FairStream: Fair Multimedia Streaming Benchmark for Reinforcement Learning Agents

作者: Jannis Weil, Jonas Ringsdorf, Julian Barthel, Yi-Ping Phoebe Chen, Tobias Meuser

分类: cs.MA, cs.AI, cs.MM

发布日期: 2024-10-28

💡 一句话要点

提出FairStream以解决多媒体流公平性问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多媒体流 公平性 强化学习 多代理环境 自适应比特率

📋 核心要点

- 现有的多媒体流强化学习方法在训练环境上过于简化,导致结果的实际应用性有限。

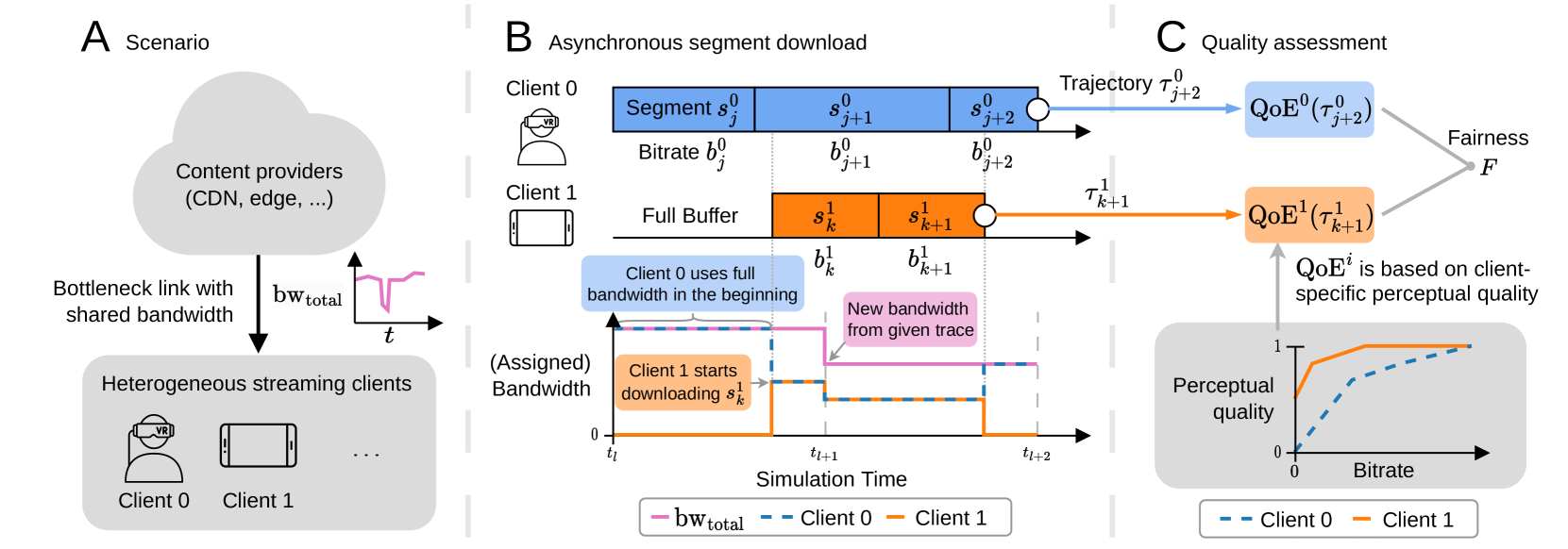

- 本文提出了一种新颖的多代理环境,解决公平多媒体流中的部分可观测性和多目标等挑战。

- 实验结果表明,简单的贪婪启发式方法在性能上超越了常用的PPO算法,提供了新的研究方向。

📝 摘要(中文)

多媒体流在当今互联网流量中占据了大部分。自适应比特率流机制根据估计带宽控制流的比特率,理想情况下实现平滑播放和良好的用户体验(QoE)。然而,在波动的网络条件下选择最佳比特率具有挑战性。这促使研究人员训练强化学习(RL)代理进行多媒体流处理。现有的训练环境往往过于简化,导致结果的适用性有限。此外,近期的RL方法很少考虑多个流之间的QoE公平性。本文提出了一种新颖的多代理环境,涵盖了公平多媒体流的多个挑战:部分可观测性、多目标、代理异质性和异步性。我们提供并分析了五种不同流量类别的基线方法,以深入了解所考虑代理的行为,并显示常用的近端策略优化(PPO)算法被简单的贪婪启发式方法超越。未来的工作包括多代理RL算法的适应和环境的进一步扩展。

🔬 方法详解

问题定义:本文旨在解决多媒体流中的公平性问题,现有方法在动态网络条件下选择最佳比特率的能力不足,且缺乏对QoE公平性的考虑。

核心思路:通过构建一个包含多个挑战的多代理环境,本文旨在训练能够适应复杂网络条件的RL代理,并考虑不同流之间的公平性。

技术框架:整体架构包括多个代理在一个共享环境中进行交互,代理通过观察环境状态和其他代理的行为来调整自己的策略,主要模块包括状态观察、策略更新和奖励计算。

关键创新:最重要的创新点在于引入了多代理环境的设计,考虑了部分可观测性和异步性等因素,这与现有方法的单一代理训练模式有本质区别。

关键设计:在参数设置上,采用了多种流量类别进行训练,损失函数设计上考虑了公平性指标,网络结构则结合了深度学习和强化学习的优势,以提高代理的学习效率。

🖼️ 关键图片

📊 实验亮点

实验结果显示,简单的贪婪启发式方法在五种不同流量类别的测试中,性能上超越了常用的PPO算法,提供了更高的QoE公平性,具体提升幅度未明确说明,但结果显著。

🎯 应用场景

该研究的潜在应用领域包括视频流媒体服务、在线游戏和实时通信等,能够显著提升用户的观看体验和满意度。通过优化多媒体流的公平性,该方法在未来可能对网络资源管理和流量调度产生深远影响。

📄 摘要(原文)

Multimedia streaming accounts for the majority of traffic in today's internet. Mechanisms like adaptive bitrate streaming control the bitrate of a stream based on the estimated bandwidth, ideally resulting in smooth playback and a good Quality of Experience (QoE). However, selecting the optimal bitrate is challenging under volatile network conditions. This motivated researchers to train Reinforcement Learning (RL) agents for multimedia streaming. The considered training environments are often simplified, leading to promising results with limited applicability. Additionally, the QoE fairness across multiple streams is seldom considered by recent RL approaches. With this work, we propose a novel multi-agent environment that comprises multiple challenges of fair multimedia streaming: partial observability, multiple objectives, agent heterogeneity and asynchronicity. We provide and analyze baseline approaches across five different traffic classes to gain detailed insights into the behavior of the considered agents, and show that the commonly used Proximal Policy Optimization (PPO) algorithm is outperformed by a simple greedy heuristic. Future work includes the adaptation of multi-agent RL algorithms and further expansions of the environment.