Rethinking the Uncertainty: A Critical Review and Analysis in the Era of Large Language Models

作者: Mohammad Beigi, Sijia Wang, Ying Shen, Zihao Lin, Adithya Kulkarni, Jianfeng He, Feng Chen, Ming Jin, Jin-Hee Cho, Dawei Zhou, Chang-Tien Lu, Lifu Huang

分类: cs.AI

发布日期: 2024-10-26

💡 一句话要点

针对LLM不确定性估计难题,提出全面分析框架以提升可靠性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 不确定性估计 可靠性 置信度 风险评估

📋 核心要点

- 现有LLM不确定性估计方法侧重于模型置信度,未能充分理解不确定性的来源和类型。

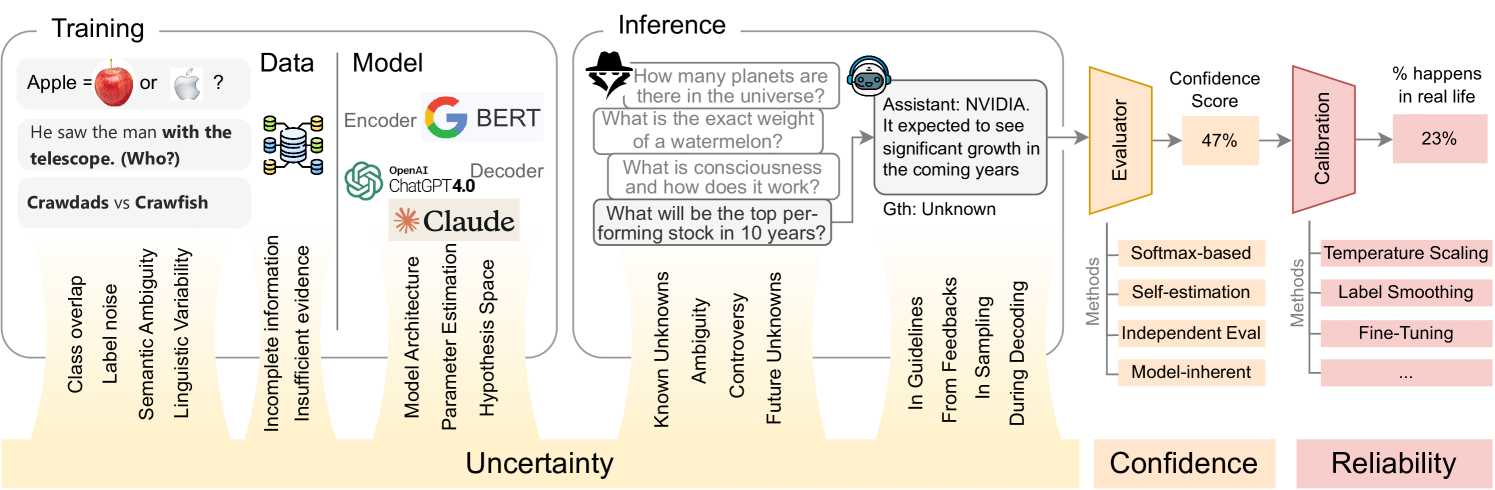

- 论文提出一个全面的框架,旨在识别和理解LLM中不确定性的类型和来源,从而更精确地量化不确定性。

- 论文分析了现有方法在关键任务和安全敏感应用中的局限性,并展望了未来研究方向。

📝 摘要(中文)

近年来,大型语言模型(LLMs)已成为广泛人工智能应用的基础。随着LLMs使用的扩展,精确估计其预测中的不确定性变得至关重要。当前的方法通常难以准确识别、测量和解决真正的不确定性,许多方法主要集中在估计模型置信度上。这种差异很大程度上是由于对不确定性何时、何地以及如何注入模型的不完全理解。本文提出了一个全面的框架,专门用于识别和理解不确定性的类型和来源,并与LLMs的独特特征相一致。我们的框架通过系统地分类和定义每种类型,增强了对不确定性多样化景象的理解,为开发能够精确量化这些不确定性的有针对性的方法奠定了坚实的基础。我们还详细介绍了关键的相关概念,并考察了当前方法在关键任务和安全敏感型应用中的局限性。最后,本文对未来的发展方向提出了展望,旨在提高这些方法在现实场景中的可靠性和实际应用。

🔬 方法详解

问题定义:当前大型语言模型(LLMs)在实际应用中面临着不确定性估计的挑战。现有方法主要关注模型输出的置信度,而忽略了不确定性的本质来源和类型,导致无法准确评估模型预测的可靠性。尤其是在关键任务和安全敏感型应用中,不准确的不确定性估计可能导致严重后果。因此,如何全面理解和精确量化LLM的不确定性是亟待解决的问题。

核心思路:论文的核心思路是构建一个全面的框架,用于识别和理解LLM中不确定性的类型和来源。该框架旨在系统地对不确定性进行分类和定义,从而为开发更精确的不确定性量化方法奠定基础。通过深入分析不确定性的根源,可以更好地理解模型预测的可靠性,并针对性地改进模型。

技术框架:该框架包含以下几个主要阶段:1) 不确定性类型识别:对LLM中可能出现的不确定性类型进行分类,例如数据不确定性、模型不确定性、认知不确定性等。2) 不确定性来源分析:分析每种类型的不确定性的具体来源,例如训练数据质量、模型结构、推理过程等。3) 不确定性量化:针对不同类型和来源的不确定性,设计相应的量化方法。4) 不确定性缓解:提出缓解不确定性影响的策略,例如数据增强、模型改进、集成学习等。

关键创新:论文的关键创新在于提出了一个系统性的框架,用于全面分析LLM中的不确定性。与现有方法仅关注模型置信度不同,该框架深入挖掘不确定性的类型和来源,从而能够更精确地量化和缓解不确定性。这种系统性的分析方法为LLM的可靠性研究提供了新的视角。

关键设计:框架的关键设计包括:1) 不确定性类型分类体系:该体系需要足够全面,能够覆盖LLM中所有可能出现的不确定性类型。2) 不确定性来源分析方法:需要设计有效的方法来识别每种类型的不确定性的具体来源。3) 不确定性量化指标:需要设计合适的指标来量化不同类型和来源的不确定性。4) 不确定性缓解策略:需要提出有效的策略来降低不确定性对模型性能的影响。

🖼️ 关键图片

📊 实验亮点

论文提出了一个全面的不确定性分析框架,为LLM的可靠性研究提供了新的视角。虽然论文没有提供具体的实验结果,但其提出的框架为后续研究奠定了基础,有望指导开发更精确的不确定性量化和缓解方法。该框架的系统性和全面性是其最大的亮点。

🎯 应用场景

该研究成果可广泛应用于对可靠性要求高的LLM应用场景,如医疗诊断、金融风控、自动驾驶等。通过更精确地估计和量化LLM的不确定性,可以提高模型预测的安全性、可靠性和可信度,从而促进LLM在关键领域的实际应用。未来,该研究有望推动LLM在更多安全敏感领域的应用,并提升人工智能系统的整体可靠性。

📄 摘要(原文)

In recent years, Large Language Models (LLMs) have become fundamental to a broad spectrum of artificial intelligence applications. As the use of LLMs expands, precisely estimating the uncertainty in their predictions has become crucial. Current methods often struggle to accurately identify, measure, and address the true uncertainty, with many focusing primarily on estimating model confidence. This discrepancy is largely due to an incomplete understanding of where, when, and how uncertainties are injected into models. This paper introduces a comprehensive framework specifically designed to identify and understand the types and sources of uncertainty, aligned with the unique characteristics of LLMs. Our framework enhances the understanding of the diverse landscape of uncertainties by systematically categorizing and defining each type, establishing a solid foundation for developing targeted methods that can precisely quantify these uncertainties. We also provide a detailed introduction to key related concepts and examine the limitations of current methods in mission-critical and safety-sensitive applications. The paper concludes with a perspective on future directions aimed at enhancing the reliability and practical adoption of these methods in real-world scenarios.