MAD-Sherlock: Multi-Agent Debate for Visual Misinformation Detection

作者: Kumud Lakara, Georgia Channing, Christian Rupprecht, Juil Sock, Philip Torr, John Collomosse, Christian Schroeder de Witt

分类: cs.AI

发布日期: 2024-10-26 (更新: 2025-10-04)

💡 一句话要点

MAD-Sherlock:用于视觉错误信息检测的多智能体辩论系统

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉错误信息检测 多智能体系统 多模态融合 辩论机制 知识检索

📋 核心要点

- 现有视觉错误信息检测方法泛化性差,依赖领域微调,且缺乏决策透明度,难以获得用户信任。

- MAD-Sherlock将错误信息检测建模为多智能体辩论,利用多模态智能体协同推理,无需领域微调。

- 实验表明,MAD-Sherlock在多个数据集上超越现有方法,并通过辩论过程提升了用户对检测结果的信任度。

📝 摘要(中文)

当前,一种极具挑战性的错误信息形式是将图像与误导性文本配对,从而构建虚假叙述。现有的AI驱动检测系统通常需要针对特定领域进行微调,限制了其泛化能力,并且缺乏对其决策过程的深入解释,从而阻碍了信任和应用。我们提出了MAD-Sherlock,一个用于检测语境外错误信息的多智能体辩论系统。MAD-Sherlock将检测过程构建为多智能体辩论,反映了在线环境中多样且冲突的讨论。多模态智能体协同工作,评估上下文一致性并检索外部信息以支持跨上下文推理。我们的框架与领域和时间无关,无需微调,但能以深入的解释实现最先进的准确性。在NewsCLIPpings、VERITE和MMFakeBench上的评估表明,它分别优于先前方法2%、3%和5%。消融研究和用户研究表明,辩论和由此产生的解释显著提高了检测性能,并提高了专家和非专家的信任度,使MAD-Sherlock成为自主公民情报的强大工具。

🔬 方法详解

问题定义:论文旨在解决视觉错误信息检测问题,即判断图像和文本描述是否一致,是否存在误导性信息。现有方法通常需要针对特定领域进行微调,泛化能力较差,并且缺乏透明的决策过程,难以解释其判断依据。

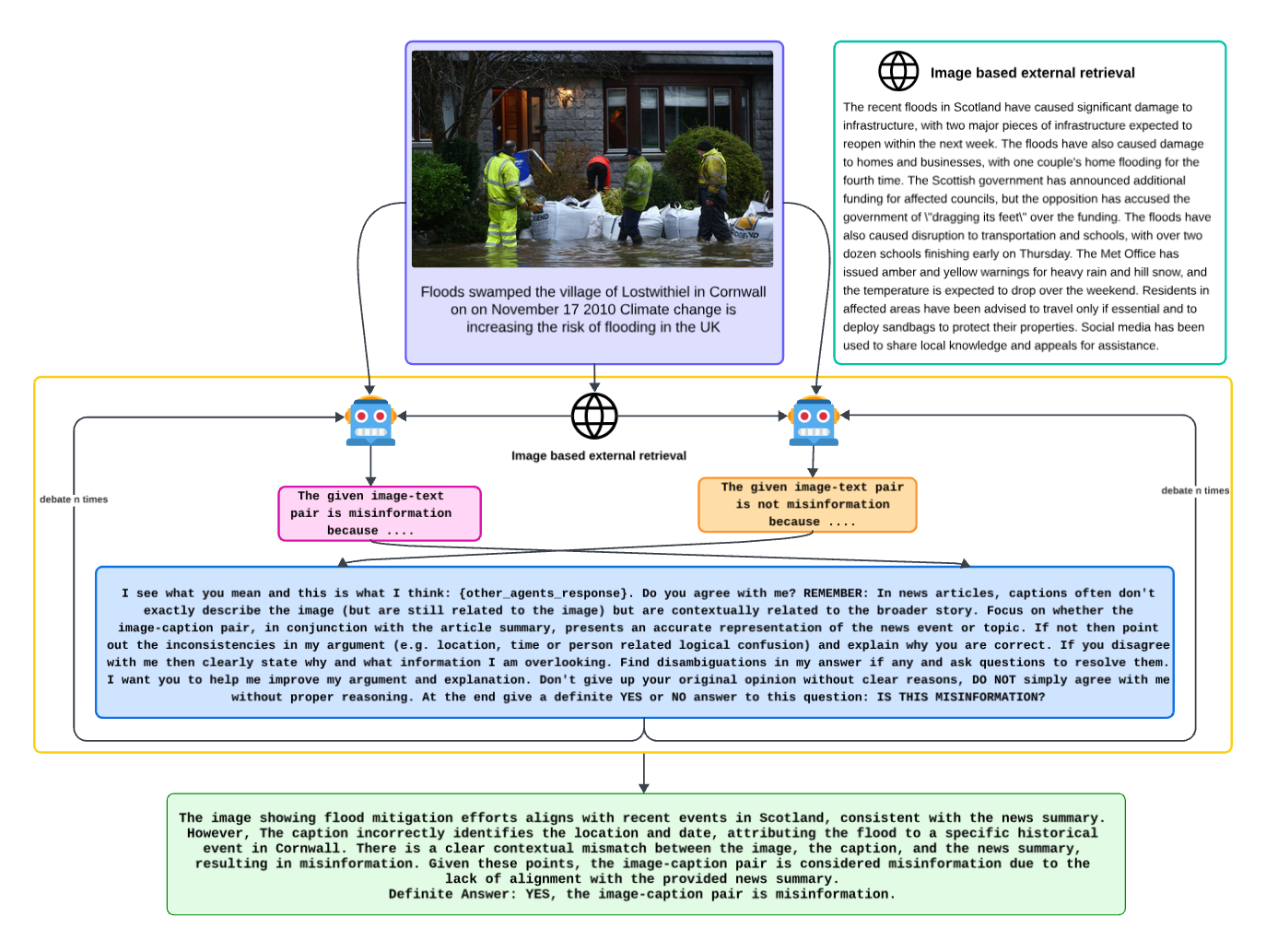

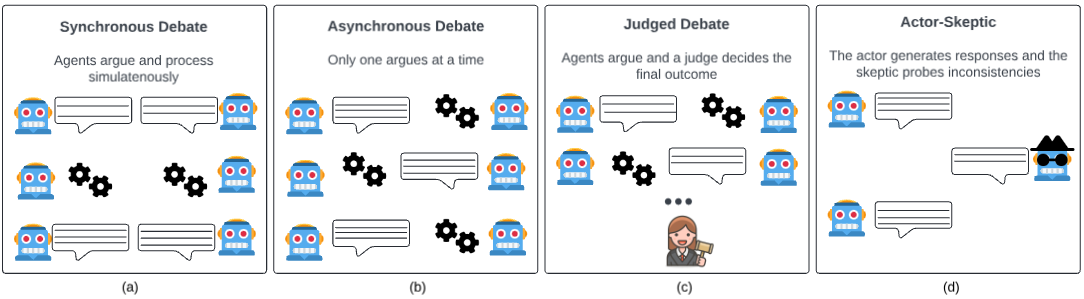

核心思路:论文的核心思路是将错误信息检测建模为一个多智能体辩论过程。每个智能体代表一个不同的视角或信息来源,通过辩论和协商来达成共识,从而提高检测的准确性和可解释性。这种方法模拟了人类在面对复杂问题时进行讨论和辩论的过程,能够更好地利用多模态信息和外部知识。

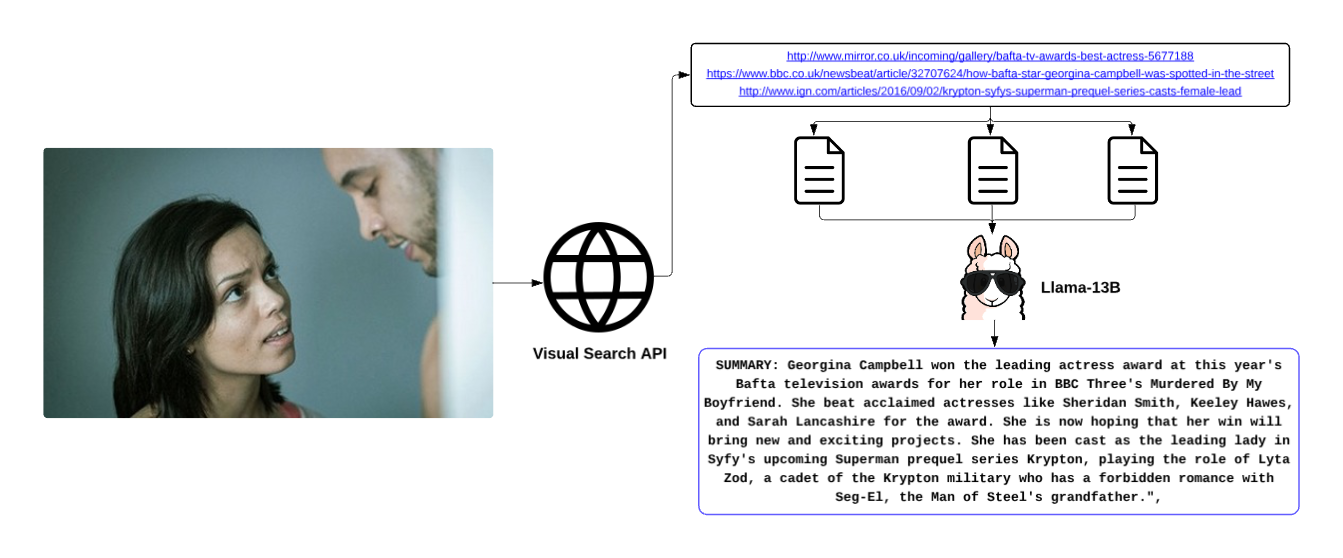

技术框架:MAD-Sherlock框架包含多个多模态智能体,每个智能体可以访问图像、文本和外部知识库。这些智能体通过消息传递进行辩论,交换观点和证据。框架主要包含以下模块:1) 特征提取模块:提取图像和文本的特征表示。2) 知识检索模块:从外部知识库中检索相关信息。3) 辩论模块:智能体之间通过消息传递进行辩论,交换观点和证据。4) 决策模块:根据辩论结果做出最终的判断。

关键创新:MAD-Sherlock的关键创新在于将多智能体辩论引入视觉错误信息检测领域。与传统的单模型方法相比,多智能体辩论能够更好地利用多模态信息和外部知识,提高检测的准确性和可解释性。此外,该框架具有良好的泛化能力,无需针对特定领域进行微调。

关键设计:智能体使用预训练的多模态模型(例如CLIP)提取图像和文本的特征表示。知识检索模块使用文本查询从外部知识库(例如Wikipedia)中检索相关信息。辩论模块使用Transformer网络进行消息传递,智能体之间交换观点和证据。决策模块使用一个分类器来判断图像和文本是否一致。

🖼️ 关键图片

📊 实验亮点

MAD-Sherlock在NewsCLIPpings、VERITE和MMFakeBench三个数据集上分别取得了2%、3%和5%的性能提升,超越了现有方法。消融实验表明,辩论机制和外部知识检索对性能提升有重要作用。用户研究表明,MAD-Sherlock的辩论过程能够提高用户对检测结果的信任度,即使对于非专业人士也具有很强的说服力。

🎯 应用场景

MAD-Sherlock可应用于社交媒体平台、新闻网站等场景,自动检测和标记视觉错误信息,帮助用户识别虚假信息,提高信息的可信度。该研究有助于构建更健康的网络生态环境,减少虚假信息对社会造成的负面影响。未来可扩展到其他类型的多模态信息检测任务。

📄 摘要(原文)

One of the most challenging forms of misinformation involves pairing images with misleading text to create false narratives. Existing AI-driven detection systems often require domain-specific finetuning, limiting generalizability, and offer little insight into their decisions, hindering trust and adoption. We introduce MAD-Sherlock, a multi-agent debate system for out-of-context misinformation detection. MAD-Sherlock frames detection as a multi-agent debate, reflecting the diverse and conflicting discourse found online. Multimodal agents collaborate to assess contextual consistency and retrieve external information to support cross-context reasoning. Our framework is domain- and time-agnostic, requiring no finetuning, yet achieves state-of-the-art accuracy with in-depth explanations. Evaluated on NewsCLIPpings, VERITE, and MMFakeBench, it outperforms prior methods by 2%, 3%, and 5%, respectively. Ablation and user studies show that the debate and resultant explanations significantly improve detection performance and improve trust for both experts and non-experts, positioning MAD-Sherlock as a robust tool for autonomous citizen intelligence.