Advancing NLP Security by Leveraging LLMs as Adversarial Engines

作者: Sudarshan Srinivasan, Maria Mahbub, Amir Sadovnik

分类: cs.AI, cs.CL

发布日期: 2024-10-23

备注: 5 pages

💡 一句话要点

利用大型语言模型作为对抗引擎,提升自然语言处理安全性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自然语言处理安全 对抗攻击 大型语言模型 对抗样本生成 模型鲁棒性

📋 核心要点

- 现有NLP安全方法在生成多样化和语义连贯的对抗样本方面存在不足,难以有效评估和提升模型鲁棒性。

- 论文提出利用LLMs强大的语言理解和生成能力,作为对抗引擎来生成更有效、更逼真的对抗样本。

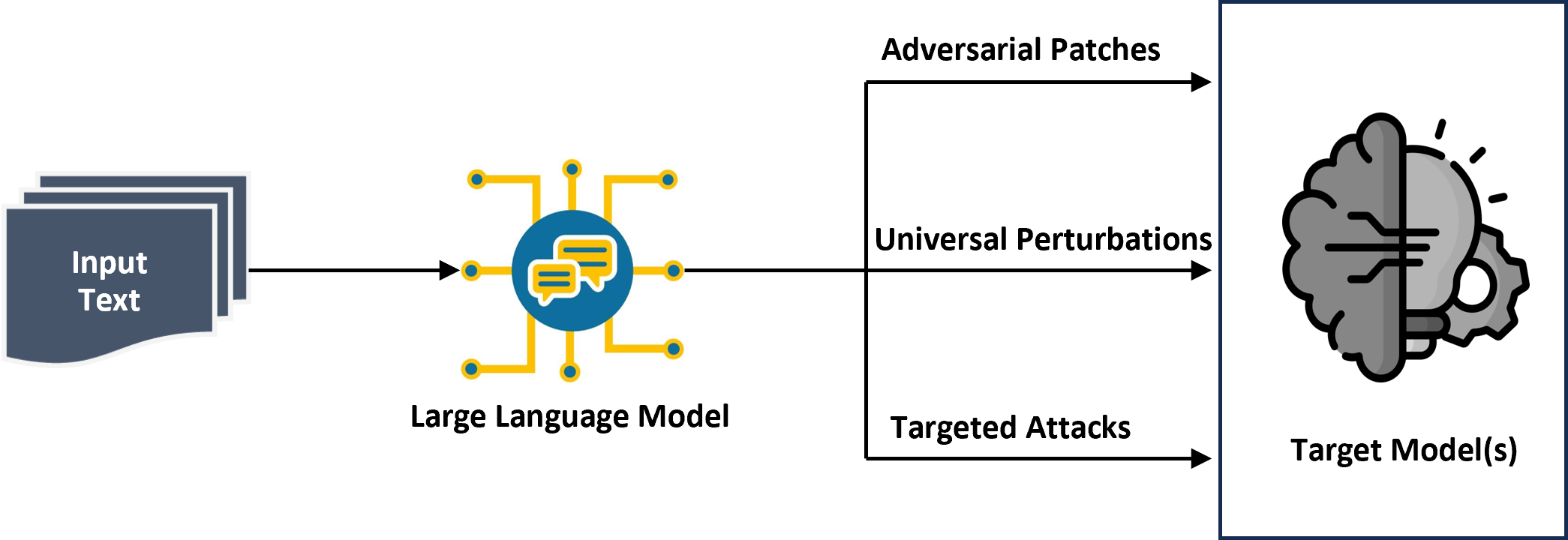

- 该方法旨在扩展LLMs在对抗样本生成方面的应用,涵盖对抗补丁、通用扰动和目标攻击等多种攻击类型。

📝 摘要(中文)

本文提出了一种新颖的方法,通过利用大型语言模型(LLMs)作为引擎来生成多样化的对抗性攻击,从而提升自然语言处理(NLP)的安全性。基于最近的研究表明LLMs在创建词级别对抗样本方面的有效性,我们认为应该扩展这一概念,以涵盖更广泛的攻击类型,包括对抗补丁、通用扰动和目标攻击。我们认为,LLMs复杂的语言理解和生成能力可以在各种领域和分类器架构中产生更有效、语义连贯且类似人类的对抗样本。这种对抗性NLP的范式转变具有深远的影响,可能增强模型的鲁棒性,发现新的漏洞,并推动防御机制的创新。通过探索这个新的前沿,我们旨在为开发更安全、可靠和值得信赖的NLP系统做出贡献,以用于关键应用。

🔬 方法详解

问题定义:现有的NLP模型容易受到对抗攻击的影响,攻击者通过构造细微的输入扰动,就能使模型产生错误的预测。传统的对抗攻击方法通常依赖于梯度信息或简单的规则,生成的对抗样本可能语义不连贯,容易被人类或防御机制识别。因此,如何生成更有效、更隐蔽的对抗样本,是提升NLP模型安全性的关键挑战。

核心思路:论文的核心思路是利用大型语言模型(LLMs)强大的语言理解和生成能力,将LLMs作为对抗引擎,自动生成多样化、语义连贯的对抗样本。LLMs能够理解上下文信息,生成更自然、更逼真的文本,从而使生成的对抗样本更难以被检测。

技术框架:该论文属于position paper,主要提出了一种新的研究方向和思路,并没有具体的算法框架。其核心思想是利用LLMs来生成各种类型的对抗攻击,包括:1) 词级别对抗样本:利用LLMs生成与原始词语语义相似的替代词;2) 对抗补丁:利用LLMs生成具有迷惑性的文本片段,插入到原始输入中;3) 通用扰动:利用LLMs生成可以应用于多个输入的通用扰动;4) 目标攻击:利用LLMs生成能够使模型预测为特定目标的对抗样本。

关键创新:该论文的关键创新在于将LLMs引入到对抗攻击领域,利用LLMs强大的语言生成能力,生成更有效、更隐蔽的对抗样本。与传统的对抗攻击方法相比,该方法生成的对抗样本更具有语义连贯性,更难以被人类或防御机制识别。

关键设计:由于是position paper,没有具体的算法细节。未来的研究可以探索如何设计合适的prompt,引导LLMs生成特定类型的对抗样本;如何优化LLMs的生成过程,提高对抗样本的生成效率;以及如何评估LLMs生成的对抗样本的有效性和隐蔽性。

🖼️ 关键图片

📊 实验亮点

该论文属于前瞻性研究,主要提出了利用LLMs作为对抗引擎的新思路,并没有提供具体的实验结果。未来的研究可以基于该思路,设计具体的算法和实验,验证LLMs在生成对抗样本方面的有效性,并与其他对抗攻击方法进行比较,评估其性能提升。

🎯 应用场景

该研究成果可应用于提升各种NLP系统的安全性,例如情感分析、文本分类、机器翻译等。通过利用LLMs生成的对抗样本进行对抗训练,可以增强模型的鲁棒性,提高模型在实际应用中的可靠性。此外,该研究还可以用于发现NLP模型中存在的潜在漏洞,为开发更有效的防御机制提供指导。

📄 摘要(原文)

This position paper proposes a novel approach to advancing NLP security by leveraging Large Language Models (LLMs) as engines for generating diverse adversarial attacks. Building upon recent work demonstrating LLMs' effectiveness in creating word-level adversarial examples, we argue for expanding this concept to encompass a broader range of attack types, including adversarial patches, universal perturbations, and targeted attacks. We posit that LLMs' sophisticated language understanding and generation capabilities can produce more effective, semantically coherent, and human-like adversarial examples across various domains and classifier architectures. This paradigm shift in adversarial NLP has far-reaching implications, potentially enhancing model robustness, uncovering new vulnerabilities, and driving innovation in defense mechanisms. By exploring this new frontier, we aim to contribute to the development of more secure, reliable, and trustworthy NLP systems for critical applications.