VLASCD: A Visual Language Action Model for Simultaneous Chatting and Decision Making

作者: Zuojin Tang, Bin Hu, Chenyang Zhao, De Ma, Gang Pan, Bin Liu

分类: cs.AI

发布日期: 2024-10-21 (更新: 2025-08-25)

备注: Accepted by EMNLP 2025 (Main Conference)

💡 一句话要点

提出VLASCD,解决多模态多任务并行执行中聊天与决策的互斥问题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 多任务学习 视觉语言模型 自动驾驶 人机交互

📋 核心要点

- 现有LLM和VLA模型采用的MISO范式在多任务并行处理时存在任务竞争和性能下降的问题。

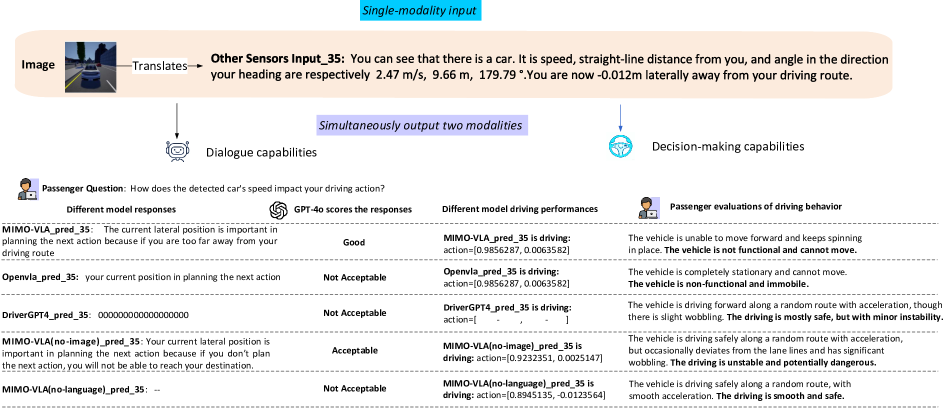

- MIMO-VLA通过统一的训练框架,实现并发的多任务输出,消除任务间的干扰,提升并行处理效率。

- 在CARLA自动驾驶平台上的实验表明,MIMO-VLA显著优于现有MISO模型,验证了其有效性。

📝 摘要(中文)

现有的大型预训练模型,如LLM(例如GPT系列)和VLA(例如OpenVLA),在多模态任务上取得了显著进展,但它们都基于多输入单输出(MISO)范式。本文指出,这种范式从根本上限制了多输入多输出(MIMO)场景下的性能,尤其是在需要并行任务执行时。在MISO架构中,任务竞争共享的输出通道,产生互斥效应,导致不平衡的优化和性能下降。为了解决这个问题,本文提出了MIMO-VLA(VLASCD),一个统一的训练框架,能够实现并发的多任务输出,例如同时进行对话生成和决策。受到人类认知的启发,MIMO-VLA消除了任务之间的干扰,并支持高效的并行处理。在CARLA自动驾驶平台上的实验表明,在MIMO设置中,MIMO-VLA显著优于最先进的基于MISO的LLM、强化学习模型和VLA,为多模态和多任务学习开辟了一个新的方向。

🔬 方法详解

问题定义:论文旨在解决多模态场景下,特别是自动驾驶等需要同时进行对话交互和决策控制的任务中,现有模型采用的多输入单输出(MISO)架构所带来的局限性。MISO架构在处理并行任务时,各个任务会竞争共享的输出通道,导致任务间相互干扰,优化不平衡,最终影响整体性能。现有方法难以实现高效且准确的并行聊天和决策。

核心思路:论文的核心思路是借鉴人类认知中并行处理信息的能力,设计一种多输入多输出(MIMO)的视觉语言动作模型(VLA),即VLASCD。通过解耦不同任务的输出通道,消除任务间的互斥效应,从而实现高效的并行处理。这种设计允许模型同时生成对话并做出驾驶决策,避免了任务间的竞争和干扰。

技术框架:VLASCD的整体架构是一个统一的训练框架,它接收多模态输入(例如,视觉信息和语言指令),并同时输出多个任务的结果(例如,对话回复和驾驶动作)。具体来说,该框架可能包含以下模块:多模态编码器(用于提取输入特征)、任务特定解码器(用于生成不同任务的输出)以及任务解耦机制(用于消除任务间的干扰)。训练过程中,模型通过联合优化多个任务的损失函数来学习并行处理能力。

关键创新:VLASCD最重要的技术创新在于其MIMO架构,它允许模型同时处理多个任务并生成多个输出,而无需像MISO架构那样进行任务调度或优先级排序。这种架构能够更自然地模拟人类的认知过程,并更有效地利用计算资源。此外,VLASCD还可能引入了任务解耦机制,以进一步减少任务间的干扰。

关键设计:具体的网络结构细节(例如,编码器和解码器的类型、层数、激活函数等)以及损失函数的设计(例如,是否使用加权损失、是否引入正则化项等)是影响VLASCD性能的关键因素。此外,任务解耦机制的具体实现方式(例如,使用注意力机制、使用独立的参数空间等)也会对模型的并行处理能力产生重要影响。论文中可能还涉及一些超参数的设置,例如学习率、batch size等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在CARLA自动驾驶平台上,VLASCD模型在同时进行聊天和决策的任务中,显著优于基于MISO的LLM、强化学习模型和VLA。具体的性能提升数据(例如,驾驶成功率、对话流畅度等)需要在论文中查找。这些结果验证了VLASCD模型在MIMO场景下的优越性。

🎯 应用场景

VLASCD模型在自动驾驶领域具有广阔的应用前景,可以用于构建更智能、更安全的自动驾驶系统。例如,它可以同时处理乘客的语音指令和感知环境信息,从而做出更合理的驾驶决策。此外,该模型还可以应用于机器人、智能助手等领域,实现更自然、更高效的人机交互。

📄 摘要(原文)

Recent large pretrained models such as LLMs (e.g., GPT series) and VLAs (e.g., OpenVLA) have achieved notable progress on multimodal tasks, yet they are built upon a multi-input single-output (MISO) paradigm. We show that this paradigm fundamentally limits performance in multi-input multi-output (MIMO) scenarios, where parallel task execution is required. In MISO architectures, tasks compete for a shared output channel, creating mutual exclusion effects that cause unbalanced optimization and degraded performance. To address this gap, we introduce MIMO-VLA (VLASCD), a unified training framework that enables concurrent multi-task outputs, exemplified by simultaneous dialogue generation and decision-making. Inspired by human cognition, MIMO-VLA eliminates interference between tasks and supports efficient parallel processing. Experiments on the CARLA autonomous driving platform demonstrate that MIMO-VLA substantially outperforms state-of-the-art MISO-based LLMs, reinforcement learning models, and VLAs in MIMO settings, establishing a new direction for multimodal and multitask learning.