Joint Verification and Refinement of Language Models for Safety-Constrained Planning

作者: Yunhao Yang, Neel P. Bhatt, William Ward, Zichao Hu, Joydeep Biswas, Ufuk Topcu

分类: cs.AI, cs.FL, cs.RO

发布日期: 2024-10-18 (更新: 2025-11-06)

💡 一句话要点

提出一种基于验证与优化的语言模型方法,用于生成安全约束下的机器人规划程序。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语言模型 机器人规划 安全约束 形式化验证 自动机 程序验证 模型微调

📋 核心要点

- 现有语言模型生成的机器人程序常违反任务安全规范,缺乏有效的验证方法,限制了其在实际系统中的可靠部署。

- 该方法将程序转换为自动机表示,并验证其是否满足安全规范,同时证明了安全子程序的组合仍然安全,降低了验证复杂性。

- 实验结果表明,该方法能显著提高生成安全程序的概率(30%),并大幅缩短训练时间(50%),提升了模型安全性和效率。

📝 摘要(中文)

大型语言模型在从自然语言描述生成用于执行机器人任务的程序(例如Python)方面表现出令人印象深刻的能力。然而,这些生成的程序常常包含违反外部给定的任务规范的错误。如果没有有效的方法来验证其正确性,那么在实际系统中可靠地部署语言模型实际上是不可行的。本文开发了一种方法,将生成的机器人程序转换为基于自动机的表示,并根据任务相关的安全规范对其进行验证。本文建立了一个定理,即经过验证的程序的任意组合也将满足安全规范。因此,该方法消除了验证由多个简单程序组成的复杂程序的需要,从而降低了计算复杂度。然后,本文介绍了一种自动微调程序,该程序利用验证结果进行监督。通过应用该定理,该程序只需要训练模型生成安全的子组件,从而提高训练效率。在机器人应用上的实验结果表明,生成符合规范的程序的概率提高了30%,与对生成完整程序进行微调相比,训练时间减少了一半。

🔬 方法详解

问题定义:现有的大型语言模型虽然能够根据自然语言指令生成机器人程序,但这些程序经常包含错误,导致违反预先设定的安全约束。缺乏有效的验证机制使得这些模型难以在实际的机器人应用中可靠部署。现有的方法通常需要验证整个复杂程序,计算成本高昂。

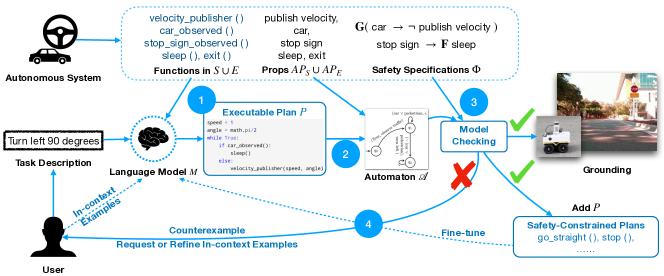

核心思路:本文的核心思路是将生成的机器人程序转化为基于自动机的形式化表示,然后利用形式化验证技术来检查程序是否满足给定的安全规范。此外,本文提出了一个关键定理:如果程序的各个子组件都通过了安全验证,那么这些子组件的任意组合也将满足安全规范。这使得我们可以将复杂的程序分解为更小的、易于验证的子组件,从而大大降低了验证的计算复杂度。

技术框架:该方法包含两个主要阶段:程序验证和模型优化。在程序验证阶段,首先将语言模型生成的机器人程序转换为自动机表示。然后,使用形式化验证工具(例如模型检查器)来验证该自动机是否满足给定的安全规范。在模型优化阶段,利用验证结果作为监督信号来微调语言模型。具体来说,模型被训练成生成通过验证的子组件,而不是直接生成完整的程序。

关键创新:该方法最重要的创新在于提出了安全子组件组合的安全性定理。这个定理使得我们可以将复杂的程序验证问题分解为更简单的子组件验证问题,从而显著降低了计算复杂度。此外,利用验证结果进行监督式微调,可以有效地提高模型生成安全程序的能力。

关键设计:在程序验证阶段,需要选择合适的自动机表示和形式化验证工具。具体选择取决于机器人程序的类型和安全规范的复杂程度。在模型优化阶段,损失函数的设计至关重要。一种可能的设计是使用交叉熵损失函数,鼓励模型生成通过验证的子组件。此外,还可以使用强化学习技术来进一步优化模型的性能。具体的网络结构取决于所使用的语言模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法能够显著提高生成符合安全规范的机器人程序的概率,提升幅度达到30%。同时,与直接对生成完整程序的语言模型进行微调相比,该方法的训练时间减少了一半。这些结果表明,该方法在提高程序安全性和训练效率方面具有显著优势。

🎯 应用场景

该研究成果可广泛应用于机器人自动化、自动驾驶、智能制造等领域。通过确保机器人程序的安全性,可以避免潜在的事故和损失,提高系统的可靠性和效率。该方法还有助于降低机器人编程的门槛,使得非专业人员也能更容易地使用自然语言指令来控制机器人。

📄 摘要(原文)

Large language models possess impressive capabilities in generating programs (e.g., Python) from natural language descriptions to execute robotic tasks. However, these generated programs often contain errors that violate externally given task specifications. Without an effective method to verify their correctness, the reliable deployment of language models in real-world systems is practically infeasible. We develop a method that converts generated robot programs into an automaton-based representation and verifies them against task-relevant safety specifications. We establish a theorem that any arbitrary combination of the verified programs will also satisfy the safety specifications. Hence, the method eliminates the need to verify complex programs composed of multiple simpler ones, reducing computation complexity. We then introduce an automated fine-tuning procedure that leverages verification outcomes for supervision. By applying the theorem, this procedure only requires training the model to generate safe sub-components, thereby improving training efficiency. Empirical results on robot applications show a 30 percent increase in the probability of generating specification-compliant programs, with training time reduced by half compared to fine-tuning on generating full programs.