Holistic Utility Preference Learning for Listwise Alignment

作者: Jiacong Zhou, Xianyun Wang, Min Zhang, Jun Yu

分类: cs.IR, cs.AI, cs.CL, cs.LG

发布日期: 2024-10-17 (更新: 2025-12-16)

💡 一句话要点

提出DRPO,通过优化排序偏好解决LLM对齐中的列表级偏好学习问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 偏好学习 排序学习 直接偏好优化 人类反馈强化学习

📋 核心要点

- 现有基于成对比较的偏好学习方法无法充分利用列表式排序中蕴含的丰富信息,限制了模型对人类偏好的准确捕捉。

- DRPO将偏好对齐视为排序学习任务,通过优化基于NDCG的整体效用分数,直接优化响应列表的排序,从而更好地学习人类偏好。

- 实验结果表明,DRPO在生成响应的质量方面优于现有方法,验证了其在列表式偏好学习中的有效性。

📝 摘要(中文)

为了使大型语言模型更好地反映人类价值观,与人类偏好对齐至关重要。一种有前景的策略是基于人类反馈的强化学习(RLHF),首先收集并排序由监督微调模型生成的响应,以改进对齐。现有的方法,如直接偏好优化(DPO),侧重于成对比较,将响应分为首选和较不首选的对,并优化成对边际。然而,这种成对方法无法捕捉多个响应之间的整体排序关系,也无法有效利用列表式比较中丰富的偏好信息。为了解决这个挑战,本文提出了一种新的直接排序偏好优化(DRPO)方法,该方法将人类偏好对齐视为一个排序学习(LTR)任务。与成对方法不同,DRPO通过计算基于NDCG(一种标准的LTR指标)的整体效用分数来优化整个响应列表的偏好排序。为了实现与不可微的NDCG的端到端优化,我们提出了一种diffNDCG损失,这是一种由排序网络促进的可微近似。此外,我们引入了一种新的基于边际的自适应排序策略分数,以提高生成响应的判别质量。大量的实验表明,DRPO优于现有方法,提高了生成响应的质量。

🔬 方法详解

问题定义:现有方法,如DPO,主要依赖于成对比较来学习人类偏好,即将响应分为“更好”和“更差”两类。这种方法忽略了多个响应之间的整体排序关系,无法充分利用列表式排序数据中蕴含的丰富信息。因此,如何有效地利用列表式排序数据来提升LLM与人类偏好的对齐程度是一个关键问题。

核心思路:DRPO的核心思路是将人类偏好对齐问题转化为一个排序学习(Learning-to-Rank, LTR)问题。通过直接优化整个响应列表的排序,而不是仅仅关注成对比较,DRPO能够更好地捕捉人类对多个响应的整体偏好。这种方法允许模型学习更细粒度的偏好关系,从而生成更符合人类期望的响应。

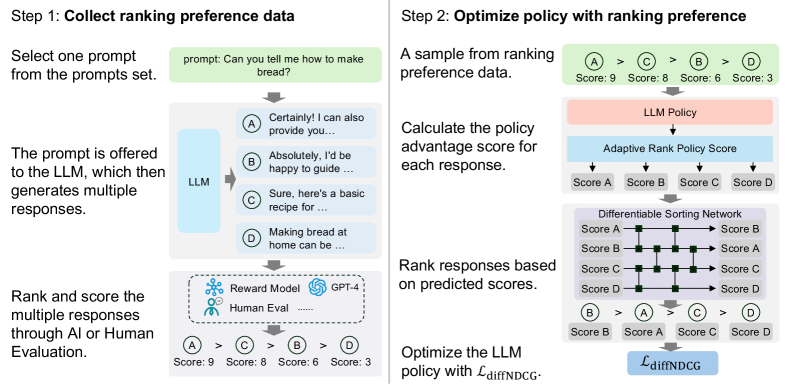

技术框架:DRPO的整体框架包括以下几个主要步骤:1) 收集包含多个响应及其人类偏好排序的列表式数据;2) 使用一个语言模型生成多个响应;3) 使用diffNDCG损失计算生成响应的排序损失,diffNDCG是NDCG的一个可微近似,允许端到端优化;4) 使用自适应排序策略分数来增强生成响应的区分度;5) 通过优化模型参数,使生成的响应排序更接近人类偏好排序。

关键创新:DRPO的关键创新在于:1) 将偏好学习问题转化为排序学习问题,从而能够利用列表式排序数据中的全部信息;2) 提出了diffNDCG损失,这是一个NDCG的可微近似,允许端到端优化;3) 引入了自适应排序策略分数,以提高生成响应的区分度。与现有方法相比,DRPO能够更有效地学习人类偏好,并生成更高质量的响应。

关键设计:diffNDCG损失是DRPO的关键组成部分。由于NDCG本身是不可微的,DRPO使用一个排序网络来近似NDCG,从而实现可微的损失函数。自适应排序策略分数的设计旨在鼓励模型生成更具区分度的响应,避免生成过于相似的响应。具体的参数设置和网络结构细节在论文中有详细描述,但总体目标是使模型能够更好地学习和模拟人类的排序偏好。

🖼️ 关键图片

📊 实验亮点

实验结果表明,DRPO在多个数据集上均优于现有的偏好学习方法,包括DPO。具体而言,DRPO在生成响应的质量和与人类偏好的对齐程度上均有显著提升。这些结果验证了DRPO在列表式偏好学习中的有效性,并表明其具有实际应用潜力。

🎯 应用场景

DRPO方法可广泛应用于各种需要与人类偏好对齐的大型语言模型应用场景,例如对话系统、文本生成、内容推荐等。通过更准确地学习和模拟人类偏好,DRPO可以显著提升用户体验,并确保AI系统的输出更符合人类价值观和伦理规范。未来,DRPO还可以扩展到其他模态,例如图像和视频生成,以实现更广泛的应用。

📄 摘要(原文)

Aligning large language models with human preferences is essential for improving interaction quality and safety by ensuring outputs better reflect human values. A promising strategy involves Reinforcement Learning from Human Feedback (RLHF), starting with collecting and ranking responses generated by a supervised fine-tuning model to refine alignment. Existing methods such as Direct Preference Optimization (DPO) focus on pairwise comparisons, categorizing responses into preferred and less preferred pairs and optimizing pairwise margins. However, this pairwise approach cannot capture the holistic ranking relationships among multiple responses or effectively leverage the rich preference information available in list-wise comparisons. To address this challenge, this paper introduces \underline{D}irect \underline{R}anking \underline{P}reference \underline{O}ptimization (DRPO), a novel method that views human preference alignment as a Learning-to-Rank (LTR) task. Unlike pairwise methods, DRPO optimizes the preference ranking of entire response lists by computing holistic utility scores through NDCG, a standard LTR metric. To enable end-to-end optimization with the non-differentiable NDCG, we propose diffNDCG loss, a differentiable approximation facilitated by a sorting network. Furthermore, we introduce a novel margin-based Adaptive Rank Policy Score to enhance the discriminative quality of generated responses. Extensive experiments have shown that DRPO outperforms existing methods, enhancing the quality of the generated responses.