Goal Inference from Open-Ended Dialog

作者: Rachel Ma, Jingyi Qu, Andreea Bobu, Dylan Hadfield-Menell

分类: cs.AI, cs.LG, cs.RO

发布日期: 2024-10-17

备注: 6 pages + 2 page (references and appendix)

💡 一句话要点

提出一种在线方法,通过对话进行目标推断,提升具身智能体完成用户目标的能力。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 目标推断 具身智能体 大型语言模型 贝叶斯推断 人机对话

📋 核心要点

- 现有离线方法(如RLHF)虽然能表示多样目标,但依赖大量数据,限制了其应用。

- 该方法利用LLM对话提取目标表示,并进行贝叶斯推断,实现高效的在线目标学习。

- 实验表明,该方法在杂货店购物和家庭机器人辅助任务中,优于其他基线方法。

📝 摘要(中文)

本文提出了一种在线方法,使具身智能体能够学习并完成多样化的用户目标。与离线方法(如RLHF)相比,虽然离线方法可以表示各种目标,但需要大量数据集,而本文提出的方法通过在线方式实现了类似的灵活性和效率。该方法从与大型语言模型(LLM)的对话中提取自然语言目标表示。通过提示LLM扮演具有不同目标的人类角色,并使用相应的可能性对潜在目标进行贝叶斯推断。因此,该方法能够基于不受限制的对话来表示复杂目标的不确定性。在杂货店购物和家庭机器人辅助领域,分别使用基于文本的界面和AI2Thor模拟环境对该方法进行了评估。结果表明,该方法优于缺乏显式目标表示或概率推理的基线方法。

🔬 方法详解

问题定义:论文旨在解决具身智能体如何高效地从与用户的开放式对话中推断用户目标,并完成这些目标的问题。现有方法,特别是离线方法(如RLHF),虽然能够表示各种目标,但需要大量的训练数据,这在实际应用中往往难以满足。因此,如何利用少量交互数据快速准确地推断用户目标是本研究的核心问题。

核心思路:论文的核心思路是利用大型语言模型(LLM)的强大语言理解和生成能力,通过与LLM的对话来获取用户目标的自然语言表示,并使用贝叶斯推断来处理目标的不确定性。通过将LLM作为模拟用户,可以生成各种可能的目标及其对应的对话,从而为目标推断提供数据。

技术框架:该方法主要包含以下几个阶段:1) 对话生成:使用LLM扮演具有不同目标的用户,生成与智能体的对话。2) 目标表示提取:从对话中提取自然语言目标表示。3) 贝叶斯推断:基于对话内容和预定义的潜在目标集合,使用贝叶斯推断计算每个目标的后验概率。4) 目标执行:根据推断的目标概率分布,智能体选择并执行相应的动作。

关键创新:该方法最重要的创新点在于将LLM作为用户模拟器,通过对话生成来获取目标表示,并结合贝叶斯推断来处理目标的不确定性。与传统的基于监督学习或强化学习的方法相比,该方法不需要大量的标注数据,并且能够处理复杂和开放式的用户目标。此外,该方法是online的,可以随着交互的进行不断更新目标概率分布。

关键设计:在对话生成阶段,通过prompt工程来引导LLM生成具有特定目标的对话。在贝叶斯推断阶段,需要定义潜在目标集合的先验概率,并根据LLM生成的对话计算似然度。具体来说,可以使用LLM生成对话的概率作为似然度,或者使用其他更复杂的模型来评估对话与目标的匹配程度。在目标执行阶段,可以采用各种策略,例如选择概率最高的的目标,或者根据目标概率分布进行采样。

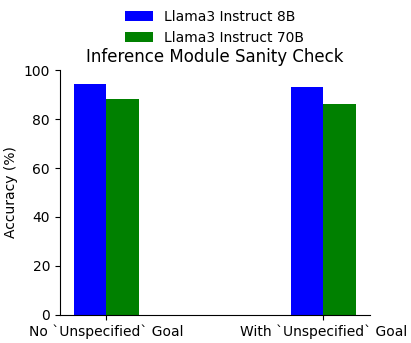

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在杂货店购物和家庭机器人辅助任务中,优于缺乏显式目标表示或概率推理的基线方法。具体性能数据未知,但摘要强调了该方法在在线学习效率和处理复杂目标不确定性方面的优势。

🎯 应用场景

该研究成果可广泛应用于家庭服务机器人、智能助手、人机协作等领域。例如,家庭服务机器人可以通过与用户的对话,理解用户的需求,并完成相应的任务,如清洁、烹饪、购物等。在人机协作场景中,智能助手可以根据用户的指令和反馈,推断用户的意图,并提供个性化的服务。

📄 摘要(原文)

We present an online method for embodied agents to learn and accomplish diverse user goals. While offline methods like RLHF can represent various goals but require large datasets, our approach achieves similar flexibility with online efficiency. We extract natural language goal representations from conversations with Large Language Models (LLMs). We prompt an LLM to role play as a human with different goals and use the corresponding likelihoods to run Bayesian inference over potential goals. As a result, our method can represent uncertainty over complex goals based on unrestricted dialog. We evaluate our method in grocery shopping and home robot assistance domains using a text-based interface and AI2Thor simulation respectively. Results show our method outperforms ablation baselines that lack either explicit goal representation or probabilistic inference.