MobA: Multifaceted Memory-Enhanced Adaptive Planning for Efficient Mobile Task Automation

作者: Zichen Zhu, Hao Tang, Yansi Li, Dingye Liu, Hongshen Xu, Kunyao Lan, Danyang Zhang, Yixuan Jiang, Hao Zhou, Chenrun Wang, Situo Zhang, Liangtai Sun, Yixiao Wang, Yuheng Sun, Lu Chen, Kai Yu

分类: cs.MA, cs.AI, cs.CL, cs.HC

发布日期: 2024-10-17 (更新: 2025-05-13)

备注: NAACL 2025 Demo Track [code] https://github.com/OpenDFM/MobA [dataset] https://huggingface.co/datasets/OpenDFM/MobA-MobBench

DOI: 10.18653/v1/2025.naacl-demo.43

💡 一句话要点

MobA:多方面记忆增强的自适应规划,用于高效移动任务自动化

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 移动任务自动化 多模态大型语言模型 自适应规划 多方面记忆 图形用户界面 智能助手 人机交互

📋 核心要点

- 现有的MLLM智能体在处理移动设备GUI交互时,难以应对环境的动态性、结构化信息以及动作空间的多样性。

- MobA通过引入自适应规划模块和多方面记忆模块,动态调整计划并提供全面记忆支持,从而提升智能体的适应性和效率。

- MobA在MobBench和AndroidArena数据集上进行了实验,结果表明其能够有效处理动态GUI环境并完成复杂的移动任务。

📝 摘要(中文)

现有的基于多模态大型语言模型(MLLM)的智能体在处理设备上复杂的图形用户界面(GUI)交互时面临重大挑战。这些挑战源于GUI环境的动态性和结构化特性,它整合了文本、图像和空间关系,以及不同页面和任务中动作空间的可变性。为了解决这些限制,我们提出了MobA,一种新颖的基于MLLM的移动助手系统。MobA引入了一个自适应规划模块,该模块结合了用于错误恢复的反射机制,并动态调整计划以适应真实环境上下文和动作模块的执行能力。此外,一个多方面的记忆模块提供了全面的记忆支持,以增强适应性和效率。我们还提出了MobBench,一个为复杂移动交互设计的数据集。在MobBench和AndroidArena上的实验结果证明了MobA处理动态GUI环境和执行复杂移动任务的能力。

🔬 方法详解

问题定义:论文旨在解决MLLM智能体在移动设备上进行复杂GUI交互时面临的挑战。现有方法难以有效处理GUI环境的动态性、结构化信息(文本、图像、空间关系)以及不同页面和任务中动作空间的可变性,导致任务完成效率低下甚至失败。

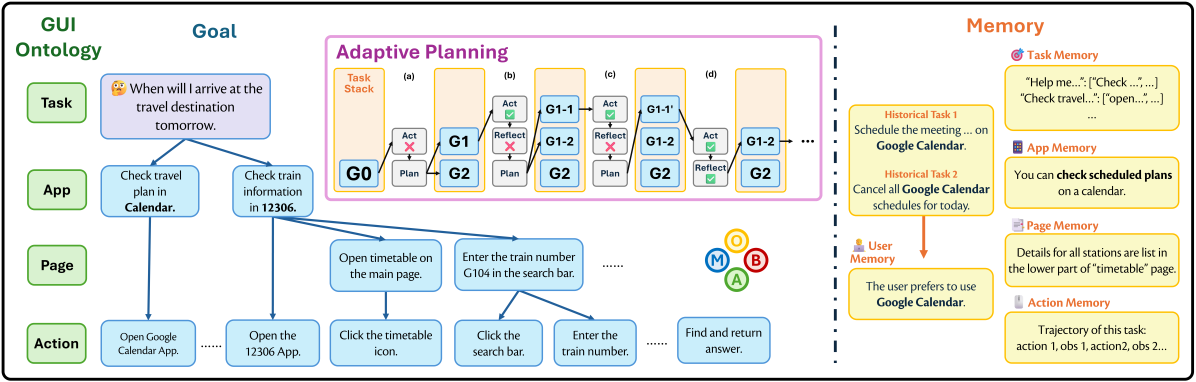

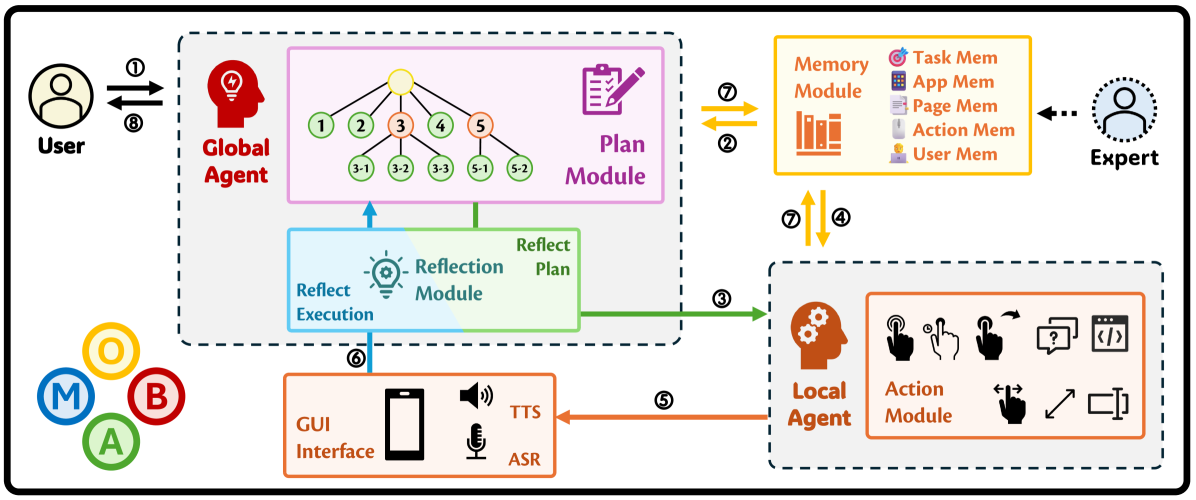

核心思路:MobA的核心思路是利用自适应规划和多方面记忆来增强MLLM智能体在动态GUI环境中的适应性和效率。自适应规划允许智能体根据实际环境和执行情况动态调整计划,而多方面记忆则为智能体提供全面的上下文信息,从而更好地理解任务并做出决策。

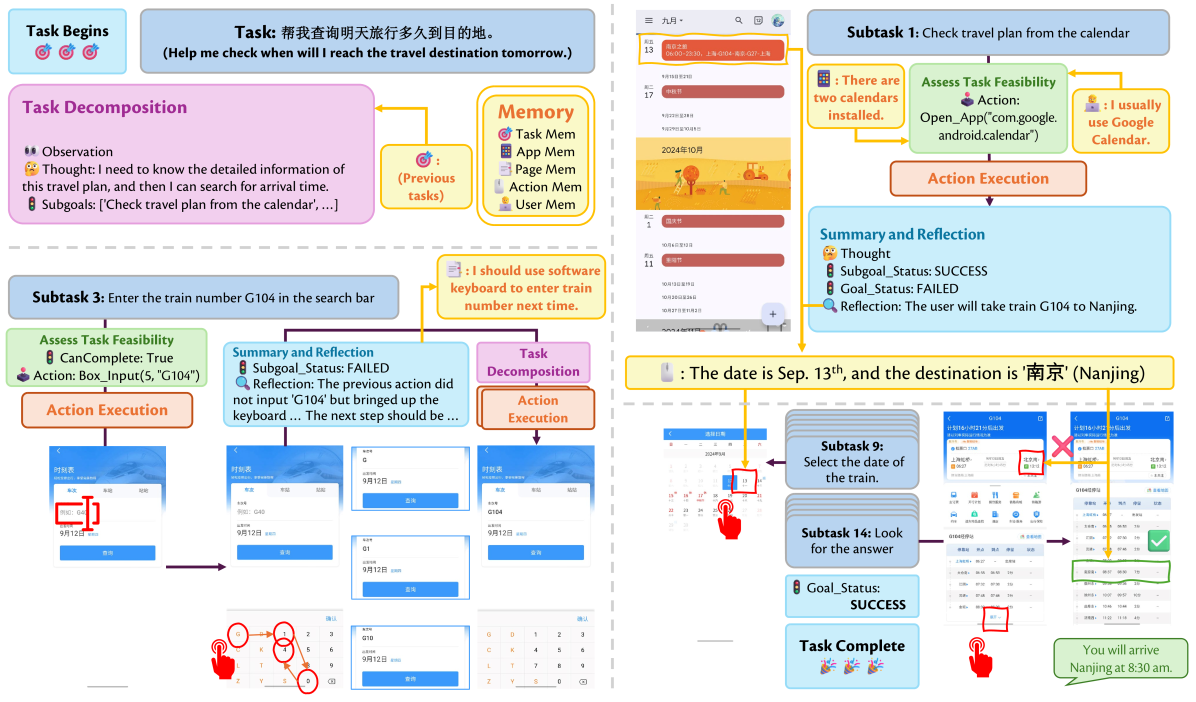

技术框架:MobA系统主要包含以下模块:1) 自适应规划模块:该模块负责生成任务执行计划,并根据环境反馈和执行结果进行动态调整。其中,反射机制用于错误恢复。2) 多方面记忆模块:该模块存储和检索与任务相关的各种信息,包括历史交互记录、GUI元素信息等,为智能体提供全面的上下文支持。3) 动作模块:该模块负责执行具体的GUI操作。整体流程是:智能体首先根据任务目标和当前环境生成初始计划,然后通过动作模块执行计划,并根据环境反馈和记忆模块的信息动态调整计划,直到任务完成。

关键创新:MobA的关键创新在于其自适应规划和多方面记忆的结合。自适应规划使得智能体能够灵活应对动态变化的GUI环境,而多方面记忆则为智能体提供了更全面的上下文信息,从而提高了任务完成的成功率和效率。与现有方法相比,MobA能够更好地处理GUI环境的复杂性和不确定性。

关键设计:自适应规划模块中的反射机制,具体实现方式未知。多方面记忆模块的具体实现方式未知,可能涉及知识图谱、向量数据库等技术。数据集MobBench的设计细节未知,但强调了复杂移动交互的特性。

🖼️ 关键图片

📊 实验亮点

MobA在MobBench和AndroidArena数据集上进行了实验,结果表明其能够有效处理动态GUI环境并完成复杂的移动任务。具体的性能数据和提升幅度未知,但论文强调了MobA在处理复杂移动交互方面的优势。

🎯 应用场景

MobA具有广泛的应用前景,可用于开发智能移动助手,帮助用户自动完成各种移动设备上的任务,例如预订机票、管理日程、处理邮件等。此外,该技术还可以应用于移动应用测试、自动化GUI交互等领域,具有重要的实际价值和商业潜力。未来,MobA有望成为移动设备上人机交互的重要组成部分。

📄 摘要(原文)

Existing Multimodal Large Language Model (MLLM)-based agents face significant challenges in handling complex GUI (Graphical User Interface) interactions on devices. These challenges arise from the dynamic and structured nature of GUI environments, which integrate text, images, and spatial relationships, as well as the variability in action spaces across different pages and tasks. To address these limitations, we propose MobA, a novel MLLM-based mobile assistant system. MobA introduces an adaptive planning module that incorporates a reflection mechanism for error recovery and dynamically adjusts plans to align with the real environment contexts and action module's execution capacity. Additionally, a multifaceted memory module provides comprehensive memory support to enhance adaptability and efficiency. We also present MobBench, a dataset designed for complex mobile interactions. Experimental results on MobBench and AndroidArena demonstrate MobA's ability to handle dynamic GUI environments and perform complex mobile tasks.