CoMAT: Chain of Mathematically Annotated Thought Improves Mathematical Reasoning

作者: Joshua Ong Jun Leang, Aryo Pradipta Gema, Shay B. Cohen

分类: cs.AI, cs.CL, cs.LG, cs.SC

发布日期: 2024-10-14 (更新: 2026-01-15)

备注: 9 pages, 12 figures

期刊: Proc. EMNLP 2025, pp. 20245-20274

DOI: 10.18653/v1/2025.emnlp-main.1024

💡 一句话要点

提出CoMAT:通过数学符号标注的思维链提升LLM的数学推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 数学推理 大型语言模型 思维链 符号推理 提示学习

📋 核心要点

- 尽管CoT等方法有所进展,LLM在复杂数学推理上仍面临挑战,缺乏有效的符号化处理能力。

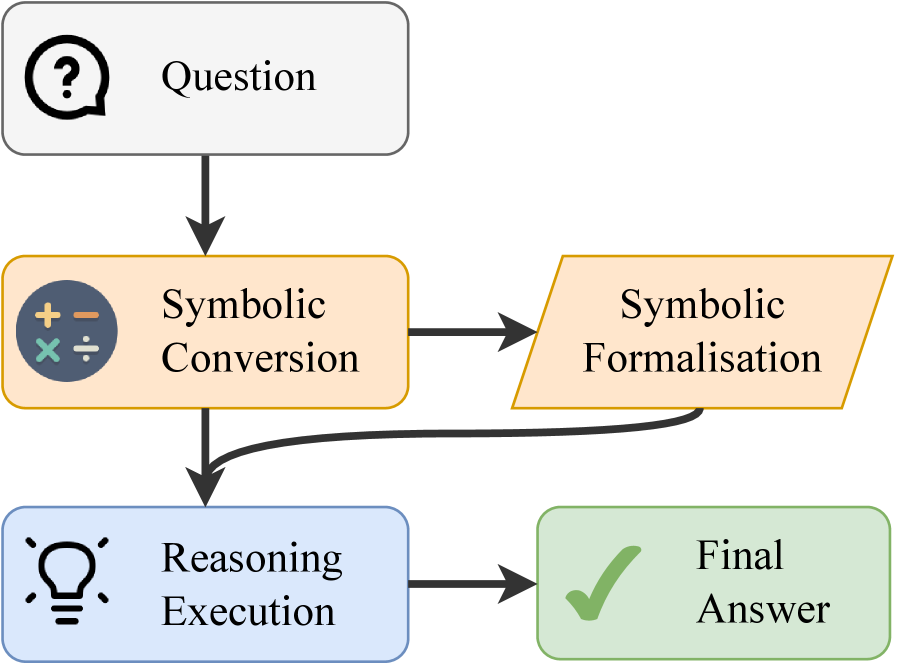

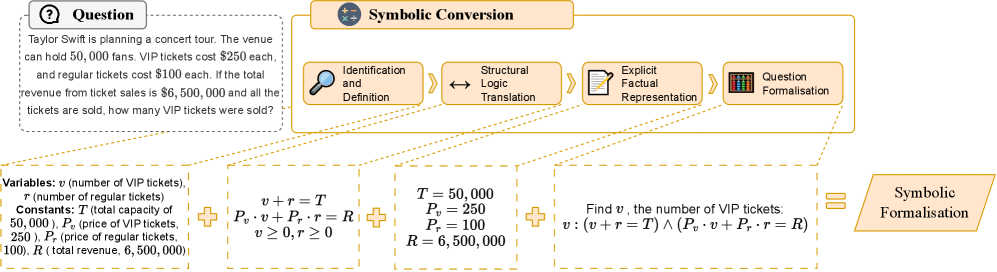

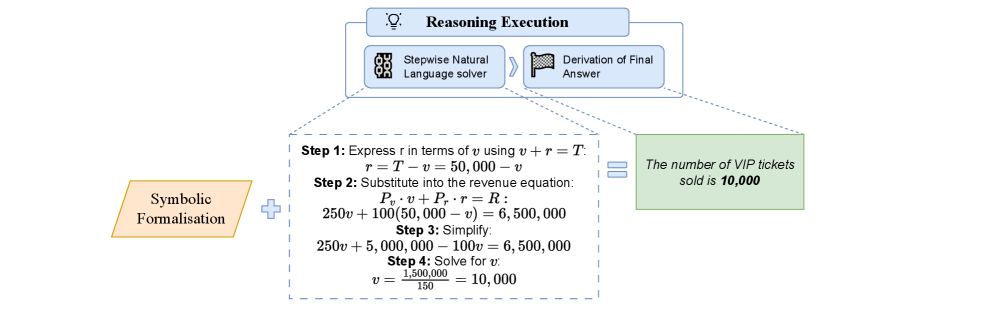

- CoMAT通过符号转换和推理执行两个阶段,将自然语言数学问题转化为符号形式,再进行推理求解。

- 实验表明,CoMAT在多个数学基准测试中显著优于传统CoT,提升了性能并保证了推理过程的透明性。

📝 摘要(中文)

大型语言模型(LLM)在数学推理方面仍然面临重大挑战,尽管诸如思维链(CoT)等提示技术取得了一定进展。本文提出了一种数学符号标注的思维链(CoMAT)方法,通过两个阶段来增强推理能力:符号转换(将自然语言查询转换为符号形式)和推理执行(从符号表示中推导出答案)。CoMAT完全使用单个LLM,无需外部求解器。在四个LLM上进行的实验表明,CoMAT在七个基准测试中的六个上优于传统的CoT,在MMLU-Redux (MATH) 上实现了4.48%的增益,在GaoKao MCQ上实现了4.58%的增益。除了提高性能外,CoMAT还确保了忠实性和可验证性,为复杂的数学任务提供了透明的推理过程。

🔬 方法详解

问题定义:LLM在解决复杂数学问题时,直接处理自然语言描述容易出错,缺乏对数学符号和规则的有效利用。现有的CoT方法虽然能引导LLM进行逐步推理,但仍然难以保证推理的正确性和可解释性,尤其是在需要精确计算和符号操作的场景下。

核心思路:CoMAT的核心思路是将自然语言描述的数学问题转化为符号化的形式,然后利用LLM的推理能力在符号空间中进行推理和计算。这种方法借鉴了人类解决数学问题的习惯,即先将问题抽象成数学公式,再进行求解。通过符号化,可以提高推理的准确性和可控性,并方便验证推理过程的正确性。

技术框架:CoMAT包含两个主要阶段:符号转换和推理执行。在符号转换阶段,LLM将自然语言描述的数学问题转换为符号化的数学表达式。在推理执行阶段,LLM利用转换后的符号表达式进行推理和计算,最终得到答案。整个过程完全由单个LLM完成,无需借助外部的数学求解器。

关键创新:CoMAT的关键创新在于引入了数学符号标注的思维链,将自然语言推理与符号推理相结合。与传统的CoT方法相比,CoMAT更加注重问题的符号化表示,从而提高了推理的准确性和可解释性。此外,CoMAT还能够生成可验证的推理过程,方便用户检查和调试。

关键设计:CoMAT在符号转换阶段,需要设计合适的提示语,引导LLM将自然语言问题转换为正确的符号表达式。在推理执行阶段,需要利用LLM的上下文学习能力,让其学习如何利用符号表达式进行推理和计算。论文中没有明确提及具体的参数设置、损失函数或网络结构,推测是直接使用了预训练LLM的现有能力,并通过prompt engineering来引导其完成任务。

🖼️ 关键图片

📊 实验亮点

CoMAT在多个数学基准测试中取得了显著的性能提升。例如,在MMLU-Redux (MATH) 上,CoMAT比传统CoT提高了4.48%;在GaoKao MCQ上,CoMAT提高了4.58%。实验结果表明,CoMAT能够有效地提高LLM的数学推理能力,并且具有良好的泛化性能。

🎯 应用场景

CoMAT方法可应用于各种需要数学推理的场景,例如自动解题、科学计算、金融分析等。该方法能够提高LLM在这些领域的应用能力,并为用户提供更加可靠和可信的解决方案。未来,CoMAT还可以扩展到其他需要符号推理的领域,例如逻辑推理、程序验证等。

📄 摘要(原文)

Mathematical reasoning remains a significant challenge for large language models (LLMs), despite progress in prompting techniques such as Chain-of-Thought (CoT). We present Chain of Mathematically Annotated Thought (CoMAT), which enhances reasoning through two stages: Symbolic Conversion (converting natural language queries into symbolic form) and Reasoning Execution (deriving answers from symbolic representations). CoMAT operates entirely with a single LLM and without external solvers. Across four LLMs, CoMAT outperforms traditional CoT on six out of seven benchmarks, achieving gains of 4.48% on MMLU-Redux (MATH) and 4.58% on GaoKao MCQ. In addition to improved performance, CoMAT ensures faithfulness and verifiability, offering a transparent reasoning process for complex mathematical tasks