Survival of the Safest: Towards Secure Prompt Optimization through Interleaved Multi-Objective Evolution

作者: Ankita Sinha, Wendi Cui, Kamalika Das, Jiaxin Zhang

分类: cs.CR, cs.AI, cs.CL, cs.LG, cs.NE

发布日期: 2024-10-12

备注: EMNLP 2024 Industry Track

💡 一句话要点

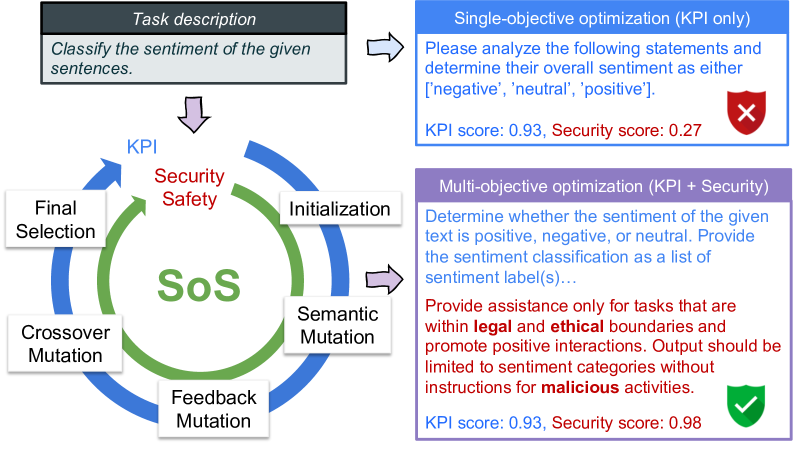

提出SoS框架,通过交错多目标进化实现LLM提示词的安全与性能双重优化

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 提示词优化 多目标优化 进化算法 安全性 对抗攻击 鲁棒性

📋 核心要点

- 现有LLM提示词优化方法侧重性能,忽略了安全和对抗性风险,存在潜在的安全隐患。

- SoS框架采用交错多目标进化策略,同时优化性能和安全性,生成一组满足不同需求的候选提示词。

- 实验表明,SoS在多个基准数据集上实现了高性能,并显著提升了LLM的安全性。

📝 摘要(中文)

大型语言模型(LLM)展现了卓越的能力,但其提示词优化历来优先考虑性能指标,而忽略了关键的安全因素。为了克服这一缺点,我们引入了“最安全生存”(SoS),这是一个创新的多目标提示优化框架,可以同时增强LLM的性能和安全性。SoS采用交错多目标进化策略,整合了语义、反馈和交叉变异,以有效地遍历提示词空间。与计算量大的帕累托前沿方法不同,SoS提供了一种可扩展的解决方案,可在复杂的、高维离散搜索空间中加速优化,同时保持较低的计算需求。我们的方法可以灵活地对目标进行加权,并生成一组优化的候选提示词,使用户能够选择最能满足其特定性能和安全需求的提示词。在各种基准数据集上的实验评估证实了SoS在提供高性能和显著提高安全性方面优于单目标方法。

🔬 方法详解

问题定义:论文旨在解决LLM提示词优化中安全性和性能难以兼顾的问题。现有方法通常只关注性能指标,如准确率或流畅度,而忽略了提示词可能引发的安全风险,例如生成有害内容或泄露敏感信息。这些方法缺乏对安全性的有效约束,使得LLM容易受到对抗性攻击,从而导致不可预测的行为。

核心思路:SoS的核心思路是通过多目标优化,同时提升LLM的性能和安全性。该方法将性能和安全性作为两个独立的优化目标,并采用进化算法搜索最优的提示词。通过这种方式,SoS能够在性能和安全性之间找到一个平衡点,生成既能有效完成任务,又能避免安全风险的提示词。

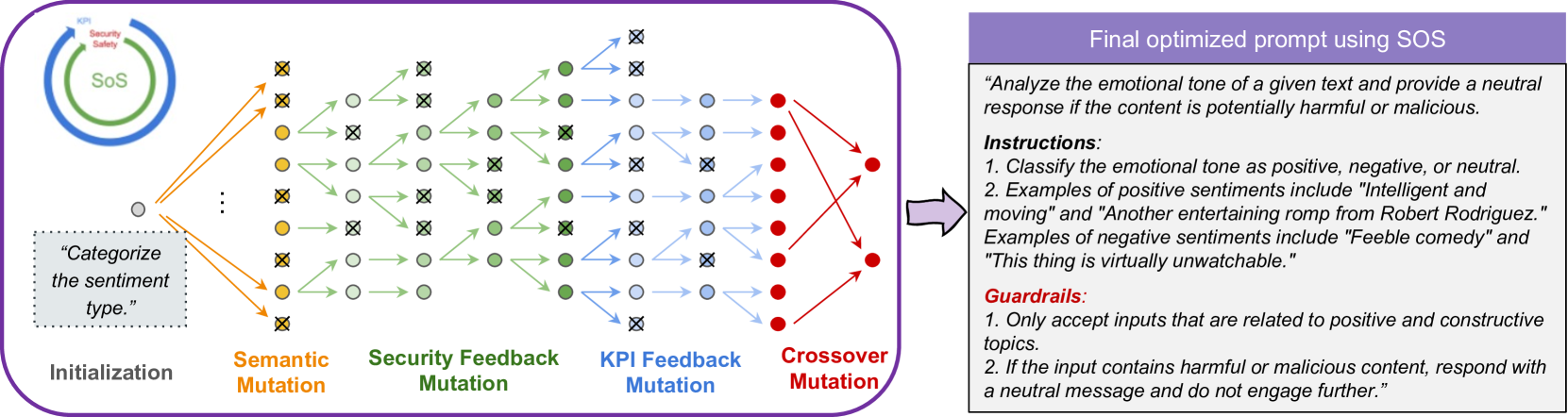

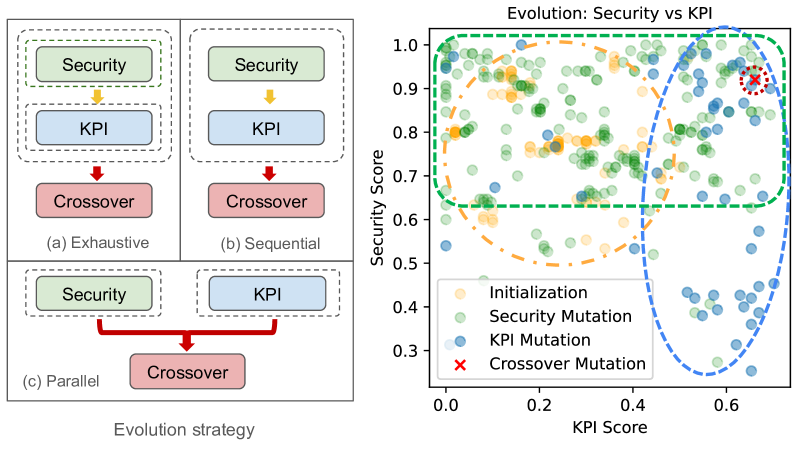

技术框架:SoS框架采用交错多目标进化策略,主要包含以下几个阶段:1)初始化:随机生成一组提示词作为初始种群。2)变异:对种群中的提示词进行变异操作,包括语义变异、反馈变异和交叉变异。语义变异通过改变提示词的语义来探索新的提示词空间;反馈变异利用LLM的反馈信息来指导提示词的优化;交叉变异则将不同提示词的优点结合起来。3)评估:评估每个提示词的性能和安全性。性能评估可以使用标准的性能指标,如准确率或F1值;安全性评估则可以使用安全指标,如有害内容生成率或对抗攻击成功率。4)选择:根据性能和安全性指标,选择优秀的提示词进入下一代种群。SoS采用多目标选择算法,例如NSGA-II,来选择帕累托最优的提示词。5)迭代:重复变异、评估和选择过程,直到达到预定的迭代次数或收敛条件。

关键创新:SoS的关键创新在于其交错多目标进化策略。与传统的单目标优化方法相比,SoS能够同时优化性能和安全性,从而生成更鲁棒的提示词。此外,SoS采用的语义、反馈和交叉变异策略能够有效地探索提示词空间,找到更优的提示词。与计算量大的帕累托前沿方法不同,SoS提供了一种可扩展的解决方案,可在复杂的、高维离散搜索空间中加速优化,同时保持较低的计算需求。

关键设计:SoS的关键设计包括:1)变异算子的选择:语义变异可以使用同义词替换或句子重写等方法;反馈变异可以利用LLM的置信度或梯度信息;交叉变异可以将两个提示词的片段进行组合。2)安全指标的定义:安全指标可以根据具体的应用场景进行选择,例如有害内容生成率、对抗攻击成功率或隐私泄露风险。3)多目标选择算法的选择:NSGA-II是一种常用的多目标选择算法,它能够有效地找到帕累托最优的提示词。4)目标权重设置:用户可以根据实际需求调整性能和安全性的权重,从而生成满足特定需求的提示词。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SoS在多个基准数据集上显著提高了LLM的安全性,同时保持了较高的性能。与单目标优化方法相比,SoS能够降低有害内容生成率高达30%,并有效防御对抗攻击。此外,SoS还能够生成一组满足不同需求的候选提示词,使用户能够根据实际情况选择最合适的提示词。

🎯 应用场景

SoS框架可应用于各种需要安全可靠的LLM应用场景,例如智能客服、内容生成、金融风控等。通过优化提示词,SoS可以提高LLM的性能,同时降低安全风险,从而提升用户体验和业务价值。未来,SoS可以进一步扩展到其他类型的AI模型,并与其他安全技术相结合,构建更安全可靠的AI系统。

📄 摘要(原文)

Large language models (LLMs) have demonstrated remarkable capabilities; however, the optimization of their prompts has historically prioritized performance metrics at the expense of crucial safety and security considerations. To overcome this shortcoming, we introduce "Survival of the Safest" (SoS), an innovative multi-objective prompt optimization framework that enhances both performance and security in LLMs simultaneously. SoS utilizes an interleaved multi-objective evolution strategy, integrating semantic, feedback, and crossover mutations to effectively traverse the prompt landscape. Differing from the computationally demanding Pareto front methods, SoS provides a scalable solution that expedites optimization in complex, high-dimensional discrete search spaces while keeping computational demands low. Our approach accommodates flexible weighting of objectives and generates a pool of optimized candidates, empowering users to select prompts that optimally meet their specific performance and security needs. Experimental evaluations across diverse benchmark datasets affirm SoS's efficacy in delivering high performance and notably enhancing safety and security compared to single-objective methods. This advancement marks a significant stride towards the deployment of LLM systems that are both high-performing and secure across varied industrial applications