Natural Language Counterfactual Explanations for Graphs Using Large Language Models

作者: Flavio Giorgi, Cesare Campagnano, Fabrizio Silvestri, Gabriele Tolomei

分类: cs.AI, cs.CL

发布日期: 2024-10-11 (更新: 2025-01-27)

💡 一句话要点

利用大语言模型为图结构数据生成自然语言反事实解释

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 图神经网络 可解释性AI 反事实解释 自然语言生成 大语言模型

📋 核心要点

- 现有反事实解释方法生成的解释复杂且技术性强,难以被非专业人士理解和应用。

- 该论文利用大语言模型,将图模型的反事实实例转化为自然语言解释,提升可理解性。

- 实验结果表明,该方法能够有效地生成准确的反事实实例自然语言表示,并有关键性能指标佐证。

📝 摘要(中文)

可解释人工智能(XAI)已成为一个关键的研究领域,旨在揭示(深度)机器学习模型的不透明内部逻辑。在文献中提出的各种XAI技术中,反事实解释是最有前途的方法之一。然而,这些“假设”解释通常复杂且技术性强,使得非专业人士难以理解,更广泛地说,人类难以解释。为了弥合这一差距,本文利用开源大语言模型的力量,当使用最先进的基于图模型的解释器生成的有效反事实实例提示时,生成自然语言解释。跨多个图数据集和反事实解释器的实验表明,我们的方法有效地生成了反事实实例的准确自然语言表示,关键性能指标证明了这一点。

🔬 方法详解

问题定义:论文旨在解决图结构数据模型的可解释性问题,特别是针对反事实解释的可理解性瓶颈。现有反事实解释方法通常输出的是复杂的图结构变化或技术指标,而非人类易于理解的自然语言描述,这限制了其在实际应用中的价值。

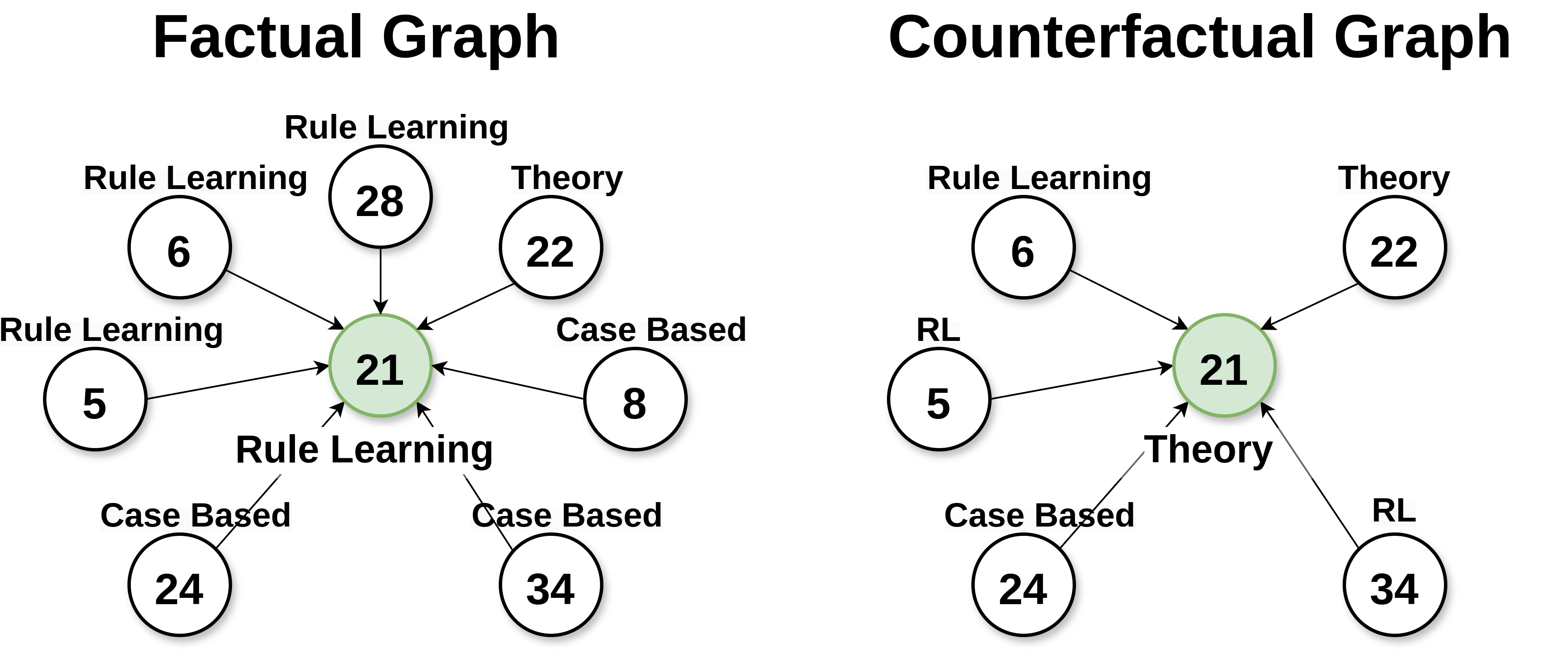

核心思路:论文的核心思路是利用大语言模型(LLM)的强大自然语言生成能力,将图结构数据模型生成的反事实实例转化为自然语言解释。通过将反事实实例作为LLM的输入提示(prompt),引导LLM生成对该反事实实例的自然语言描述,从而提高解释的可理解性。

技术框架:整体框架包含两个主要阶段:1) 使用现有的图模型反事实解释器生成反事实实例;2) 将生成的反事实实例作为prompt输入到大语言模型中,由大语言模型生成自然语言解释。框架的关键在于如何设计有效的prompt,以引导LLM生成准确且有意义的解释。

关键创新:该方法的主要创新在于将大语言模型引入到图结构数据的可解释性分析中,并将其应用于反事实解释的自然语言生成。与传统方法相比,该方法无需人工设计复杂的解释规则,而是利用LLM的知识和推理能力自动生成解释,从而提高了效率和可扩展性。

关键设计:论文的关键设计包括:1) 选择合适的开源大语言模型;2) 设计有效的prompt模板,prompt中需要包含足够的信息,以便LLM能够理解反事实实例的含义并生成准确的解释;3) 使用合适的评估指标来评估生成的自然语言解释的质量,例如准确性、流畅性和可理解性。具体的参数设置、损失函数、网络结构等细节取决于所使用的大语言模型和图模型反事实解释器。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了该方法的有效性。实验结果表明,使用大语言模型生成的自然语言反事实解释具有较高的准确性和可理解性。具体而言,该方法在多个图数据集上取得了显著的性能提升,并能够生成流畅且有意义的自然语言解释,相比于直接分析图结构变化,更容易被用户理解。

🎯 应用场景

该研究成果可应用于多个领域,例如金融风控、社交网络分析、推荐系统等。通过提供易于理解的自然语言反事实解释,可以帮助用户更好地理解模型的决策过程,从而提高模型的透明度和可信度。此外,该方法还可以用于调试和优化模型,发现模型潜在的偏差和漏洞,最终提升模型的性能和公平性。

📄 摘要(原文)

Explainable Artificial Intelligence (XAI) has emerged as a critical area of research to unravel the opaque inner logic of (deep) machine learning models. Among the various XAI techniques proposed in the literature, counterfactual explanations stand out as one of the most promising approaches. However, these "what-if" explanations are frequently complex and technical, making them difficult for non-experts to understand and, more broadly, challenging for humans to interpret. To bridge this gap, in this work, we exploit the power of open-source Large Language Models to generate natural language explanations when prompted with valid counterfactual instances produced by state-of-the-art explainers for graph-based models. Experiments across several graph datasets and counterfactual explainers show that our approach effectively produces accurate natural language representations of counterfactual instances, as demonstrated by key performance metrics.