One Step at a Time: Combining LLMs and Static Analysis to Generate Next-Step Hints for Programming Tasks

作者: Anastasiia Birillo, Elizaveta Artser, Anna Potriasaeva, Ilya Vlasov, Katsiaryna Dzialets, Yaroslav Golubev, Igor Gerasimov, Hieke Keuning, Timofey Bryksin

分类: cs.SE, cs.AI, cs.CY, cs.HC

发布日期: 2024-10-11

备注: 12 pages, 5 figures

💡 一句话要点

结合LLM与静态分析,为编程学习者生成下一步提示

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 编程教育 大型语言模型 静态分析 代码提示 个性化学习

📋 核心要点

- 在线编程学习缺乏个性化指导,学生常因无法获得下一步行动建议而受阻。

- 结合LLM的语义理解能力与静态分析的代码质量控制,生成更有效、更可靠的编程提示。

- 课堂实验表明,该系统生成的文本和代码提示均能有效帮助学生推进编程任务。

📝 摘要(中文)

学生在在线学习编程时经常遇到困难,尤其缺乏个性化帮助。本文提出一种新颖的系统,通过生成下一步提示(即展示学生接下来需要做的具体小步骤)来提供帮助。该方法结合大型语言模型(LLM)和静态分析,显著提高输出质量。该方法使用链式思考提示技术,包含三个步骤:(1)生成子目标,即从当前学生的解决方案中继续执行任务的行动列表;(2)生成实现下一个子目标的代码;(3)生成描述所需操作的文本。在第二步中,我们应用静态分析来控制生成代码的大小和质量。该工具作为开源JetBrains Academy插件的修改版实现,为IDE课程中的学生提供支持。通过专家验证和课堂实验,结果表明文本和代码提示对学生都有帮助,并且该系统帮助他们继续完成编码任务。

🔬 方法详解

问题定义:论文旨在解决在线编程学习中学生缺乏个性化指导的问题,特别是下一步行动建议的缺失。现有方法,如单纯依赖LLM生成提示,可能产生质量不高或不符合规范的代码,导致学生困惑。

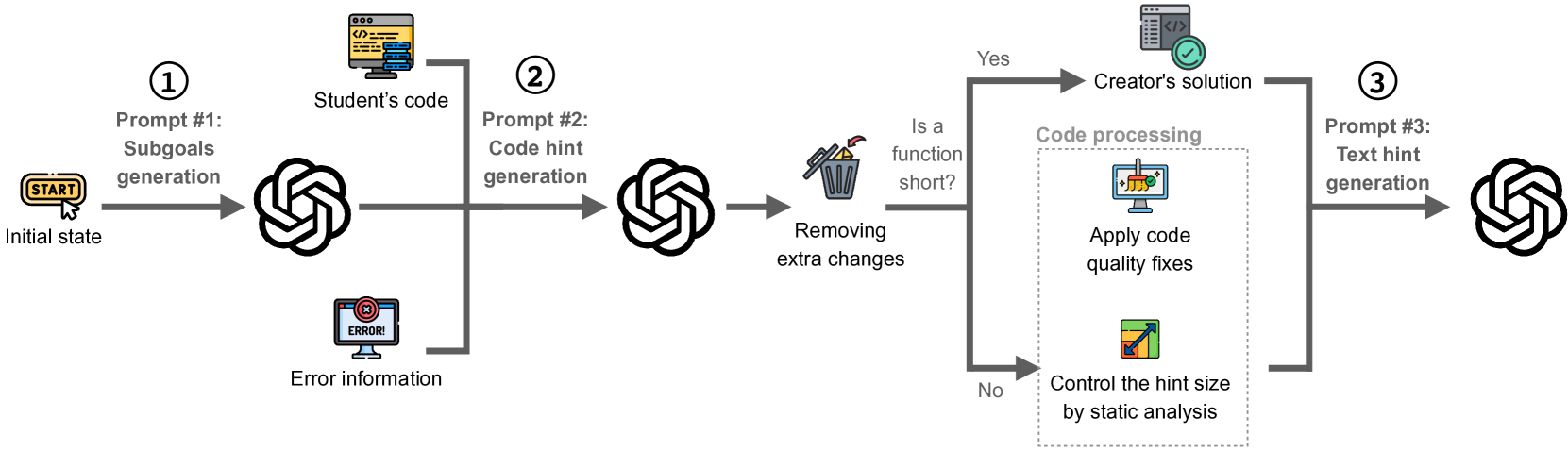

核心思路:论文的核心思路是将LLM的强大生成能力与静态分析的代码质量控制相结合。LLM负责理解学生代码并规划下一步行动,而静态分析则确保生成的代码片段符合规范、简洁有效,从而提供更可靠的提示。

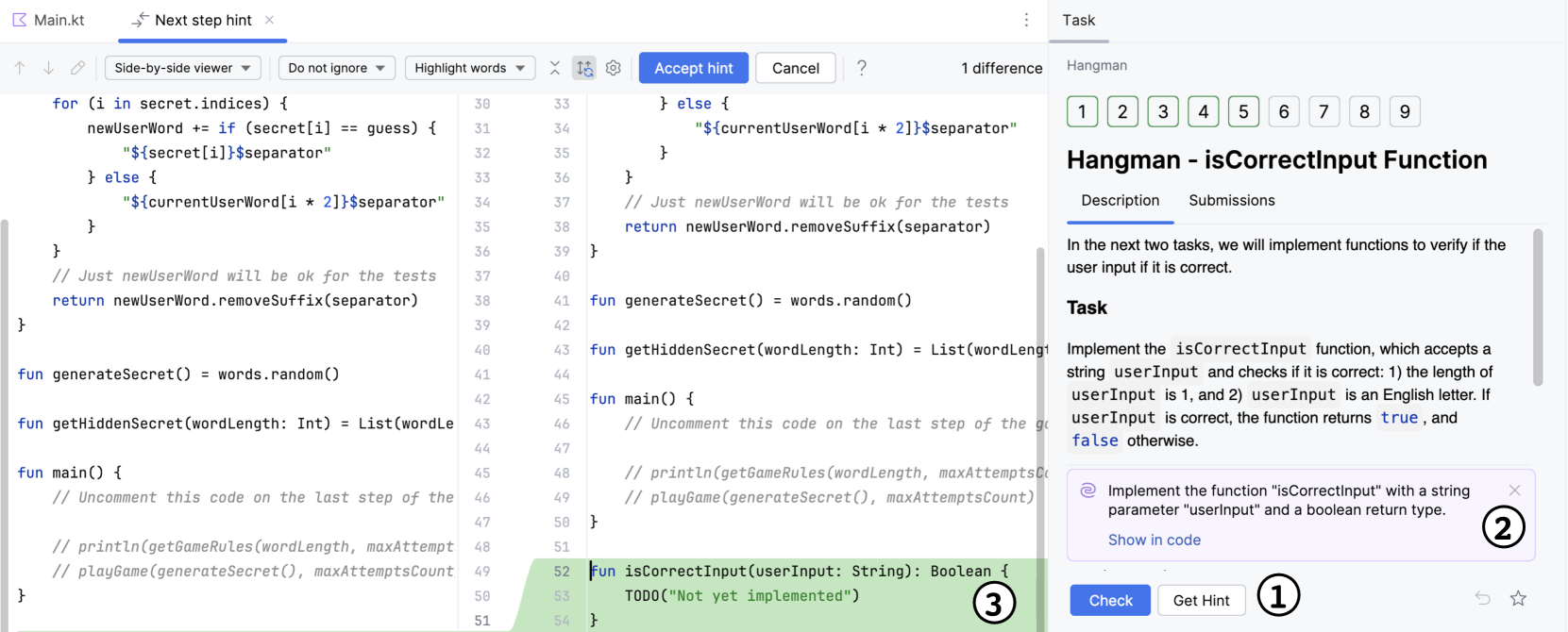

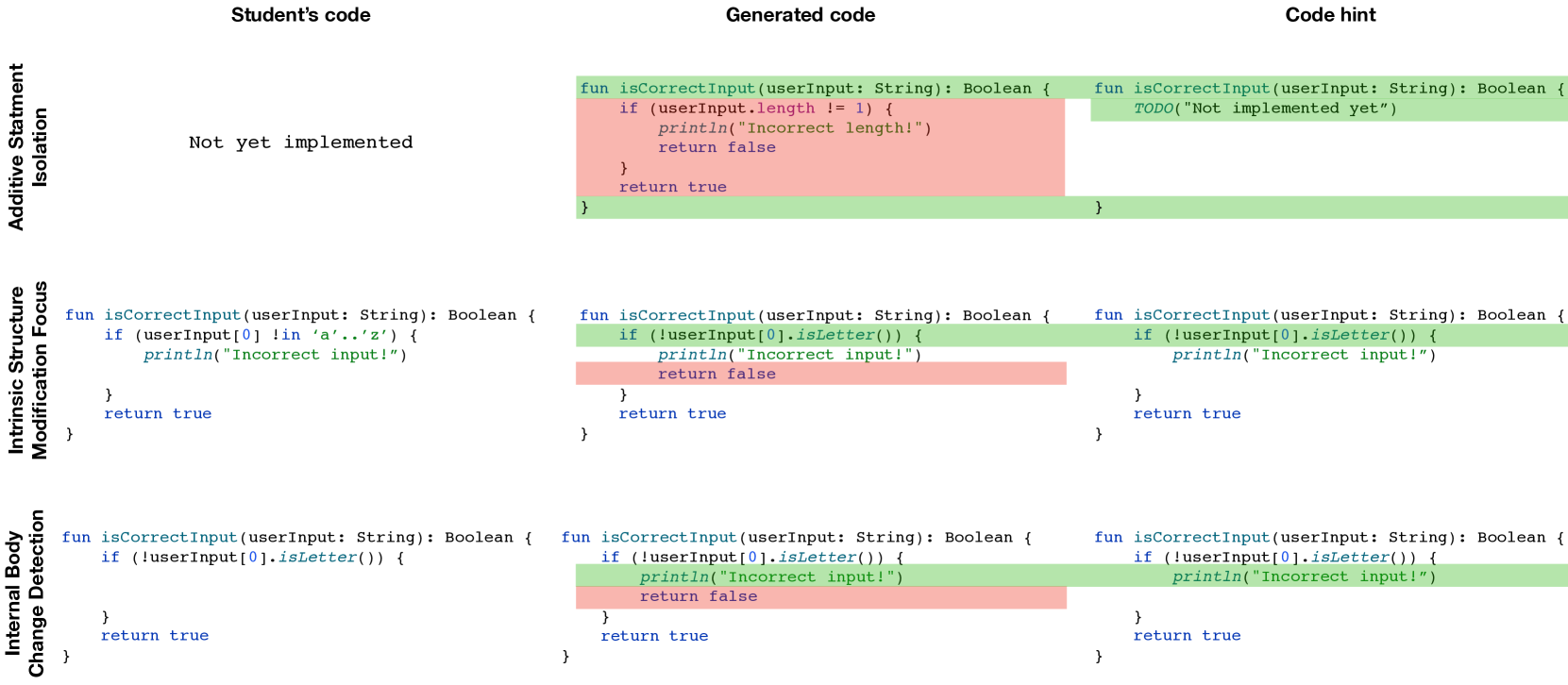

技术框架:该方法包含三个主要步骤:1) 子目标生成:利用LLM分析学生当前代码,生成一系列可行的子目标,即接下来需要完成的任务步骤。2) 代码生成:针对每个子目标,利用LLM生成相应的代码片段。在此步骤中,应用静态分析技术对生成的代码进行检查和优化,例如去除冗余代码、简化表达式等。3) 文本提示生成:将生成的代码片段转化为易于理解的文本提示,向学生解释下一步需要做什么。整个流程采用链式思考提示(Chain-of-Thought prompting)技术,引导LLM逐步推理并生成高质量的提示。

关键创新:该方法最重要的创新在于将LLM与静态分析相结合,弥补了单纯依赖LLM生成提示的不足。静态分析能够有效控制生成代码的质量,避免产生错误或低效的代码,从而提高提示的可靠性和实用性。

关键设计:论文未详细描述具体的参数设置、损失函数或网络结构,因为其重点在于框架的设计和流程的整合。静态分析的具体实现依赖于现有的静态分析工具和技术,例如代码风格检查、冗余代码检测等。LLM的使用可能涉及到Prompt的设计,以引导LLM生成符合要求的子目标和代码片段,但具体细节未知。

🖼️ 关键图片

📊 实验亮点

该方法通过专家验证和课堂实验进行了评估。课堂实验结果表明,文本和代码提示对学生都有帮助,并且该系统能够有效帮助他们推进编程任务。具体的性能数据和提升幅度未知,但定性结果表明该方法具有实际应用价值。

🎯 应用场景

该研究成果可应用于在线编程教育平台、集成开发环境(IDE)的辅助编程工具等领域,为学生提供个性化的学习支持,提高编程学习效率。未来,该方法可以扩展到更复杂的编程任务和更广泛的编程语言,并与其他AI技术(如代码补全、错误检测)相结合,构建更智能的编程助手。

📄 摘要(原文)

Students often struggle with solving programming problems when learning to code, especially when they have to do it online, with one of the most common disadvantages of working online being the lack of personalized help. This help can be provided as next-step hint generation, i.e., showing a student what specific small step they need to do next to get to the correct solution. There are many ways to generate such hints, with large language models (LLMs) being among the most actively studied right now. While LLMs constitute a promising technology for providing personalized help, combining them with other techniques, such as static analysis, can significantly improve the output quality. In this work, we utilize this idea and propose a novel system to provide both textual and code hints for programming tasks. The pipeline of the proposed approach uses a chain-of-thought prompting technique and consists of three distinct steps: (1) generating subgoals - a list of actions to proceed with the task from the current student's solution, (2) generating the code to achieve the next subgoal, and (3) generating the text to describe this needed action. During the second step, we apply static analysis to the generated code to control its size and quality. The tool is implemented as a modification to the open-source JetBrains Academy plugin, supporting students in their in-IDE courses. To evaluate our approach, we propose a list of criteria for all steps in our pipeline and conduct two rounds of expert validation. Finally, we evaluate the next-step hints in a classroom with 14 students from two universities. Our results show that both forms of the hints - textual and code - were helpful for the students, and the proposed system helped them to proceed with the coding tasks.