Federated Vision-Language-Recommendation with Personalized Fusion

作者: Zhiwei Li, Guodong Long, Jing Jiang, Chengqi Zhang, Qiang Yang

分类: cs.IR, cs.AI, cs.LG

发布日期: 2024-10-11 (更新: 2025-11-02)

备注: 15 pages, 10 figures, 7 tables, conference

💡 一句话要点

提出FedVLR框架,通过个性化融合实现联邦视觉-语言-推荐系统。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 联邦学习 视觉-语言推荐 多模态融合 个性化推荐 混合专家网络

📋 核心要点

- 现有VLR方法难以在保护用户隐私的同时提供个性化推荐,面临联邦学习环境下的挑战。

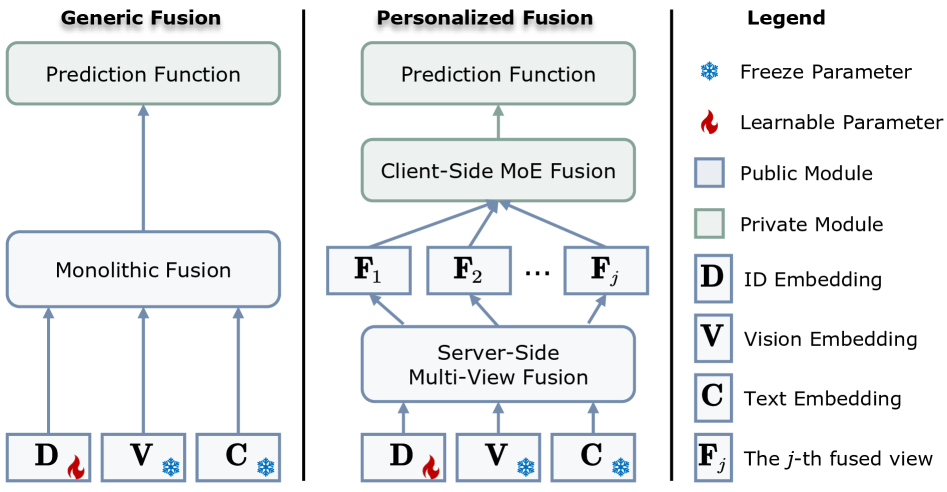

- FedVLR通过双层融合机制,在服务器端生成多模态视图,客户端进行用户个性化混合专家融合。

- 实验在七个基准数据集上验证了FedVLR的有效性,证明了其在联邦VLR系统中的潜力。

📝 摘要(中文)

本文提出了一种名为FedVLR的联邦视觉-语言-推荐(VLR)框架,专门为用户特定的视觉-语言表征个性化融合而设计。将大型预训练视觉-语言模型应用于推荐系统是一个新兴领域,我们称之为视觉-语言-推荐(VLR)。在联邦学习框架内,将VLR应用于面向用户的设备端智能是增强用户隐私和提供个性化体验的关键一步。FedVLR的核心是一种新颖的双层融合机制:服务器端的多视角融合模块首先生成一组多样化的预融合多模态视图。随后,每个客户端采用用户特定的混合专家机制,根据个人用户交互历史自适应地整合这些视图。这种轻量级的个性化融合模块为实现联邦VLR系统提供了一种高效的解决方案。在七个基准数据集上的验证表明了我们提出的FedVLR的有效性。

🔬 方法详解

问题定义:论文旨在解决联邦学习场景下,如何利用视觉-语言模型进行个性化推荐的问题。现有的VLR方法通常集中式训练,无法保护用户隐私。直接将VLR模型应用于联邦学习,难以兼顾模型性能和用户个性化需求。

核心思路:论文的核心思路是设计一种双层融合机制,在服务器端进行多视角融合,生成通用的多模态表征;在客户端利用用户特定的混合专家机制,个性化地融合这些表征。这种设计既能利用服务器端的计算资源,又能保证用户数据的隐私性,同时实现个性化推荐。

技术框架:FedVLR框架包含服务器端和客户端两部分。服务器端的多视角融合模块负责生成多个预融合的多模态视图。客户端的个性化融合模块包含一个混合专家网络,根据用户的交互历史,自适应地选择和融合服务器端提供的多模态视图。整个流程是:服务器训练多视角融合模块,并将融合后的视图发送给客户端;客户端训练个性化融合模块,并只上传模型参数到服务器进行聚合。

关键创新:FedVLR的关键创新在于其双层融合机制,特别是客户端的混合专家网络。该网络能够根据用户的历史交互数据,动态地调整不同多模态视图的权重,从而实现用户个性化的表征融合。这种设计避免了直接在客户端训练大型VLR模型,降低了计算成本和通信开销。

关键设计:服务器端的多视角融合模块可以使用不同的多模态融合方法,例如简单的拼接、注意力机制等。客户端的混合专家网络可以使用不同的网络结构,例如MLP、Transformer等。损失函数通常包括推荐任务的损失函数(例如交叉熵损失)和正则化项,以防止过拟合。具体的参数设置需要根据数据集和任务进行调整。

🖼️ 关键图片

📊 实验亮点

论文在七个基准数据集上验证了FedVLR的有效性,实验结果表明,FedVLR在推荐性能上优于现有的联邦学习方法。具体的性能提升幅度取决于数据集和任务,但总体上,FedVLR能够在保护用户隐私的同时,实现与集中式训练相媲美的推荐效果。实验结果证明了FedVLR在联邦VLR系统中的潜力。

🎯 应用场景

FedVLR可应用于电商、社交媒体、内容推荐等领域,在保护用户隐私的前提下,提供个性化的视觉-语言推荐服务。例如,电商平台可以根据用户的浏览历史和商品图片,推荐用户可能感兴趣的商品;社交媒体可以根据用户的关注和发布的图片,推荐用户可能感兴趣的内容。该研究有助于推动联邦学习在多模态推荐系统中的应用。

📄 摘要(原文)

Applying large pre-trained Vision-Language Models to recommendation is a burgeoning field, a direction we term Vision-Language-Recommendation (VLR). Bringing VLR to user-oriented on-device intelligence within a federated learning framework is a crucial step for enhancing user privacy and delivering personalized experiences. This paper introduces FedVLR, a federated VLR framework specially designed for user-specific personalized fusion of vision-language representations. At its core is a novel bi-level fusion mechanism: The server-side multi-view fusion module first generates a diverse set of pre-fused multimodal views. Subsequently, each client employs a user-specific mixture-of-expert mechanism to adaptively integrate these views based on individual user interaction history. This designed lightweight personalized fusion module provides an efficient solution to implement a federated VLR system. The effectiveness of our proposed FedVLR has been validated on seven benchmark datasets.