Intuitions of Compromise: Utilitarianism vs. Contractualism

作者: Jared Moore, Yejin Choi, Sydney Levine

分类: cs.AI, cs.GT

发布日期: 2024-10-07

💡 一句话要点

对比功利主义与契约主义,揭示社会决策中人类偏好与大语言模型的错位

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 社会决策 功利主义 契约主义 纳什积 大型语言模型 偏好聚合 群体决策 人工智能伦理

📋 核心要点

- 现有社会决策方法主要采用功利主义,简单加总效用,忽略了契约主义这种基于协议的替代方案。

- 论文核心在于对比功利主义(效用总和)和契约主义(纳什积)在社会决策偏好聚合中的表现。

- 实验表明,人类更倾向于契约主义算法的推荐结果,且大型语言模型与人类偏好存在显著差异。

📝 摘要(中文)

在不同个体对不同事物赋予不同价值的情况下,如何达成最佳妥协?目前最普遍接受的方法是功利主义,即简单地将不同选项的效用相加,选择总和最大的方案。然而,契约主义提供了一种重要的替代方案,它提倡一种基于协议驱动的决策方法。本研究首次直接比较了这两种方法在直觉上的合理性。通过将功利主义总和与契约主义的纳什积应用于社会决策场景中的群体偏好聚合,我们发现人们强烈偏好契约主义算法推荐的聚合结果。最后,我们将大型语言模型(LLM)的判断与人类参与者的判断进行比较,发现模型偏好与人类偏好之间存在显著的不一致。

🔬 方法详解

问题定义:论文旨在解决社会决策中,如何在不同个体具有不同偏好时,找到最佳的妥协方案。现有方法,即功利主义,通过简单地加总效用值来做出决策,这种方法可能忽略了个体之间的公平性和协商过程,导致某些个体的利益被忽视。因此,现有方法的痛点在于缺乏对个体权益的充分考虑,可能导致不公正的决策结果。

核心思路:论文的核心思路是引入契约主义作为一种替代的决策框架。契约主义强调通过个体之间的协商和协议来达成共识,从而在最大程度上兼顾所有参与者的利益。具体而言,论文采用纳什积作为契约主义的代表,该方法旨在最大化所有个体效用值的乘积,从而鼓励公平的分配和避免极端不平衡的结果。

技术框架:论文的技术框架主要包括以下几个步骤:1) 设计社会决策场景,其中不同个体对不同选项具有不同的偏好;2) 使用功利主义算法(效用总和)和契约主义算法(纳什积)对个体偏好进行聚合,得到两种算法推荐的决策方案;3) 招募人类参与者,让他们对两种算法推荐的方案进行评价,从而了解人类的直觉偏好;4) 将大型语言模型(LLM)的判断与人类参与者的判断进行比较,分析模型偏好与人类偏好之间的差异。

关键创新:论文最重要的技术创新点在于首次直接比较了功利主义和契约主义在社会决策中的直觉合理性。以往的研究主要集中在理论分析或案例研究,缺乏对这两种方法进行实证对比的证据。此外,论文还创新性地将大型语言模型引入到社会决策研究中,分析了模型偏好与人类偏好之间的差异,为理解人工智能的价值观和伦理观提供了新的视角。

关键设计:论文的关键设计包括:1) 精心设计的社会决策场景,确保场景具有一定的复杂性和现实意义,能够有效区分功利主义和契约主义的决策结果;2) 采用纳什积作为契约主义的代表,该方法具有良好的数学性质和理论基础,能够有效地衡量个体之间的公平性和协商程度;3) 使用大规模的人类参与者实验,确保实验结果具有统计显著性,能够反映人类的普遍偏好;4) 选择具有代表性的大型语言模型,分析其在社会决策中的表现,从而了解人工智能的价值观和伦理观。

🖼️ 关键图片

📊 实验亮点

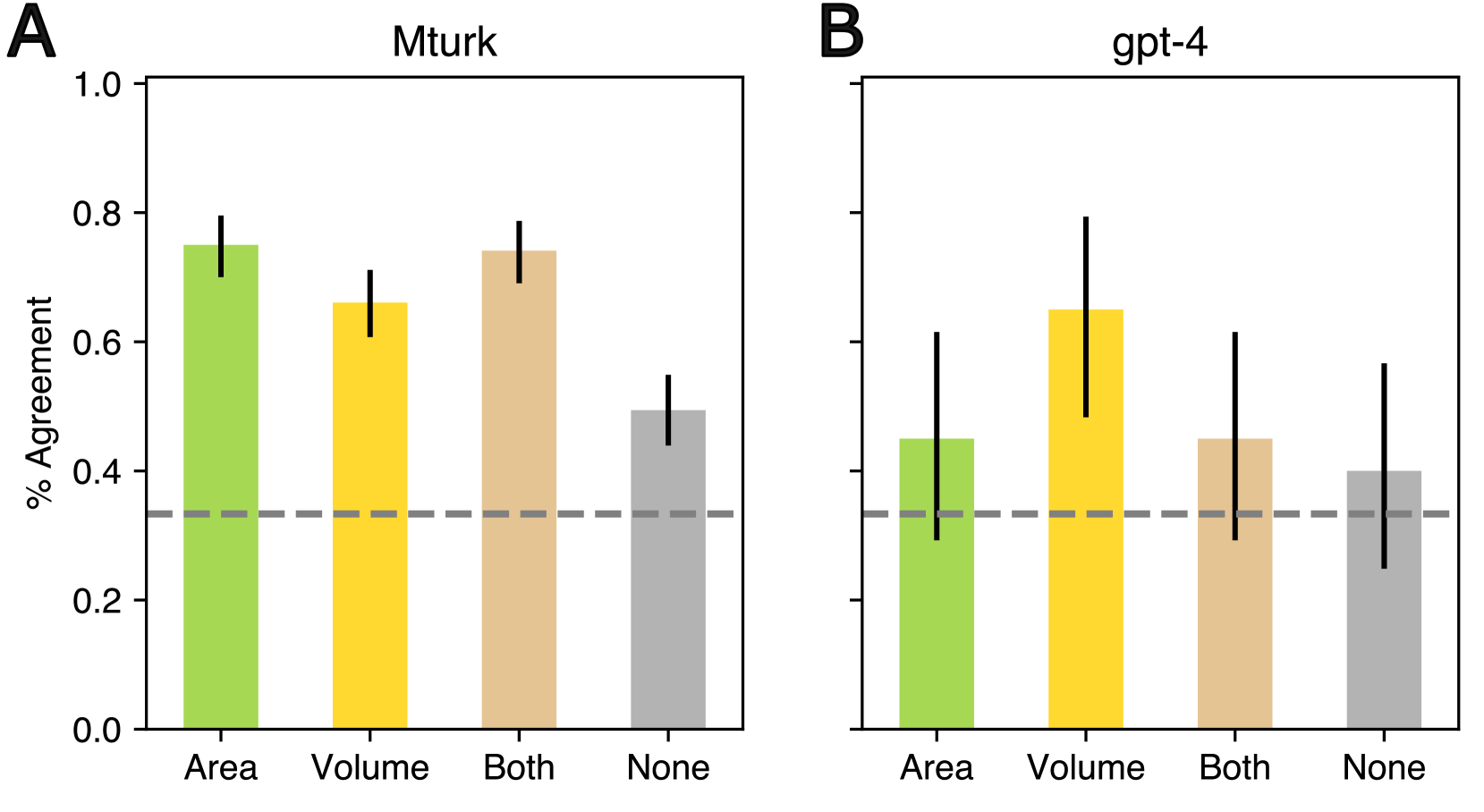

实验结果表明,人类参与者强烈偏好契约主义算法(纳什积)推荐的决策方案,而非功利主义算法(效用总和)。此外,研究发现大型语言模型在社会决策中的偏好与人类存在显著差异,这表明需要进一步研究如何使人工智能的价值观与人类价值观对齐。

🎯 应用场景

该研究成果可应用于群体决策支持系统、资源分配、政策制定等领域。通过理解人类在社会决策中的偏好,可以设计更公平、更合理的算法和系统,提升决策质量和用户满意度。此外,该研究对于人工智能伦理和价值观对齐具有重要意义,有助于开发更符合人类价值观的人工智能系统。

📄 摘要(原文)

What is the best compromise in a situation where different people value different things? The most commonly accepted method for answering this question -- in fields across the behavioral and social sciences, decision theory, philosophy, and artificial intelligence development -- is simply to add up utilities associated with the different options and pick the solution with the largest sum. This

utilitarian'' approach seems like the obvious, theory-neutral way of approaching the problem. But there is an important, though often-ignored, alternative: acontractualist'' approach, which advocates for an agreement-driven method of deciding. Remarkably, no research has presented empirical evidence directly comparing the intuitive plausibility of these two approaches. In this paper, we systematically explore the proposals suggested by each algorithm (the ``Utilitarian Sum'' and the contractualist ''Nash Product''), using a paradigm that applies those algorithms to aggregating preferences across groups in a social decision-making context. While the dominant approach to value aggregation up to now has been utilitarian, we find that people strongly prefer the aggregations recommended by the contractualist algorithm. Finally, we compare the judgments of large language models (LLMs) to that of our (human) participants, finding important misalignment between model and human preferences.