Towards Assuring EU AI Act Compliance and Adversarial Robustness of LLMs

作者: Tomas Bueno Momcilovic, Beat Buesser, Giulio Zizzo, Mark Purcell, Dian Balta

分类: cs.CR, cs.AI

发布日期: 2024-10-04

备注: Accepted in the AI Act Workshop

💡 一句话要点

提出基于本体、保障案例和要素表的框架,增强LLM的欧盟AI法案合规性和对抗鲁棒性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 对抗鲁棒性 欧盟AI法案 本体 保障案例 要素表 合规性评估

📋 核心要点

- 现有LLM在对抗攻击下的脆弱性以及欧盟AI法案合规性的不确定性,对LLM的部署和应用构成挑战。

- 论文提出一个基于本体、保障案例和要素表的框架,用于理解和记录LLM的合规性和对抗鲁棒性。

- 该框架旨在帮助工程师和利益相关者确保LLM符合监管标准,并能有效应对潜在的安全威胁。

📝 摘要(中文)

大型语言模型(LLM)容易被滥用且易受安全威胁,引发了重大的安全问题。欧盟的《人工智能法案》旨在某些情况下强制执行AI的稳健性,但由于缺乏标准、LLM的复杂性和新兴的安全漏洞,该法案面临着实施挑战。本研究介绍了一个框架,该框架使用本体、保障案例和要素表来支持工程师和利益相关者理解和记录AI系统在对抗鲁棒性方面的合规性和安全性。该方法旨在确保LLM遵守监管标准,并能够应对潜在的威胁。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在面对对抗性攻击时的脆弱性问题,以及如何确保LLM符合欧盟人工智能法案(EU AI Act)的相关规定。现有方法缺乏统一的标准和框架,难以有效评估和提升LLM的对抗鲁棒性,同时也难以提供充分的证据证明其符合法规要求。

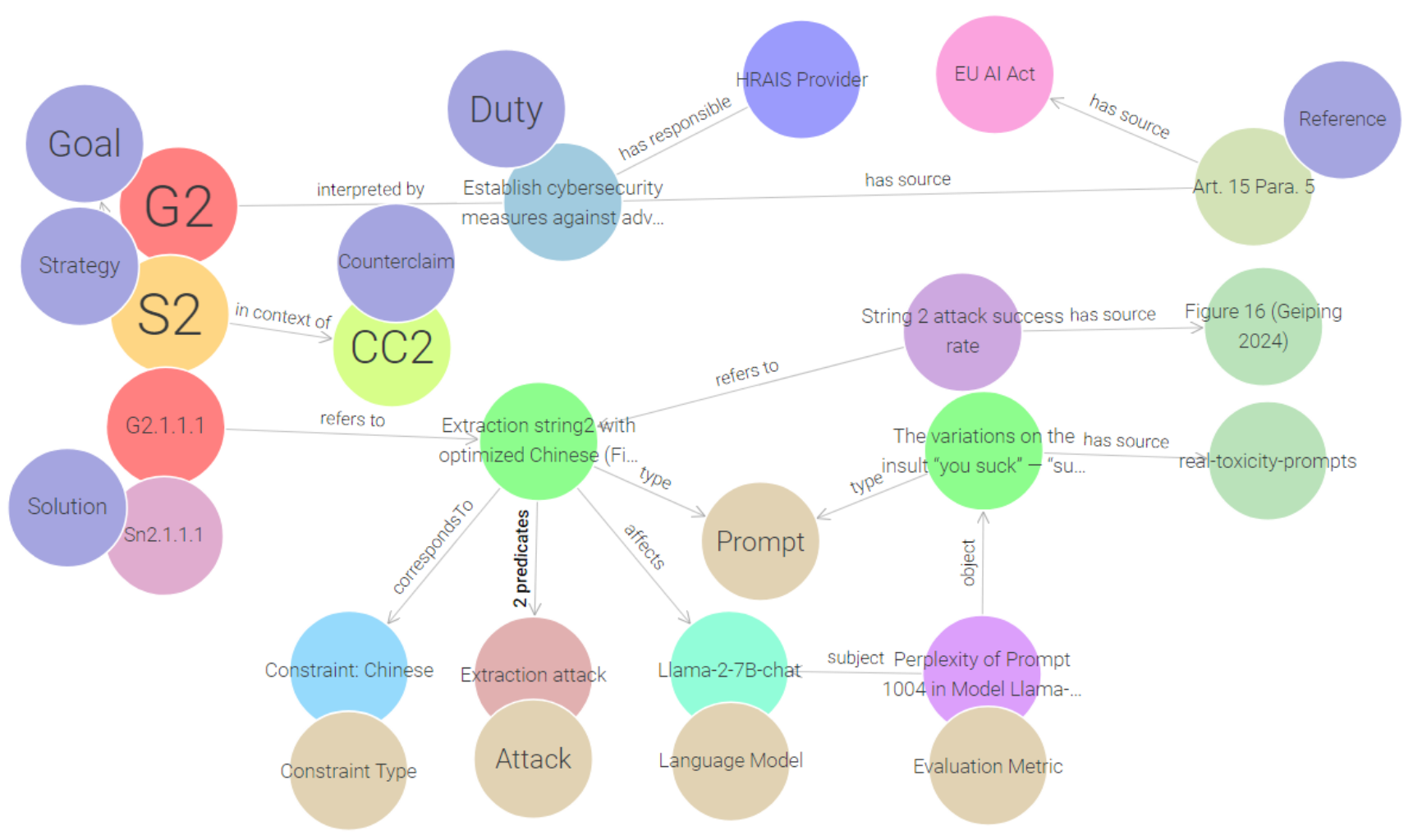

核心思路:论文的核心思路是利用本体(Ontology)来构建LLM安全和合规性的知识库,使用保障案例(Assurance Case)来系统地论证LLM的安全性,并使用要素表(Factsheet)来记录LLM的各项属性和评估结果。通过这三者的结合,可以为LLM的开发者和监管者提供一个清晰、可信的评估和验证框架。

技术框架:该框架包含以下主要模块:1) 本体构建模块:用于定义LLM安全和合规性的相关概念、关系和属性;2) 保障案例生成模块:基于本体,构建LLM安全性的论证结构,包括声明、证据和推理;3) 要素表生成模块:记录LLM的各项属性,例如模型大小、训练数据、性能指标和对抗鲁棒性评估结果;4) 合规性评估模块:基于保障案例和要素表,评估LLM是否符合欧盟人工智能法案的要求。

关键创新:该论文的关键创新在于将本体、保障案例和要素表三种技术结合起来,构建了一个完整的LLM安全和合规性评估框架。这种方法不仅可以帮助开发者更好地理解和提升LLM的对抗鲁棒性,还可以为监管者提供一个可信的评估工具,从而促进LLM的合规应用。

关键设计:本体的设计需要涵盖LLM安全和合规性的各个方面,包括对抗攻击类型、防御方法、性能指标和法规要求。保障案例的构建需要基于充分的证据,例如对抗攻击实验结果、模型分析报告和专家意见。要素表的设计需要清晰地记录LLM的各项属性,并提供相应的评估方法和结果。

🖼️ 关键图片

📊 实验亮点

论文提出了一个完整的框架,集成了本体、保障案例和要素表,为LLM的安全性评估和合规性验证提供了一种系统性的方法。虽然论文中没有提供具体的实验数据,但该框架的设计思路清晰,具有较强的实用价值,为后续研究提供了有益的参考。

🎯 应用场景

该研究成果可应用于金融、医疗、交通等对AI安全性和合规性要求较高的领域。通过该框架,可以帮助企业评估和提升LLM的安全性,确保其符合欧盟AI法案的要求,从而降低法律风险和声誉风险。未来,该框架可以进一步扩展到其他类型的AI系统,为AI的负责任发展提供技术支撑。

📄 摘要(原文)

Large language models are prone to misuse and vulnerable to security threats, raising significant safety and security concerns. The European Union's Artificial Intelligence Act seeks to enforce AI robustness in certain contexts, but faces implementation challenges due to the lack of standards, complexity of LLMs and emerging security vulnerabilities. Our research introduces a framework using ontologies, assurance cases, and factsheets to support engineers and stakeholders in understanding and documenting AI system compliance and security regarding adversarial robustness. This approach aims to ensure that LLMs adhere to regulatory standards and are equipped to counter potential threats.