SWIM: Short-Window CNN Integrated with Mamba for EEG-Based Auditory Spatial Attention Decoding

作者: Ziyang Zhang, Andrew Thwaites, Alexandra Woolgar, Brian Moore, Chao Zhang

分类: eess.AS, cs.AI, cs.SD, eess.SP

发布日期: 2024-09-30 (更新: 2024-11-27)

备注: accepted by SLT 2024

🔗 代码/项目: GITHUB

💡 一句话要点

提出SWIM模型,结合短窗CNN与Mamba,用于脑电信号的听觉空间注意力解码。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 脑电信号 听觉空间注意力 卷积神经网络 Mamba模型 序列建模

📋 核心要点

- 现有听觉空间注意力解码方法依赖语音包络,限制了其在复杂环境中的应用。

- SWIM模型结合短窗CNN提取短期特征,并利用Mamba模型捕捉长期依赖关系,实现更精确的解码。

- 实验结果表明,SWIM模型在KUL数据集上取得了86.2%的准确率,显著优于现有方法。

📝 摘要(中文)

本研究提出了一种名为SWIM的新模型,该模型集成了短窗卷积神经网络(CNN)和Mamba,用于从脑电图(EEG)信号中识别听觉注意力的位置(左或右),而无需依赖语音包络。SWIM由两部分组成。第一部分是短窗CNN(SW$ ext{CNN}$),它作为短期EEG特征提取器,在广泛使用的KUL数据集的留一说话人交叉验证设置中,最终准确率达到84.9%。这一改进归功于改进的CNN结构、数据增强、多任务训练和模型组合。第二部分是Mamba,这是一种首次应用于听觉空间注意力解码的序列模型,用于利用来自先前SW$ ext{CNN}$时间步的长时依赖性。通过联合训练SW$_ ext{CNN}$和Mamba,所提出的SWIM结构利用了短期和长期信息,实现了86.2%的准确率,与之前的最先进结果相比,分类错误率相对降低了31.0%。源代码可在https://github.com/windowso/SWIM-ASAD 获得。

🔬 方法详解

问题定义:论文旨在解决在复杂听觉环境中,如何仅通过脑电信号准确解码听觉空间注意力(左或右)的问题。现有方法通常依赖于语音包络,这限制了它们在非语音或多语音环境中的应用,并且可能无法充分利用脑电信号中的时序信息。

核心思路:论文的核心思路是将短时脑电特征提取与长时依赖建模相结合。通过短窗CNN提取脑电信号的局部特征,然后利用Mamba模型捕捉这些局部特征之间的长期依赖关系,从而更全面地理解听觉注意力的动态过程。这种设计旨在克服传统方法对语音包络的依赖,并充分利用脑电信号中的时序信息。

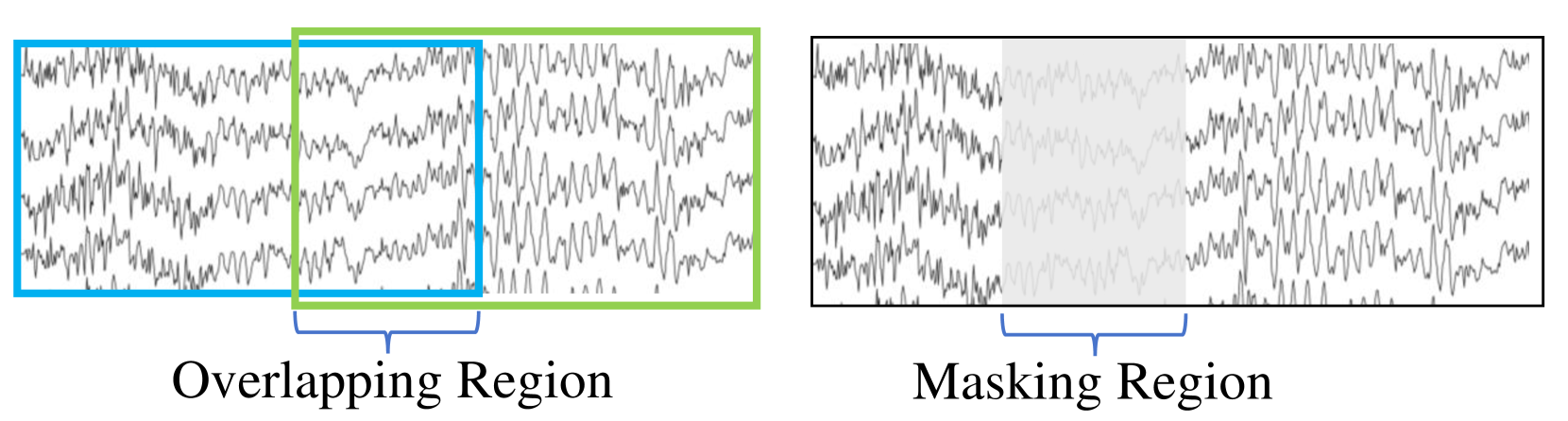

技术框架:SWIM模型由两个主要模块组成:短窗CNN(SW$ ext{CNN}$)和Mamba。首先,SW$ ext{CNN}$将脑电信号分割成短时窗口,并提取每个窗口的特征。然后,Mamba模型将这些特征序列作为输入,利用其选择性状态空间模型(Selective State Space Model, S6)来捕捉长时依赖关系。最后,Mamba模型的输出被用于分类,判断听觉注意力位于左侧还是右侧。整个框架采用端到端的方式进行训练。

关键创新:该论文的关键创新在于将Mamba模型引入到听觉空间注意力解码任务中。Mamba模型是一种新型的序列模型,具有线性复杂度,并且能够有效地捕捉长时依赖关系。与传统的循环神经网络(RNN)和Transformer相比,Mamba模型在处理长序列时具有更高的效率和更好的性能。此外,论文还对短窗CNN进行了改进,并采用了数据增强、多任务训练和模型组合等技术,进一步提高了模型的性能。

关键设计:SW$_ ext{CNN}$采用了一种改进的CNN结构,具体结构细节未知。数据增强方法未知,但被用于提升模型泛化能力。多任务训练可能涉及辅助任务,以提高特征学习的效率。Mamba模型的具体参数设置未知,但其核心在于选择性状态空间模型(S6),该模型允许模型根据输入动态地调整其状态转移矩阵。损失函数未知,但通常采用交叉熵损失函数进行分类任务。

🖼️ 关键图片

📊 实验亮点

SWIM模型在KUL数据集上取得了显著的性能提升。在留一说话人交叉验证设置中,SW$_ ext{CNN}$的准确率达到84.9%,而SWIM模型的准确率进一步提升至86.2%。与之前的最先进结果相比,SWIM模型将分类错误率相对降低了31.0%,表明其在听觉空间注意力解码方面具有显著优势。

🎯 应用场景

该研究成果可应用于脑机接口(BCI)系统,帮助听力受损人士在嘈杂环境中选择性地关注特定声源。此外,该技术还可用于开发智能助听设备,提高语音识别的准确性,并改善人机交互体验。未来,该研究或可扩展到其他认知任务的脑电解码,例如视觉注意力和工作记忆。

📄 摘要(原文)

In complex auditory environments, the human auditory system possesses the remarkable ability to focus on a specific speaker while disregarding others. In this study, a new model named SWIM, a short-window convolution neural network (CNN) integrated with Mamba, is proposed for identifying the locus of auditory attention (left or right) from electroencephalography (EEG) signals without relying on speech envelopes. SWIM consists of two parts. The first is a short-window CNN (SW$\text{CNN}$), which acts as a short-term EEG feature extractor and achieves a final accuracy of 84.9% in the leave-one-speaker-out setup on the widely used KUL dataset. This improvement is due to the use of an improved CNN structure, data augmentation, multitask training, and model combination. The second part, Mamba, is a sequence model first applied to auditory spatial attention decoding to leverage the long-term dependency from previous SW$\text{CNN}$ time steps. By joint training SW$_\text{CNN}$ and Mamba, the proposed SWIM structure uses both short-term and long-term information and achieves an accuracy of 86.2%, which reduces the classification errors by a relative 31.0% compared to the previous state-of-the-art result. The source code is available at https://github.com/windowso/SWIM-ASAD.