See Where You Read with Eye Gaze Tracking and Large Language Model

作者: Sikai Yang, Gang Yan, Wan Du

分类: cs.HC, cs.AI, cs.CV

发布日期: 2024-09-28 (更新: 2024-12-13)

备注: 9 pages

💡 一句话要点

提出基于眼动追踪与大语言模型的阅读辅助系统,解决跳读场景下的定位难题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 眼动追踪 大语言模型 阅读辅助 跳读检测 上下文感知

📋 核心要点

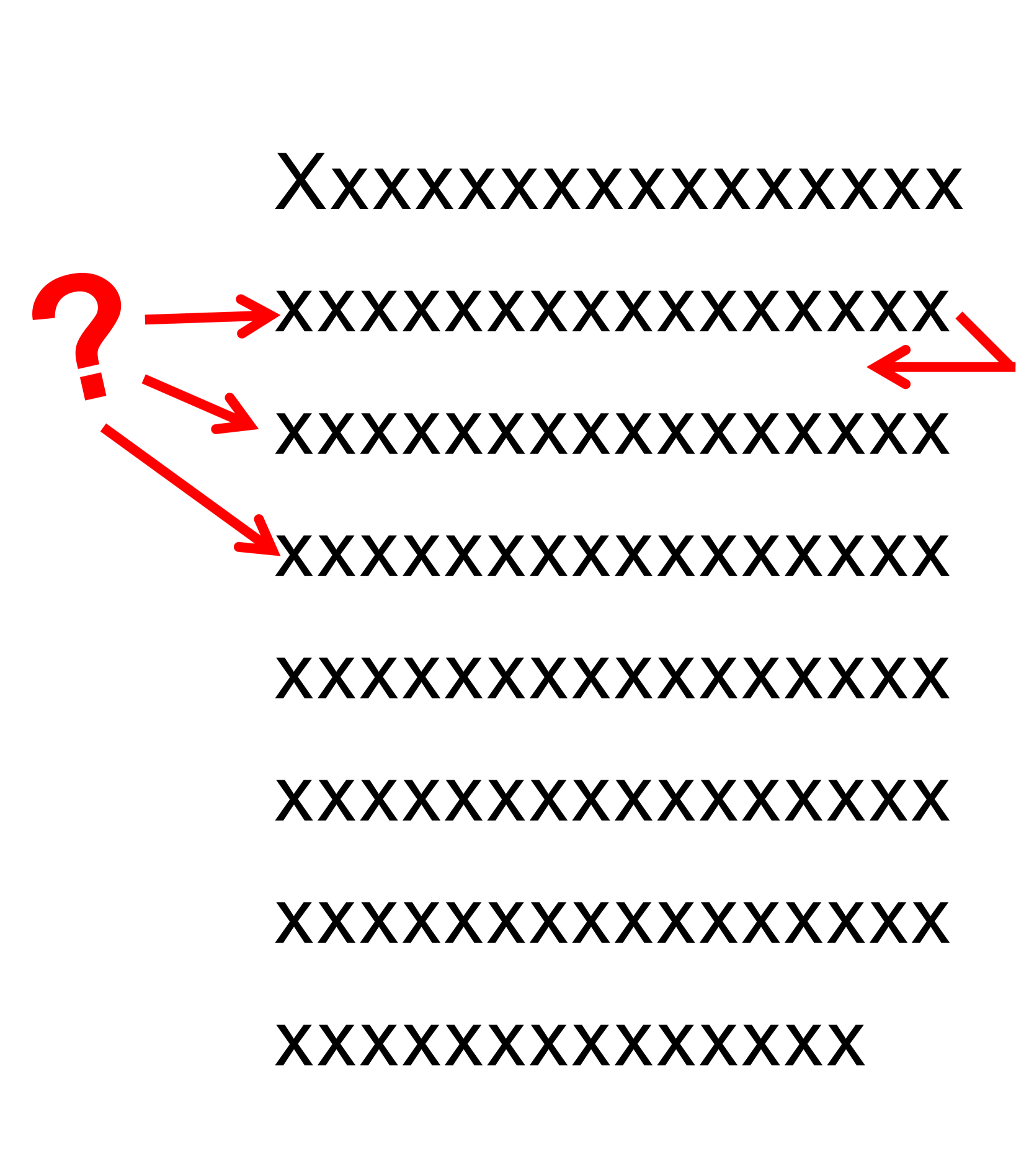

- 现有眼动追踪阅读辅助系统难以应对跳读,精度不足导致行间定位困难。

- 利用眼动误差模型检测跳读,结合大语言模型上下文理解能力辅助定位。

- 实验表明,该系统在跳读追踪中达到84%的准确率,提升阅读效率。

📝 摘要(中文)

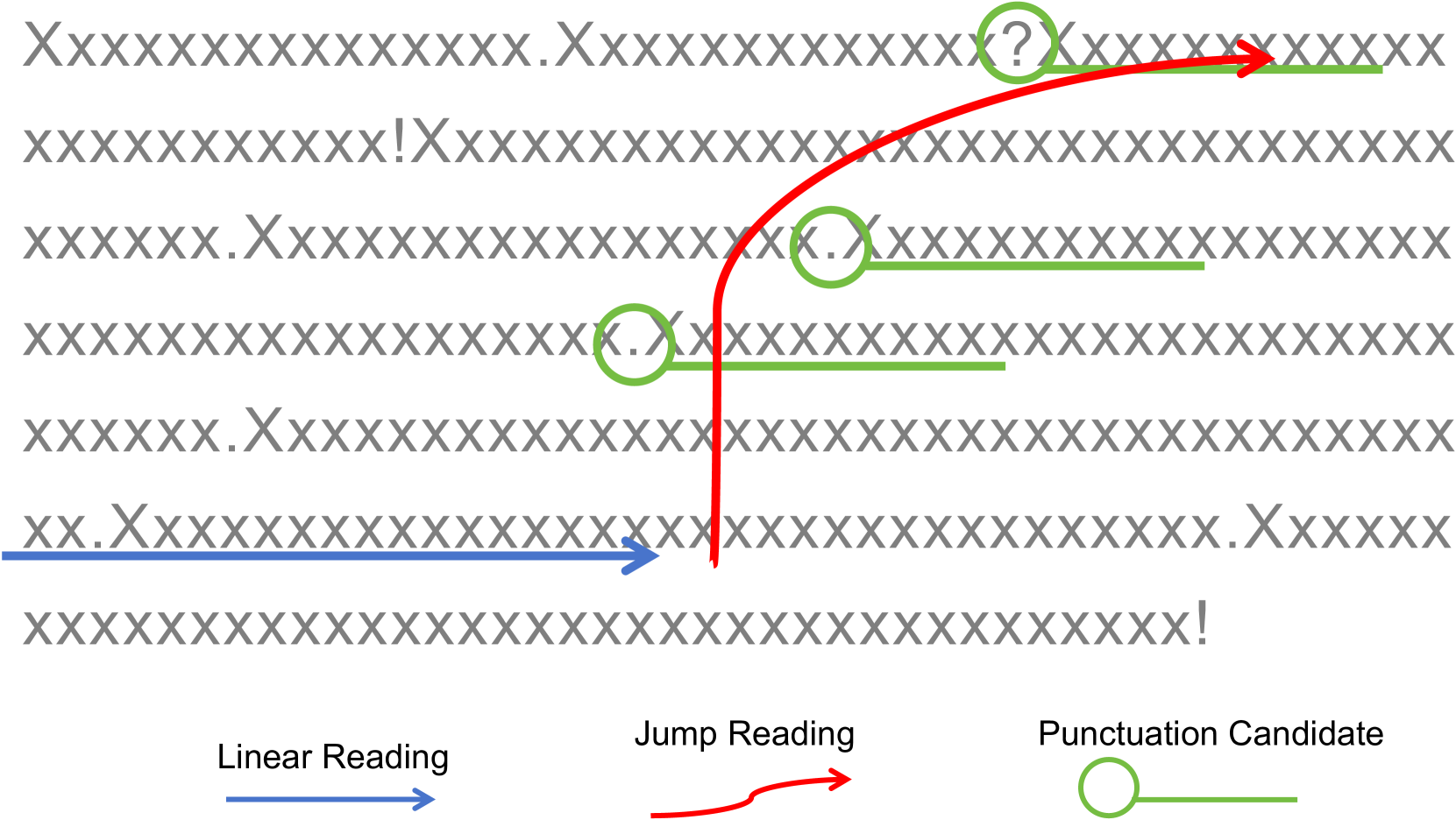

在阅读过程中,行间切换时容易丢失阅读进度,令人沮丧。眼动追踪技术通过高亮已读段落,有望解决此问题,避免错误的行切换。然而,眼动追踪精度(2-3厘米)与文本行间距(3-5毫米)之间的差距使得直接应用不切实际。现有方法利用线性阅读模式,但在跳读时失效。本文提出了一种支持线性和跳读的阅读追踪和高亮系统。基于对16名用户眼动行为的实验分析,设计了两种眼动误差模型,以实现跳读检测和重定位。该系统还利用大语言模型的上下文感知能力来辅助阅读追踪。同时,利用阅读追踪领域特定的行-眼动对齐机会,实现对眼动结果的动态和频繁校准。受控实验表明,该系统能够可靠地追踪线性阅读,并在跳读追踪中达到84%的准确率。此外,对18名志愿者的真实场景测试表明,该系统能够有效地追踪和高亮已读段落,提高阅读效率,并改善用户体验。

🔬 方法详解

问题定义:现有基于眼动追踪的阅读辅助系统主要依赖于线性阅读模式,当用户进行跳读时,由于眼动追踪的精度限制(2-3厘米)远大于文本行间距(3-5毫米),导致无法准确判断用户当前阅读的行,从而无法提供有效的阅读引导。因此,如何准确追踪跳读行为,是本论文要解决的核心问题。

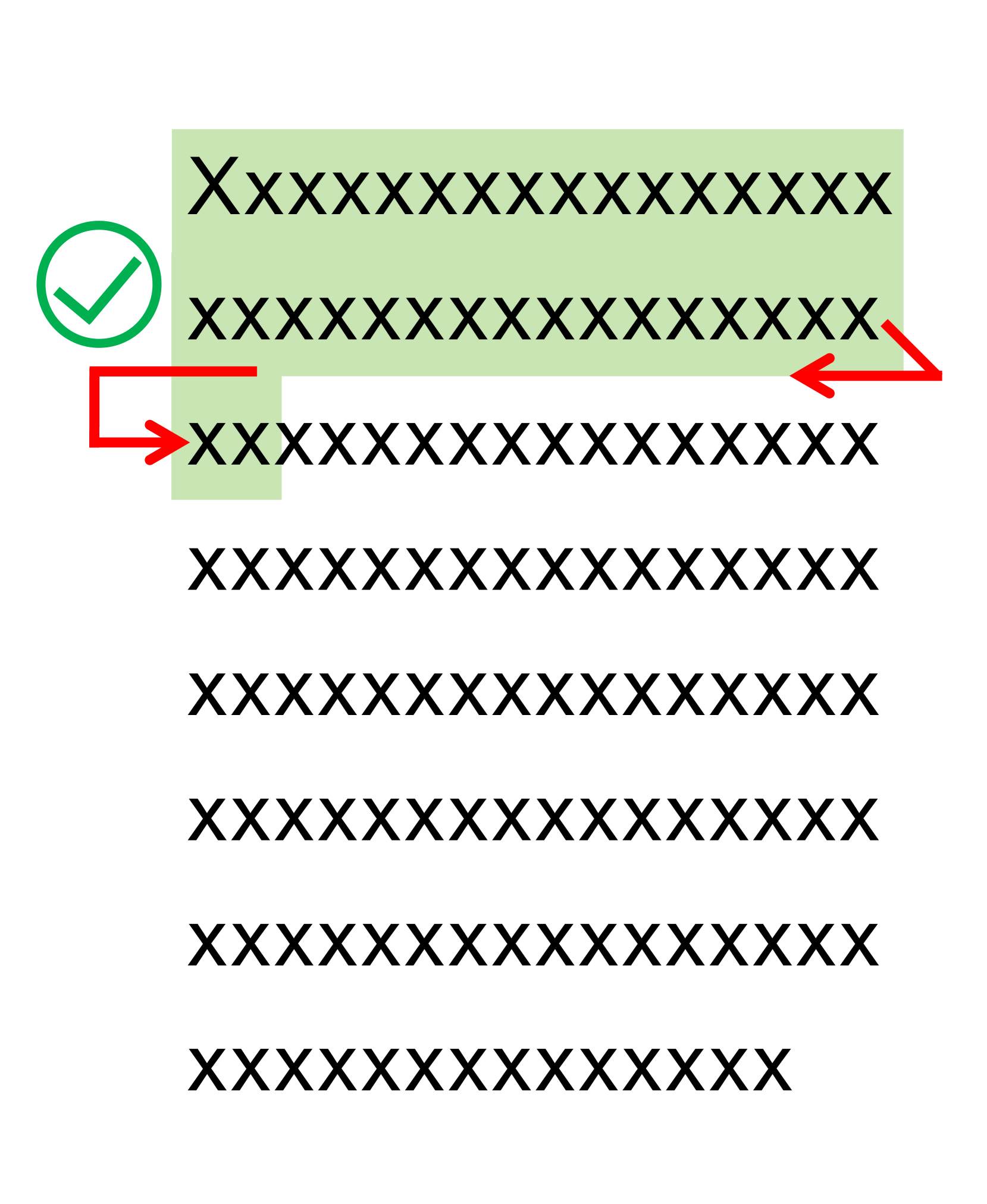

核心思路:本论文的核心思路是结合眼动误差模型和大语言模型的上下文感知能力,来弥补眼动追踪精度的不足。通过眼动误差模型来检测跳读行为,并利用大语言模型对阅读内容进行理解,从而辅助确定用户当前阅读的段落。同时,利用阅读过程中产生的行-眼动对齐数据,动态校准眼动追踪结果,进一步提高定位精度。

技术框架:该系统主要包含以下几个模块:1) 眼动数据采集模块:负责采集用户的眼动数据。2) 眼动误差模型模块:基于对用户眼动行为的分析,建立眼动误差模型,用于检测跳读行为。3) 大语言模型模块:利用大语言模型对阅读内容进行理解,提供上下文信息。4) 行-眼动对齐模块:利用阅读过程中产生的行-眼动对齐数据,动态校准眼动追踪结果。5) 阅读追踪和高亮模块:根据眼动数据、眼动误差模型和大语言模型的输出,确定用户当前阅读的段落,并进行高亮显示。

关键创新:本论文的关键创新在于:1) 提出了基于眼动误差模型的跳读检测方法,能够有效识别用户的跳读行为。2) 将大语言模型的上下文感知能力引入到阅读追踪系统中,提高了系统对阅读内容的理解能力,从而辅助确定用户当前阅读的段落。3) 提出了利用行-眼动对齐数据动态校准眼动追踪结果的方法,进一步提高了定位精度。

关键设计:眼动误差模型的设计是关键。论文基于对16名用户眼动行为的分析,设计了两种眼动误差模型,分别用于检测水平方向和垂直方向的跳读行为。具体参数设置未知,但强调了基于用户数据的统计分析。大语言模型的使用方式也未详细说明,但强调了利用其上下文感知能力。行-眼动对齐模块的具体实现方式未知,但强调了动态和频繁校准的重要性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该系统能够可靠地追踪线性阅读,并在跳读追踪中达到84%的准确率。与没有眼动追踪辅助的阅读相比,使用该系统可以显著提高阅读效率。对18名志愿者的真实场景测试表明,该系统能够有效地追踪和高亮已读段落,改善用户体验。这些结果验证了该系统在实际应用中的有效性。

🎯 应用场景

该研究成果可应用于各种阅读辅助场景,例如在线阅读平台、电子书阅读器、教育软件等。通过提供精准的阅读追踪和高亮功能,可以有效提高阅读效率,改善用户体验,尤其对于有阅读障碍或需要长时间阅读的用户,具有重要的辅助价值。未来,可以将该技术与虚拟现实/增强现实技术结合,创造更沉浸式的阅读体验。

📄 摘要(原文)

Losing track of reading progress during line switching can be frustrating. Eye gaze tracking technology offers a potential solution by highlighting read paragraphs, aiding users in avoiding wrong line switches. However, the gap between gaze tracking accuracy (2-3 cm) and text line spacing (3-5 mm) makes direct application impractical. Existing methods leverage the linear reading pattern but fail during jump reading. This paper presents a reading tracking and highlighting system that supports both linear and jump reading. Based on experimental insights from the gaze nature study of 16 users, two gaze error models are designed to enable both jump reading detection and relocation. The system further leverages the large language model's contextual perception capability in aiding reading tracking. A reading tracking domain-specific line-gaze alignment opportunity is also exploited to enable dynamic and frequent calibration of the gaze results. Controlled experiments demonstrate reliable linear reading tracking, as well as 84% accuracy in tracking jump reading. Furthermore, real field tests with 18 volunteers demonstrated the system's effectiveness in tracking and highlighting read paragraphs, improving reading efficiency, and enhancing user experience.