Trustworthy AI: Securing Sensitive Data in Large Language Models

作者: Georgios Feretzakis, Vassilios S. Verykios

分类: cs.AI

发布日期: 2024-09-26

备注: 40 pages, 1 figure

期刊: AI 5(4), 2773-2800 (2024)

DOI: 10.3390/ai5040134

💡 一句话要点

提出面向大语言模型的信任框架,保障敏感数据安全

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 隐私保护 数据安全 信任机制 访问控制

📋 核心要点

- 现有大语言模型在敏感领域应用面临隐私泄露风险,缺乏细粒度的访问控制机制。

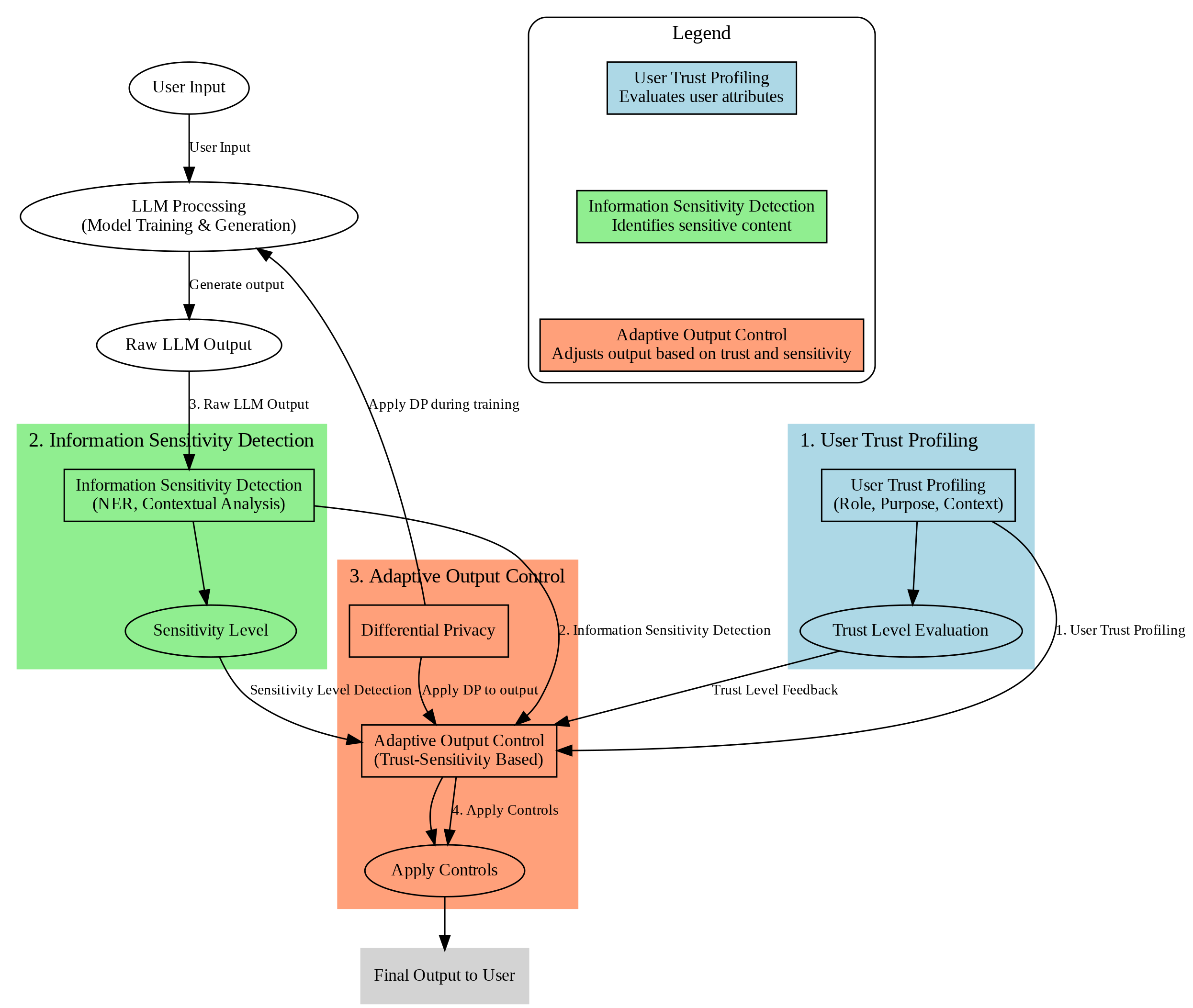

- 提出一种综合信任框架,通过用户信任画像、信息敏感度检测和自适应输出控制,动态管理敏感信息披露。

- 该框架旨在平衡数据效用和隐私保护,为高风险场景下安全部署LLM提供解决方案,未来将进行多领域测试。

📝 摘要(中文)

大型语言模型(LLM)通过强大的文本生成和理解能力,变革了自然语言处理(NLP)领域。然而,在医疗、金融和法律服务等敏感领域的部署引发了对隐私和数据安全的关键担忧。本文提出了一个综合框架,将信任机制嵌入到LLM中,以动态控制敏感信息的披露。该框架集成了三个核心组件:用户信任画像、信息敏感度检测和自适应输出控制。通过利用基于角色的访问控制(RBAC)、基于属性的访问控制(ABAC)、命名实体识别(NER)、上下文分析以及差分隐私等隐私保护方法,该系统确保敏感信息根据用户的信任级别进行适当披露。通过关注数据效用和隐私之间的平衡,所提出的解决方案为在高风险环境中安全部署LLM提供了一种新颖的方法。未来的工作将侧重于在各个领域测试该框架,以评估其在管理敏感数据同时保持系统效率方面的有效性。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在处理敏感数据时存在的隐私泄露风险。现有的LLM部署缺乏有效的机制来控制敏感信息的披露,无法根据用户的信任级别和信息的敏感程度进行细粒度的访问控制,导致潜在的数据滥用和隐私侵犯。

核心思路:论文的核心思路是将信任机制嵌入到LLM中,构建一个动态的、自适应的隐私保护框架。该框架通过对用户进行信任画像,识别信息的敏感程度,并根据这两者之间的关系,自适应地控制LLM的输出,从而在数据效用和隐私保护之间取得平衡。

技术框架:该框架包含三个主要模块:1) 用户信任画像:利用RBAC和ABAC等技术,根据用户的角色、属性和行为建立信任等级。2) 信息敏感度检测:采用NER和上下文分析等技术,识别文本中包含的敏感信息,并评估其敏感程度。3) 自适应输出控制:根据用户信任等级和信息敏感程度,利用差分隐私等技术,对LLM的输出进行调整,例如删除、替换或泛化敏感信息。

关键创新:该论文的关键创新在于提出了一个综合性的信任框架,将用户信任、信息敏感度和输出控制三个方面有机结合,实现了对LLM敏感信息的动态管理。与传统的静态隐私保护方法相比,该框架能够根据不同的用户和信息,自适应地调整隐私保护策略,从而更好地平衡数据效用和隐私保护。

关键设计:用户信任画像模块的关键设计在于如何有效地整合用户的角色、属性和行为信息,构建准确的信任等级。信息敏感度检测模块的关键设计在于如何利用NER和上下文分析技术,准确识别文本中的敏感信息,并评估其敏感程度。自适应输出控制模块的关键设计在于如何选择合适的隐私保护技术(如差分隐私),并根据用户信任等级和信息敏感程度,调整隐私保护参数,以实现最佳的隐私保护效果。

🖼️ 关键图片

📊 实验亮点

论文侧重于框架设计,摘要中未提供具体的实验结果和性能数据。未来的工作将侧重于在各个领域测试该框架,以评估其在管理敏感数据同时保持系统效率方面的有效性。因此,目前无法提供具体的实验亮点。

🎯 应用场景

该研究成果可应用于医疗、金融、法律等对数据安全和隐私保护要求极高的领域。例如,在医疗领域,可以控制患者病历信息的访问权限,确保只有授权的医生和研究人员才能访问敏感信息。在金融领域,可以防止客户的财务数据被泄露,保护客户的财产安全。该研究有助于推动LLM在敏感领域的安全应用,并为未来的隐私保护研究提供新的思路。

📄 摘要(原文)

Large Language Models (LLMs) have transformed natural language processing (NLP) by enabling robust text generation and understanding. However, their deployment in sensitive domains like healthcare, finance, and legal services raises critical concerns about privacy and data security. This paper proposes a comprehensive framework for embedding trust mechanisms into LLMs to dynamically control the disclosure of sensitive information. The framework integrates three core components: User Trust Profiling, Information Sensitivity Detection, and Adaptive Output Control. By leveraging techniques such as Role-Based Access Control (RBAC), Attribute-Based Access Control (ABAC), Named Entity Recognition (NER), contextual analysis, and privacy-preserving methods like differential privacy, the system ensures that sensitive information is disclosed appropriately based on the user's trust level. By focusing on balancing data utility and privacy, the proposed solution offers a novel approach to securely deploying LLMs in high-risk environments. Future work will focus on testing this framework across various domains to evaluate its effectiveness in managing sensitive data while maintaining system efficiency.