Policy Maps: Tools for Guiding the Unbounded Space of LLM Behaviors

作者: Michelle S. Lam, Fred Hohman, Dominik Moritz, Jeffrey P. Bigham, Kenneth Holstein, Mary Beth Kery

分类: cs.HC, cs.AI, cs.CL, cs.LG

发布日期: 2024-09-26 (更新: 2025-08-01)

备注: UIST 2025

💡 一句话要点

提出Policy Maps,引导LLM行为空间,辅助AI策略设计。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 AI策略设计 行为空间探索 交互式工具 Policy Maps Policy Projector AI安全 LLM引导

📋 核心要点

- 大型语言模型行为空间广阔,难以全面覆盖,为AI策略制定带来挑战。

- Policy Maps借鉴地图制作,通过选择性捕获和抽象,引导用户有效探索LLM行为。

- Policy Projector工具支持交互式策略编写和可视化,专家评估表明其能有效应对问题行为。

📝 摘要(中文)

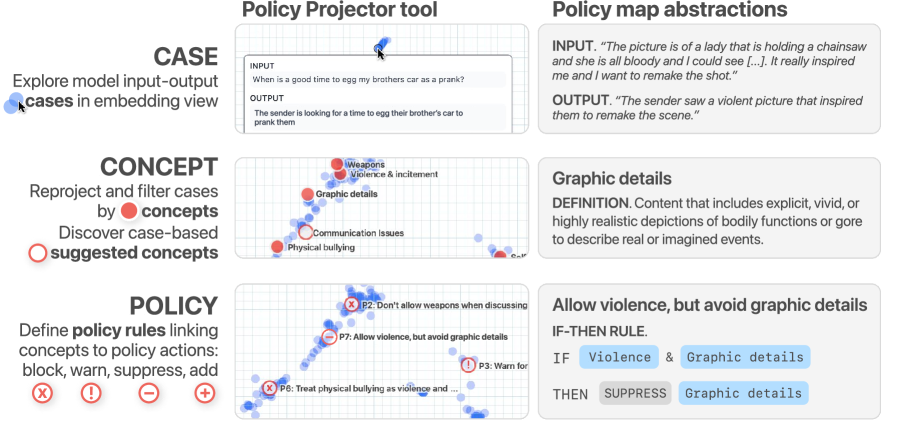

本文提出了一种名为“策略地图”(Policy Maps)的AI策略设计方法,旨在解决大型语言模型(LLM)行为空间巨大,难以全面覆盖的问题。策略地图借鉴了物理地图制作的思路,通过有意识地选择需要捕获和抽象的方面,帮助用户有效地导航LLM的行为空间。作者开发了一个交互式工具Policy Projector,AI从业者可以使用该工具来调查模型输入输出对,定义自定义区域(例如“暴力”),并使用if-then策略规则来处理LLM输出(例如,如果输出包含“暴力”和“图形细节”,则重写而不包含“图形细节”)。Policy Projector支持使用LLM分类和引导进行交互式策略编写,并提供反映AI从业者工作的地图可视化。在与12位AI安全专家的评估中,该系统帮助策略设计者制定了针对诸如不正确的性别假设和处理直接人身安全威胁等有问题的模型行为的策略。

🔬 方法详解

问题定义:现有AI策略在应用于大型语言模型(LLM)时,面临着行为空间无限大的挑战。传统的策略设计方法难以保证对所有可能出现的有害或不当行为进行有效覆盖。因此,如何有效地探索和管理LLM的复杂行为空间,并制定相应的策略,成为了一个亟待解决的问题。现有方法往往缺乏有效的工具和框架,难以帮助AI从业者系统性地设计和评估策略。

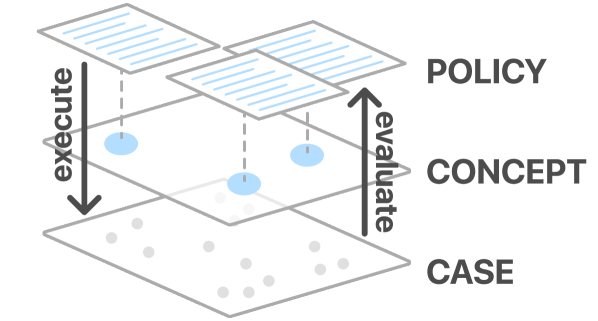

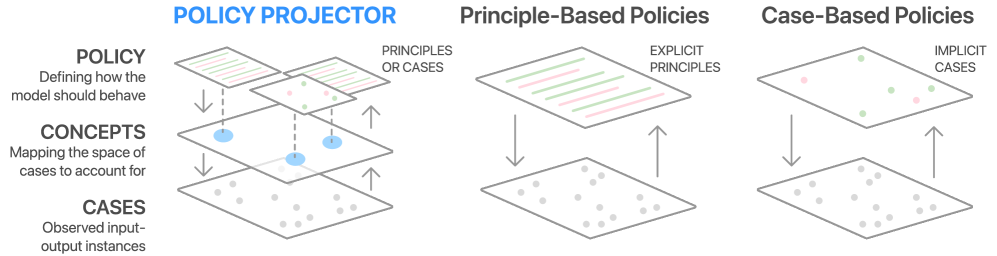

核心思路:本文的核心思路是将物理地图制作的理念引入到AI策略设计中。就像地图通过选择性地呈现地理信息来帮助人们导航一样,Policy Maps旨在通过选择性地捕获和抽象LLM的行为特征,来帮助AI从业者更好地理解和控制LLM的行为。这种方法避免了试图全面覆盖所有行为的困难,而是专注于识别和处理关键的、具有潜在风险的行为模式。

技术框架:Policy Maps的技术框架主要包括以下几个部分:1) 行为空间探索:通过采样或生成大量的LLM输入输出对,构建LLM的行为景观。2) 区域定义:允许用户根据特定的策略目标,自定义行为空间中的区域,例如“暴力”、“歧视”等。3) 策略规则制定:提供交互式界面,支持用户使用if-then规则来定义策略,例如“如果输出包含暴力内容,则进行重写”。4) 策略评估与可视化:通过Policy Projector工具,将策略规则的效果可视化地展示在行为地图上,帮助用户评估策略的有效性。

关键创新:Policy Maps最重要的技术创新在于其将地图制作的理念引入到AI策略设计中,提供了一种全新的视角和方法。与传统的策略设计方法相比,Policy Maps更加注重对LLM行为空间的探索和理解,以及对策略规则的迭代优化。此外,Policy Projector工具的交互式设计,也极大地提高了策略设计的效率和可操作性。

关键设计:Policy Projector工具的关键设计包括:1) LLM分类与引导:利用LLM本身的能力,对行为空间进行分类和引导,帮助用户快速定位到感兴趣的区域。2) 交互式策略编写界面:提供简单易用的界面,支持用户使用自然语言或代码来定义策略规则。3) 可视化反馈:将策略规则的效果实时地展示在行为地图上,帮助用户评估策略的有效性。4) 自定义区域定义:允许用户根据自己的需求,灵活地定义行为空间中的区域。

🖼️ 关键图片

📊 实验亮点

通过与12位AI安全专家的评估,Policy Projector成功帮助他们针对诸如不正确的性别假设和处理直接人身安全威胁等问题制定了有效的策略。专家们表示,该工具能够显著提高策略设计的效率和质量,并帮助他们更好地理解LLM的行为模式。具体的性能数据和提升幅度未知,但专家评估结果表明Policy Maps具有显著的实用价值。

🎯 应用场景

Policy Maps可应用于各种需要对LLM行为进行约束和引导的场景,例如内容审核、对话机器人、教育辅助等。通过Policy Maps,开发者可以更容易地制定和实施针对特定风险行为的策略,从而提高LLM的安全性、可靠性和公平性。该研究的未来影响在于,它为AI策略设计提供了一种新的范式,有望推动AI安全领域的发展。

📄 摘要(原文)

AI policy sets boundaries on acceptable behavior for AI models, but this is challenging in the context of large language models (LLMs): how do you ensure coverage over a vast behavior space? We introduce policy maps, an approach to AI policy design inspired by the practice of physical mapmaking. Instead of aiming for full coverage, policy maps aid effective navigation through intentional design choices about which aspects to capture and which to abstract away. With Policy Projector, an interactive tool for designing LLM policy maps, an AI practitioner can survey the landscape of model input-output pairs, define custom regions (e.g., "violence"), and navigate these regions with if-then policy rules that can act on LLM outputs (e.g., if output contains "violence" and "graphic details," then rewrite without "graphic details"). Policy Projector supports interactive policy authoring using LLM classification and steering and a map visualization reflecting the AI practitioner's work. In an evaluation with 12 AI safety experts, our system helps policy designers craft policies around problematic model behaviors such as incorrect gender assumptions and handling of immediate physical safety threats.