Proof of Thought : Neurosymbolic Program Synthesis allows Robust and Interpretable Reasoning

作者: Debargha Ganguly, Srinivasan Iyengar, Vipin Chaudhary, Shivkumar Kalyanaraman

分类: cs.AI, cs.CL, cs.LG, cs.LO, cs.NE

发布日期: 2024-09-25 (更新: 2024-10-23)

备注: 38th Conference on Neural Information Processing Systems (NeurIPS 2024) System 2 Reasoning At Scale Workshop

💡 一句话要点

提出Proof of Thought框架,提升LLM推理的可靠性与可解释性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 神经符号推理 程序合成 大语言模型 形式逻辑验证 可解释性AI

📋 核心要点

- 现有LLM在复杂逻辑推理和新领域泛化方面存在不足,推理过程缺乏透明度和可验证性。

- Proof of Thought框架将LLM的输出转化为形式逻辑,通过定理证明器进行验证,提升推理的可靠性。

- 实验表明,该框架在StrategyQA和多模态推理任务上表现出性能提升,尤其是在开放式场景中。

📝 摘要(中文)

大型语言模型(LLM)在自然语言处理领域取得了革命性进展,但它们在不一致的推理方面存在困难,尤其是在新领域和复杂的逻辑序列中。本研究介绍了一种名为Proof of Thought的框架,旨在提高LLM输出的可靠性和透明度。我们的方法将LLM生成的想法与形式逻辑验证相结合,利用自定义解释器将LLM输出转换为一阶逻辑结构,以便进行定理证明器的审查。该方法的核心是一种基于JSON的领域特定语言,它在精确的逻辑结构和直观的人类概念之间实现了平衡。这种混合表示既能实现严格的验证,又能使人类易于理解LLM的推理过程。主要贡献包括:一个具有排序管理的鲁棒类型系统,用于增强逻辑完整性;规则的显式表示,用于明确区分事实知识和推论知识;以及一个灵活的架构,可以轻松扩展到各种特定领域的应用。我们通过在StrategyQA和一个新的多模态推理任务上的基准测试,证明了Proof of Thought的有效性,并在开放式场景中显示出改进的性能。通过提供可验证和可解释的结果,我们的技术满足了对AI系统问责制的关键需求,并为高风险领域的人工监督奠定了基础。

🔬 方法详解

问题定义:现有大型语言模型(LLM)在进行复杂逻辑推理时,容易出现不一致和错误,尤其是在面对新的领域或复杂的逻辑序列时。此外,LLM的推理过程通常是黑盒的,缺乏透明度和可解释性,难以验证其结果的正确性。这限制了LLM在需要高可靠性和可信度的关键领域的应用。

核心思路:Proof of Thought的核心思路是将LLM生成的自然语言推理过程转化为形式逻辑表达式,然后利用定理证明器对这些表达式进行验证。通过这种方式,可以确保推理过程的逻辑一致性和正确性,并提供可验证的证据。该方法旨在弥合LLM的直觉推理能力与形式逻辑的严谨性之间的差距。

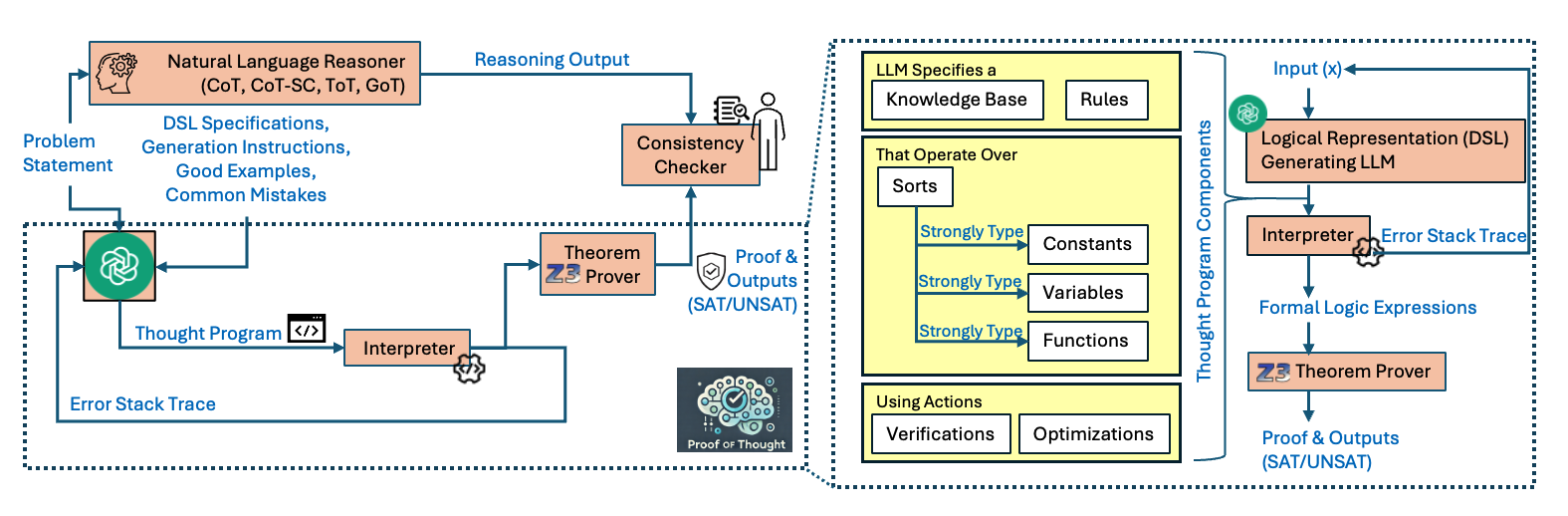

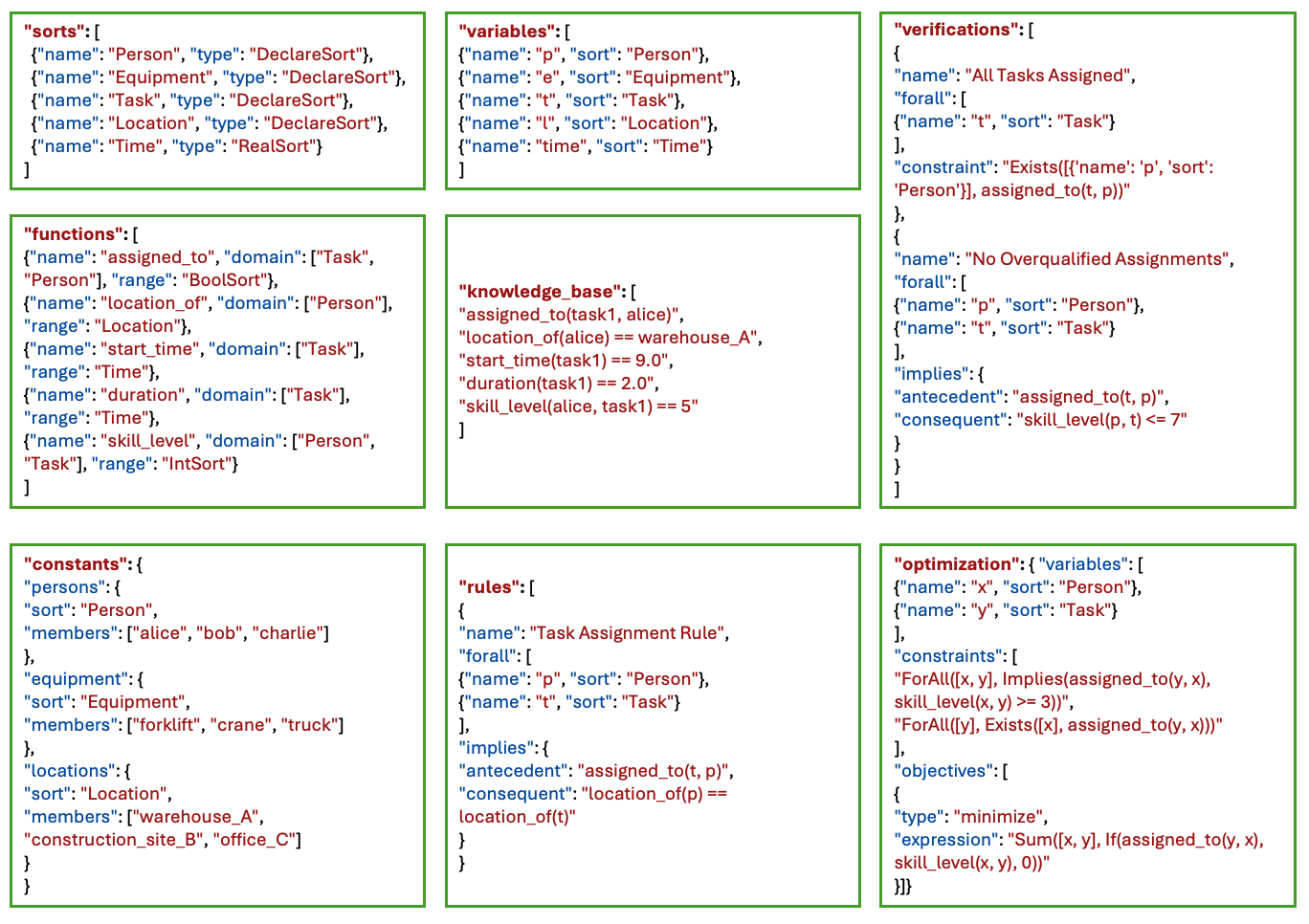

技术框架:Proof of Thought框架包含以下主要模块:1) LLM推理模块:利用LLM生成自然语言形式的推理过程。2) 领域特定语言(DSL)转换模块:将LLM的输出转换为基于JSON的DSL表示,该DSL旨在平衡逻辑精确性和人类可读性。3) 一阶逻辑(FOL)转换模块:将DSL表示转换为一阶逻辑表达式。4) 定理证明器:使用定理证明器验证FOL表达式的正确性。5) 结果解释模块:将定理证明器的结果解释为自然语言,并提供推理过程的可视化表示。

关键创新:该方法的主要创新点在于:1) 提出了一种混合表示方法,即基于JSON的领域特定语言,它既能表达精确的逻辑结构,又能保持人类可读性。2) 引入了一个鲁棒的类型系统,用于增强逻辑完整性。3) 显式地表示规则,从而明确区分事实知识和推论知识。4) 框架具有灵活的架构,易于扩展到各种特定领域的应用。

关键设计:DSL的设计是关键。它需要足够表达力来表示复杂的逻辑关系,同时又要足够简单易懂,方便LLM生成和人类理解。类型系统用于确保逻辑表达式的类型安全。规则的显式表示有助于区分事实和推论,提高推理过程的可解释性。框架的模块化设计使其易于集成不同的LLM和定理证明器。

🖼️ 关键图片

📊 实验亮点

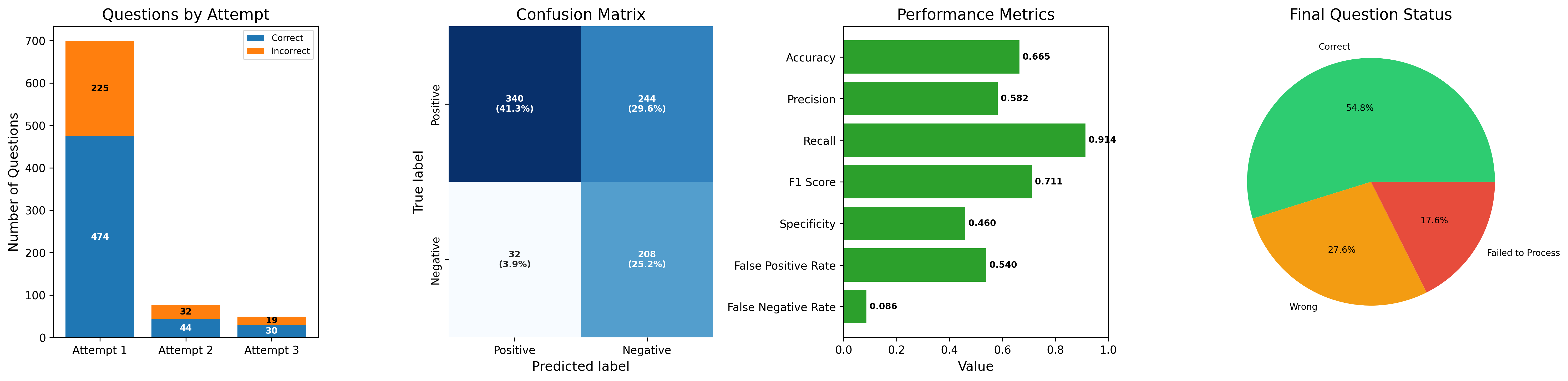

在StrategyQA数据集上,Proof of Thought框架表现出显著的性能提升。此外,在一个新的多模态推理任务上,该框架也取得了良好的效果,尤其是在开放式场景中。这些实验结果表明,Proof of Thought框架能够有效地提高LLM推理的可靠性和可解释性。

🎯 应用场景

Proof of Thought框架可应用于需要高可靠性和可解释性的领域,例如医疗诊断、金融风险评估、法律推理等。它可以帮助提高AI系统的问责制,并为高风险领域的人工监督提供支持。该框架还可以用于教育领域,帮助学生学习逻辑推理和形式化方法。

📄 摘要(原文)

Large Language Models (LLMs) have revolutionized natural language processing, yet they struggle with inconsistent reasoning, particularly in novel domains and complex logical sequences. This research introduces Proof of Thought, a framework that enhances the reliability and transparency of LLM outputs. Our approach bridges LLM-generated ideas with formal logic verification, employing a custom interpreter to convert LLM outputs into First Order Logic constructs for theorem prover scrutiny. Central to our method is an intermediary JSON-based Domain-Specific Language, which by design balances precise logical structures with intuitive human concepts. This hybrid representation enables both rigorous validation and accessible human comprehension of LLM reasoning processes. Key contributions include a robust type system with sort management for enhanced logical integrity, explicit representation of rules for clear distinction between factual and inferential knowledge, and a flexible architecture that allows for easy extension to various domain-specific applications. We demonstrate Proof of Thought's effectiveness through benchmarking on StrategyQA and a novel multimodal reasoning task, showing improved performance in open-ended scenarios. By providing verifiable and interpretable results, our technique addresses critical needs for AI system accountability and sets a foundation for human-in-the-loop oversight in high-stakes domains.