The Effect of Perceptual Metrics on Music Representation Learning for Genre Classification

作者: Tashi Namgyal, Alexander Hepburn, Raul Santos-Rodriguez, Valero Laparra, Jesus Malo

分类: cs.SD, cs.AI, cs.CV, cs.LG, eess.AS

发布日期: 2024-09-25

备注: arXiv admin note: text overlap with arXiv:2312.03455

💡 一句话要点

利用感知度量作为损失函数,提升音乐表征学习在音乐流派分类任务上的性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 音乐流派分类 表征学习 感知度量 自编码器 损失函数

📋 核心要点

- 现有音乐流派分类方法在特征提取方面存在不足,难以有效捕捉人类感知的音乐特征。

- 该论文提出使用感知度量作为自编码器的损失函数,从而学习到更符合人类感知的音乐表征。

- 实验结果表明,使用该方法提取的特征进行流派分类,性能优于直接使用感知度量作为距离度量的方法。

📝 摘要(中文)

自然信号的主观质量可以通过客观的感知度量来近似。感知度量旨在模拟人类观察者的感知行为,通常反映自然信号和神经通路中的结构。使用感知度量作为损失函数训练的模型可以从这些度量中捕获具有感知意义的特征。本文证明,使用通过感知损失训练的自编码器提取的特征,可以提高音乐理解任务(即流派分类)的性能,优于直接使用这些度量作为距离来学习分类器。该结果表明,当使用感知度量作为表征学习的损失函数时,可以更好地泛化到新的信号。

🔬 方法详解

问题定义:音乐流派分类旨在根据音乐内容自动识别其所属流派。现有方法在特征提取方面存在局限性,难以捕捉到与人类感知相关的音乐特征,导致分类精度受限。直接使用感知度量作为距离度量进行分类,泛化能力较弱。

核心思路:该论文的核心思路是利用感知度量作为自编码器的损失函数,训练自编码器学习音乐的潜在表征。由于感知度量能够反映人类的感知特性,因此通过这种方式学习到的表征能够更好地捕捉音乐中与人类感知相关的特征。

技术框架:整体框架包含两个主要阶段:1) 使用感知度量作为损失函数训练自编码器,提取音乐特征;2) 使用提取的特征训练分类器进行音乐流派分类。自编码器负责学习音乐的潜在表征,分类器负责将这些表征映射到不同的音乐流派。

关键创新:该论文的关键创新在于将感知度量引入到音乐表征学习中,并将其作为自编码器的损失函数。这种方法能够有效地利用感知度量中蕴含的关于人类感知的先验知识,从而学习到更具判别性的音乐表征。与直接使用感知度量作为距离度量相比,该方法能够更好地泛化到新的音乐信号。

关键设计:论文中使用了不同的感知度量作为损失函数,例如基于对比敏感度函数的度量。自编码器的网络结构可以根据具体任务进行调整。分类器可以使用常见的机器学习模型,例如支持向量机或神经网络。关键在于如何选择合适的感知度量和调整自编码器的结构,以获得最佳的表征学习效果。

🖼️ 关键图片

📊 实验亮点

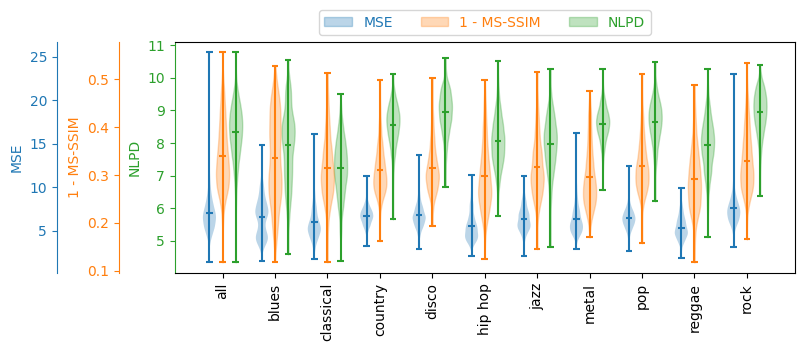

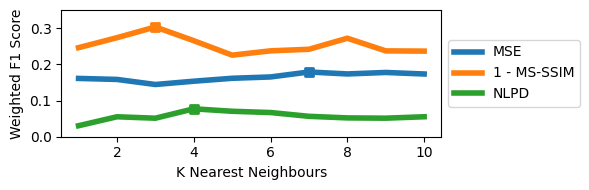

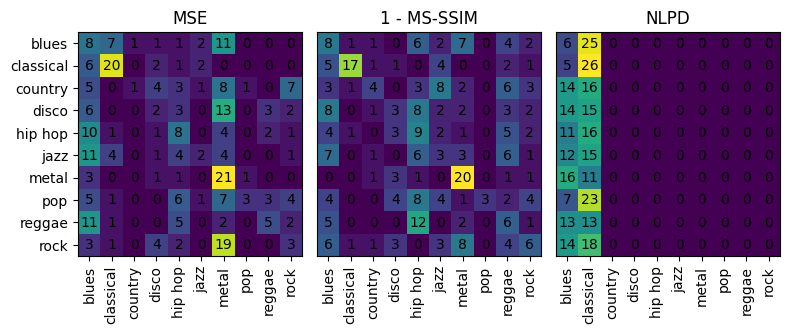

实验结果表明,使用通过感知损失训练的自编码器提取的特征,在音乐流派分类任务上取得了显著的性能提升,优于直接使用感知度量作为距离度量的方法。具体的性能数据和对比基线在论文中进行了详细的展示,证明了该方法的有效性。

🎯 应用场景

该研究成果可应用于音乐推荐系统、音乐信息检索、音乐创作辅助等领域。通过学习更符合人类感知的音乐表征,可以提高音乐推荐的准确性和个性化程度,提升音乐检索的效率,并为音乐创作者提供更智能的工具。

📄 摘要(原文)

The subjective quality of natural signals can be approximated with objective perceptual metrics. Designed to approximate the perceptual behaviour of human observers, perceptual metrics often reflect structures found in natural signals and neurological pathways. Models trained with perceptual metrics as loss functions can capture perceptually meaningful features from the structures held within these metrics. We demonstrate that using features extracted from autoencoders trained with perceptual losses can improve performance on music understanding tasks, i.e. genre classification, over using these metrics directly as distances when learning a classifier. This result suggests improved generalisation to novel signals when using perceptual metrics as loss functions for representation learning.