A Survey of Low-bit Large Language Models: Basics, Systems, and Algorithms

作者: Ruihao Gong, Yifu Ding, Zining Wang, Chengtao Lv, Xingyu Zheng, Jinyang Du, Haotong Qin, Jinyang Guo, Michele Magno, Xianglong Liu

分类: cs.AI, cs.CL, cs.LG

发布日期: 2024-09-25 (更新: 2025-11-12)

备注: Ruihao Gong leads the overall organization of the survey, with Yifu Ding and Jinyang Du contributing to Sections 2 and 3. Xingyu Zheng is responsible for authoring Section 4, while Chengtao Lv and Zining Wang collaborate on Section 5. Haotong Qin, Jinyang Guo, Michele Magno, and Xianglong Liu provide guidance during the whole process and assist in refining the final manuscript

💡 一句话要点

综述低比特大语言模型:基础、系统与算法,助力高效部署。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 低比特量化 大语言模型 模型压缩 量化感知训练 推理加速

📋 核心要点

- 现有大语言模型内存和计算需求高昂,严重阻碍了其在资源受限环境下的部署和应用。

- 本文综述了低比特量化技术,通过降低模型参数、激活值和梯度的比特宽度,有效降低内存占用和计算复杂度。

- 该综述从基础概念、系统实现和算法策略三个维度,全面分析了低比特大语言模型的研究现状和未来趋势。

📝 摘要(中文)

大语言模型(LLMs)在自然语言处理领域取得了显著进展,并在各种任务中展现出卓越的性能。然而,其高昂的内存和计算需求给实际部署带来了重大挑战。低比特量化通过降低模型参数、激活和梯度的比特宽度,从而减少内存使用和计算需求,已成为缓解这些挑战的关键方法。本文全面综述了为LLMs量身定制的低比特量化方法,涵盖了基本原理、系统实现和算法策略。首先介绍了低比特LLMs的基本概念和新的数据格式,然后回顾了促进各种硬件平台上低比特LLMs的框架和系统。接着,我们对LLMs高效低比特训练和推理的技术和工具包进行了分类和分析。最后,我们总结并讨论了低比特LLMs的未来趋势和潜在进展。我们从基础、系统和算法角度进行的系统概述,可以为未来的工作提供有价值的见解和指导,以通过低比特量化提高LLMs的效率和适用性。

🔬 方法详解

问题定义:现有大语言模型参数量巨大,导致内存占用高、计算复杂度高,难以在边缘设备或资源受限的环境中部署。现有的全精度模型在推理和训练时需要大量的计算资源和时间,成本高昂。因此,如何降低大语言模型的资源消耗,使其能够在更广泛的场景下应用,是一个亟待解决的问题。

核心思路:本文的核心思路是利用低比特量化技术,将模型中的参数、激活值以及梯度等数据表示从全精度(如FP32)降低到低精度(如INT8、INT4甚至更低)。通过减少数据表示的比特数,可以显著降低模型的存储空间和计算复杂度,从而提高推理速度和降低能耗。同时,需要设计相应的算法和系统,以保证在低比特量化后,模型性能不会显著下降。

技术框架:该综述首先介绍了低比特量化的基本概念和数据格式,包括定点数表示、量化方法(如线性量化、非线性量化)等。然后,回顾了现有的低比特大语言模型框架和系统,这些框架和系统通常包括量化工具、推理引擎和硬件加速器等组件,用于支持低比特模型的训练和推理。接着,对低比特大语言模型的训练和推理算法进行了分类和分析,包括量化感知训练、训练后量化等方法。最后,对低比特大语言模型的未来发展趋势进行了展望。

关键创新:该综述的关键创新在于对低比特大语言模型进行了全面的梳理和总结,从基础概念、系统实现和算法策略三个维度,系统地介绍了低比特量化的研究现状和未来趋势。与以往的综述相比,本文更加关注低比特量化在大语言模型上的应用,并对相关的技术和工具进行了深入的分析。

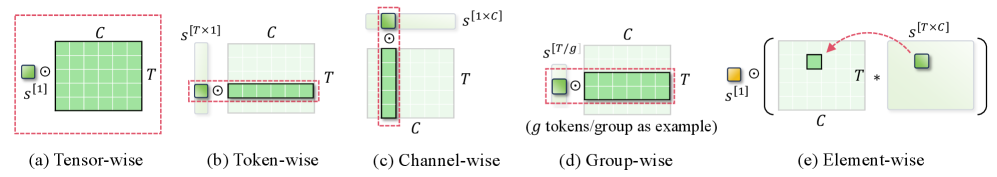

关键设计:在算法层面,关键设计包括:1) 量化策略的选择,如均匀量化、非均匀量化等,不同的量化策略对模型性能和计算复杂度有不同的影响;2) 量化参数的优化,如量化范围、量化步长等,需要根据模型的具体情况进行调整;3) 量化感知训练,通过在训练过程中模拟量化操作,使模型更好地适应低比特表示;4) 混合精度量化,对不同的层或参数采用不同的比特宽度,以在性能和效率之间取得平衡。在系统层面,关键设计包括:1) 高效的推理引擎,能够充分利用硬件加速器,提高低比特模型的推理速度;2) 灵活的量化工具,支持不同的量化策略和数据格式;3) 易于使用的API,方便用户进行低比特模型的开发和部署。

🖼️ 关键图片

📊 实验亮点

该综述总结了当前低比特量化技术在大语言模型上的应用,并分析了各种方法的优缺点。例如,INT8量化可以在保证模型性能基本不变的情况下,将模型大小降低4倍,推理速度提高2-3倍。更低比特的量化(如INT4)可以进一步降低模型大小和提高推理速度,但可能会导致一定的性能损失。该综述还介绍了最新的量化感知训练方法,可以有效缓解低比特量化带来的性能下降。

🎯 应用场景

低比特大语言模型在资源受限的场景下具有广泛的应用前景,例如移动设备、嵌入式系统和边缘计算等。通过降低模型的存储空间和计算复杂度,可以使大语言模型能够在这些设备上运行,从而实现智能化的本地推理和服务。此外,低比特量化还可以降低云计算的成本,提高数据中心的能源效率,具有重要的经济和社会价值。

📄 摘要(原文)

Large language models (LLMs) have achieved remarkable advancements in natural language processing, showcasing exceptional performance across various tasks. However, the expensive memory and computational requirements present significant challenges for their practical deployment. Low-bit quantization has emerged as a critical approach to mitigate these challenges by reducing the bit-width of model parameters, activations, and gradients, thus decreasing memory usage and computational demands. This paper presents a comprehensive survey of low-bit quantization methods tailored for LLMs, covering the fundamental principles, system implementations, and algorithmic strategies. An overview of basic concepts and new data formats specific to low-bit LLMs is first introduced, followed by a review of frameworks and systems that facilitate low-bit LLMs across various hardware platforms. Then, we categorize and analyze techniques and toolkits for efficient low-bit training and inference of LLMs. Finally, we conclude with a discussion of future trends and potential advancements of low-bit LLMs. Our systematic overview from basic, system, and algorithm perspectives can offer valuable insights and guidelines for future works to enhance the efficiency and applicability of LLMs through low-bit quantization.