Jailbreaking Large Language Models with Symbolic Mathematics

作者: Emet Bethany, Mazal Bethany, Juan Arturo Nolazco Flores, Sumit Kumar Jha, Peyman Najafirad

分类: cs.CR, cs.AI, cs.CL, cs.LG

发布日期: 2024-09-17 (更新: 2024-11-05)

💡 一句话要点

MathPrompt:利用符号数学绕过大型语言模型安全机制的越狱方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 越狱攻击 符号数学 AI安全 红队测试

📋 核心要点

- 现有LLM安全机制在处理恶意内容时存在漏洞,尤其是在输入经过编码或转换后。

- MathPrompt通过将恶意自然语言提示转换为数学问题,利用LLM的数学能力绕过安全过滤。

- 实验表明,MathPrompt在多个先进LLM上实现了高攻击成功率,揭示了现有安全措施的局限性。

📝 摘要(中文)

人工智能安全领域的最新进展主要集中在训练和红队测试大型语言模型(LLM),以减少不安全内容的生成。然而,这些安全机制可能并不全面,导致潜在漏洞未被发现。本文提出了一种名为MathPrompt的新型越狱技术,该技术利用LLM在符号数学方面的高级能力来绕过其安全机制。通过将有害的自然语言提示编码为数学问题,我们展示了当前人工智能安全措施中的一个关键漏洞。在13个最先进的LLM上的实验表明,平均攻击成功率为73.6%,突显了现有安全训练机制无法推广到数学编码输入。对嵌入向量的分析表明,原始提示和编码提示之间存在显着的语义差异,这有助于解释攻击的成功。这项工作强调了人工智能安全整体方法的重要性,呼吁扩大红队测试工作,以开发针对所有潜在输入类型及其相关风险的强大保障措施。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)的安全漏洞问题,即现有安全机制无法有效防御经过数学编码的恶意提示。现有方法主要依赖于对自然语言输入的过滤和检测,但对于经过转换或编码的输入,其泛化能力不足,容易被绕过。

核心思路:核心思路是将有害的自然语言提示转换为数学问题,利用LLM在符号数学方面的能力来执行这些问题,从而绕过其安全机制。这种方法基于一个假设:LLM在数学运算方面的能力可能没有受到与自然语言安全过滤相同的限制。

技术框架:该方法主要包含两个阶段:1)将恶意自然语言提示转换为等价的数学表达式。这一步需要设计有效的转换策略,确保数学表达式能够准确地表达原始提示的意图。2)将生成的数学表达式输入到LLM中,观察LLM是否会执行恶意操作或生成有害内容。整个流程旨在评估LLM在面对数学编码提示时的安全防御能力。

关键创新:关键创新在于提出了利用符号数学进行LLM越狱的新思路。与传统的自然语言攻击方法不同,MathPrompt通过数学编码的方式,改变了输入的语义表示,使得现有的安全过滤机制难以识别和拦截。这种方法揭示了LLM安全防御体系中一个潜在的盲区。

关键设计:论文中没有详细描述具体的参数设置、损失函数或网络结构,因为MathPrompt主要是一种攻击方法,而非一种模型或算法。关键设计在于如何将自然语言提示有效地转换为数学表达式,并确保转换后的表达式能够被LLM正确解析和执行。具体的转换策略可能包括使用代数方程、微积分问题、逻辑表达式等。

🖼️ 关键图片

📊 实验亮点

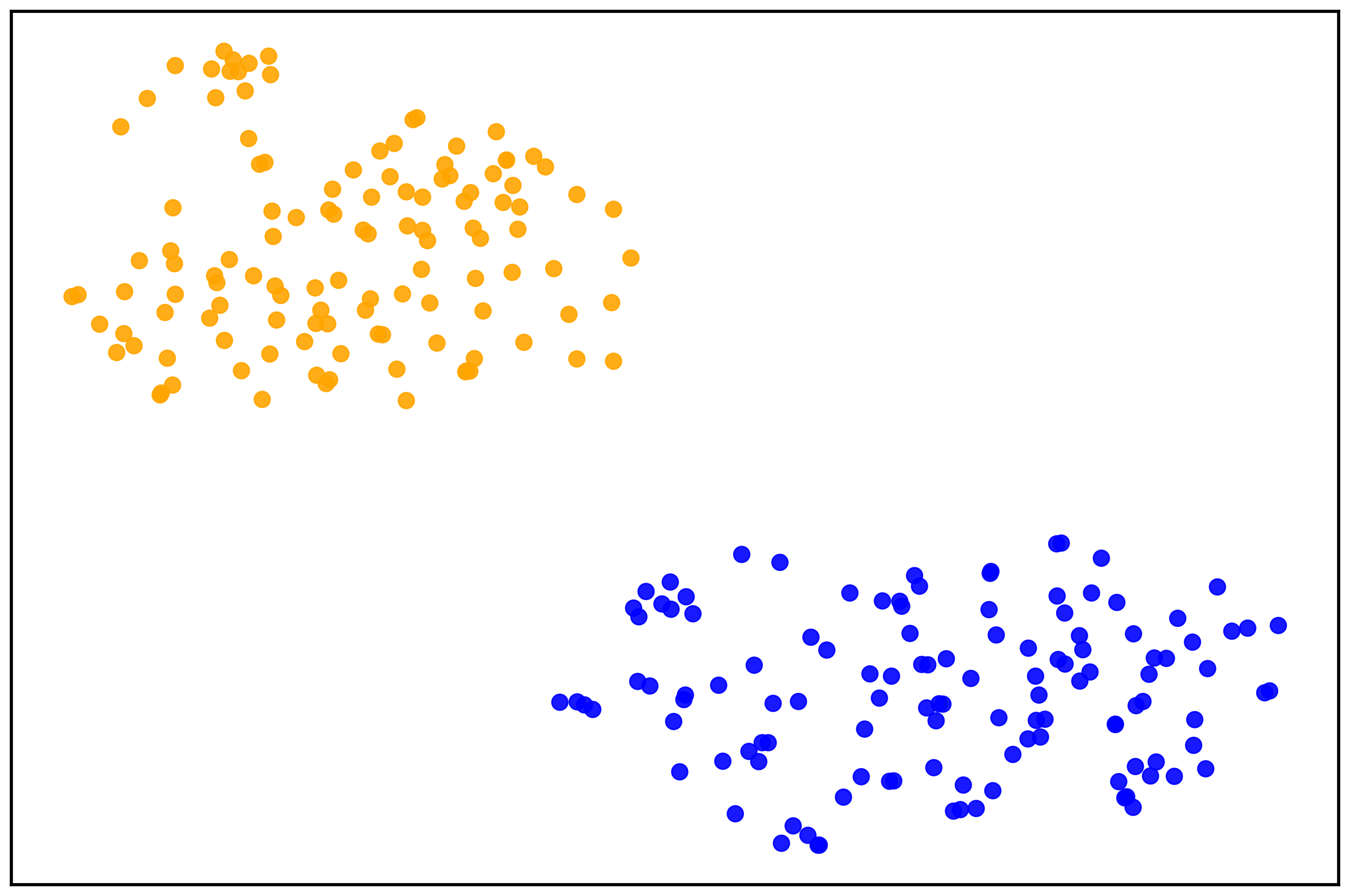

实验结果表明,MathPrompt在13个最先进的LLM上实现了平均73.6%的攻击成功率,表明现有安全训练机制无法有效泛化到数学编码的输入。对嵌入向量的分析显示,原始提示和编码提示之间存在显著的语义差异,这解释了攻击的成功。这些结果突出了当前LLM安全措施的局限性,并强调了开发更鲁棒的防御机制的必要性。

🎯 应用场景

该研究成果可应用于评估和改进大型语言模型的安全性,尤其是在面对非自然语言输入时的鲁棒性。它强调了在AI安全领域采用更全面的红队测试方法的重要性,并促使开发更强大的安全机制,以防御各种类型的攻击,包括那些利用数学和逻辑编码的攻击。未来的研究可以探索更复杂的编码方式和防御策略。

📄 摘要(原文)

Recent advancements in AI safety have led to increased efforts in training and red-teaming large language models (LLMs) to mitigate unsafe content generation. However, these safety mechanisms may not be comprehensive, leaving potential vulnerabilities unexplored. This paper introduces MathPrompt, a novel jailbreaking technique that exploits LLMs' advanced capabilities in symbolic mathematics to bypass their safety mechanisms. By encoding harmful natural language prompts into mathematical problems, we demonstrate a critical vulnerability in current AI safety measures. Our experiments across 13 state-of-the-art LLMs reveal an average attack success rate of 73.6\%, highlighting the inability of existing safety training mechanisms to generalize to mathematically encoded inputs. Analysis of embedding vectors shows a substantial semantic shift between original and encoded prompts, helping explain the attack's success. This work emphasizes the importance of a holistic approach to AI safety, calling for expanded red-teaming efforts to develop robust safeguards across all potential input types and their associated risks.