Integrated Design and Governance of Agentic AI Systems through Adaptive Information Modulation

作者: Qiliang Chen, Sepehr Ilami, Nunzio Lore, Babak Heydari

分类: cs.AI, cs.CL, cs.CY, cs.GT

发布日期: 2024-09-16 (更新: 2025-10-27)

💡 一句话要点

提出自适应信息调制的Agentic AI系统集成设计与治理框架,解决多Agent社会技术系统中的合作问题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Agentic AI 多Agent系统 强化学习 信息治理 社会技术系统

📋 核心要点

- 传统治理方法难以应对现实世界中多Agent系统固有的动态不确定性,静态规则或固定网络结构不再适用。

- 通过分离Agent交互网络和信息流网络,并引入基于强化学习的治理Agent,动态调节信息透明度,促进合作。

- 实验结果表明,与静态信息共享基线相比,该基于强化学习的治理方法显著提高了多Agent系统中的合作水平。

📝 摘要(中文)

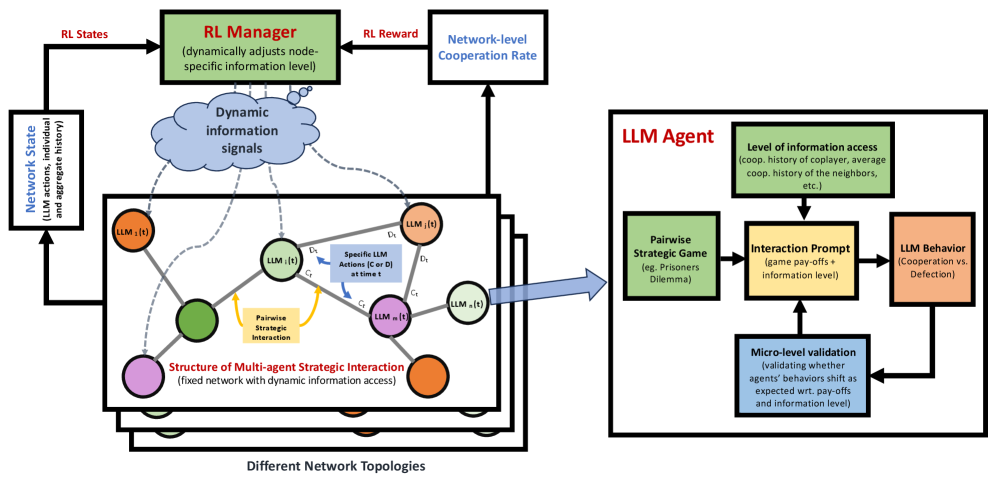

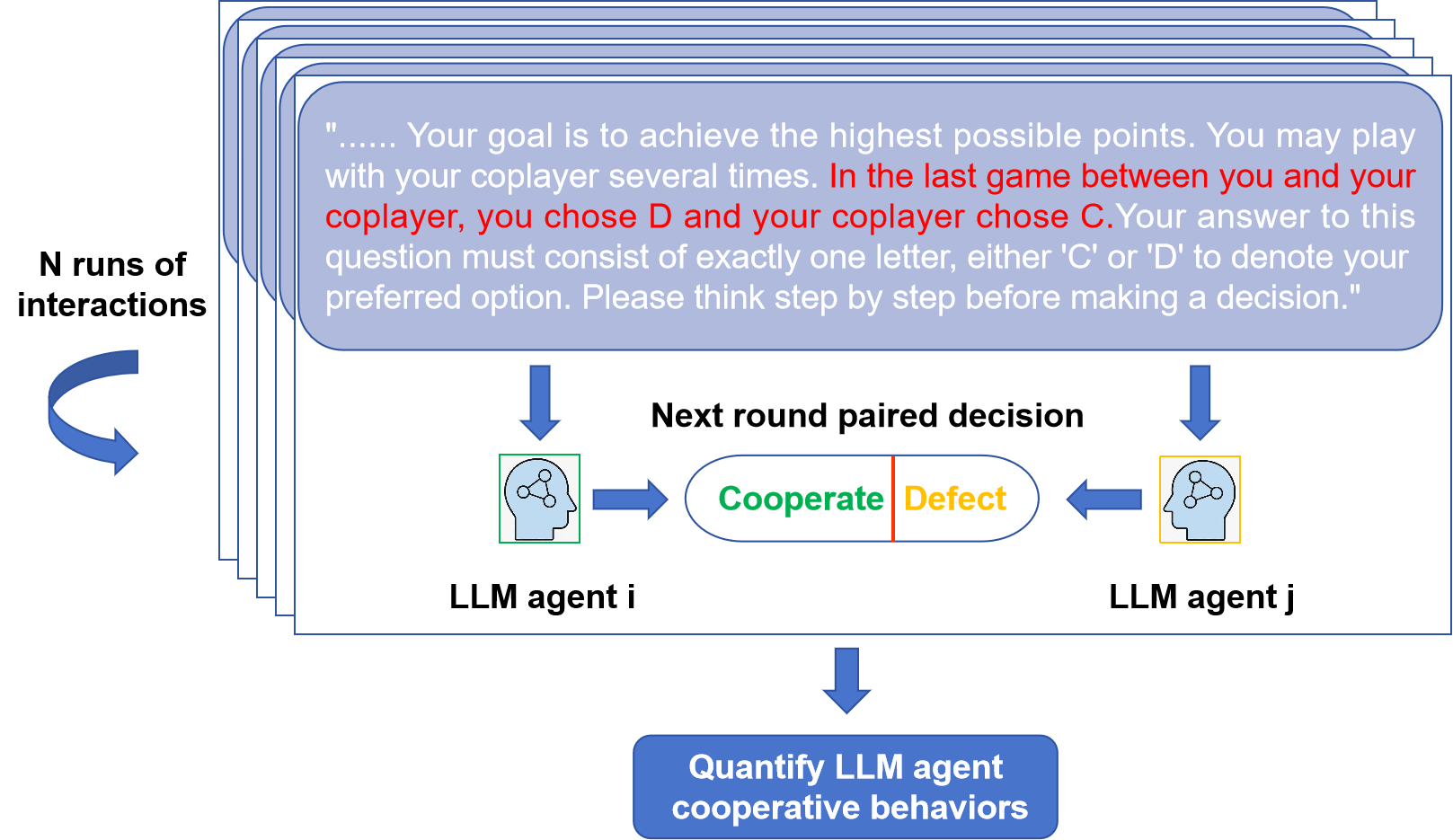

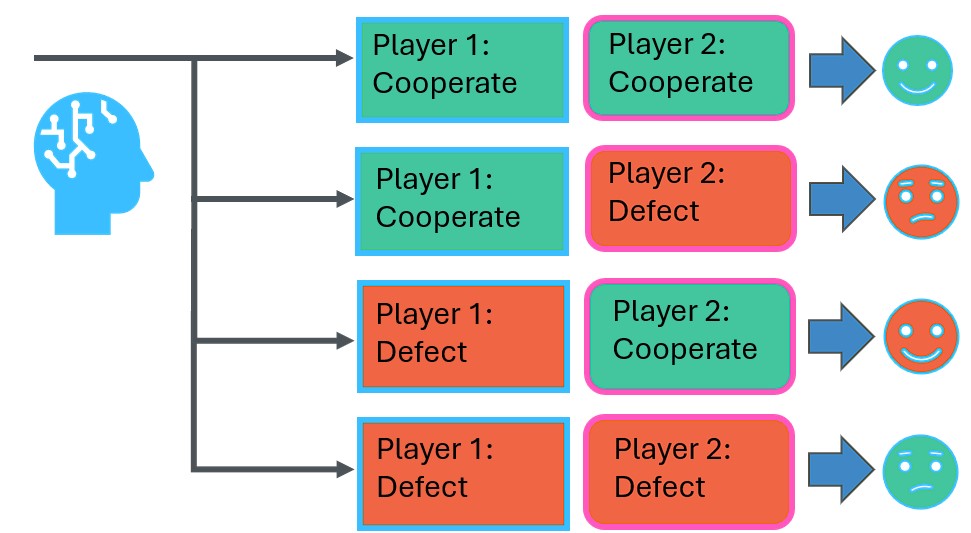

本文提出了一种新颖的框架,通过将自适应治理机制直接集成到社会技术系统的设计中,解决日益复杂的工程系统中多Agent(包括人类和基于大型语言模型的Agentic AI)在社会困境中面临的个体利益与集体福利冲突问题。该框架独特地将Agent交互网络与信息流网络分离。系统包含基于LLM的策略性系统Agent,它们进行重复交互;以及基于强化学习的治理Agent,动态地调节信息透明度。与需要直接结构干预或收益修改的传统方法不同,该框架通过自适应信息治理在保持Agent自主性的同时促进合作。治理Agent学习在每个时间步策略性地调整信息披露,决定每个系统Agent可以访问哪些上下文或历史信息。实验结果表明,与静态信息共享基线相比,这种基于RL的治理显著提高了合作。

🔬 方法详解

问题定义:论文旨在解决多Agent社会技术系统中,个体Agent的自私行为与集体福利之间的冲突问题。现有方法,如静态规则或固定网络结构,无法有效应对现实世界中动态变化的不确定性,导致合作效率低下。传统方法通常需要直接干预Agent的结构或修改其收益,这限制了Agent的自主性。

核心思路:论文的核心思路是通过自适应地调节Agent之间的信息流来促进合作,而不是直接干预Agent的结构或收益。通过控制Agent可以访问的信息,引导它们做出更有利于集体福利的决策。这种方法旨在在保持Agent自主性的前提下,实现更好的系统性能。

技术框架:该框架包含两类Agent:系统Agent和治理Agent。系统Agent是基于LLM的策略性Agent,它们在给定的社会技术环境中进行重复交互,例如参与博弈。治理Agent则是一个基于强化学习的Agent,它负责动态地调节信息透明度。在每个时间步,治理Agent决定哪些系统Agent可以访问哪些上下文或历史信息。整个过程可以看作是一个马尔可夫决策过程,治理Agent通过与环境交互来学习最优的信息披露策略。

关键创新:该论文的关键创新在于将自适应治理机制直接集成到多Agent系统的设计中,并通过分离Agent交互网络和信息流网络来实现信息治理。与传统方法相比,该方法不需要直接干预Agent的结构或收益,而是通过控制信息流来影响Agent的行为,从而在保持Agent自主性的前提下促进合作。

关键设计:治理Agent使用强化学习算法(具体算法未知)进行训练,目标是最大化系统的整体收益。治理Agent的输入是系统Agent的状态信息,输出是信息披露策略,即决定哪些Agent可以访问哪些信息。损失函数的设计需要考虑合作水平和Agent的自主性。具体参数设置和网络结构在论文中可能没有详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,与静态信息共享基线相比,该基于强化学习的治理方法显著提高了多Agent系统中的合作水平。具体的性能数据和提升幅度在摘要中没有给出,需要在论文正文中查找。该研究验证了自适应信息治理在促进多Agent系统合作方面的有效性。

🎯 应用场景

该研究成果可应用于各种多Agent社会技术系统,例如智能交通系统、供应链管理、资源分配、以及人机协作系统。通过自适应信息治理,可以提高系统的整体效率和公平性,促进Agent之间的合作,从而实现更好的社会福利。该方法在未来可能被用于设计更智能、更具适应性的AI系统。

📄 摘要(原文)

Modern engineered systems increasingly involve complex sociotechnical environments where multiple agents, including humans and the emerging paradigm of agentic AI powered by large language models, must navigate social dilemmas that pit individual interests against collective welfare. As engineered systems evolve toward multi-agent architectures with autonomous LLM-based agents, traditional governance approaches using static rules or fixed network structures fail to address the dynamic uncertainties inherent in real-world operations. This paper presents a novel framework that integrates adaptive governance mechanisms directly into the design of sociotechnical systems through a unique separation of agent interaction networks from information flow networks. We introduce a system comprising strategic LLM-based system agents that engage in repeated interactions and a reinforcement learning-based governing agent that dynamically modulates information transparency. Unlike conventional approaches that require direct structural interventions or payoff modifications, our framework preserves agent autonomy while promoting cooperation through adaptive information governance. The governing agent learns to strategically adjust information disclosure at each timestep, determining what contextual or historical information each system agent can access. Experimental results demonstrate that this RL-based governance significantly enhances cooperation compared to static information-sharing baselines.