Propaganda is all you need

作者: Paul Kronlund-Drouault

分类: cs.CY, cs.AI

发布日期: 2024-09-13 (更新: 2025-04-01)

💡 一句话要点

揭示大型语言模型政治倾向:对齐过程中的意识形态偏见分析

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 政治偏见 对齐过程 意识形态 嵌入空间

📋 核心要点

- 现有研究较少关注大型语言模型对齐过程中的政治维度,忽略了其潜在的意识形态偏见。

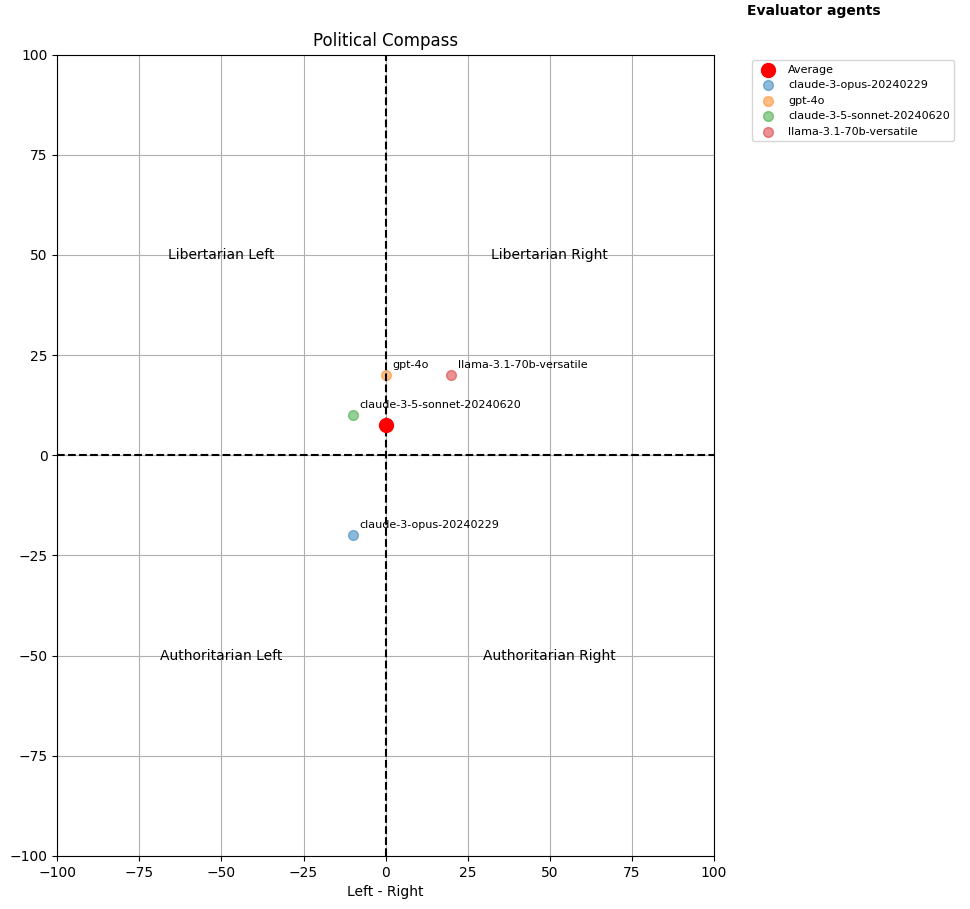

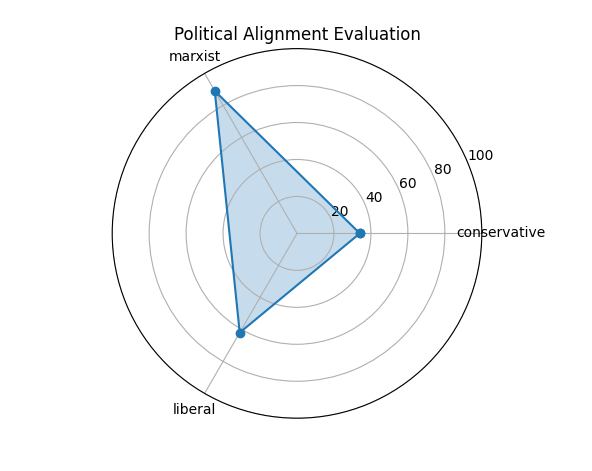

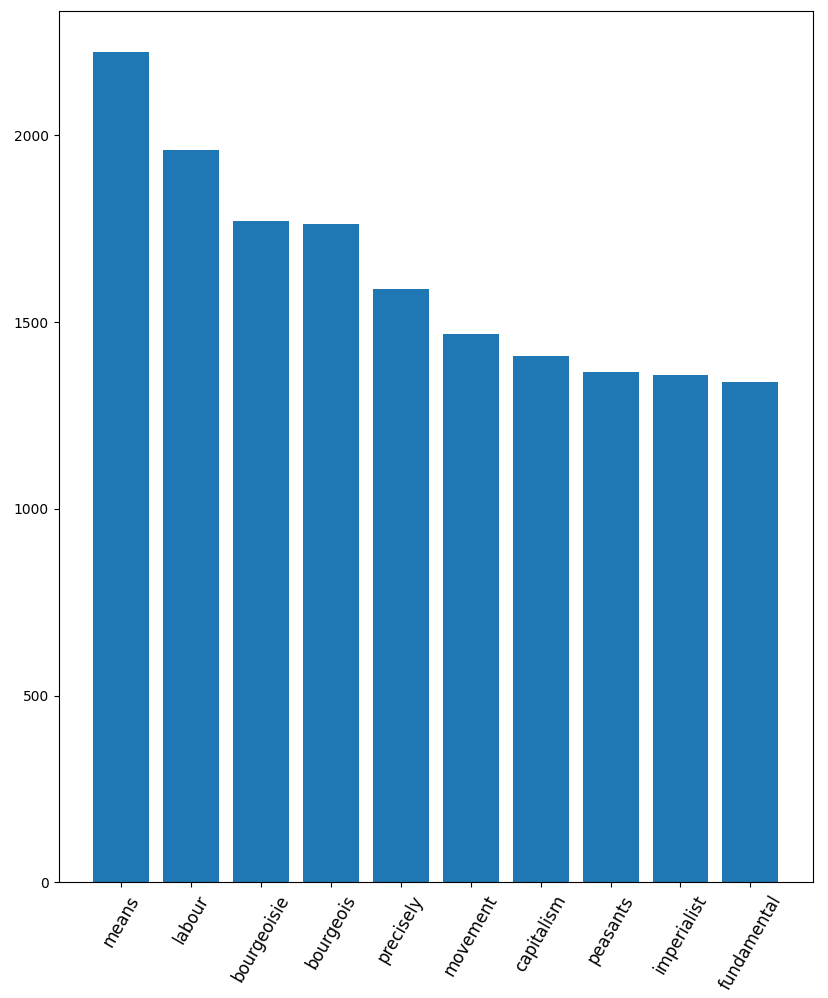

- 该研究旨在分析政治导向的对齐如何影响LLM的嵌入空间,以及政治概念的相对位置。

- 通过社会政治视角,假设大型LLM与“主导意识形态”对齐,并探讨其对社会变革的潜在影响。

📝 摘要(中文)

由于机器学习(ML)仍然是一个新兴领域,尤其是在抽象数学和计算机科学之外,关于大型语言模型(LLM)的政治方面,特别是关于对齐过程及其政治维度的研究还很少。这个过程可以简单到提示工程,但也可能非常复杂,并影响完全不相关的概念。例如,政治导向的对齐对LLM的嵌入空间以及政治概念在该空间中的相对位置有非常强烈的影响。通过使用特殊工具来评估一般的政治偏见并分析对齐的影响,我们可以收集新的数据来理解其原因以及对社会可能造成的后果。事实上,通过采取社会政治方法,我们可以假设大多数大型LLM都与马克思主义哲学中所谓的“主导意识形态”对齐。由于人工智能在政治决策中的作用,无论是在公民层面还是在政府机构中,这种偏见都可能对社会变革产生巨大影响,要么为社会统一创造新的隐蔽途径,要么允许伪装的极端主义观点在人们中获得吸引力。

🔬 方法详解

问题定义:该论文旨在解决大型语言模型(LLM)在对齐过程中可能存在的政治偏见问题。现有方法主要集中在技术层面,例如提高生成文本的流畅性和一致性,而忽略了对齐过程可能引入的意识形态偏见,以及这些偏见对社会可能造成的潜在影响。现有方法缺乏对LLM政治倾向的有效评估和分析工具。

核心思路:该论文的核心思路是从社会政治的角度出发,分析LLM的对齐过程,并假设LLM与“主导意识形态”对齐。通过分析LLM的嵌入空间,揭示政治概念之间的关系,从而评估LLM的政治倾向。这种思路强调了技术与社会之间的相互作用,并关注了技术可能带来的社会影响。

技术框架:该论文的技术框架主要包括以下几个阶段:1. 使用特殊工具评估LLM的一般政治偏见;2. 分析对齐过程对LLM嵌入空间的影响;3. 收集数据以理解偏见的原因和可能的社会后果;4. 从社会政治角度分析LLM与“主导意识形态”的对齐情况。具体的技术细节(例如使用的工具、分析方法等)在摘要中没有详细说明,属于未知信息。

关键创新:该论文的关键创新在于其研究视角,即从社会政治的角度分析LLM的对齐过程。与以往主要关注技术层面的研究不同,该论文强调了技术与社会之间的相互作用,并关注了技术可能带来的社会影响。这种研究视角有助于更全面地理解LLM的潜在风险和挑战。

关键设计:由于摘要中没有提供关于具体技术细节的信息,例如参数设置、损失函数、网络结构等,因此这部分内容属于未知信息。

🖼️ 关键图片

📊 实验亮点

由于论文摘要侧重于概念和方法论,并未提供具体的实验结果或性能数据,因此无法总结实验亮点。摘要强调了对齐过程对LLM嵌入空间的影响,以及政治概念在其中的相对位置变化,但缺乏量化分析。

🎯 应用场景

该研究的潜在应用领域包括:评估和纠正LLM中的政治偏见,提高LLM的透明度和可解释性,以及开发更负责任和符合伦理规范的人工智能系统。该研究的实际价值在于帮助人们更好地理解LLM的潜在风险和挑战,并为开发更安全、可靠和公正的人工智能系统提供指导。未来,该研究可以促进人工智能技术的健康发展,并为构建更公平、公正的社会做出贡献。

📄 摘要(原文)

As Machine Learning (ML) is still a recent field of study, especially outside the realm of abstract Mathematics and Computer Science, few works have been conducted on the political aspect of large Language Models (LLMs), and more particularly about the alignment process and its political dimension. This process can be as simple as prompt engineering but is also very complex and can affect completely unrelated notions. For example, politically directed alignment has a very strong impact on an LLM's embedding space and the relative position of political notions in such a space. Using special tools to evaluate general political bias and analyze the effects of alignment, we can gather new data to understand its causes and possible consequences on society. Indeed, by taking a socio-political approach, we can hypothesize that most big LLMs are aligned with what Marxist philosophy calls the 'dominant ideology.' As AI's role in political decision-making, at the citizen's scale but also in government agencies, such biases can have huge effects on societal change, either by creating new and insidious pathways for societal uniformity or by allowing disguised extremist views to gain traction among the people.