Multimodal Fusion with LLMs for Engagement Prediction in Natural Conversation

作者: Cheng Charles Ma, Kevin Hyekang Joo, Alexandria K. Vail, Sunreeta Bhattacharya, Álvaro Fernández García, Kailana Baker-Matsuoka, Sheryl Mathew, Lori L. Holt, Fernando De la Torre

分类: cs.AI, cs.CL, cs.HC, cs.LG

发布日期: 2024-09-13

备注: 22 pages, first three authors equal contribution

💡 一句话要点

提出基于LLM的多模态融合方法,用于自然对话中参与度预测

🎯 匹配领域: 支柱五:交互与反应 (Interaction & Reaction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态融合 大型语言模型 参与度预测 自然对话 智能眼镜

📋 核心要点

- 现有方法难以有效融合自然对话中的多模态信息,从而限制了参与度预测的准确性。

- 利用大型语言模型(LLM)将多种行为模态融合为多模态文本记录,实现对人类行为的推理。

- 初步实验结果表明,该方法在参与度预测方面达到了与传统融合技术相当的性能,具有巨大潜力。

📝 摘要(中文)

过去十年,可穿戴计算设备(如智能眼镜)在传感器技术、设计和处理能力方面取得了显著进步,为高密度人类行为数据开辟了新纪元。配备可穿戴摄像头的智能眼镜为分析自然场景中个体互动时的非语言行为提供了独特的机会。本文侧重于通过分析言语和非言语线索来预测二元互动中的参与度,旨在检测不感兴趣或困惑的迹象。此类分析可能彻底改变我们对人类交流的理解,促进专业环境中更有效的协作,通过共情的虚拟互动提供更好的心理健康支持,并增强有沟通障碍人士的可访问性。本文收集了一个包含34名参与者的休闲二元对话数据集,每个参与者在每次对话结束时提供自我报告的参与度评分。我们引入了一种新颖的融合策略,使用大型语言模型(LLM)将多种行为模式整合到“多模态文本记录”中,该记录可由LLM处理以进行行为推理任务。值得注意的是,即使在初步实现中,该方法也达到了与已建立的融合技术相当的性能,表明了进一步研究和优化的强大潜力。这种融合方法是首批通过语言模型来“推理”现实世界人类行为的方法之一。智能眼镜使我们能够不引人注目地收集关于人类行为的高密度多模态数据,为理解和改善人类交流的新方法铺平了道路,并具有重要的社会效益。研究期间收集的特征和数据将公开提供,以促进进一步研究。

🔬 方法详解

问题定义:论文旨在解决自然对话场景中参与度预测的问题。现有方法在融合来自不同模态(例如语音、视觉)的信息时存在困难,难以充分利用非语言行为线索,导致预测精度受限。此外,缺乏能够有效推理人类行为的通用框架。

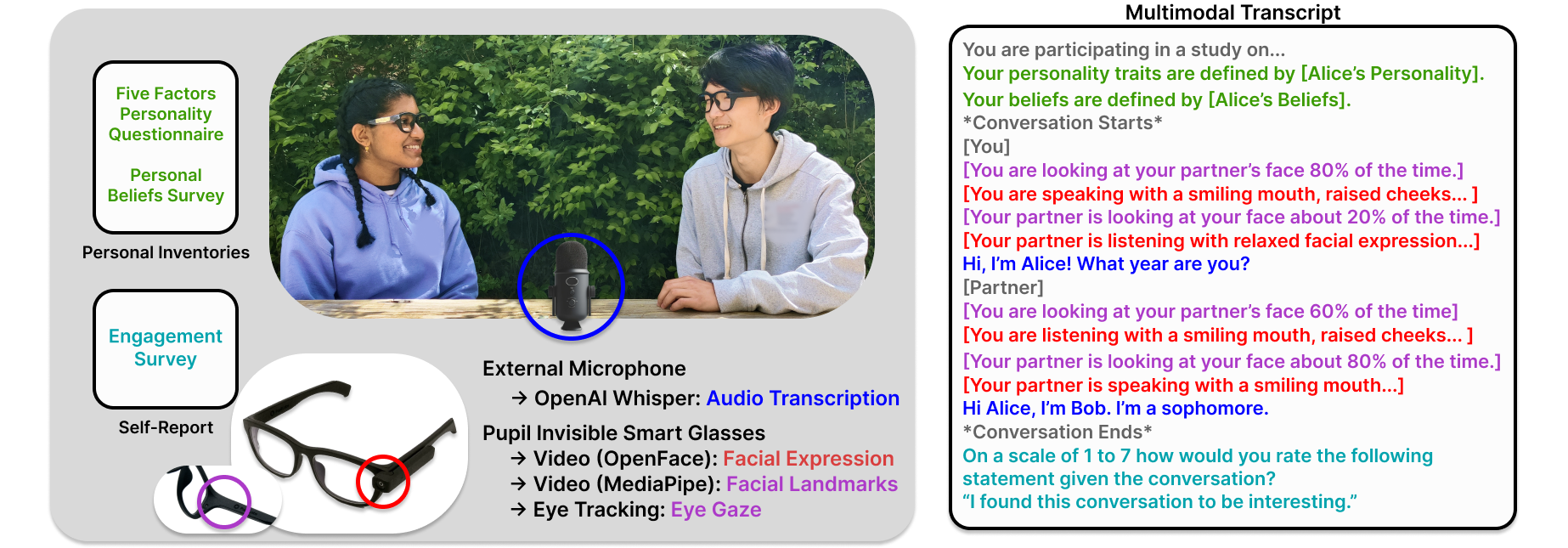

核心思路:论文的核心思路是利用大型语言模型(LLM)的强大语言理解和推理能力,将不同模态的信息转化为LLM可以处理的文本形式,即“多模态文本记录”。通过这种方式,LLM可以对人类行为进行推理,从而提高参与度预测的准确性。

技术框架:整体框架包含以下几个主要阶段:1) 数据采集:使用智能眼镜等设备收集参与者在自然对话中的多模态数据(例如语音、视频)。2) 特征提取:从不同模态的数据中提取相关特征(例如语音特征、面部表情特征)。3) 多模态融合:将提取的特征输入LLM,生成多模态文本记录。4) 参与度预测:使用LLM对多模态文本记录进行分析,预测参与者的参与度。

关键创新:最重要的技术创新点在于使用LLM进行多模态融合和行为推理。与传统的融合方法相比,该方法能够更好地利用LLM的语言理解能力,从而更准确地捕捉人类行为的细微差别。此外,该方法提供了一个通用的框架,可以方便地扩展到其他行为分析任务。

关键设计:论文中没有详细描述具体的参数设置、损失函数或网络结构。但是,可以推断,LLM的选择和微调是关键的设计因素。此外,如何有效地将不同模态的特征转化为LLM可以理解的文本形式也是一个重要的设计考虑。

🖼️ 关键图片

📊 实验亮点

该研究初步实验结果表明,基于LLM的多模态融合方法在参与度预测方面达到了与传统融合技术相当的性能。这表明该方法具有巨大的潜力,可以通过进一步的研究和优化来显著提高参与度预测的准确性。此外,该研究公开了收集的数据集,为相关领域的研究提供了宝贵的资源。

🎯 应用场景

该研究成果可应用于多个领域,例如:改善人机交互,使虚拟助手更具同理心;提升在线教育质量,根据学生的参与度调整教学策略;辅助心理健康评估,通过分析患者的言语和非言语行为来识别潜在问题;增强沟通障碍人士的交流能力。

📄 摘要(原文)

Over the past decade, wearable computing devices (

smart glasses'') have undergone remarkable advancements in sensor technology, design, and processing power, ushering in a new era of opportunity for high-density human behavior data. Equipped with wearable cameras, these glasses offer a unique opportunity to analyze non-verbal behavior in natural settings as individuals interact. Our focus lies in predicting engagement in dyadic interactions by scrutinizing verbal and non-verbal cues, aiming to detect signs of disinterest or confusion. Leveraging such analyses may revolutionize our understanding of human communication, foster more effective collaboration in professional environments, provide better mental health support through empathetic virtual interactions, and enhance accessibility for those with communication barriers. In this work, we collect a dataset featuring 34 participants engaged in casual dyadic conversations, each providing self-reported engagement ratings at the end of each conversation. We introduce a novel fusion strategy using Large Language Models (LLMs) to integrate multiple behavior modalities into amultimodal transcript'' that can be processed by an LLM for behavioral reasoning tasks. Remarkably, this method achieves performance comparable to established fusion techniques even in its preliminary implementation, indicating strong potential for further research and optimization. This fusion method is one of the first to approach ``reasoning'' about real-world human behavior through a language model. Smart glasses provide us the ability to unobtrusively gather high-density multimodal data on human behavior, paving the way for new approaches to understanding and improving human communication with the potential for important societal benefits. The features and data collected during the studies will be made publicly available to promote further research.