Early Joint Learning of Emotion Information Makes MultiModal Model Understand You Better

作者: Mengying Ge, Mingyang Li, Dongkai Tang, Pengbo Li, Kuo Liu, Shuhao Deng, Songbai Pu, Long Liu, Yang Song, Tao Zhang

分类: cs.MM, cs.AI, cs.SD, eess.AS

发布日期: 2024-09-12

💡 一句话要点

提出基于早期联合学习的多模态情感识别模型,提升噪声和数据不足场景性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态情感识别 早期融合 大型语言模型 语音源分离 数据挖掘 模态竞争 MER2024

📋 核心要点

- 现有方法在多模态情感识别中存在音频和文本模态竞争问题,影响模型性能。

- 采用基于大型语言模型的早期融合策略,联合训练音频和文本,缓解模态竞争。

- 通过多轮多模型投票进行数据挖掘,并使用语音源分离预处理音频,提升模型鲁棒性。

📝 摘要(中文)

本文提出了针对多模态情感识别挑战赛(MER2024)的情感识别解决方案。为了缓解音频和文本之间的模态竞争问题,我们采用了一种基于大型语言模型的早期融合策略,首先对音频和文本进行联合训练。然后,将联合的音频-文本模态特征与其他单模态特征进行后期融合。为了解决数据不足和类别不平衡的问题,我们使用多轮多模型投票进行数据挖掘。此外,为了提高音频特征的质量,我们采用语音源分离来预处理音频。我们的模型在MER2024-SEMI和MER2024-NOISE中均排名第二,验证了我们方法的有效性。

🔬 方法详解

问题定义:论文旨在解决多模态情感识别任务中,音频和文本模态之间存在的竞争问题。现有方法在处理此类问题时,往往无法充分利用跨模态信息,导致模型性能下降,尤其是在数据量不足或存在噪声的情况下。

核心思路:论文的核心思路是采用早期融合策略,即在模型训练初期就将音频和文本信息进行联合学习,从而使模型能够更好地理解两种模态之间的关联性,缓解模态竞争。同时,利用数据挖掘和音频预处理技术来增强模型的鲁棒性。

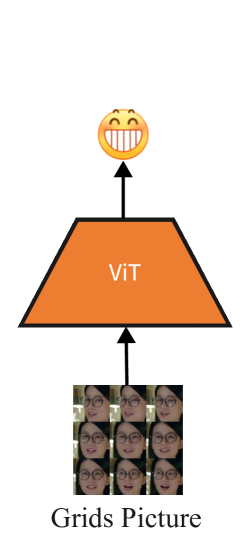

技术框架:整体框架包含以下几个主要阶段:1) 音频预处理:使用语音源分离技术提高音频质量。2) 早期融合:基于大型语言模型,联合训练音频和文本特征。3) 特征融合:将联合的音频-文本特征与其他单模态特征进行后期融合。4) 数据增强:采用多轮多模型投票进行数据挖掘,解决数据不足和类别不平衡问题。

关键创新:最重要的技术创新点在于早期融合策略的应用,通过在训练初期就将音频和文本信息进行融合,使得模型能够更好地学习跨模态信息,从而有效缓解模态竞争。此外,结合数据挖掘和音频预处理技术,进一步提升了模型的性能和鲁棒性。

关键设计:论文采用大型语言模型作为基础架构,具体使用的模型结构和参数设置未知。损失函数的设计也未知,但可能考虑了类别不平衡问题。多轮多模型投票的具体实现细节也未知,但其目的是为了挖掘更多有价值的数据。

🖼️ 关键图片

📊 实验亮点

该模型在MER2024-SEMI和MER2024-NOISE两个子挑战中均排名第二,证明了其在半监督学习和噪声环境下的有效性。具体性能提升幅度未知,但排名结果表明该方法优于其他参赛方案,具有较强的竞争力。

🎯 应用场景

该研究成果可应用于智能客服、情感聊天机器人、心理健康监测等领域。通过准确识别用户的情感状态,可以提供更个性化、更贴心的服务。未来,该技术有望在人机交互、医疗健康等领域发挥重要作用,提升用户体验和生活质量。

📄 摘要(原文)

In this paper, we present our solutions for emotion recognition in the sub-challenges of Multimodal Emotion Recognition Challenge (MER2024). To mitigate the modal competition issue between audio and text, we adopt an early fusion strategy based on a large language model, where joint training of audio and text is conducted initially. And the joint Audio-Text modal feature will be late-fused with other unimodal features. In order to solve the problems of data insufficiency and class imbalance, We use multiple turns of multi-model voting for data mining. Moreover, to enhance the quality of audio features, we employ speech source separation to preprocess audios. Our model ranks \textbf{2nd} in both MER2024-SEMI and MER2024-NOISE, validating our method's effectiveness.