"My Grade is Wrong!": A Contestable AI Framework for Interactive Feedback in Evaluating Student Essays

作者: Shengxin Hong, Chang Cai, Sixuan Du, Haiyue Feng, Siyuan Liu, Xiuyi Fan

分类: cs.AI, cs.HC

发布日期: 2024-09-11

💡 一句话要点

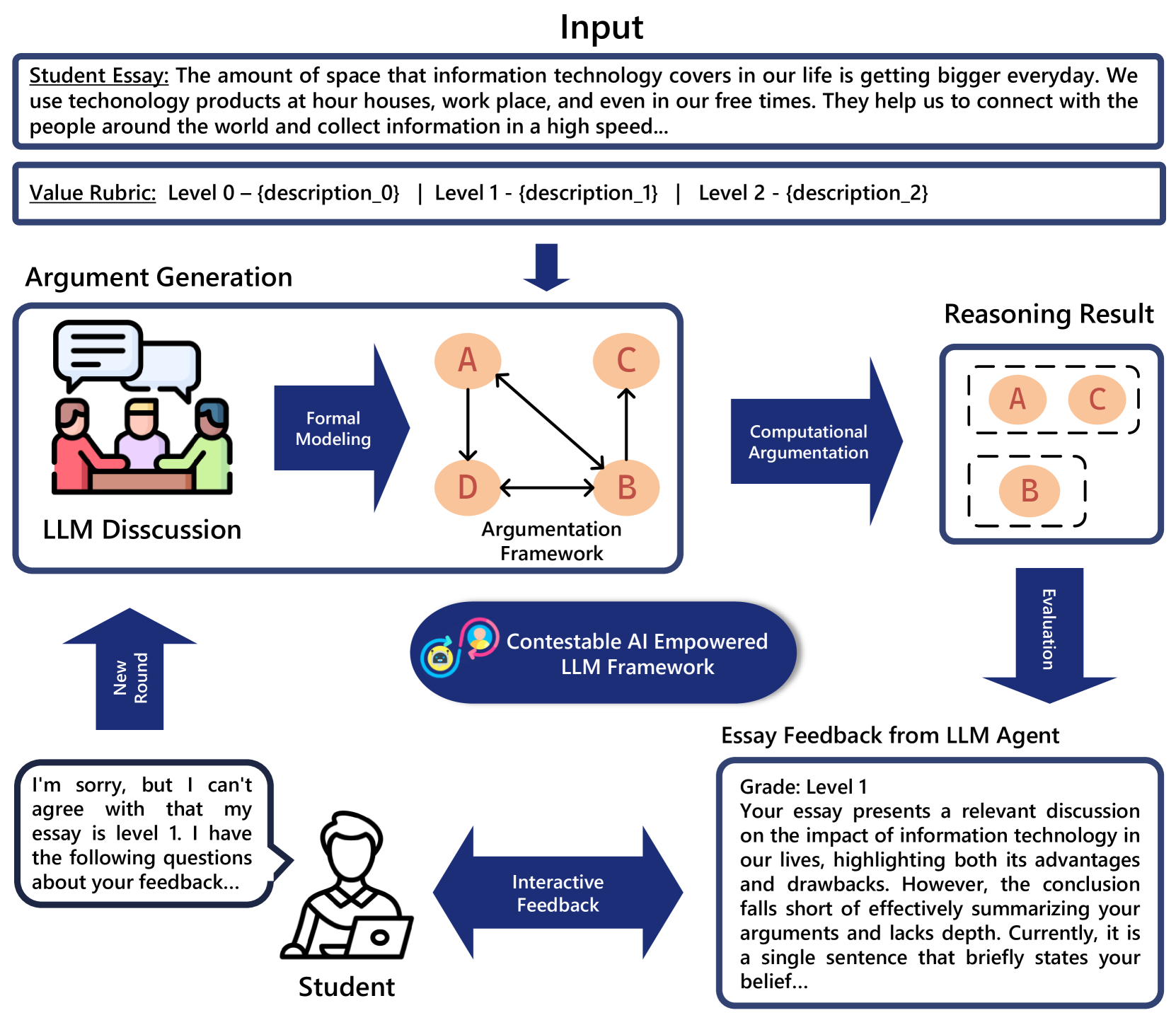

提出CAELF框架,利用可辩论AI提升LLM在学生论文评估中的交互式反馈效果

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 交互式反馈 大型语言模型 可辩论AI 多智能体系统 计算论证

📋 核心要点

- 现有交互式反馈因耗时而难以广泛应用,LLM虽有潜力,但在交互推理上存在不足。

- CAELF框架通过多智能体系统和计算论证,使学生能质疑和澄清反馈,提升理解。

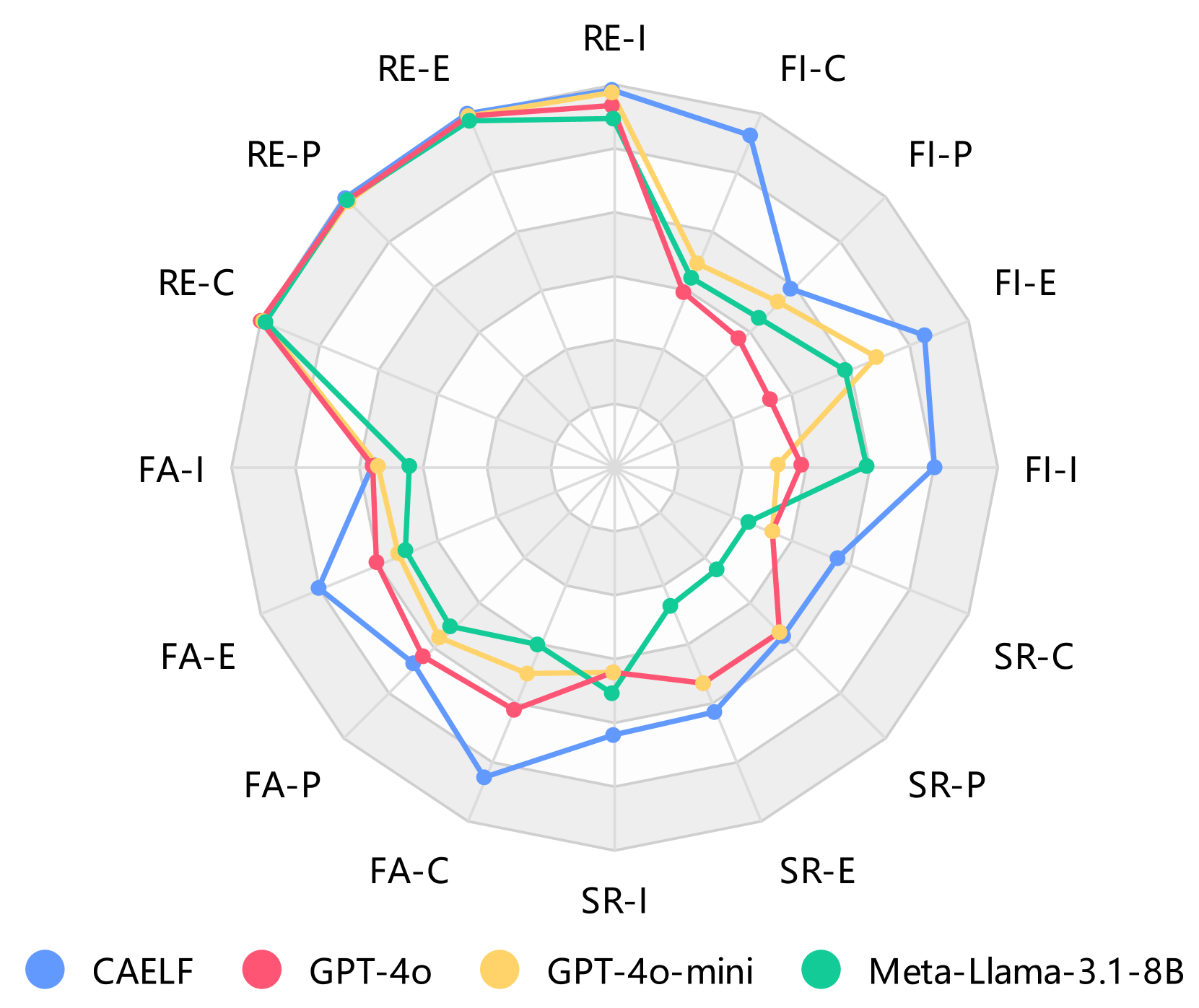

- 实验表明,CAELF显著改善了交互式反馈,增强了LLM的推理和交互能力。

📝 摘要(中文)

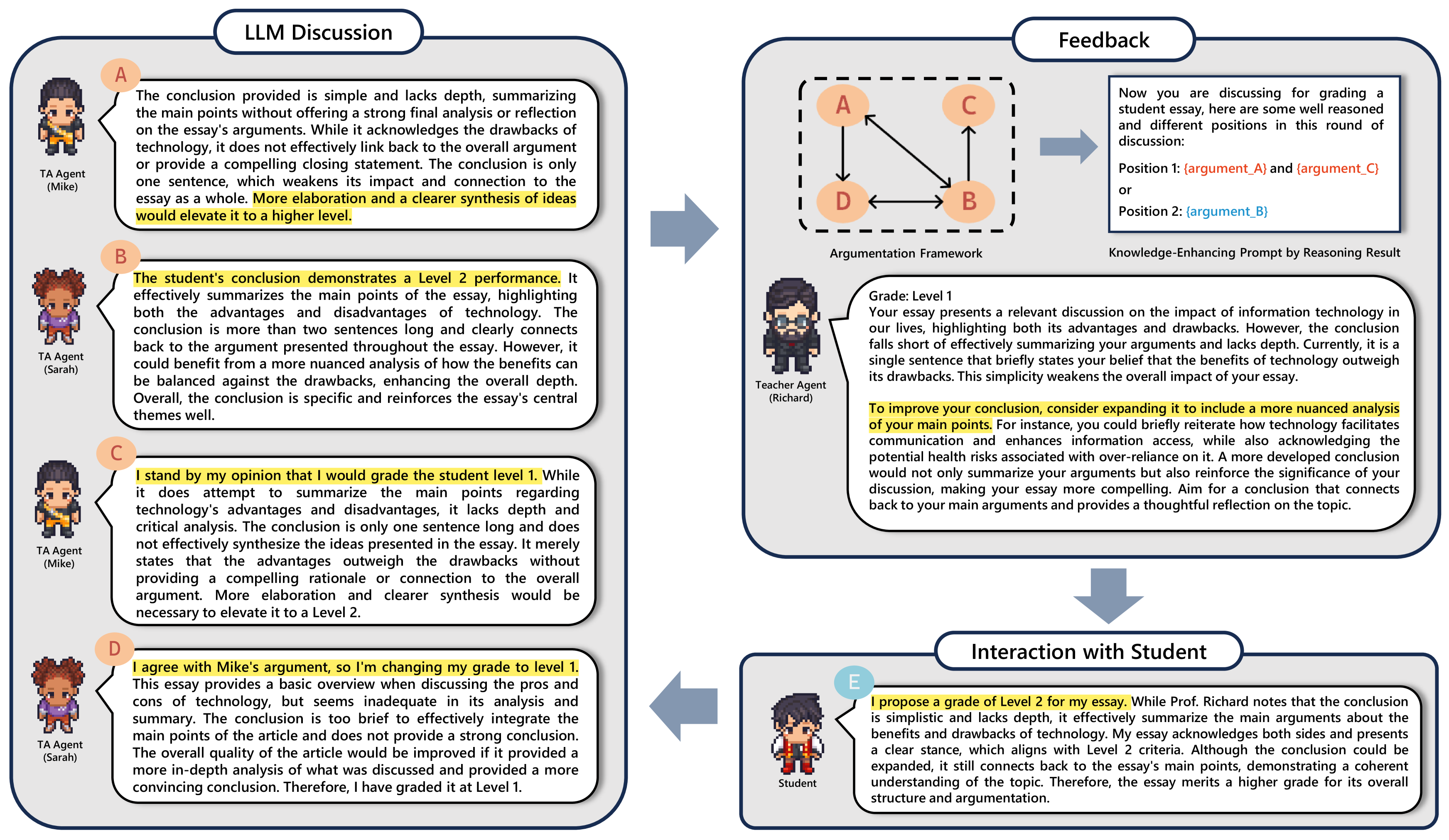

交互式反馈比传统的单向反馈更有效,但其耗时特性限制了其广泛应用。大型语言模型(LLM)在自动化反馈方面具有潜力,但在交互式环境中的推理和交互方面存在困难。本文提出了CAELF,一个基于可辩论AI的LLM框架,用于自动化交互式反馈。CAELF通过集成多智能体系统和计算论证,允许学生查询、挑战和澄清反馈。首先,多个助教智能体(TA Agents)评估论文,然后教师智能体通过形式推理聚合评估结果,生成反馈和评分。学生可以进一步参与反馈,以加深理解。对500篇批判性思维论文的案例研究和用户研究表明,CAELF显著改善了交互式反馈,增强了LLM的推理和交互能力。该方法为克服时间和资源障碍,从而促进交互式反馈在教育环境中的应用,提供了一个有希望的解决方案。

🔬 方法详解

问题定义:论文旨在解决交互式反馈在教育实践中难以广泛应用的问题。现有方法,特别是直接使用LLM进行反馈,在推理能力和交互能力上存在不足,无法提供学生充分质疑和澄清的空间,导致反馈效果受限。

核心思路:论文的核心思路是引入可辩论AI(Contestable AI)的概念,构建一个多智能体系统,模拟教师和学生之间的交互过程。通过让多个助教智能体独立评估论文,教师智能体整合评估结果并生成反馈,学生可以对反馈提出质疑,从而促进更深入的理解和学习。

技术框架:CAELF框架包含以下主要模块:1) 多个助教智能体(TA Agents):每个TA Agent独立评估学生论文,给出评分和反馈。2) 教师智能体(Teacher Agent):整合TA Agents的评估结果,通过形式推理生成最终的反馈和评分。3) 学生交互模块:学生可以查询、挑战和澄清教师智能体的反馈。框架利用计算论证技术,支持学生和智能体之间的辩论过程。

关键创新:CAELF的关键创新在于将可辩论AI与LLM相结合,构建了一个支持交互式反馈的多智能体系统。与传统的单向反馈方法相比,CAELF允许学生主动参与反馈过程,从而提高学习效果。与直接使用LLM进行反馈的方法相比,CAELF通过多智能体协作和计算论证,增强了LLM的推理和交互能力。

关键设计:论文中没有详细描述具体的参数设置、损失函数或网络结构等技术细节。但是,多智能体之间的协作方式,以及计算论证的具体实现,是影响框架性能的关键因素。未来的研究可以进一步探索这些方面的优化。

🖼️ 关键图片

📊 实验亮点

在对500篇批判性思维论文的案例研究中,用户研究表明,CAELF显著改善了交互式反馈,增强了LLM的推理和交互能力。具体的性能数据和对比基线在摘要中没有明确给出,但结论强调了CAELF在提升交互式反馈质量方面的有效性。

🎯 应用场景

CAELF框架可应用于各种教育场景,例如论文评估、作业批改、在线辅导等。该研究的实际价值在于,它提供了一种自动化交互式反馈的有效方法,可以减轻教师的负担,提高学生的学习效果。未来,该框架可以进一步扩展到其他领域,例如法律咨询、医疗诊断等,为用户提供更个性化和可信赖的AI服务。

📄 摘要(原文)

Interactive feedback, where feedback flows in both directions between teacher and student, is more effective than traditional one-way feedback. However, it is often too time-consuming for widespread use in educational practice. While Large Language Models (LLMs) have potential for automating feedback, they struggle with reasoning and interaction in an interactive setting. This paper introduces CAELF, a Contestable AI Empowered LLM Framework for automating interactive feedback. CAELF allows students to query, challenge, and clarify their feedback by integrating a multi-agent system with computational argumentation. Essays are first assessed by multiple Teaching-Assistant Agents (TA Agents), and then a Teacher Agent aggregates the evaluations through formal reasoning to generate feedback and grades. Students can further engage with the feedback to refine their understanding. A case study on 500 critical thinking essays with user studies demonstrates that CAELF significantly improves interactive feedback, enhancing the reasoning and interaction capabilities of LLMs. This approach offers a promising solution to overcoming the time and resource barriers that have limited the adoption of interactive feedback in educational settings.