TRACE-CS: A Hybrid Logic-LLM System for Explainable Course Scheduling

作者: Stylianos Loukas Vasileiou, William Yeoh

分类: cs.AI

发布日期: 2024-09-05 (更新: 2025-09-01)

💡 一句话要点

TRACE-CS:混合逻辑-LLM系统,用于可解释的课程调度

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 课程调度 可解释AI 混合系统 逻辑推理 大型语言模型 自然语言处理 符号推理

📋 核心要点

- 现有课程调度系统缺乏可解释性,用户难以理解调度结果背后的原因,尤其是在面对对比查询时。

- TRACE-CS结合逻辑推理和LLM,利用逻辑保证调度正确性并生成解释,再用LLM将解释转化为易于理解的自然语言。

- TRACE-CS通过混合方法,在保证逻辑正确性的同时,提升了用户交互体验,使得课程调度系统更易于使用和理解。

📝 摘要(中文)

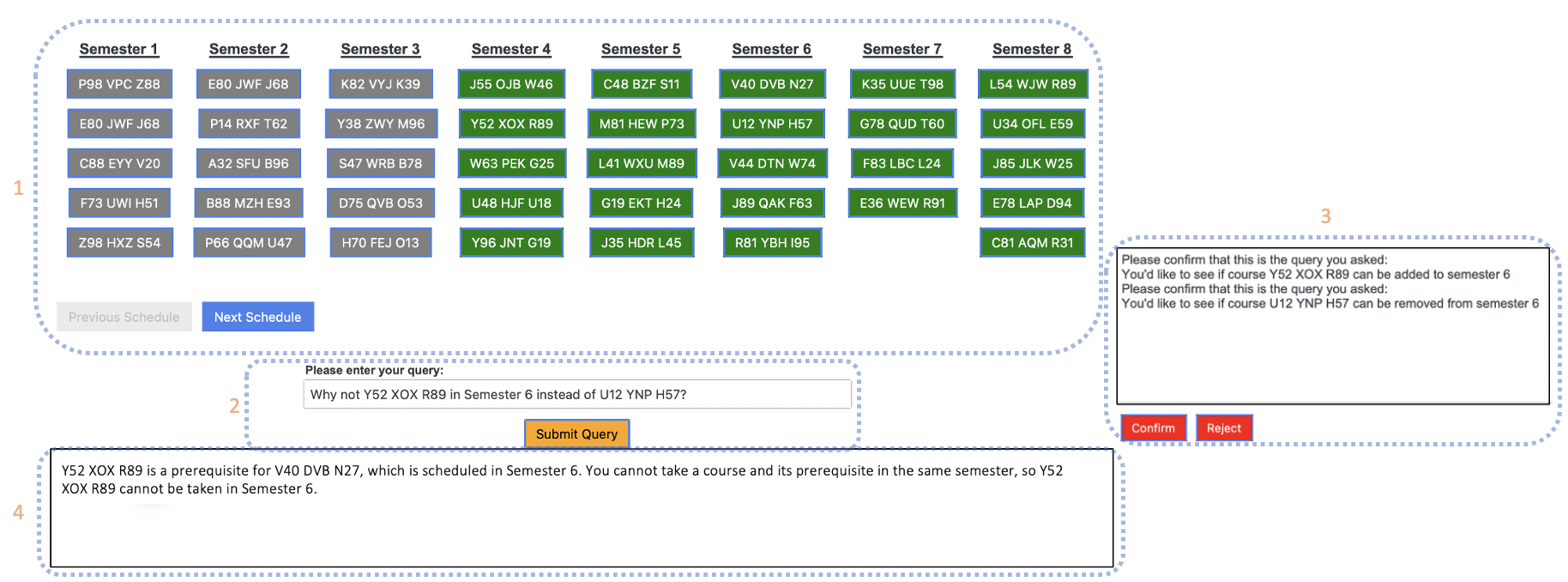

本文提出TRACE-CS,一种新颖的混合系统,它结合了符号推理与大型语言模型(LLM),以解决课程调度问题中的对比查询。TRACE-CS利用基于逻辑的技术来编码调度约束并生成可证明正确的解释,同时利用LLM来处理自然语言查询并将逻辑解释细化为用户友好的响应。该系统展示了如何将符号知识表示方法与LLM相结合,创建可解释的AI代理,从而平衡逻辑正确性与自然语言可访问性,解决了已部署调度系统中的一个根本挑战。

🔬 方法详解

问题定义:课程调度问题通常涉及复杂的约束条件,例如课程容量、教师可用时间、学生选课偏好等。现有方法在提供调度结果时,往往缺乏对结果的解释,用户难以理解为什么会得到这样的调度方案,尤其是在提出“为什么不...”之类的对比查询时,系统难以给出合理的解释。这降低了用户对系统的信任度和满意度。

核心思路:TRACE-CS的核心思路是将符号推理的严谨性和LLM的自然语言处理能力相结合。通过逻辑推理保证调度结果的正确性,并生成初步的逻辑解释。然后,利用LLM将这些逻辑解释转化为用户友好的自然语言描述,从而提高系统的可解释性和易用性。

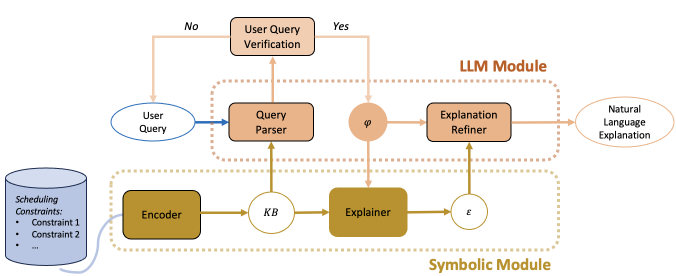

技术框架:TRACE-CS的整体架构包含以下几个主要模块:1) 自然语言查询处理模块:使用LLM解析用户输入的自然语言查询,提取关键信息和意图。2) 逻辑编码模块:将课程调度问题和约束条件编码为逻辑规则。3) 推理引擎:利用逻辑推理引擎,根据编码的规则和用户查询,生成调度方案和相应的逻辑解释。4) 解释细化模块:使用LLM将逻辑解释转化为自然语言描述,使其更易于理解。5) 响应生成模块:将细化后的解释呈现给用户。

关键创新:TRACE-CS的关键创新在于将符号推理和LLM无缝集成,实现了一种混合的可解释AI系统。与传统的基于规则的系统相比,TRACE-CS能够处理更复杂的自然语言查询,并生成更自然、更易于理解的解释。与纯粹基于LLM的系统相比,TRACE-CS能够保证调度结果的逻辑正确性,避免了LLM可能产生的幻觉问题。

关键设计:TRACE-CS的关键设计包括:1) 逻辑编码方式:选择合适的逻辑语言(例如,一阶逻辑或描述逻辑)来编码课程调度问题和约束条件。2) LLM的选择和微调:选择合适的LLM,并针对课程调度领域的特定任务进行微调,以提高其自然语言处理能力。3) 解释细化策略:设计有效的提示工程(prompt engineering)策略,指导LLM将逻辑解释转化为清晰、简洁的自然语言描述。4) 推理引擎的选择:选择高效的推理引擎,以保证调度方案的生成效率。

🖼️ 关键图片

📊 实验亮点

论文展示了TRACE-CS在课程调度问题上的有效性,通过结合逻辑推理和LLM,实现了可解释的调度结果。虽然文中没有给出具体的性能数据,但强调了该系统在提供用户友好解释方面的优势,解决了传统调度系统可解释性不足的问题。未来的工作可以进一步量化TRACE-CS在不同场景下的性能提升。

🎯 应用场景

TRACE-CS具有广泛的应用前景,可应用于大学、培训机构等各种需要进行课程调度的场景。它不仅可以帮助用户快速生成可行的调度方案,还可以提供对调度结果的解释,提高用户对系统的信任度和满意度。此外,该系统还可以扩展到其他调度领域,例如会议室预订、资源分配等。

📄 摘要(原文)

We present TRACE-CS, a novel hybrid system that combines symbolic reasoning with large language models (LLMs)to address contrastive queries in course scheduling problems. TRACE-CS leverages logic-based techniques to encode scheduling constraints and generate provably correct explanations, while utilizing an LLM to process natural language queries and refine logical explanations into user friendly responses. This system showcases how combining symbolic KR methods with LLMs creates explainable AI agents that balance logical correctness with natural language accessibility, addressing a fundamental challenge in deployed scheduling systems.