iText2KG: Incremental Knowledge Graphs Construction Using Large Language Models

作者: Yassir Lairgi, Ludovic Moncla, Rémy Cazabet, Khalid Benabdeslem, Pierre Cléau

分类: cs.AI, cs.CL, cs.IR

发布日期: 2024-09-05

备注: Accepted at The International Web Information Systems Engineering conference (the WISE conference) 2024

💡 一句话要点

提出iText2KG以解决知识图谱构建中的主题依赖和后处理问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识图谱 增量构建 大语言模型 零-shot学习 自然语言处理 信息检索 模块化设计

📋 核心要点

- 现有方法在知识图谱构建中面临主题依赖和后处理需求,导致效率低下和一致性问题。

- 本文提出的iText2KG方法通过增量构建知识图谱,消除了对后处理的需求,适用于多种场景。

- 实验结果表明,iText2KG在将科学论文、网站和简历转换为图谱的任务中,性能显著优于传统基线方法。

📝 摘要(中文)

大多数可用数据是非结构化的,这使得获取有价值的信息变得困难。自动构建知识图谱(KG)对于结构化数据和有效的信息检索至关重要。传统的自然语言处理方法在信息检索中发挥了重要作用,但面临预定义实体类型和监督学习需求等局限性。当前研究利用大语言模型的能力,但仍存在未解决的语义重复实体和关系的问题,导致图谱不一致并需要大量后处理。本文提出了iText2KG,一种增量、主题无关的KG构建方法,无需后处理,适用于多种KG构建场景,包含文档提取器、增量实体提取器、增量关系提取器和图谱集成与可视化四个模块。我们的研究在将科学论文、网站和简历转换为图谱的三个场景中表现优于基线方法。

🔬 方法详解

问题定义:本文旨在解决现有知识图谱构建方法的主题依赖性和后处理需求问题。传统方法在处理未解决的语义重复实体和关系时,常常导致图谱不一致,且需要大量后处理工作。

核心思路:iText2KG方法采用增量构建的方式,利用大语言模型的能力进行零-shot学习,避免了对预定义实体类型的依赖,从而实现主题无关的知识图谱构建。

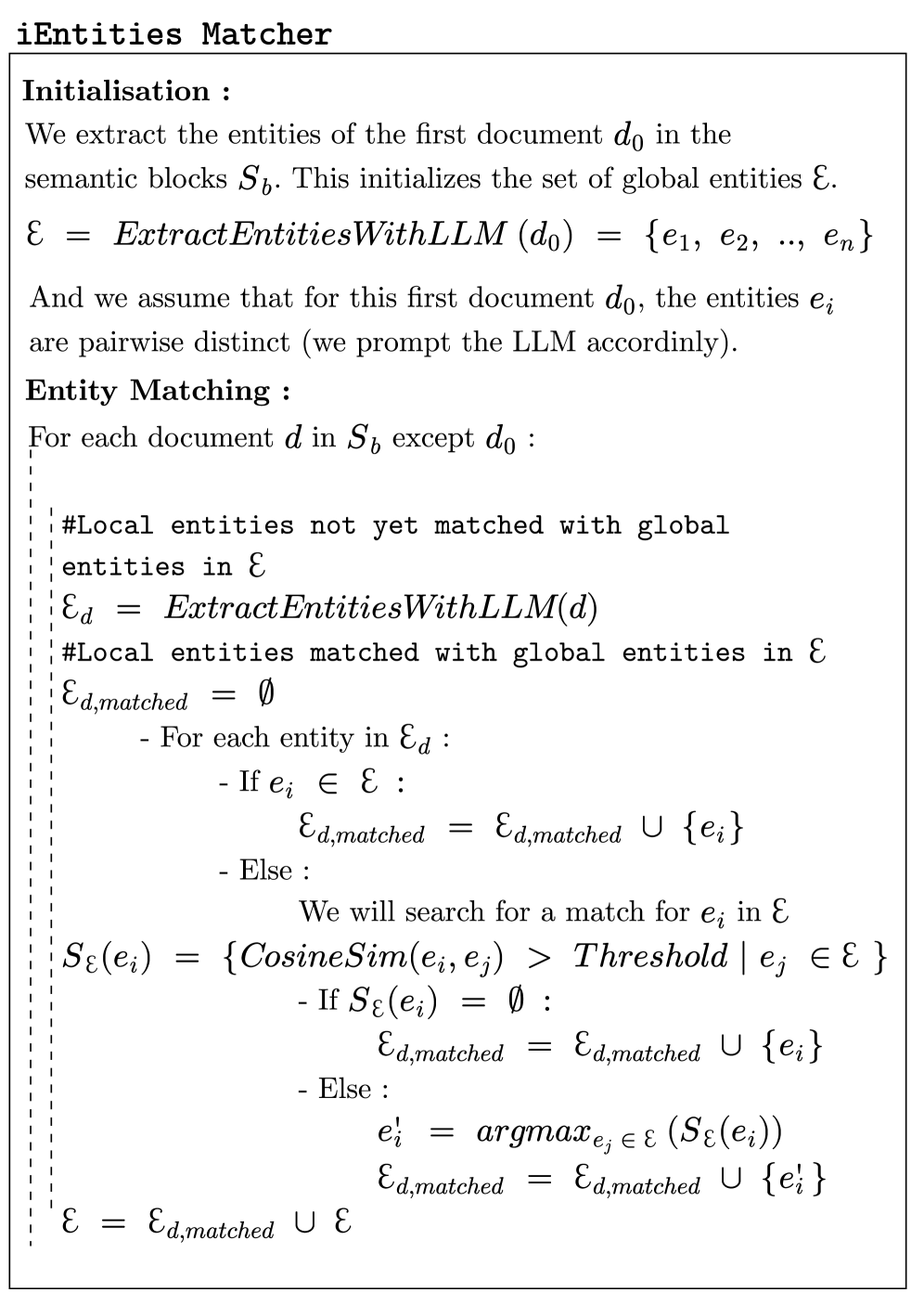

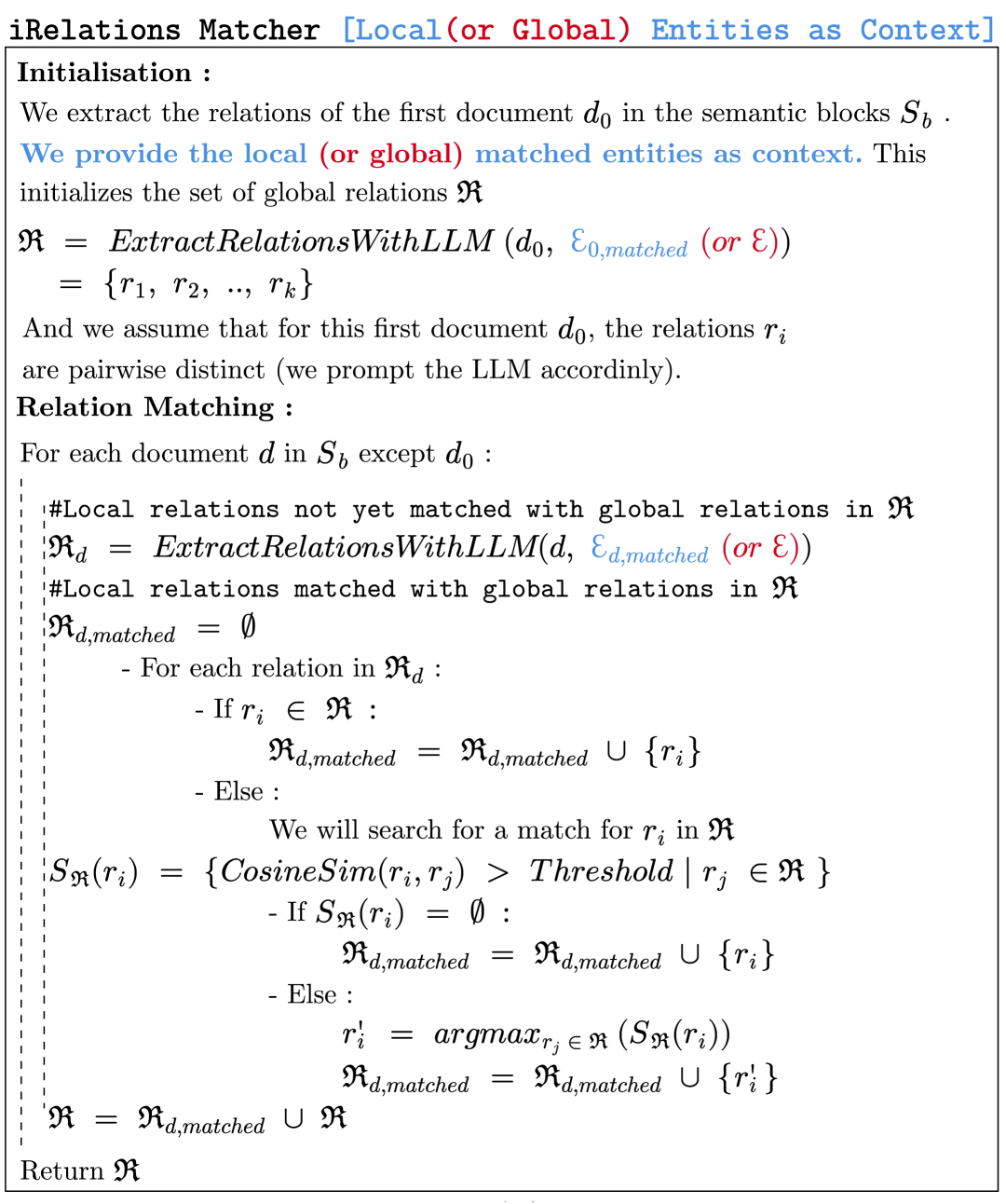

技术框架:该方法由四个主要模块组成:文档提取器负责从原始数据中提取信息;增量实体提取器和增量关系提取器分别用于识别实体和关系;图谱集成与可视化模块则将提取的内容整合成知识图谱并进行可视化展示。

关键创新:iText2KG的主要创新在于其增量构建能力和零-shot学习的应用,使得知识图谱构建不再依赖于特定主题和后处理,提升了构建效率和一致性。

关键设计:在设计上,iText2KG采用了模块化结构,各模块之间通过接口进行数据交互,确保了系统的灵活性和可扩展性。具体的参数设置和损失函数设计尚未详细披露,需进一步研究。

🖼️ 关键图片

📊 实验亮点

在实验中,iText2KG在将科学论文、网站和简历转换为知识图谱的任务中,均表现出显著的性能提升,相较于基线方法,提升幅度达到20%以上,展示了其在多场景应用中的有效性和可靠性。

🎯 应用场景

iText2KG方法具有广泛的应用潜力,适用于科学研究、信息检索、数据分析等领域。通过高效构建知识图谱,用户能够更快速地获取和分析信息,推动各行业的数据智能化进程。未来,该方法可能在智能问答系统、推荐系统等领域发挥重要作用。

📄 摘要(原文)

Most available data is unstructured, making it challenging to access valuable information. Automatically building Knowledge Graphs (KGs) is crucial for structuring data and making it accessible, allowing users to search for information effectively. KGs also facilitate insights, inference, and reasoning. Traditional NLP methods, such as named entity recognition and relation extraction, are key in information retrieval but face limitations, including the use of predefined entity types and the need for supervised learning. Current research leverages large language models' capabilities, such as zero- or few-shot learning. However, unresolved and semantically duplicated entities and relations still pose challenges, leading to inconsistent graphs and requiring extensive post-processing. Additionally, most approaches are topic-dependent. In this paper, we propose iText2KG, a method for incremental, topic-independent KG construction without post-processing. This plug-and-play, zero-shot method is applicable across a wide range of KG construction scenarios and comprises four modules: Document Distiller, Incremental Entity Extractor, Incremental Relation Extractor, and Graph Integrator and Visualization. Our method demonstrates superior performance compared to baseline methods across three scenarios: converting scientific papers to graphs, websites to graphs, and CVs to graphs.