Content Moderation by LLM: From Accuracy to Legitimacy

作者: Tao Huang

分类: cs.CY, cs.AI, cs.ET, cs.HC, cs.LG

发布日期: 2024-09-05 (更新: 2025-06-01)

💡 一句话要点

提出基于合法性的LLM内容审核框架,提升平台治理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 内容审核 大型语言模型 平台治理 合法性 用户参与

📋 核心要点

- 现有内容审核研究过度关注LLM的准确性,忽略了内容审核的平台治理属性和合法性需求。

- 论文提出基于合法性的LLM内容审核框架,强调区分简单和困难情况,并针对性地设计审核策略。

- 论文提出将LLM应用于困难案例筛选、决策解释、辅助人工审核和促进用户参与等多个方面,提升审核的合法性。

📝 摘要(中文)

大型语言模型(LLM)的一个热门应用是用于在线平台的内容审核。目前关于此应用的大多数研究都集中在准确性这一指标上,即LLM对内容做出正确决定的程度。本文认为,准确性是不充分且具有误导性的,因为它未能把握简单情况和困难情况之间的区别,以及在实现更高准确性方面不可避免的权衡。更深入的考察表明,内容审核是平台治理的组成部分,其关键在于获得和提高合法性。LLM的主要目标不是使审核决策正确,而是使其合法。对此,本文提出了一种范式转变,即从单一的准确性基准转向基于合法性的框架来评估LLM审核员的性能。该框架表明,对于简单情况,关键是确保准确性、速度和透明度,而对于困难情况,重要的是合理的理由和用户参与。在此框架下考察,LLM在审核方面的真正潜力不在于提高准确性,而在于其他四个方面:从简单情况中筛选出困难情况,为审核决策提供高质量的解释,协助人工审核员获取更多背景信息,以及以更互动的方式促进用户参与。为了实现这些贡献,本文提出了一种将LLM纳入内容审核系统的工作流程。本文运用来自法律和社会科学的规范理论来批判性地评估这项新技术应用,旨在重新定义LLM在内容审核中的作用,并重新引导该领域的相关研究。

🔬 方法详解

问题定义:现有内容审核方法主要关注LLM的准确性,即判断内容是否违反平台规则。然而,这种方法忽略了内容审核的本质是平台治理的一部分,其目标不仅是做出“正确”的决定,更重要的是获得用户的信任和认可,即合法性。现有方法未能区分简单和困难的审核案例,也未能充分考虑审核决策的解释性和用户参与度,导致用户对审核结果的信任度较低。

核心思路:论文的核心思路是将内容审核的评估标准从单一的“准确性”转变为更全面的“合法性”。合法性包括准确性、透明度、可解释性和用户参与度等多个方面。针对不同的审核案例(简单或困难),应采取不同的策略。对于简单案例,应追求高准确性和高效率;对于困难案例,则应侧重于提供合理的解释和鼓励用户参与。

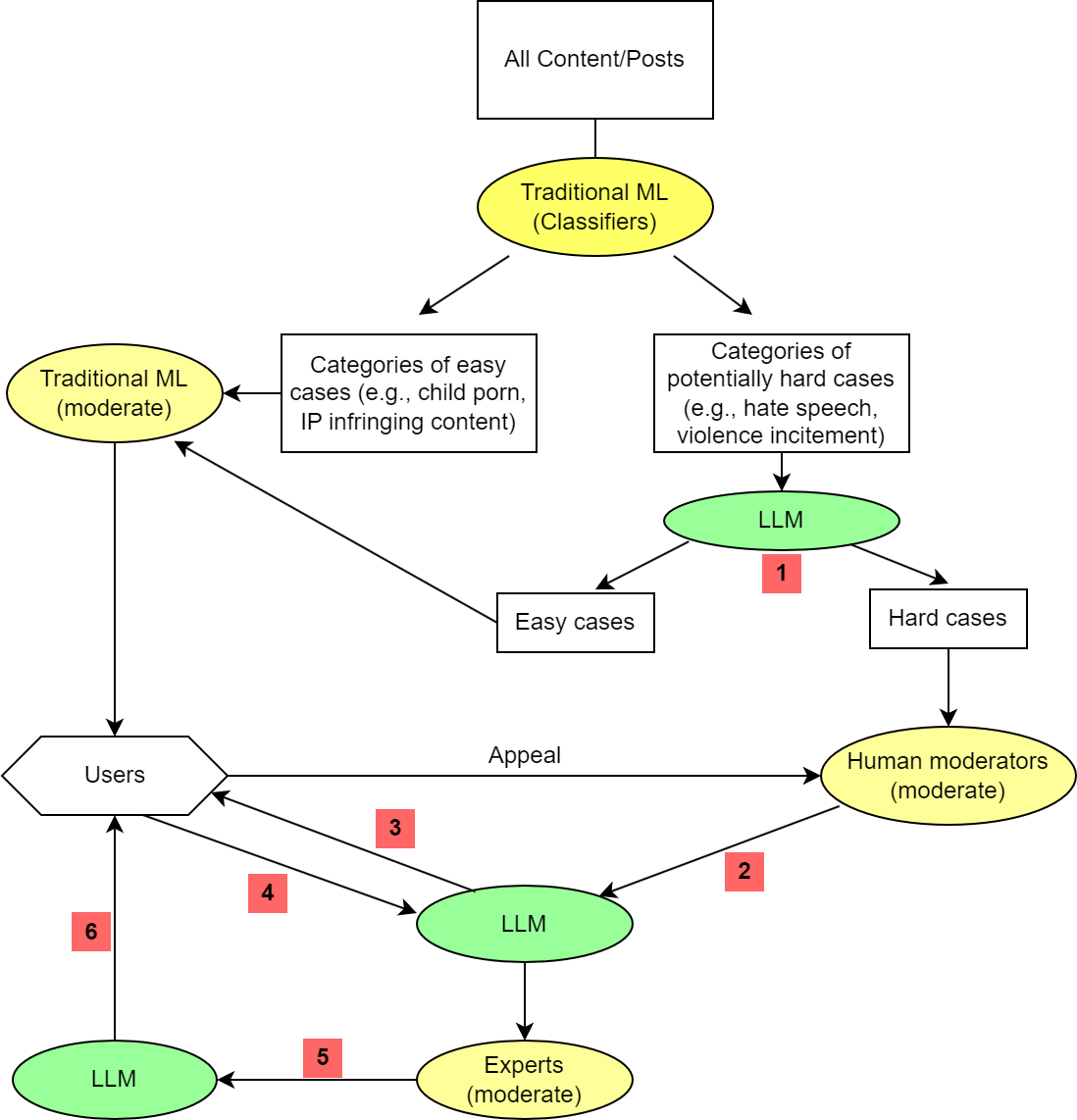

技术框架:论文提出了一个将LLM融入内容审核系统的工作流程。该流程包括以下几个阶段:1) LLM对内容进行初步筛选,区分简单和困难案例;2) 对于简单案例,LLM直接做出审核决策,并提供简要解释;3) 对于困难案例,LLM提供更详细的背景信息和可能的决策选项,辅助人工审核员进行决策;4) LLM生成审核决策的解释,并允许用户参与讨论和申诉。

关键创新:论文的关键创新在于提出了基于合法性的内容审核框架,并重新定义了LLM在内容审核中的角色。LLM不再仅仅是一个“准确的判断者”,而是一个“辅助决策者”和“沟通桥梁”,帮助平台更好地与用户沟通,提高审核决策的透明度和可信度。

关键设计:论文没有涉及具体的模型结构或算法设计,而是侧重于提出一种新的审核流程和评估框架。关键设计在于如何利用LLM的能力来区分简单和困难案例,如何生成高质量的解释,以及如何设计用户参与机制。这些设计需要结合具体的平台规则和用户反馈进行优化。

🖼️ 关键图片

📊 实验亮点

论文的核心贡献在于提出了内容审核的“合法性”概念,并以此为基础构建了新的评估框架和工作流程。虽然论文没有提供具体的实验数据,但其提出的框架具有很强的理论价值和实践指导意义,为未来的内容审核研究提供了新的方向。

🎯 应用场景

该研究成果可应用于各种在线平台的内容审核,例如社交媒体、电商平台、新闻网站等。通过提升内容审核的合法性,可以增强用户对平台的信任感,减少争议和投诉,维护平台的健康生态。未来,该研究可以进一步扩展到其他平台治理领域,例如用户行为规范、社区管理等。

📄 摘要(原文)

One trending application of LLM (large language model) is to use it for content moderation in online platforms. Most current studies on this application have focused on the metric of accuracy -- the extent to which LLMs make correct decisions about content. This article argues that accuracy is insufficient and misleading because it fails to grasp the distinction between easy cases and hard cases, as well as the inevitable trade-offs in achieving higher accuracy. Closer examination reveals that content moderation is a constitutive part of platform governance, the key of which is to gain and enhance legitimacy. Instead of making moderation decisions correct, the chief goal of LLMs is to make them legitimate. In this regard, this article proposes a paradigm shift from the single benchmark of accuracy towards a legitimacy-based framework for evaluating the performance of LLM moderators. The framework suggests that for easy cases, the key is to ensure accuracy, speed, and transparency, while for hard cases, what matters is reasoned justification and user participation. Examined under this framework, LLMs' real potential in moderation is not accuracy improvement. Rather, LLMs can better contribute in four other aspects: to conduct screening of hard cases from easy cases, to provide quality explanations for moderation decisions, to assist human reviewers in getting more contextual information, and to facilitate user participation in a more interactive way. To realize these contributions, this article proposes a workflow for incorporating LLMs into the content moderation system. Using normative theories from law and social sciences to critically assess the new technological application, this article seeks to redefine LLMs' role in content moderation and redirect relevant research in this field.