Wavelet GPT: Wavelet Inspired Large Language Models

作者: Prateek Verma

分类: eess.SP, cs.AI, cs.CL, cs.LG, cs.SD, eess.AS

发布日期: 2024-09-04 (更新: 2025-02-09)

备注: 12 pages, 4 figures;

💡 一句话要点

Wavelet GPT:通过小波变换提升大语言模型预训练效率与性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 小波变换 预训练 多尺度学习 信号处理

📋 核心要点

- 现有大语言模型预训练忽略了数据本身的多尺度结构,导致训练效率低下,性能提升受限。

- Wavelet GPT通过在预训练阶段将小波变换融入LLM,使模型能够学习和利用数据中的多尺度信息。

- 实验表明,Wavelet GPT在多种数据类型上实现了更快的预训练速度和更高的性能,且无需增加额外参数。

📝 摘要(中文)

本文提出了一种名为Wavelet GPT的新型大语言模型,它将传统信号处理中的小波变换思想融入到LLM的预训练过程中,以利用数据中的多尺度结构。在不增加GPT风格LLM架构任何额外参数的情况下,该方法在文本、音频和图像等多种数据类型上,实现了几乎两倍的预训练速度。当训练步数相同时,Wavelet GPT的性能显著提升,可与预训练更大的神经网络架构相媲美。实验表明,该方法在Long Range Arena基准测试和多种输入表示(如字符、BPE token、字节、波形、数学表达式和图像像素)上均有效。该架构允许每个下一个token预测访问每个解码器块中不同时间分辨率的中间嵌入。这项工作为将多速率信号处理融入预训练过程铺平了道路。

🔬 方法详解

问题定义:现有的大语言模型在预训练时,通常忽略了文本、音频、图像等数据中普遍存在的多尺度结构。这种忽略导致模型在学习数据内在规律时效率较低,需要更多的计算资源和时间才能达到理想的性能。因此,如何有效地利用数据中的多尺度信息,提升LLM的预训练效率和性能,是一个重要的研究问题。

核心思路:Wavelet GPT的核心思路是将传统信号处理领域的小波变换引入到LLM的预训练过程中。小波变换能够将信号分解成不同频率和时间尺度的分量,从而揭示信号的内在结构。通过在LLM的中间嵌入中引入小波变换,模型可以学习到不同尺度上的特征表示,从而更好地理解和生成数据。

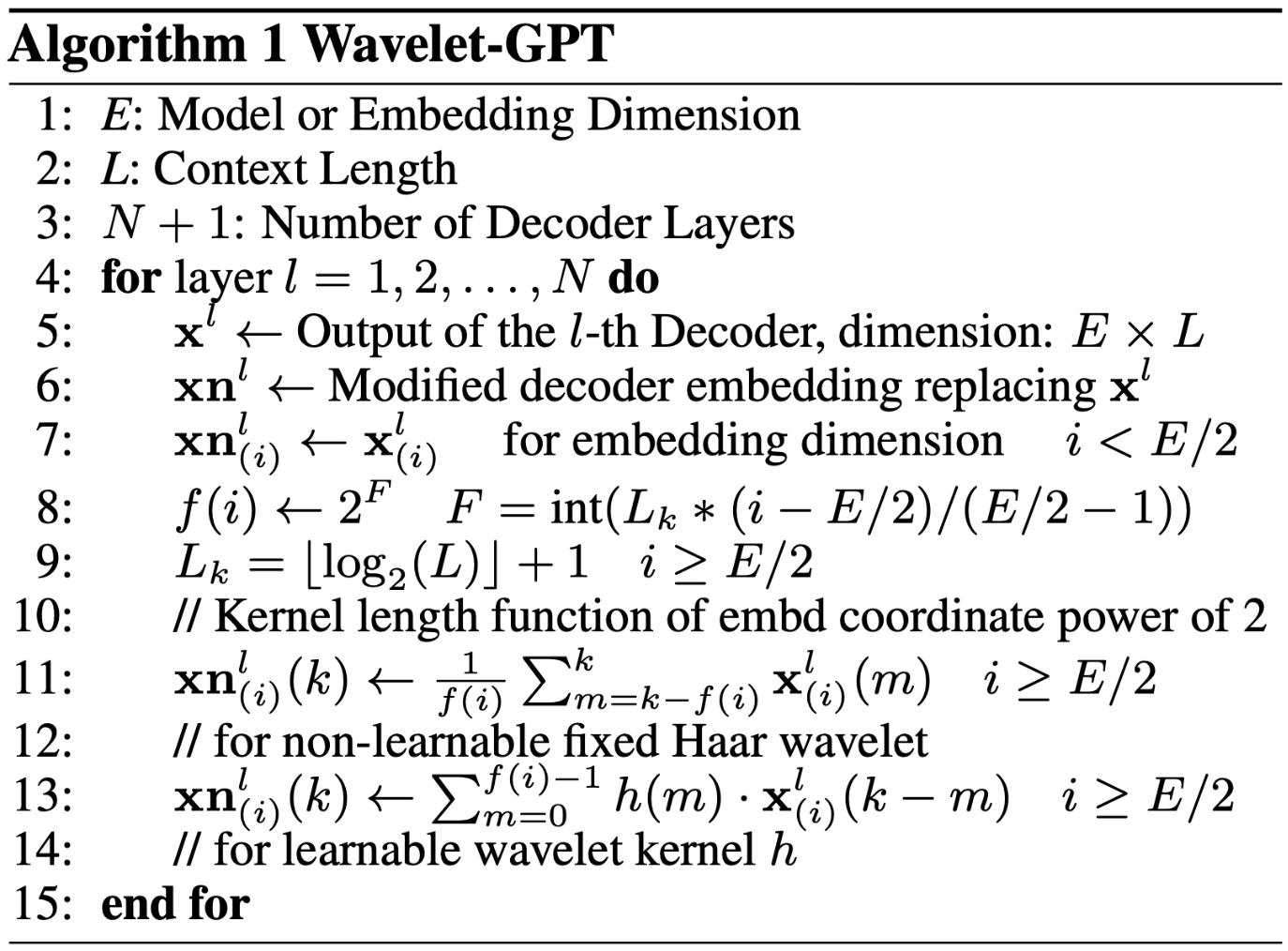

技术框架:Wavelet GPT的整体架构基于标准的GPT风格的LLM。主要的改进在于在每个解码器块中,对中间嵌入进行小波变换。具体来说,模型首先将输入数据(例如文本、音频或图像)转换为嵌入表示。然后,在每个解码器块中,对这些嵌入进行小波分解,得到不同尺度的分量。这些不同尺度的分量被用于后续的token预测。每个token预测都可以访问不同时间分辨率的中间嵌入。

关键创新:Wavelet GPT最重要的技术创新在于将小波变换与LLM的中间嵌入相结合。这种结合使得模型能够学习到数据中的多尺度特征,从而提升了预训练的效率和性能。与现有方法相比,Wavelet GPT无需增加额外的参数,即可实现显著的性能提升。

关键设计:Wavelet GPT的关键设计包括小波基的选择、小波分解的层数以及不同尺度分量的融合方式。论文中可能探讨了不同的小波基(例如Daubechies小波、Haar小波等)对模型性能的影响。此外,小波分解的层数决定了模型能够学习到的尺度范围。最后,如何有效地融合不同尺度的分量,也是一个重要的设计考虑因素。具体的参数设置和损失函数等细节,需要参考论文原文。

🖼️ 关键图片

📊 实验亮点

Wavelet GPT在多种数据类型上实现了显著的性能提升。在文本、音频和图像等数据上,该方法在不增加任何额外参数的情况下,实现了几乎两倍的预训练速度。当训练步数相同时,Wavelet GPT的性能可与预训练更大的神经网络架构相媲美。此外,该方法在Long Range Arena基准测试和多种输入表示上均表现出色。

🎯 应用场景

Wavelet GPT具有广泛的应用前景,包括自然语言处理、语音识别、图像生成等领域。它可以用于提升各种LLM的预训练效率和性能,从而加速AI技术的发展。例如,在文本生成领域,Wavelet GPT可以生成更流畅、更自然的文本;在语音识别领域,它可以提高识别的准确率;在图像生成领域,它可以生成更高质量的图像。此外,该方法还可以应用于其他具有多尺度结构的数据,例如时间序列数据、生物信号数据等。

📄 摘要(原文)

Large Language Models (LLMs) have ushered in a new wave of artificial intelligence advancements impacting every scientific field and discipline. We live in a world where most of the data around us, e.g., text, audio, and music, has a multi-scale structure. This paper infuses LLMs with a traditional signal processing idea, namely wavelets, during pre-training to take advantage of the structure. Without adding \textbf{any extra parameters} to a GPT-style LLM architecture in an academic setup, we achieve the same pre-training performance almost twice as fast in text, audio, and images. This is done by imposing a structure on intermediate embeddings. When trained for the same number of training steps, we achieve significant gains in performance, which is comparable to pre-training a larger neural architecture. Further, we show this extends to the Long Range Arena benchmark and several input representations such as characters, BPE tokens, bytes, waveform, math expression, and image pixels. Our architecture allows every next token prediction access to intermediate embeddings at different temporal resolutions in every decoder block. We hope this will pave the way for incorporating multi-rate signal processing into pre-training.