NESTFUL: A Benchmark for Evaluating LLMs on Nested Sequences of API Calls

作者: Kinjal Basu, Ibrahim Abdelaziz, Kiran Kate, Mayank Agarwal, Maxwell Crouse, Yara Rizk, Kelsey Bradford, Asim Munawar, Sadhana Kumaravel, Saurabh Goyal, Xin Wang, Luis A. Lastras, Pavan Kapanipathi

分类: cs.AI, cs.CL

发布日期: 2024-09-04 (更新: 2025-05-21)

🔗 代码/项目: GITHUB

💡 一句话要点

NESTFUL:用于评估LLM在API调用嵌套序列上的性能的基准测试。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 工具调用 API调用 嵌套序列 基准测试 自主Agent 性能评估

📋 核心要点

- 现有LLM在工具调用方面面临挑战,尤其是在处理API调用的嵌套序列时,缺乏有效的评估基准。

- NESTFUL基准测试通过提供包含1800多个可执行API调用嵌套序列的数据集,来评估LLM在此类任务中的表现。

- 实验结果表明,即使是GPT-4o等先进模型在NESTFUL上的表现也远未达到完美,突显了该领域的研究潜力。

📝 摘要(中文)

本文提出NESTFUL,一个用于评估大型语言模型(LLM)在API调用嵌套序列上的性能的基准测试。随着使用LLM构建的自主Agent在解决复杂现实世界任务中的复兴,LLM的工具或函数调用能力变得越来越重要。NESTFUL专注于嵌套序列的复杂性,旨在扩展现有的基准和评估。NESTFUL包含1800多个嵌套序列,其中所有函数调用都是可执行的。实验结果表明,性能最佳的模型(GPT-4o)的完整序列匹配准确率仅为28%,胜率为60%,表明在函数调用的嵌套序列方面仍有很大的改进空间。对这些结果的分析为社区提供了未来可能的研究方向,以及一个跟踪进展的基准。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在处理API调用嵌套序列时的性能评估问题。现有的工具调用评估基准缺乏对嵌套序列复杂性的充分考虑,导致无法准确衡量LLM在此类任务中的能力。现有方法难以处理API调用之间复杂的依赖关系,导致规划和执行错误。

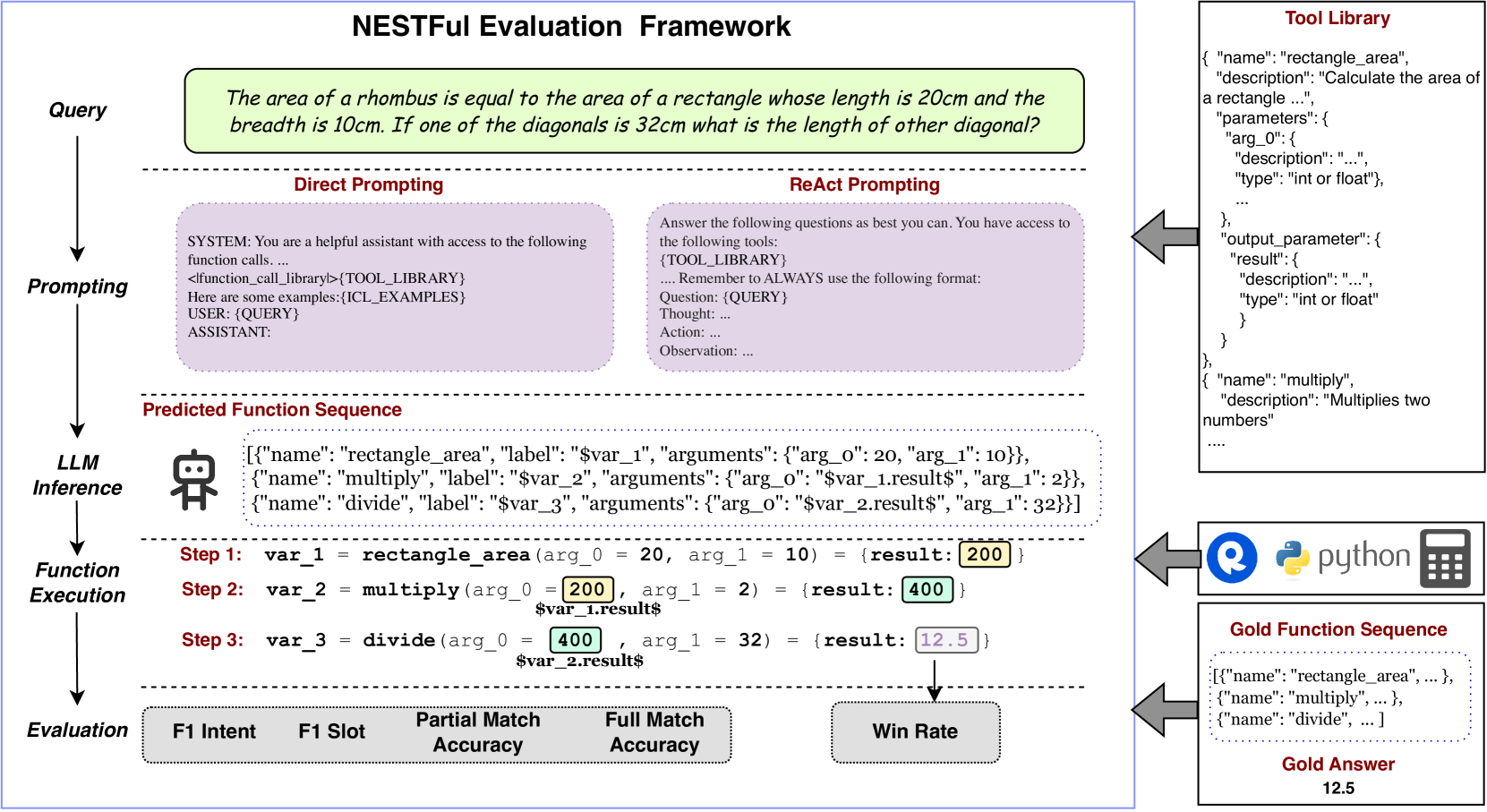

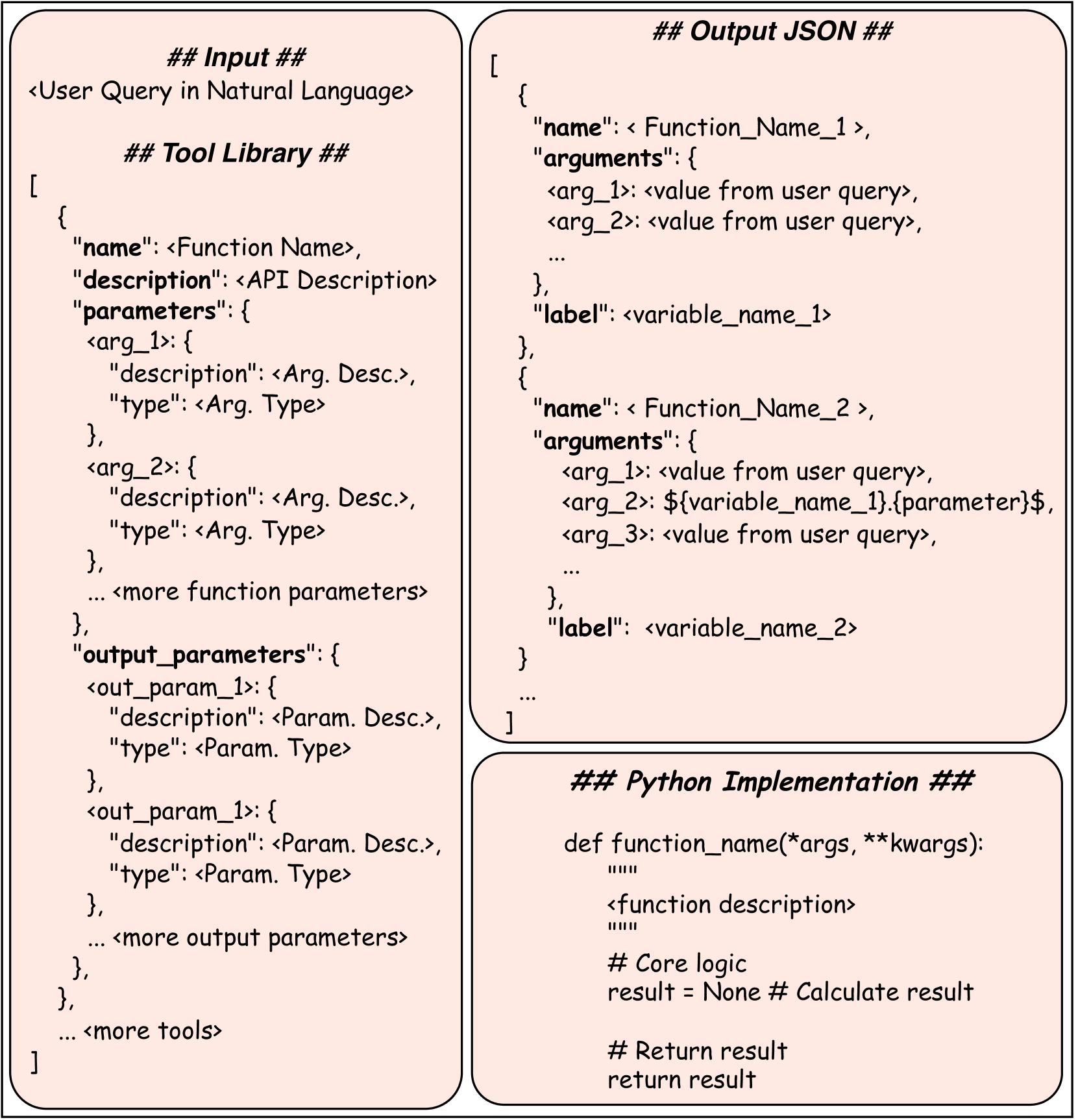

核心思路:论文的核心思路是构建一个专门用于评估LLM在API调用嵌套序列上的性能的基准测试数据集。通过提供包含多个API调用,且后一个API调用的输入依赖于前一个API调用的输出的序列,来测试LLM的规划、执行和响应能力。这种嵌套结构能够更真实地反映实际应用场景的复杂性。

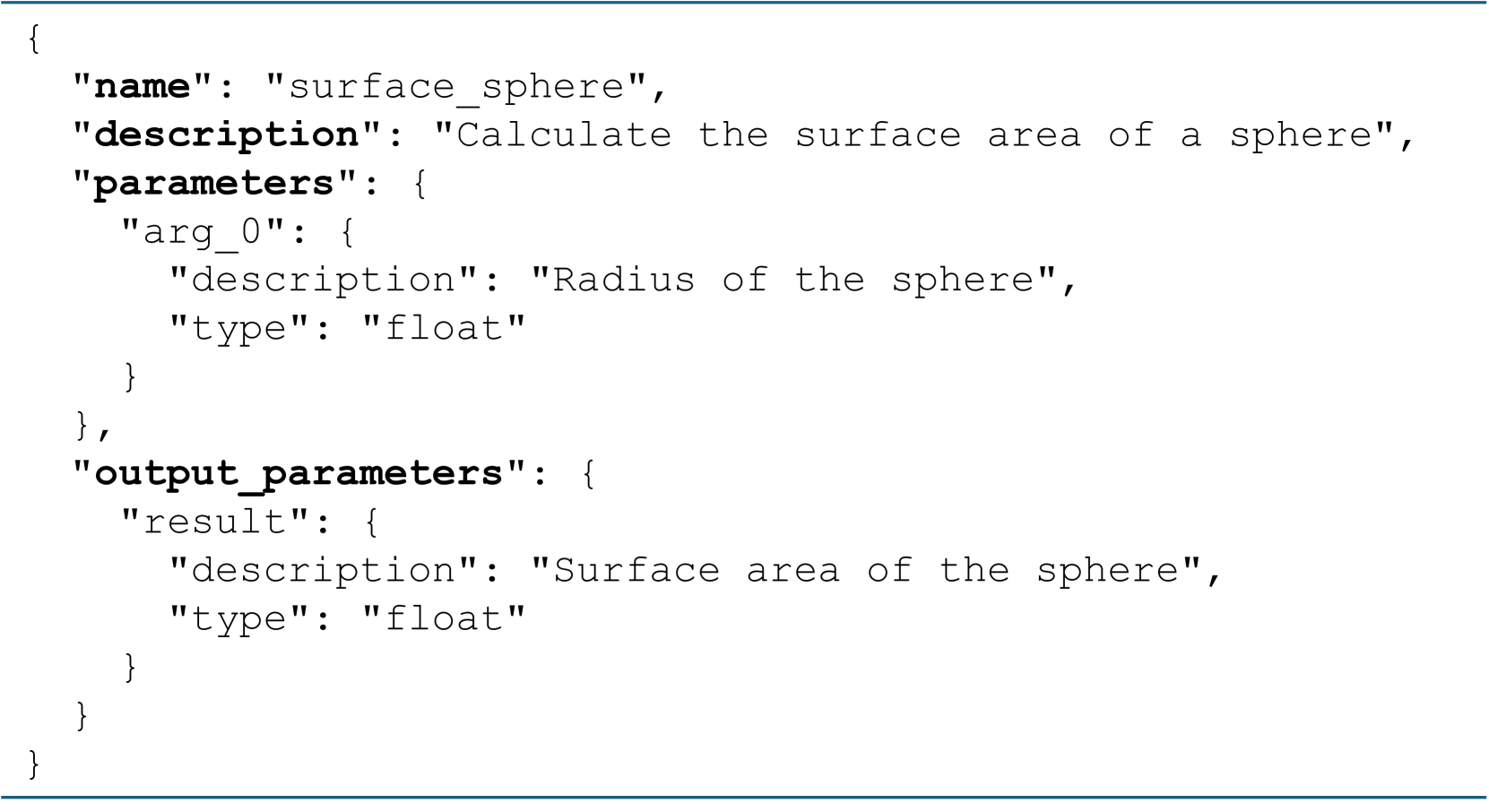

技术框架:NESTFUL基准测试包含以下主要组成部分:1) 一个包含1800多个API调用嵌套序列的数据集;2) 一套评估指标,用于衡量LLM在完成嵌套序列任务时的准确性和效率;3) 一系列实验,用于评估不同LLM在NESTFUL上的性能。数据集中的每个序列都包含多个API调用,这些调用按照一定的逻辑顺序排列,并且每个调用都是可执行的。

关键创新:NESTFUL的关键创新在于其对API调用嵌套序列的关注。与现有的工具调用评估基准相比,NESTFUL更加强调API调用之间的依赖关系,从而能够更全面地评估LLM在复杂任务中的规划和执行能力。此外,NESTFUL数据集中的所有API调用都是可执行的,这使得评估结果更加可靠和可重复。

关键设计:NESTFUL数据集中的API调用来自不同的领域,例如天气查询、日历管理和文本翻译。每个API调用都包含输入参数和输出结果,并且这些参数和结果都经过精心设计,以确保序列的逻辑性和可执行性。评估指标包括完整序列匹配准确率和胜率,这些指标能够衡量LLM在完成整个嵌套序列任务时的性能。

🖼️ 关键图片

📊 实验亮点

实验结果显示,在NESTFUL基准测试中,性能最佳的模型GPT-4o的完整序列匹配准确率仅为28%,胜率为60%。这表明,即使是最先进的LLM在处理API调用嵌套序列时仍然面临很大的挑战,突显了NESTFUL基准测试的重要性和价值。这些结果为未来的研究提供了明确的方向,并为跟踪该领域的进展提供了一个基准。

🎯 应用场景

NESTFUL基准测试可用于评估和改进LLM在各种实际应用场景中的工具调用能力,例如智能助手、自动化工作流程和机器人控制。通过提高LLM处理API调用嵌套序列的能力,可以构建更加智能和自主的Agent,从而提高工作效率和用户体验。该研究成果对开发更强大的自动化系统具有重要意义。

📄 摘要(原文)

The resurgence of autonomous agents built using large language models (LLMs) to solve complex real-world tasks has brought increased focus on LLMs' fundamental ability of tool or function calling. At the core of these agents, an LLM must plan, execute, and respond using external tools, APIs, and custom functions. Research on tool calling has gathered momentum, but evaluation benchmarks and datasets representing the complexity of the tasks have lagged behind. In this work, we focus on one such complexity, nested sequencing, with the goal of extending existing benchmarks and evaluation. Specifically, we present NESTFUL, a benchmark to evaluate LLMs on nested sequences of API calls, i.e., sequences where the output of one API call is passed as input to a subsequent call. NESTFUL contains 1800+ nested sequences where all the function calls are executable. Experimental results on a variety of models show that the best-performing model (GPT-4o) achieves a full sequence match accuracy of 28% and a win-rate of 60%, necessitating a large scope for improvement in the nested sequencing aspect of function calling. Our analysis of these results provides possible future research directions for the community, in addition to a benchmark to track progress. We have released the NESTFUL dataset under the Apache 2.0 license at https://github.com/IBM/NESTFUL.