Configurable Foundation Models: Building LLMs from a Modular Perspective

作者: Chaojun Xiao, Zhengyan Zhang, Chenyang Song, Dazhi Jiang, Feng Yao, Xu Han, Xiaozhi Wang, Shuo Wang, Yufei Huang, Guanyu Lin, Yingfa Chen, Weilin Zhao, Yuge Tu, Zexuan Zhong, Ao Zhang, Chenglei Si, Khai Hao Moo, Chenyang Zhao, Huimin Chen, Yankai Lin, Zhiyuan Liu, Jingbo Shang, Maosong Sun

分类: cs.AI, cs.CL, cs.LG

发布日期: 2024-09-04

💡 一句话要点

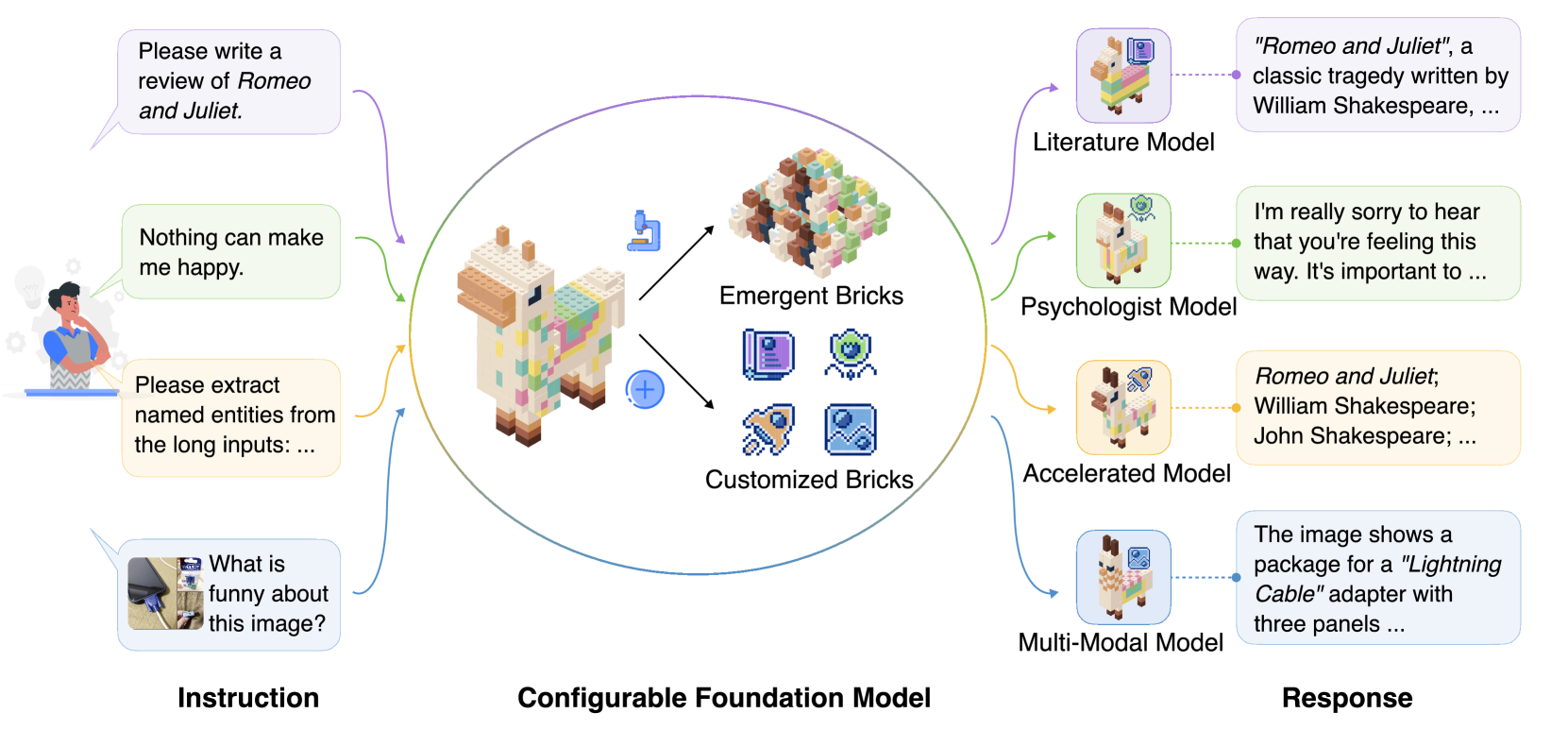

提出可配置基础模型,通过模块化构建LLM以提升效率和可扩展性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 模块化 可配置模型 计算效率 可扩展性 动态配置 神经元分区

📋 核心要点

- 现有LLM因参数量巨大,面临计算效率和可扩展性的挑战,限制了其在资源受限设备和多样化场景中的应用。

- 论文提出将LLM分解为功能模块(砖块),通过动态组装和配置这些模块,实现高效推理和处理复杂任务。

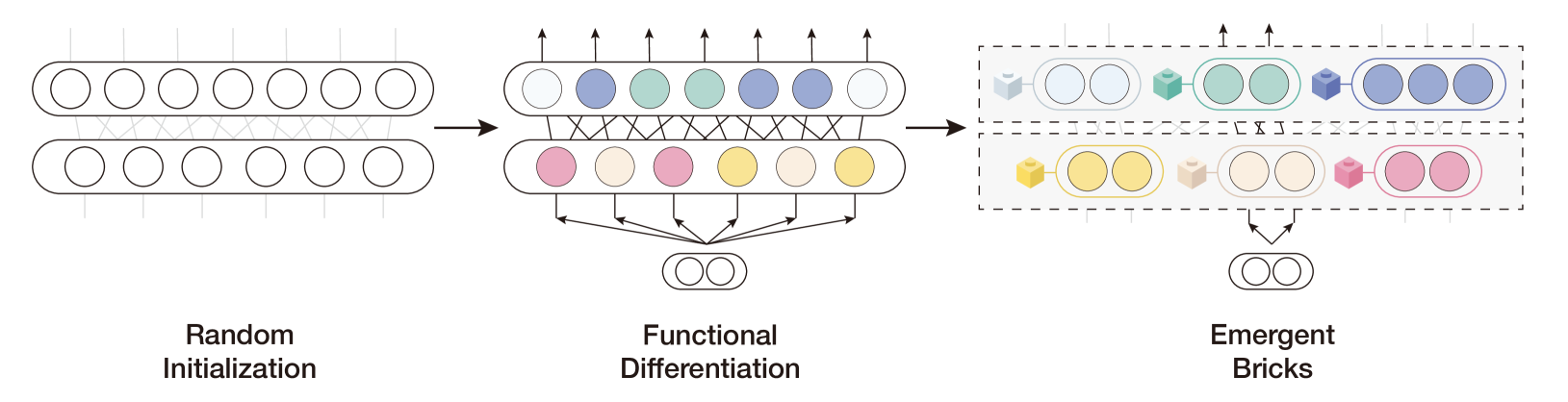

- 通过实证分析,验证了LLM中FFN层存在功能模块化模式,为可配置基础模型提供了理论基础。

📝 摘要(中文)

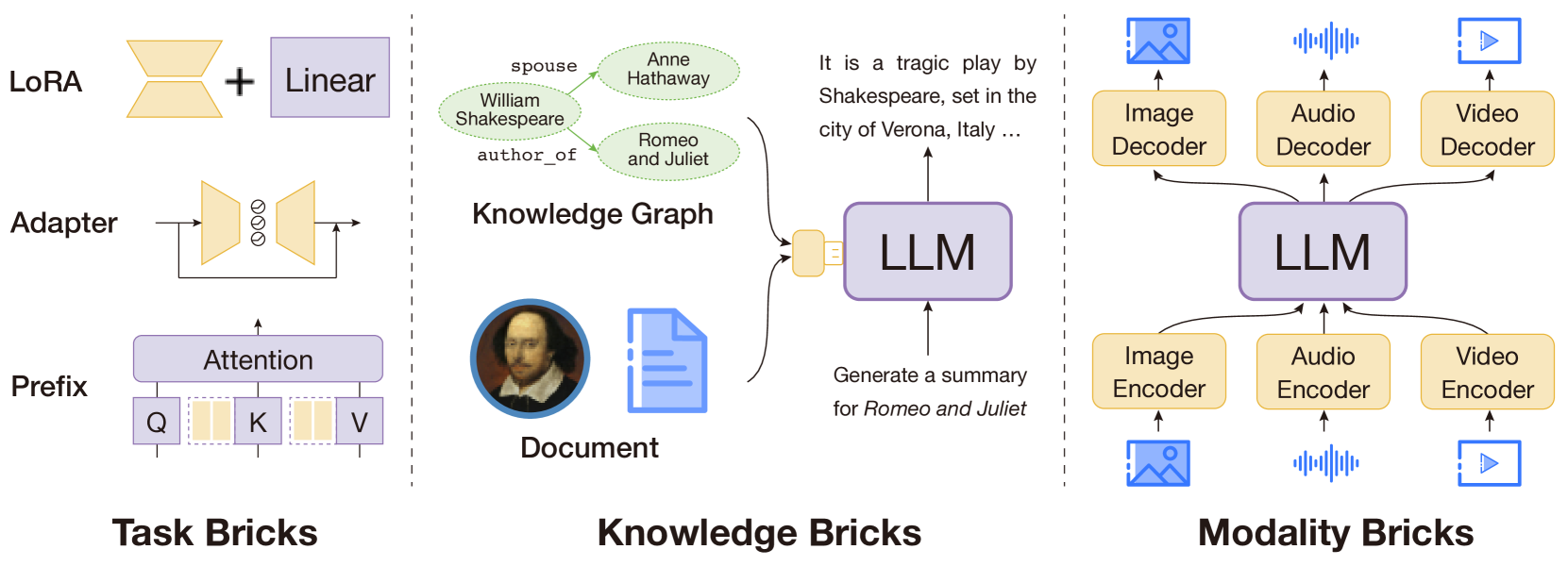

大型语言模型(LLM)的进步揭示了计算效率和持续可扩展性方面的挑战,因为它们需要巨大的参数量,这使得这些模型在计算资源有限的设备上的应用以及在需要各种能力的场景中的演进变得越来越繁琐。受到人脑模块化的启发,越来越多的趋势是将LLM分解为多个功能模块,允许使用部分模块进行推理,并动态组装模块以解决复杂的任务,例如混合专家模型。为了突出模块化方法的固有效率和可组合性,我们创造了术语“砖块”来表示每个功能模块,并将模块化结构指定为可配置的基础模型。在本文中,我们对可配置基础模型的构建、利用和局限性进行了全面的概述和研究。我们首先将模块形式化为涌现砖块(在预训练阶段出现的功能神经元分区)和定制砖块(通过额外的后训练构建的砖块,以提高LLM的能力和知识)。基于不同的功能砖块,我们进一步提出了四种面向砖块的操作:检索和路由、合并、更新和增长。这些操作允许基于指令动态配置LLM以处理复杂的任务。为了验证我们的观点,我们对广泛使用的LLM进行了实证分析。我们发现FFN层遵循模块化模式,具有神经元的功能专业化和功能神经元分区。最后,我们强调了未来研究的几个开放问题和方向。总的来说,本文旨在为现有的LLM研究提供一种新的模块化视角,并激发未来创建更高效和可扩展的基础模型。

🔬 方法详解

问题定义:现有大型语言模型(LLM)由于参数规模庞大,导致计算成本高昂,难以部署在资源受限的设备上,并且在面对需要不同能力的复杂任务时,难以灵活调整模型结构。现有方法缺乏对LLM内部结构进行细粒度控制和动态配置的能力。

核心思路:论文的核心思路是将LLM解构为多个功能模块,每个模块被称为“砖块”。这些砖块可以独立工作,也可以动态组合,以适应不同的任务需求。这种模块化的设计旨在提高LLM的计算效率、可扩展性和灵活性。

技术框架:论文提出了一个基于砖块的可配置基础模型框架,主要包含以下几个模块:1) 砖块构建:包括涌现砖块(预训练阶段自然形成的功能神经元分区)和定制砖块(通过后训练专门构建的模块)。2) 砖块操作:包括检索和路由(选择合适的砖块)、合并(组合多个砖块)、更新(调整砖块参数)和增长(增加新的砖块)。3) 动态配置:根据任务需求,通过砖块操作动态调整LLM的结构和功能。

关键创新:论文的关键创新在于提出了“可配置基础模型”的概念,并将其与LLM的模块化解构相结合。与传统的整体式LLM相比,可配置基础模型能够根据任务需求动态调整模型结构,从而提高计算效率和灵活性。此外,论文还提出了涌现砖块和定制砖块的概念,为模块化LLM的构建提供了新的思路。

关键设计:论文中涉及的关键设计包括:1) 砖块的粒度:如何确定每个砖块包含的神经元数量和功能。2) 砖块的路由策略:如何根据任务需求选择合适的砖块。3) 砖块的合并方法:如何将多个砖块组合成一个更大的模块。4) 砖块的更新策略:如何调整砖块的参数以适应新的任务。这些设计细节将直接影响可配置基础模型的性能和效率。

🖼️ 关键图片

📊 实验亮点

论文通过对现有LLM的实证分析,发现FFN层存在功能模块化模式,验证了可配置基础模型的可行性。虽然论文没有给出具体的性能数据,但强调了模块化方法在提高计算效率和灵活性方面的潜力,为未来的研究方向提供了指导。

🎯 应用场景

该研究成果可应用于各种需要高效和灵活的LLM部署场景,例如移动设备上的智能助手、边缘计算环境下的自然语言处理、以及需要快速适应新任务的机器人控制系统。通过动态配置LLM的模块,可以降低计算成本,提高响应速度,并扩展LLM的应用范围。

📄 摘要(原文)

Advancements in LLMs have recently unveiled challenges tied to computational efficiency and continual scalability due to their requirements of huge parameters, making the applications and evolution of these models on devices with limited computation resources and scenarios requiring various abilities increasingly cumbersome. Inspired by modularity within the human brain, there is a growing tendency to decompose LLMs into numerous functional modules, allowing for inference with part of modules and dynamic assembly of modules to tackle complex tasks, such as mixture-of-experts. To highlight the inherent efficiency and composability of the modular approach, we coin the term brick to represent each functional module, designating the modularized structure as configurable foundation models. In this paper, we offer a comprehensive overview and investigation of the construction, utilization, and limitation of configurable foundation models. We first formalize modules into emergent bricks - functional neuron partitions that emerge during the pre-training phase, and customized bricks - bricks constructed via additional post-training to improve the capabilities and knowledge of LLMs. Based on diverse functional bricks, we further present four brick-oriented operations: retrieval and routing, merging, updating, and growing. These operations allow for dynamic configuration of LLMs based on instructions to handle complex tasks. To verify our perspective, we conduct an empirical analysis on widely-used LLMs. We find that the FFN layers follow modular patterns with functional specialization of neurons and functional neuron partitions. Finally, we highlight several open issues and directions for future research. Overall, this paper aims to offer a fresh modular perspective on existing LLM research and inspire the future creation of more efficient and scalable foundational models.