Large Language Models and Cognitive Science: A Comprehensive Review of Similarities, Differences, and Challenges

作者: Qian Niu, Junyu Liu, Ziqian Bi, Pohsun Feng, Benji Peng, Keyu Chen, Ming Li, Lawrence KQ Yan, Yichao Zhang, Caitlyn Heqi Yin, Cheng Fei, Tianyang Wang, Yunze Wang, Silin Chen, Ming Liu, Ziyuan Qin, Riyang Bao, Xinyuan Song, Zekun Jiang

分类: cs.AI, cs.CL

发布日期: 2024-09-04 (更新: 2025-11-25)

备注: 10 pages, 1 figure

💡 一句话要点

全面综述:大型语言模型与认知科学的异同、挑战及未来

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 认知科学 认知模型 人工智能 认知偏差 认知架构 人类认知 智能系统

📋 核心要点

- 现有认知模型在复杂性和灵活性方面存在局限,难以模拟人类认知的复杂性。

- 该综述深入分析LLMs与人类认知过程的异同,评估LLMs作为认知模型的潜力,并探讨其在认知科学中的应用。

- 通过对LLMs的认知能力、局限性和未来发展方向的评估,为人工智能和认知科学的交叉研究提供指导。

📝 摘要(中文)

本综述全面探讨了大型语言模型(LLMs)与认知科学的交叉领域,考察了LLMs与人类认知过程的异同。我们分析了评估LLMs认知能力的方法,并讨论了它们作为认知模型的潜力。综述涵盖了LLMs在各个认知领域的应用,重点介绍了对认知科学研究的见解。我们评估了LLMs的认知偏差和局限性,以及改进其性能的建议方法。考察了LLMs与认知架构的集成,揭示了增强人工智能(AI)能力的有希望的途径。确定了关键挑战和未来研究方向,强调需要不断改进LLMs,以更好地与人类认知保持一致。本综述对LLMs在促进我们对人工智能和人类智能的理解方面的现状和未来潜力提供了平衡的视角。

🔬 方法详解

问题定义:当前认知科学领域面临的挑战是构建能够准确模拟人类认知过程的模型。现有认知模型往往在处理复杂、动态和上下文相关的任务时表现不足,缺乏足够的灵活性和泛化能力。大型语言模型(LLMs)的兴起为解决这些问题提供了新的视角,但同时也带来了如何评估和利用LLMs认知能力的新挑战。

核心思路:该综述的核心思路是系统性地分析LLMs与人类认知在多个层面的相似性和差异性,从而评估LLMs作为认知模型的有效性。通过对比LLMs和人类在语言理解、推理、记忆等方面的表现,揭示LLMs在模拟人类认知方面的优势和局限性。这种对比分析有助于指导LLMs的改进,使其更接近人类认知。

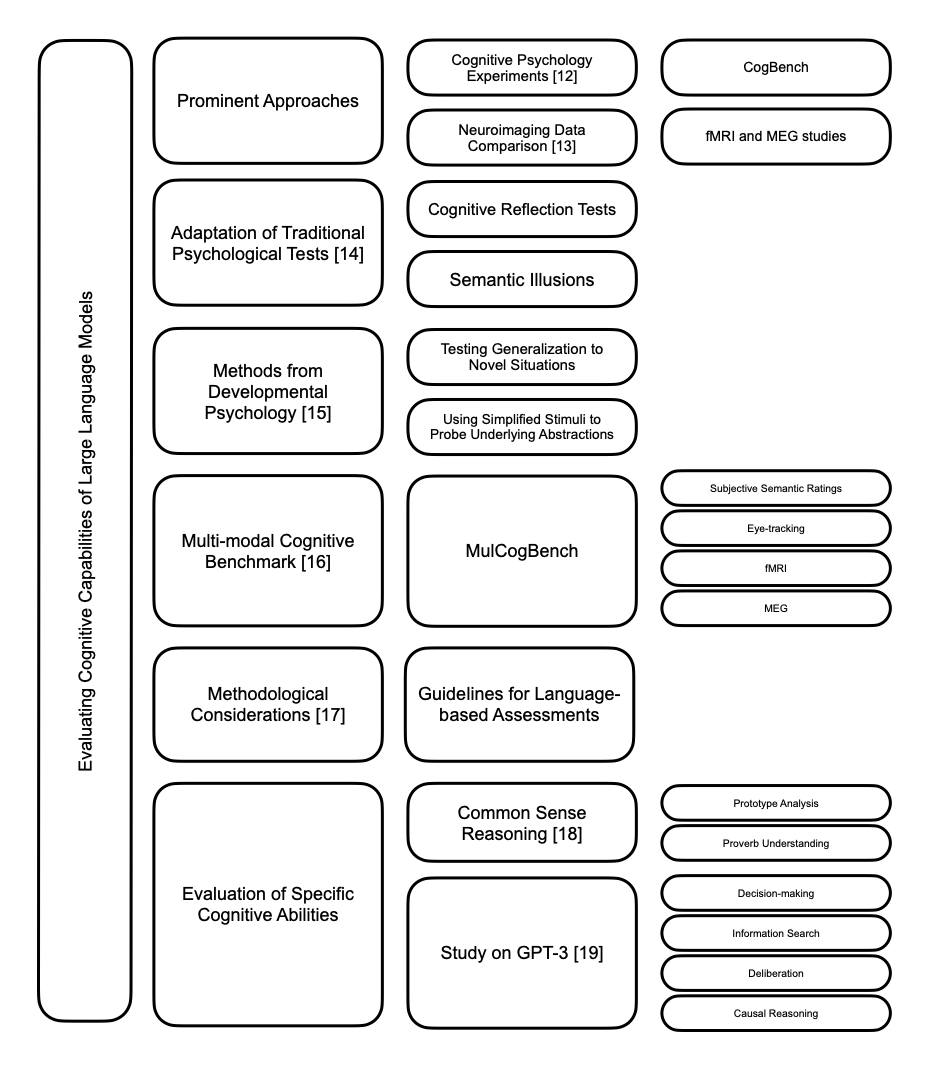

技术框架:该综述没有提出新的技术框架,而是对现有研究进行了系统性的梳理和总结。其框架可以概括为:1) 比较LLMs和人类认知过程;2) 评估LLMs的认知能力;3) 探讨LLMs在认知科学中的应用;4) 分析LLMs的认知偏差和局限性;5) 研究LLMs与认知架构的集成。

关键创新:该综述的关键创新在于其全面性和系统性。它不仅涵盖了LLMs在认知科学中的应用,还深入探讨了LLMs的认知能力、局限性和未来发展方向。通过对现有研究的综合分析,该综述为研究人员提供了一个清晰的路线图,指导他们如何利用LLMs来推进认知科学研究。

关键设计:该综述没有涉及具体的技术细节,而是侧重于对现有研究的总结和分析。它强调了LLMs在模拟人类认知方面的潜力,同时也指出了LLMs存在的认知偏差和局限性。未来的研究需要关注如何减少这些偏差,提高LLMs的鲁棒性和泛化能力。

🖼️ 关键图片

📊 实验亮点

该综述全面评估了LLMs在认知科学中的应用潜力,并指出了LLMs在认知能力、认知偏差和局限性等方面存在的挑战。通过对现有研究的综合分析,为未来研究提供了清晰的方向,强调了持续改进LLMs以更好地模拟人类认知的重要性。

🎯 应用场景

该研究成果可应用于认知科学、人工智能、教育等多个领域。通过利用LLMs模拟人类认知过程,可以开发更智能的教育系统、更人性化的交互界面,以及更有效的决策支持系统。此外,该研究还有助于我们更深入地理解人类认知的本质。

📄 摘要(原文)

This comprehensive review explores the intersection of Large Language Models (LLMs) and cognitive science, examining similarities and differences between LLMs and human cognitive processes. We analyze methods for evaluating LLMs cognitive abilities and discuss their potential as cognitive models. The review covers applications of LLMs in various cognitive fields, highlighting insights gained for cognitive science research. We assess cognitive biases and limitations of LLMs, along with proposed methods for improving their performance. The integration of LLMs with cognitive architectures is examined, revealing promising avenues for enhancing artificial intelligence (AI) capabilities. Key challenges and future research directions are identified, emphasizing the need for continued refinement of LLMs to better align with human cognition. This review provides a balanced perspective on the current state and future potential of LLMs in advancing our understanding of both artificial and human intelligence.