AI Meets the Classroom: When Do Large Language Models Harm Learning?

作者: Matthias Lehmann, Philipp B. Cornelius, Fabian J. Sting

分类: cs.CY, cs.AI, cs.HC, cs.LG

发布日期: 2024-08-29 (更新: 2025-03-08)

💡 一句话要点

研究揭示LLM在教育中的双刃剑效应:过度替代学习活动或损害理解

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 教育应用 学习效果 替代性学习 辅助性学习 学生行为 知识水平 实验研究

📋 核心要点

- 现有研究对LLM在教育中的作用存在争议,缺乏对LLM如何影响不同学习行为和学习效果的深入理解。

- 该研究通过实验分析学生使用LLM的不同方式(替代或辅助学习活动)与学习成果之间的关系。

- 实验结果表明,LLM的使用方式会显著影响学习效果,替代性使用可能损害理解,而辅助性使用则能提升理解。

📝 摘要(中文)

大型语言模型(LLM)在教育中的作用备受争议,既有研究表明LLM可以促进学习,也有研究表明其会阻碍学习。本研究通过两项预注册的、激励性的实验室实验发现,LLM对整体学习成果没有显著影响。进一步的探索性分析和一项实地研究表明,LLM对学习成果的影响取决于使用行为。用LLM替代部分学习活动(例如,生成练习题答案)的学生,虽然能够学习更多的主题,但对每个主题的理解程度会降低。而利用LLM辅助学习活动(例如,寻求解释)的学生,虽然学习的主题数量没有增加,但理解程度有所提高。此外,研究还观察到LLM扩大了先前知识水平较低和较高学生之间的差距。虽然LLM在改善学习方面具有巨大潜力,但其使用必须根据教育环境和学生的需求进行调整。

🔬 方法详解

问题定义:本研究旨在探究大型语言模型(LLM)在教育领域中的实际影响,特别是当学生使用LLM辅助学习时,其对学习成果(包括学习主题的数量和对每个主题的理解程度)的影响。现有研究对LLM的教育作用存在争议,缺乏对不同使用方式(替代 vs. 辅助)的区分,以及对学生先前知识水平差异的考虑。

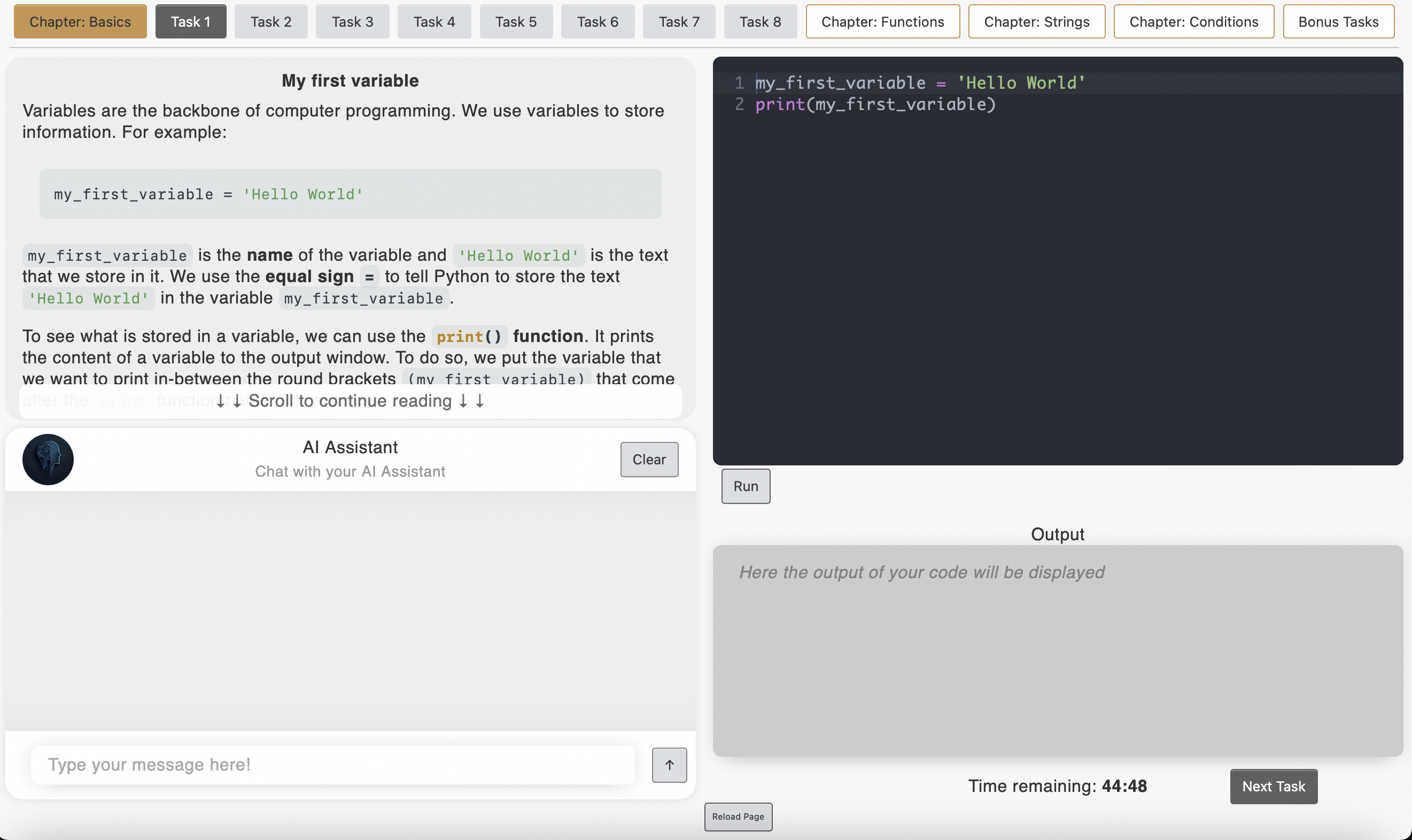

核心思路:核心思路是区分学生使用LLM的两种主要方式:一种是替代性使用,即学生直接使用LLM生成答案或完成作业,从而减少了自身的学习投入;另一种是辅助性使用,即学生利用LLM来获取解释、理解概念或验证自己的答案,从而增强了学习效果。研究假设这两种使用方式会对学习成果产生不同的影响。

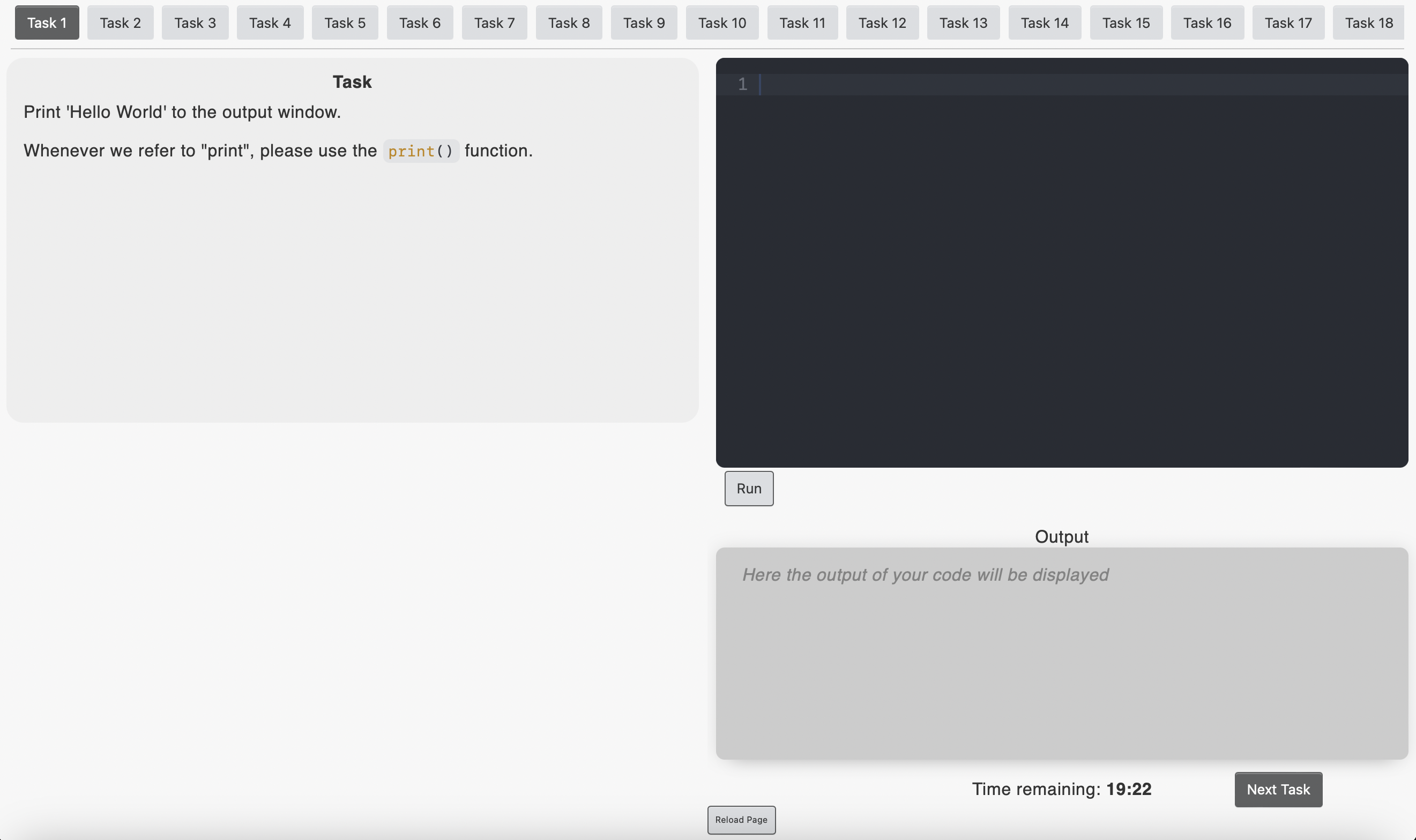

技术框架:研究采用了混合方法,包括两项预注册的实验室实验和一项实地研究。实验室实验旨在控制变量,量化LLM对学习成果的影响。实地研究则旨在观察学生在真实学习环境中使用LLM的行为和效果。研究收集了学生使用LLM的数据(例如,使用频率、提问类型),并分析了这些数据与学习成果之间的关系。

关键创新:该研究的关键创新在于区分了LLM的替代性使用和辅助性使用,并揭示了这两种使用方式对学习成果的不同影响。此外,研究还考虑了学生先前知识水平的差异,发现LLM可能会扩大不同水平学生之间的差距。

关键设计:实验室实验中,研究人员设计了特定的学习任务,并允许部分学生使用LLM辅助学习。研究人员记录了学生使用LLM的行为,并测量了他们的学习成果(例如,测试成绩、对概念的理解程度)。实地研究中,研究人员收集了学生在真实课堂环境中使用LLM的数据,并分析了这些数据与他们的学习成绩之间的关系。研究使用了统计分析方法来评估LLM对学习成果的影响,并控制了其他可能影响学习成果的因素(例如,学生的学习能力、学习时间)。

🖼️ 关键图片

📊 实验亮点

研究发现,LLM的替代性使用(例如,直接生成答案)会增加学生学习的主题数量,但降低对每个主题的理解程度。相反,LLM的辅助性使用(例如,寻求解释)不会增加主题数量,但能提高理解程度。此外,LLM的使用可能会扩大先前知识水平较低和较高学生之间的差距。这些发现强调了LLM在教育中使用的复杂性,以及根据学生需求进行个性化指导的重要性。

🎯 应用场景

该研究成果可应用于指导教育工作者和学生更有效地利用LLM。通过了解LLM的不同使用方式对学习成果的影响,可以制定更合理的教学策略和学习方法,避免过度依赖LLM而损害学生的理解能力。此外,该研究也为LLM教育应用的开发提供了参考,例如,可以设计鼓励辅助性使用、避免替代性使用的LLM学习工具。

📄 摘要(原文)

The effect of large language models (LLMs) in education is debated: Previous research shows that LLMs can help as well as hurt learning. In two pre-registered and incentivized laboratory experiments, we find no effect of LLMs on overall learning outcomes. In exploratory analyses and a field study, we provide evidence that the effect of LLMs on learning outcomes depends on usage behavior. Students who substitute some of their learning activities with LLMs (e.g., by generating solutions to exercises) increase the volume of topics they can learn about but decrease their understanding of each topic. Students who complement their learning activities with LLMs (e.g., by asking for explanations) do not increase topic volume but do increase their understanding. We also observe that LLMs widen the gap between students with low and high prior knowledge. While LLMs show great potential to improve learning, their use must be tailored to the educational context and students' needs.