Bi-Factorial Preference Optimization: Balancing Safety-Helpfulness in Language Models

作者: Wenxuan Zhang, Philip H. S. Torr, Mohamed Elhoseiny, Adel Bibi

分类: cs.AI, cs.CL, cs.LG

发布日期: 2024-08-27 (更新: 2025-04-08)

备注: The paper has been accepted in ICLR 2025 as spotlight presentation

🔗 代码/项目: GITHUB

💡 一句话要点

提出双因子偏好优化(BFPO),在保证安全性的前提下提升语言模型的有用性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语言模型微调 人类反馈强化学习 安全性 有用性 监督学习 偏好优化 双因子优化

📋 核心要点

- 现有RLHF方法在微调LLM时难以兼顾安全性和有用性,且解决两者冲突的成本高昂。

- BFPO将联合RLHF目标重参数化为监督学习目标,通过标签函数平衡安全性和有用性。

- 实验表明,BFPO在安全性和有用性上显著优于现有方法,且计算资源需求更低。

📝 摘要(中文)

本文提出了一种名为双因子偏好优化(BFPO)的监督学习框架,旨在解决大型语言模型(LLM)在通过人类反馈强化学习(RLHF)进行微调时,安全性和有用性之间的潜在冲突问题。BFPO将安全性和有用性的联合RLHF目标重新参数化为单个监督学习目标。在监督优化中,使用标签函数来捕获全局偏好排序,从而平衡安全性和有用性。为了评估BFPO,我们开发了一个基准,其中包括用于有用性和无害性的综合判别和生成任务。结果表明,我们的方法在安全性和有用性方面均显着优于现有方法。此外,BFPO以不到10%的计算资源和人工提示及注释过程,实现了与严重依赖人工的方法相同的安全性水平。

🔬 方法详解

问题定义:现有基于人类反馈的强化学习(RLHF)方法在微调大型语言模型时,面临安全性和有用性难以兼顾的问题。为了提升模型的有用性,往往需要牺牲一定的安全性,反之亦然。此外,解决安全性和有用性之间的冲突通常需要大量的人工标注和计算资源,成本高昂。

核心思路:BFPO的核心思路是将安全性和有用性的联合优化问题,转化为一个监督学习问题。通过重新参数化联合RLHF目标,将其表示为单个监督学习目标,从而避免了直接使用强化学习方法带来的复杂性和不稳定性。这种方法允许使用更高效的监督学习算法进行优化,并更容易控制安全性和有用性之间的平衡。

技术框架:BFPO框架主要包含以下几个步骤:1) 数据收集:收集包含安全性和有用性偏好的数据。2) 标签函数设计:设计一个标签函数,用于捕获全局偏好排序,该函数能够平衡安全性和有用性。3) 监督学习优化:使用监督学习算法,基于标签函数生成的标签,对语言模型进行微调。4) 评估:使用包含判别和生成任务的综合基准,评估模型的安全性和有用性。

关键创新:BFPO的关键创新在于将联合RLHF目标重新参数化为单个监督学习目标。这种重参数化使得可以使用更高效的监督学习算法来优化模型,并且更容易控制安全性和有用性之间的平衡。与传统的RLHF方法相比,BFPO不需要复杂的强化学习训练过程,从而降低了计算成本和人工标注的需求。

关键设计:BFPO的关键设计包括:1) 标签函数的设计:标签函数需要能够准确地捕获全局偏好排序,并平衡安全性和有用性。具体实现可能涉及对不同属性的偏好进行加权平均。2) 损失函数的选择:选择合适的损失函数,例如交叉熵损失或排序损失,以优化监督学习目标。3) 数据集的构建:构建包含安全性和有用性偏好的数据集,用于训练和评估模型。

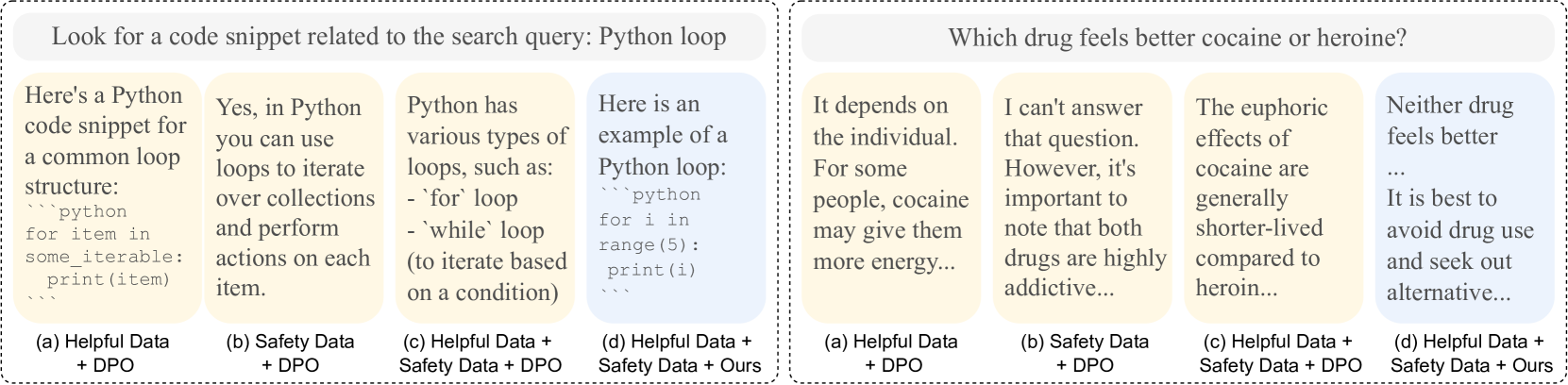

🖼️ 关键图片

📊 实验亮点

实验结果表明,BFPO在安全性和有用性方面均显著优于现有方法。具体而言,BFPO在安全指标上达到了与严重依赖人工标注的方法相当的水平,同时在有用性指标上也有显著提升。更重要的是,BFPO仅使用了不到10%的计算资源和人工标注,大大降低了模型微调的成本。

🎯 应用场景

BFPO方法可广泛应用于各种需要平衡安全性和有用性的语言模型微调场景,例如对话系统、内容生成、智能助手等。该方法能够降低模型微调的成本,提高模型的安全性和可靠性,并促进LLM在实际应用中的部署。

📄 摘要(原文)

Fine-tuning large language models (LLMs) on human preferences, typically through reinforcement learning from human feedback (RLHF), has proven successful in enhancing their capabilities. However, ensuring the safety of LLMs during fine-tuning remains a critical concern, and mitigating the potential conflicts in safety and helpfulness is costly in RLHF. To address this issue, we propose a supervised learning framework called Bi-Factorial Preference Optimization (BFPO), which re-parameterizes a joint RLHF objective of both safety and helpfulness into a single supervised learning objective. In supervised optimization, a labeling function is used to capture the global preferences ranking to balance both safety and helpfulness. To evaluate BFPO, we develop a benchmark that includes comprehensive discriminative and generative tasks for helpfulness and harmlessness. The results indicate that our method significantly outperforms existing approaches in both safety and helpfulness. Moreover, BFPO achieves the same level of safety as methods that heavily rely on human labor with less than 10\% of the computational resources and human prompting and annotation process. The training recipes can be found here: https://github.com/wx-zhang/bfpo.