Dr.Academy: A Benchmark for Evaluating Questioning Capability in Education for Large Language Models

作者: Yuyan Chen, Chenwei Wu, Songzhou Yan, Panjun Liu, Haoyu Zhou, Yanghua Xiao

分类: cs.AI, cs.CL, cs.CY

发布日期: 2024-08-20

备注: Accepted to ACL 2024

💡 一句话要点

提出Dr.Academy基准,评估大型语言模型在教育领域的问题生成能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 教育 提问能力 基准评估 Dr.Academy

📋 核心要点

- 现有研究主要关注LLM作为学习者的能力,而忽略了其作为教育者,特别是提问能力这一关键教学技能。

- 论文提出Dr.Academy基准,通过评估LLM生成的教育问题的质量,来衡量其在教育领域的提问能力,从而评估其教学潜力。

- 实验结果表明,GPT-4在通用学科方面表现出色,而Claude2在跨学科教学方面更具优势,且自动评估结果与人工评估结果高度一致。

📝 摘要(中文)

教师在知识传授和引导学习者方面至关重要,而大型语言模型(LLM)作为潜在教育者的角色正成为一个重要的研究领域。认识到LLM生成教育内容的能力可以促进自动化和个性化学习的进步。虽然LLM的理解和问题解决能力已经过测试,但它们在教学方面的能力在很大程度上仍未被探索。在教学中,提问是一项关键技能,可以指导学生分析、评估和综合核心概念和原则。因此,我们的研究引入了一个基准,通过评估LLM生成的教育问题来评估其作为教师的提问能力,利用Anderson和Krathwohl的分类法,涵盖一般、单学科和跨学科领域。我们将重点从LLM作为学习者转移到LLM作为教育者,通过引导他们生成问题来评估他们的教学能力。我们应用四个指标,包括相关性、覆盖率、代表性和一致性,来评估LLM输出的教育质量。我们的结果表明,GPT-4在教授一般、人文和科学课程方面表现出巨大的潜力;Claude2似乎更适合作为跨学科教师。此外,自动评分与人类的观点一致。

🔬 方法详解

问题定义:论文旨在解决如何有效评估大型语言模型(LLM)在教育领域作为教师的提问能力的问题。现有方法主要关注LLM作为学习者的能力,而忽略了其作为教育者的潜力,尤其是在提问这一关键教学技能上的表现。缺乏一个专门的基准来系统地评估LLM生成高质量教育问题的能力,阻碍了LLM在教育领域的进一步应用。

核心思路:论文的核心思路是将LLM视为教师,通过评估其生成的教育问题的质量来衡量其教学能力。具体而言,论文设计了一个基准Dr.Academy,该基准涵盖了不同学科领域(一般、单学科、跨学科)的问题,并利用Anderson和Krathwohl的认知领域分类法来评估问题的难度和类型。通过分析LLM生成的问题的相关性、覆盖率、代表性和一致性,可以全面评估其提问能力。

技术框架:Dr.Academy基准的整体框架包括以下几个主要步骤:1) 选择合适的LLM作为评估对象;2) 设计问题生成提示,引导LLM生成教育问题;3) 利用Anderson和Krathwohl的分类法对生成的问题进行分类;4) 使用相关性、覆盖率、代表性和一致性等指标对问题质量进行评估;5) 将自动评估结果与人工评估结果进行比较,验证自动评估的有效性。

关键创新:论文的关键创新在于:1) 提出了一个专门用于评估LLM在教育领域提问能力的基准Dr.Academy;2) 将LLM的角色从学习者转变为教育者,关注其教学能力;3) 利用Anderson和Krathwohl的分类法对问题进行分类,从而更全面地评估问题的难度和类型;4) 设计了一套自动评估指标,可以高效地评估LLM生成的问题的质量。

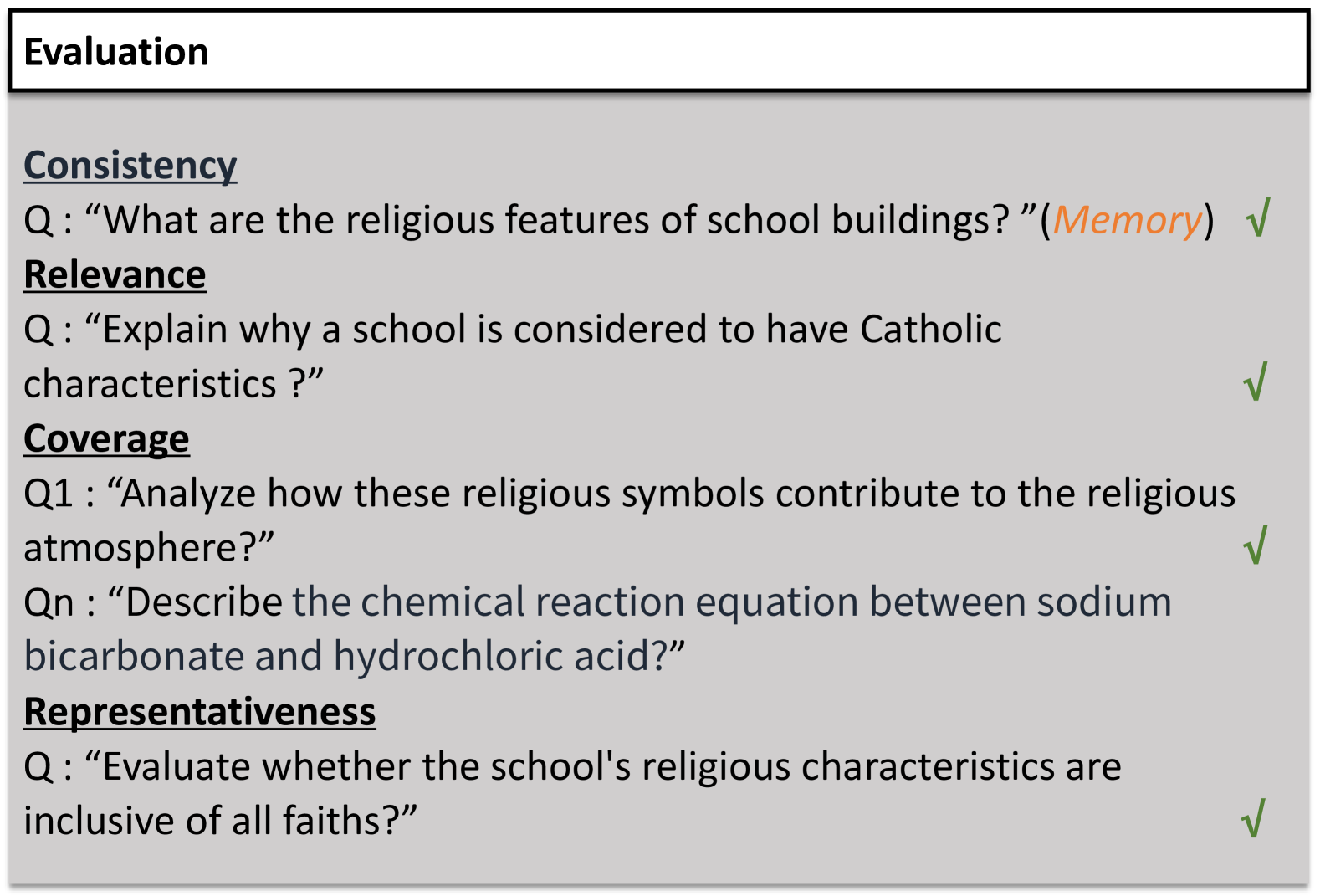

关键设计:在问题生成提示方面,论文设计了不同的提示模板,以引导LLM生成不同类型和难度的问题。在评估指标方面,论文采用了四个关键指标:相关性(问题是否与主题相关)、覆盖率(问题是否覆盖了主题的关键概念)、代表性(问题是否具有代表性,能够反映主题的本质)和一致性(问题之间是否一致,避免出现矛盾或冲突)。这些指标的设计旨在全面评估LLM生成的问题的教育质量。

🖼️ 关键图片

📊 实验亮点

实验结果表明,GPT-4在通用、人文和科学课程的教学方面表现出显著潜力,而Claude2更适合作为跨学科教师。自动评估指标与人工评估结果高度一致,验证了Dr.Academy基准的有效性。这些发现为LLM在教育领域的应用提供了有价值的参考。

🎯 应用场景

该研究成果可应用于开发智能教育系统,辅助教师进行教学设计,为学生提供个性化的学习体验。通过评估和提升LLM的提问能力,可以构建更有效的在线学习平台,促进教育资源的公平分配,并最终推动教育领域的智能化转型。

📄 摘要(原文)

Teachers are important to imparting knowledge and guiding learners, and the role of large language models (LLMs) as potential educators is emerging as an important area of study. Recognizing LLMs' capability to generate educational content can lead to advances in automated and personalized learning. While LLMs have been tested for their comprehension and problem-solving skills, their capability in teaching remains largely unexplored. In teaching, questioning is a key skill that guides students to analyze, evaluate, and synthesize core concepts and principles. Therefore, our research introduces a benchmark to evaluate the questioning capability in education as a teacher of LLMs through evaluating their generated educational questions, utilizing Anderson and Krathwohl's taxonomy across general, monodisciplinary, and interdisciplinary domains. We shift the focus from LLMs as learners to LLMs as educators, assessing their teaching capability through guiding them to generate questions. We apply four metrics, including relevance, coverage, representativeness, and consistency, to evaluate the educational quality of LLMs' outputs. Our results indicate that GPT-4 demonstrates significant potential in teaching general, humanities, and science courses; Claude2 appears more apt as an interdisciplinary teacher. Furthermore, the automatic scores align with human perspectives.