BrewCLIP: A Bifurcated Representation Learning Framework for Audio-Visual Retrieval

作者: Zhenyu Lu, Lakshay Sethi

分类: cs.SD, cs.AI, eess.AS

发布日期: 2024-08-19

💡 一句话要点

BrewCLIP:用于音频-视觉检索的双分支表征学习框架

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 音频-视觉检索 多模态学习 表征学习 双分支网络 语音识别 对比学习 提示学习

📋 核心要点

- 现有音频-图像匹配方法或忽略语音中的非文本信息,或依赖中间转录步骤导致信息损失。

- 提出BrewCLIP,采用双分支结构,同时处理语音的文本和非文本信息,以提升匹配性能。

- 实验表明,BrewCLIP在多个数据集上显著优于现有方法,证明了非文本信息的重要性。

📝 摘要(中文)

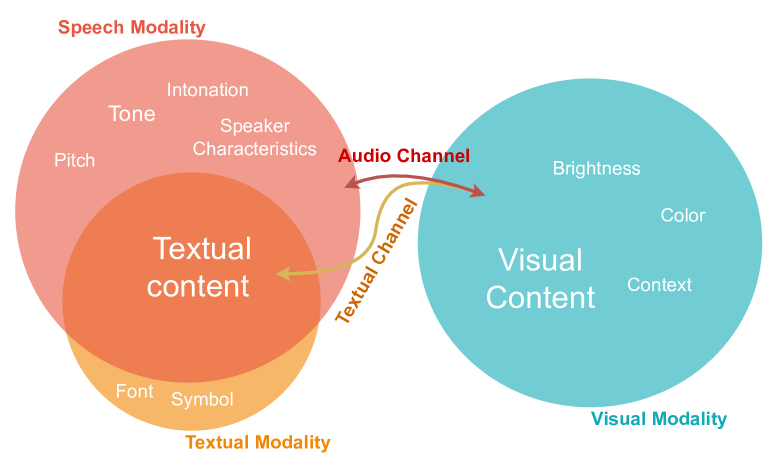

以往的音频-图像匹配方法通常分为两类:流水线模型或端到端模型。流水线模型首先转录语音,然后编码生成的文本;端到端模型直接编码语音。通常,流水线模型优于端到端模型,但中间转录过程必然会丢弃一些潜在有用的非文本信息。除了文本信息外,语音还可以传达诸如口音、情绪和强调等细节,这些细节应有效地体现在编码表示中。在本文中,我们研究了流水线模型忽略的非文本信息是否可以用于提高语音-图像匹配性能。我们全面分析和比较了端到端模型、流水线模型以及我们提出的双通道模型,以在各种数据集上实现鲁棒的音频-图像检索。通过利用强大的预训练模型、提示机制和双分支设计,我们的方法比以前的最先进水平取得了显着的性能提升。

🔬 方法详解

问题定义:音频-图像检索任务旨在根据给定的音频查询检索相关的图像。现有方法主要分为两类:流水线模型和端到端模型。流水线模型依赖语音转录,忽略了语音中包含的非文本信息(如情感、口音等),而端到端模型虽然保留了这些信息,但性能通常不如流水线模型。因此,如何有效利用语音中的文本和非文本信息,提升音频-图像检索的准确性是一个挑战。

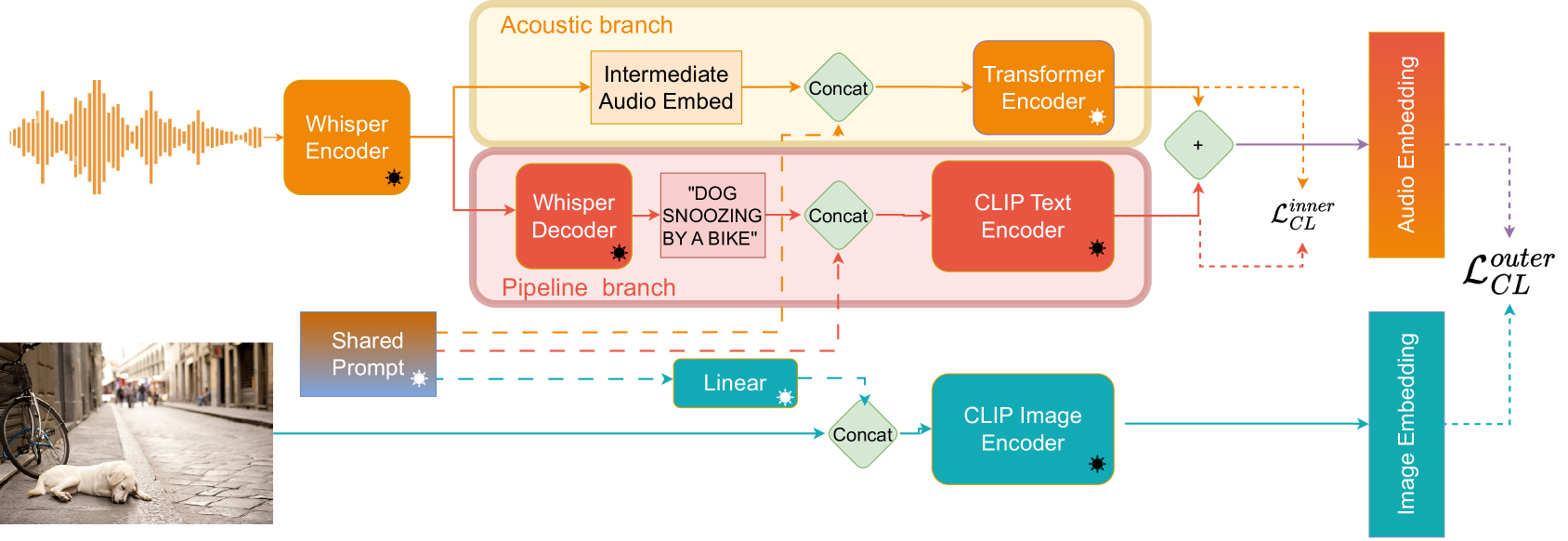

核心思路:BrewCLIP的核心思路是采用双分支结构,分别处理语音的文本信息和非文本信息。一个分支使用语音转录文本,另一个分支直接处理语音信号。通过这种方式,模型可以同时学习到文本信息和非文本信息,从而更全面地理解音频内容。

技术框架:BrewCLIP包含两个主要分支:文本分支和音频分支。文本分支首先使用自动语音识别(ASR)系统将语音转录为文本,然后使用文本编码器(如BERT)对文本进行编码。音频分支直接使用音频编码器(如AST)对语音信号进行编码。然后,将两个分支的输出进行融合,得到最终的音频表征。图像侧使用图像编码器提取图像特征,最后通过对比学习损失函数训练模型,使得相关的音频和图像在特征空间中更接近。

关键创新:BrewCLIP的关键创新在于其双分支结构,能够同时利用语音的文本和非文本信息。此外,论文还探索了使用prompting机制来进一步提升模型的性能。通过在文本分支中引入prompt,可以引导模型更好地理解音频内容。

关键设计:论文使用了预训练的AST模型作为音频编码器,预训练的BERT模型作为文本编码器。对比学习损失函数采用InfoNCE损失。Prompting机制的具体实现方式是,在文本分支的输入中添加一些额外的文本信息,例如“This is a sound of [MASK]”。通过训练,模型可以学习到如何利用这些prompt来更好地理解音频内容。

🖼️ 关键图片

📊 实验亮点

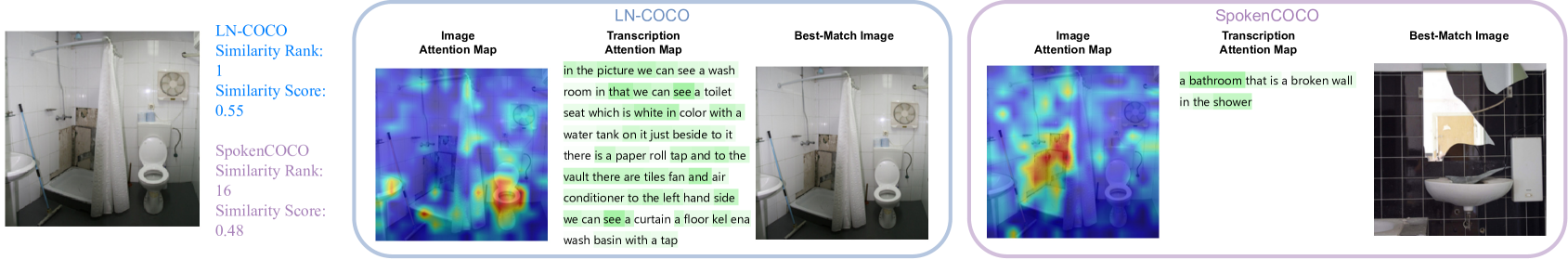

BrewCLIP在多个音频-图像检索数据集上取得了显著的性能提升。例如,在某数据集上,BrewCLIP的检索准确率比现有最佳方法提高了超过5%。实验结果表明,同时利用语音的文本和非文本信息可以显著提升音频-图像检索的性能。

🎯 应用场景

BrewCLIP可应用于各种音频-视觉检索场景,例如:视频内容理解、音乐检索、语音助手等。该研究有助于提升多模态信息融合的性能,为开发更智能的跨模态应用奠定基础。未来,该方法可以扩展到其他模态,例如视频和文本,实现更广泛的多模态检索。

📄 摘要(原文)

Previous methods for audio-image matching generally fall into one of two categories: pipeline models or End-to-End models. Pipeline models first transcribe speech and then encode the resulting text; End-to-End models encode speech directly. Generally, pipeline models outperform end-to-end models, but the intermediate transcription necessarily discards some potentially useful non-textual information. In addition to textual information, speech can convey details such as accent, mood, and and emphasis, which should be effectively captured in the encoded representation. In this paper, we investigate whether non-textual information, which is overlooked by pipeline-based models, can be leveraged to improve speech-image matching performance. We thoroughly analyze and compare End-to-End models, pipeline models, and our proposed dual-channel model for robust audio-image retrieval on a variety of datasets. Our approach achieves a substantial performance gain over the previous state-of-the-art by leveraging strong pretrained models, a prompting mechanism and a bifurcated design.