Enhancing Modal Fusion by Alignment and Label Matching for Multimodal Emotion Recognition

作者: Qifei Li, Yingming Gao, Yuhua Wen, Cong Wang, Ya Li

分类: cs.MM, cs.AI, cs.CV, cs.SD

发布日期: 2024-08-18

备注: The paper has been accepted by INTERSPEECH 2024

💡 一句话要点

提出Foal-Net,通过对齐和标签匹配增强多模态情感识别中的模态融合效果

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态情感识别 模态融合 情感对齐 对比学习 跨模态学习

📋 核心要点

- 多模态情感识别中,模态间信息融合不足限制了性能提升,需要更有效的融合策略。

- Foal-Net通过音频-视频情感对齐和跨模态情感标签匹配,增强模态融合效果,提升情感识别准确率。

- 在IEMOCAP数据集上,Foal-Net超越现有方法,验证了情感对齐在模态融合前的重要性。

📝 摘要(中文)

为了解决多模态情感识别(MER)中模态间信息融合的局限性,我们提出了一个基于多任务学习的新型MER框架,称为Foal-Net,该框架在对齐后进行融合。该框架旨在提高模态融合的有效性,并包括两个辅助任务:音频-视频情感对齐(AVEL)和跨模态情感标签匹配(MEM)。首先,AVEL通过对比学习实现音频-视频表示中情感信息的对齐。然后,模态融合网络整合对齐后的特征。同时,MEM评估当前样本对的情感是否相同,为模态信息融合提供辅助,并引导模型更多地关注情感信息。在IEMOCAP语料库上进行的实验结果表明,Foal-Net优于最先进的方法,并且模态融合之前的情感对齐是必要的。

🔬 方法详解

问题定义:多模态情感识别旨在利用来自不同模态(如音频和视频)的信息来识别人类的情感状态。现有的方法在模态融合方面存在不足,未能充分利用不同模态之间的互补信息,导致识别性能受限。尤其是在模态信息存在偏差或噪声时,简单的融合策略可能导致性能下降。

核心思路:Foal-Net的核心思路是在模态融合之前进行情感对齐,并通过跨模态情感标签匹配来引导模型关注情感信息。通过对齐,可以减少模态间的差异,使模型更容易捕捉到一致的情感表达。标签匹配则可以增强模型对情感信息的敏感度,提高识别的准确性。

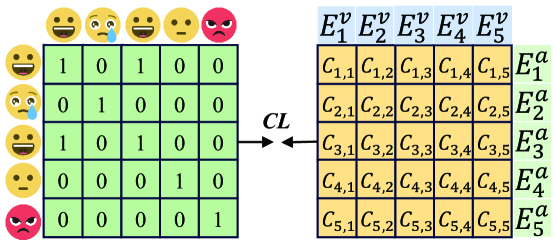

技术框架:Foal-Net的整体框架包括三个主要模块:音频-视频情感对齐(AVEL)、模态融合网络和跨模态情感标签匹配(MEM)。首先,AVEL模块通过对比学习,将音频和视频的情感表示对齐到一个共同的特征空间。然后,模态融合网络将对齐后的特征进行融合,生成最终的情感表示。最后,MEM模块评估当前样本对的情感是否相同,并利用这个信息来辅助模态融合。

关键创新:Foal-Net的关键创新在于引入了情感对齐作为模态融合的预处理步骤,以及利用跨模态情感标签匹配来增强模型对情感信息的关注。与传统的直接融合方法相比,Foal-Net能够更好地处理模态间的差异和噪声,从而提高情感识别的准确性。

关键设计:AVEL模块使用对比学习,通过最小化正样本对(具有相同情感的音频和视频)之间的距离,最大化负样本对之间的距离,来实现情感对齐。MEM模块通过一个二元分类器来判断样本对的情感是否相同,并使用交叉熵损失函数进行训练。模态融合网络可以使用各种现有的融合策略,例如注意力机制或门控机制。具体参数设置和网络结构的选择可以根据具体应用场景进行调整。

🖼️ 关键图片

📊 实验亮点

Foal-Net在IEMOCAP数据集上取得了显著的性能提升,超越了现有的state-of-the-art方法。实验结果表明,情感对齐在模态融合之前是必要的,并且跨模态情感标签匹配可以有效地提高情感识别的准确性。具体的性能数据和对比基线在论文中详细给出,展示了Foal-Net的优越性。

🎯 应用场景

Foal-Net在人机交互、情感计算、智能客服等领域具有广泛的应用前景。例如,可以应用于智能监控系统中,通过分析视频和音频信息来识别异常行为和情感状态;也可以应用于在线教育平台,根据学生的情感状态调整教学策略,提高学习效果。此外,该方法还可以用于心理健康评估和治疗,帮助医生更好地了解患者的情感状态。

📄 摘要(原文)

To address the limitation in multimodal emotion recognition (MER) performance arising from inter-modal information fusion, we propose a novel MER framework based on multitask learning where fusion occurs after alignment, called Foal-Net. The framework is designed to enhance the effectiveness of modality fusion and includes two auxiliary tasks: audio-video emotion alignment (AVEL) and cross-modal emotion label matching (MEM). First, AVEL achieves alignment of emotional information in audio-video representations through contrastive learning. Then, a modal fusion network integrates the aligned features. Meanwhile, MEM assesses whether the emotions of the current sample pair are the same, providing assistance for modal information fusion and guiding the model to focus more on emotional information. The experimental results conducted on IEMOCAP corpus show that Foal-Net outperforms the state-of-the-art methods and emotion alignment is necessary before modal fusion.