Toward a Dialogue System Using a Large Language Model to Recognize User Emotions with a Camera

作者: Hiroki Tanioka, Tetsushi Ueta, Masahiko Sano

分类: cs.HC, cs.AI, cs.RO

发布日期: 2024-08-15 (更新: 2025-02-18)

备注: 4 pages, 5 figures, 1 table, The 1st InterAI: Interactive AI for Human-Centered Robotics workshop in conjunction with IEEE Ro-MAN 2024, Pasadona, LA, USA, Aug. 2024

期刊: The 1st InterAI Workshop: Interactive AI for Human-centered Robotics, 2024

💡 一句话要点

利用大语言模型和摄像头,实现能识别用户情绪的对话系统

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 对话系统 大型语言模型 情绪识别 面部表情 多模态交互

📋 核心要点

- 现有AI对话系统缺乏从用户面部表情识别情绪的能力,限制了其在多模态交互中的表现。

- 该研究提出利用摄像头捕捉用户面部表情,通过LLM识别情绪,并将其融入对话提示中,实现情绪感知对话。

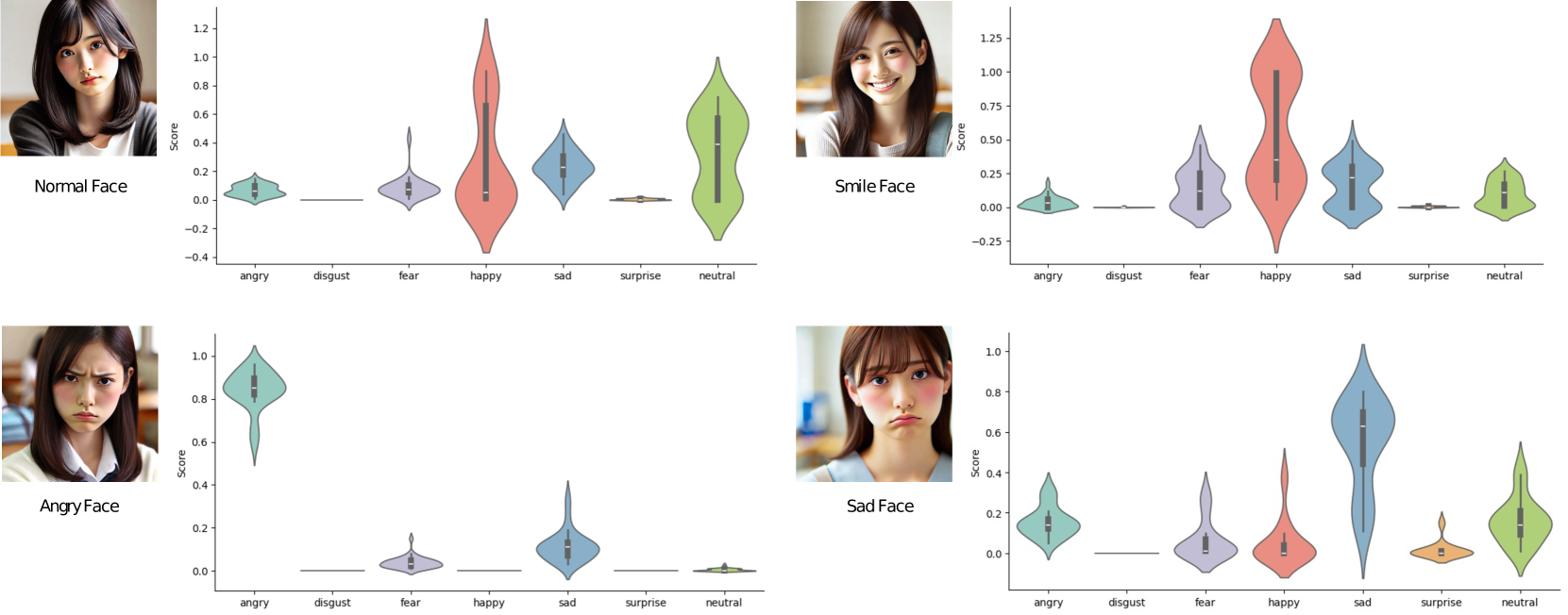

- 实验结果表明,对于快乐和愤怒等情绪,AI代理能够根据用户情绪状态进行相应的对话。

📝 摘要(中文)

ChatGPT等大型语言模型(LLM)的性能得到了显著提升,它们在在线环境中被广泛应用,例如网页上的聊天机器人、使用语音交互的呼叫中心运营以及使用代理的对话功能。在离线环境中,多模态对话功能也正在实现,例如使用平板电脑终端的人工智能代理(AI代理)的引导以及安装在机器人上的LLM形式的对话系统。在这种多模态对话中,AI和用户之间的相互情绪识别将变得重要。目前已经存在一些方法可以表达AI代理的情绪,或者使用用户话语的文本或语音信息来识别情绪,但尚未研究AI代理从用户面部表情识别情绪的方法。本研究探讨了基于LLM的AI代理是否可以通过摄像头捕捉与用户对话时的面部表情,从中识别情绪,并将这些情绪信息添加到提示中,从而根据用户的情绪状态与用户进行交互。结果证实,对于快乐和愤怒等得分相对较高的情绪状态,AI代理可以根据情绪状态进行对话。

🔬 方法详解

问题定义:现有对话系统主要依赖文本或语音信息进行情绪识别,忽略了面部表情这一重要的非语言信息来源。这导致AI无法充分理解用户的真实情感状态,影响了对话的自然性和有效性。尤其是在人机交互中,面部表情能够提供更丰富的情感线索,现有方法的不足限制了AI在情感理解方面的能力。

核心思路:本研究的核心思路是将视觉信息(面部表情)融入到基于LLM的对话系统中,使AI能够像人类一样,通过观察对方的表情来理解其情感状态,从而做出更恰当的反应。通过将面部表情识别结果作为prompt的一部分输入LLM,引导LLM生成更符合用户情感状态的回复。

技术框架:该方法主要包含以下几个模块:1. 摄像头捕捉用户面部图像;2. 面部表情识别模块,用于从面部图像中提取情绪信息(例如,快乐、愤怒、悲伤等);3. LLM对话系统,接收用户输入和面部表情识别结果,生成回复;4. Prompt构建模块,将用户输入和面部表情识别结果组合成prompt,输入LLM。整体流程是:用户与系统对话,摄像头捕捉用户面部表情,表情识别模块提取情绪信息,prompt构建模块将用户输入和情绪信息组合成prompt,LLM根据prompt生成回复。

关键创新:该研究的关键创新在于将面部表情识别与LLM对话系统相结合,实现了基于视觉情感感知的对话。与现有方法相比,该方法能够利用更丰富的用户情感信息,从而提升对话的自然性和有效性。这是首次尝试将面部表情识别融入到LLM驱动的对话系统中。

关键设计:论文中未详细描述面部表情识别模块的具体实现方式,也未提及LLM的具体选择和参数设置。Prompt构建方式是关键设计之一,需要确定如何将情绪信息有效地融入到prompt中,例如,可以使用自然语言描述情绪状态,或者使用特定的标记来表示情绪类别。损失函数和网络结构等技术细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,对于快乐和愤怒等得分相对较高的情绪状态,AI代理能够根据用户情绪状态进行对话。这意味着该方法在一定程度上实现了基于视觉情感感知的对话,验证了将面部表情识别融入LLM对话系统的可行性。虽然论文未提供具体的性能指标和对比实验,但初步结果表明该方法具有一定的潜力。

🎯 应用场景

该研究成果可应用于多种人机交互场景,例如:情感陪护机器人、智能客服、教育辅导系统等。通过识别用户情绪,AI能够提供更个性化、更贴心的服务,提升用户体验。未来,该技术有望应用于心理咨询、医疗诊断等领域,辅助专业人员进行情感分析和判断,具有广阔的应用前景。

📄 摘要(原文)

The performance of ChatGPT© and other LLMs has improved tremendously, and in online environments, they are increasingly likely to be used in a wide variety of situations, such as ChatBot on web pages, call center operations using voice interaction, and dialogue functions using agents. In the offline environment, multimodal dialogue functions are also being realized, such as guidance by Artificial Intelligence agents (AI agents) using tablet terminals and dialogue systems in the form of LLMs mounted on robots. In this multimodal dialogue, mutual emotion recognition between the AI and the user will become important. So far, there have been methods for expressing emotions on the part of the AI agent or for recognizing them using textual or voice information of the user's utterances, but methods for AI agents to recognize emotions from the user's facial expressions have not been studied. In this study, we examined whether or not LLM-based AI agents can interact with users according to their emotional states by capturing the user in dialogue with a camera, recognizing emotions from facial expressions, and adding such emotion information to prompts. The results confirmed that AI agents can have conversations according to the emotional state for emotional states with relatively high scores, such as Happy and Angry.