SAGE-RT: Synthetic Alignment data Generation for Safety Evaluation and Red Teaming

作者: Anurakt Kumar, Divyanshu Kumar, Jatan Loya, Nitin Aravind Birur, Tanay Baswa, Sahil Agarwal, Prashanth Harshangi

分类: cs.AI, cs.CL, cs.CR

发布日期: 2024-08-14

💡 一句话要点

SAGE-RT:用于安全评估和红队测试的合成对齐数据生成

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 红队测试 安全评估 合成数据生成 大型语言模型 安全对齐

📋 核心要点

- 现有红队测试方法缺乏细致性和多样性,难以有效评估大型语言模型的安全性,且对数据生成过程缺乏足够的控制。

- SAGE-RT通过构建详细的有害主题分类体系,迭代扩展主题并调节输出,生成高质量的合成对齐和红队测试数据。

- 实验表明,SAGE-RT生成的红队测试数据能够有效越狱最先进的LLM,并在多个有害性子类别上达到100%的攻击成功率。

📝 摘要(中文)

本文介绍了一种用于生成合成对齐和红队测试数据的新型流程,名为SAGE-RT(或SAGE)。现有方法在创建细致且多样化的数据集、提供对数据生成和验证过程的必要控制,或需要大量手动生成的种子数据方面存在不足。SAGE通过使用详细的分类法来生成涵盖广泛主题的有害性安全对齐和红队测试数据,从而解决了这些限制。我们生成了51,000个多样且深入的提示-响应对,涵盖了1,500多个有害主题,并涵盖了大型语言模型(LLM)面临的最常见越狱提示的变体。我们表明,通过SAGE生成的红队测试数据在32个子类别中的27个以上,以及279个叶子类别(子-子类别)中的58个以上成功越狱了最先进的LLM。GPT-4o和GPT-3.5-turbo在有害性子类别上的攻击成功率达到100%。我们的方法通过确保使用主题的迭代扩展和基于生成的原始文本调节输出来详细覆盖有害主题,从而避免了合成安全训练数据生成中的模式崩溃和生成流程中缺乏细微差别的缺陷。该方法可用于完全合成地生成LLM安全红队测试和对齐数据,以使LLM更安全或对各种主题的模型进行红队测试。

🔬 方法详解

问题定义:现有红队测试方法存在以下痛点:一是生成的数据集不够细致和多样化,难以覆盖各种潜在的攻击场景;二是缺乏对数据生成过程的有效控制,难以保证数据的质量和相关性;三是需要大量手动生成的种子数据,成本高昂且效率低下。因此,需要一种能够自动生成高质量、多样化且可控的红队测试数据的方法,以更有效地评估和提升大型语言模型的安全性。

核心思路:SAGE-RT的核心思路是利用合成数据生成技术,通过构建详细的有害主题分类体系,迭代扩展主题并调节输出,从而生成高质量的红队测试数据。该方法避免了手动标注的成本和偏差,并能够覆盖更广泛的攻击场景。通过对生成过程的控制,可以确保数据的质量和相关性,从而更有效地评估和提升大型语言模型的安全性。

技术框架:SAGE-RT的整体流程包括以下几个主要阶段:1) 构建有害主题分类体系:定义各种有害行为和主题,形成一个层次化的分类结构。2) 迭代扩展主题:基于已有的主题,通过生成式模型或规则,自动扩展新的相关主题。3) 生成提示-响应对:根据主题,生成相应的提示和预期响应,形成红队测试数据。4) 数据验证与过滤:对生成的数据进行验证和过滤,去除质量较差或不相关的数据。

关键创新:SAGE-RT最重要的技术创新点在于其完全合成的数据生成流程,避免了对大量手动标注数据的依赖。通过详细的有害主题分类体系和迭代扩展机制,能够生成多样化且细致的红队测试数据,覆盖更广泛的攻击场景。此外,通过对生成过程的控制,可以确保数据的质量和相关性,从而更有效地评估和提升大型语言模型的安全性。

关键设计:SAGE-RT的关键设计包括:1) 有害主题分类体系的构建,需要仔细定义各种有害行为和主题,并建立清晰的层次结构。2) 迭代扩展机制的设计,需要选择合适的生成式模型或规则,以保证生成的新主题与已有主题的相关性和多样性。3) 提示-响应对的生成,需要根据主题设计合适的提示,并生成符合安全要求的预期响应。4) 数据验证与过滤,需要设计有效的指标和方法,以去除质量较差或不相关的数据。

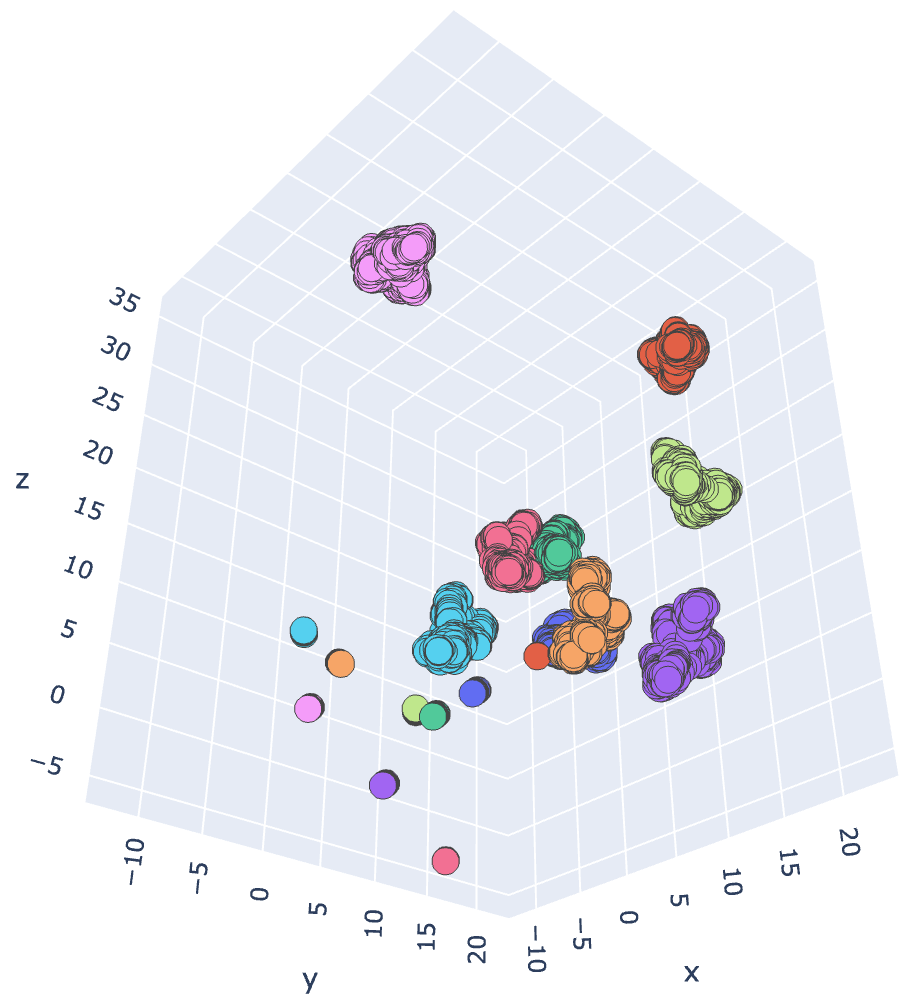

🖼️ 关键图片

📊 实验亮点

SAGE-RT生成的红队测试数据在32个子类别中的27个以上,以及279个叶子类别中的58个以上成功越狱了最先进的LLM,例如GPT-4o和GPT-3.5-turbo在有害性子类别上的攻击成功率达到100%。这表明SAGE-RT能够有效评估和发现大型语言模型中的安全漏洞。

🎯 应用场景

SAGE-RT可广泛应用于大型语言模型的安全评估和红队测试,帮助开发者发现和修复模型中的安全漏洞。该方法还可以用于生成安全对齐数据,提升模型的安全性和可靠性。此外,SAGE-RT还可以应用于其他人工智能系统的安全评估,例如自动驾驶系统和医疗诊断系统,具有重要的实际价值和未来影响。

📄 摘要(原文)

We introduce Synthetic Alignment data Generation for Safety Evaluation and Red Teaming (SAGE-RT or SAGE) a novel pipeline for generating synthetic alignment and red-teaming data. Existing methods fall short in creating nuanced and diverse datasets, providing necessary control over the data generation and validation processes, or require large amount of manually generated seed data. SAGE addresses these limitations by using a detailed taxonomy to produce safety-alignment and red-teaming data across a wide range of topics. We generated 51,000 diverse and in-depth prompt-response pairs, encompassing over 1,500 topics of harmfulness and covering variations of the most frequent types of jailbreaking prompts faced by large language models (LLMs). We show that the red-teaming data generated through SAGE jailbreaks state-of-the-art LLMs in more than 27 out of 32 sub-categories, and in more than 58 out of 279 leaf-categories (sub-sub categories). The attack success rate for GPT-4o, GPT-3.5-turbo is 100% over the sub-categories of harmfulness. Our approach avoids the pitfalls of synthetic safety-training data generation such as mode collapse and lack of nuance in the generation pipeline by ensuring a detailed coverage of harmful topics using iterative expansion of the topics and conditioning the outputs on the generated raw-text. This method can be used to generate red-teaming and alignment data for LLM Safety completely synthetically to make LLMs safer or for red-teaming the models over a diverse range of topics.