LLMs can Schedule

作者: Henrik Abgaryan, Ararat Harutyunyan, Tristan Cazenave

分类: cs.AI

发布日期: 2024-08-13

💡 一句话要点

利用大型语言模型解决Job Shop调度问题,性能媲美传统神经方法

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Job Shop调度 大型语言模型 生产优化 序列建模 智能调度

📋 核心要点

- Job Shop调度问题(JSSP)是一个经典的优化难题,传统方法难以在复杂场景下找到最优解。

- 该论文探索了使用大型语言模型(LLM)直接解决JSSP问题的可能性,并提出了一种新的训练和采样方法。

- 实验结果表明,基于LLM的调度方法可以达到与现有神经方法相当的性能,为JSSP提供了一种新的解决思路。

📝 摘要(中文)

Job Shop调度问题(JSSP)是优化生产流程中的一个重要挑战。它涉及在有限数量的机器上高效地分配作业,同时最小化总处理时间或作业延迟等因素。虽然人工智能的最新进展已经产生了有希望的解决方案,例如强化学习和图神经网络,但本文探索了大型语言模型(LLM)在JSSP中的潜力。我们首次引入了一个专门为训练LLM用于JSSP而设计的包含12万个样本的监督数据集。令人惊讶的是,我们的研究结果表明,基于LLM的调度可以达到与其他神经方法相当的性能。此外,我们提出了一种抽样方法,可以提高LLM在解决JSSP问题中的有效性。

🔬 方法详解

问题定义:Job Shop调度问题(JSSP)旨在优化生产流程,目标是在有限的机器资源下,为一系列作业安排最佳的加工顺序,以最小化诸如总完工时间或最大延迟等指标。现有的解决方法,如强化学习和图神经网络,虽然取得了一定的进展,但在泛化能力、训练成本和解释性方面仍存在挑战。

核心思路:该论文的核心思路是利用大型语言模型(LLM)强大的序列建模能力,将JSSP问题转化为一个序列生成问题。通过训练LLM学习JSSP的调度规则,使其能够直接生成可行的调度方案。这种方法避免了传统优化算法的复杂搜索过程,并有望提高调度效率和泛化能力。

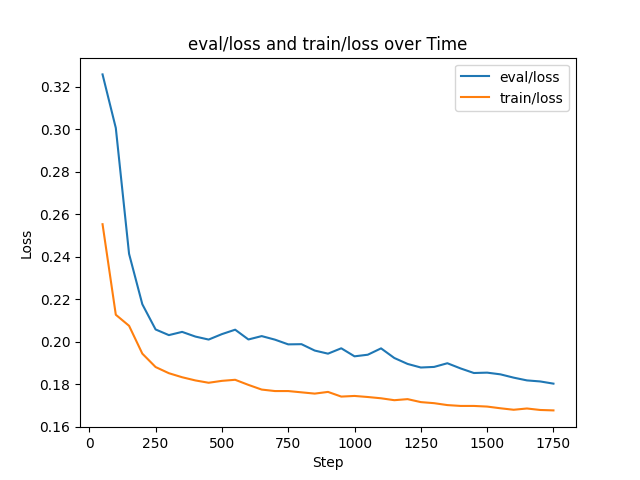

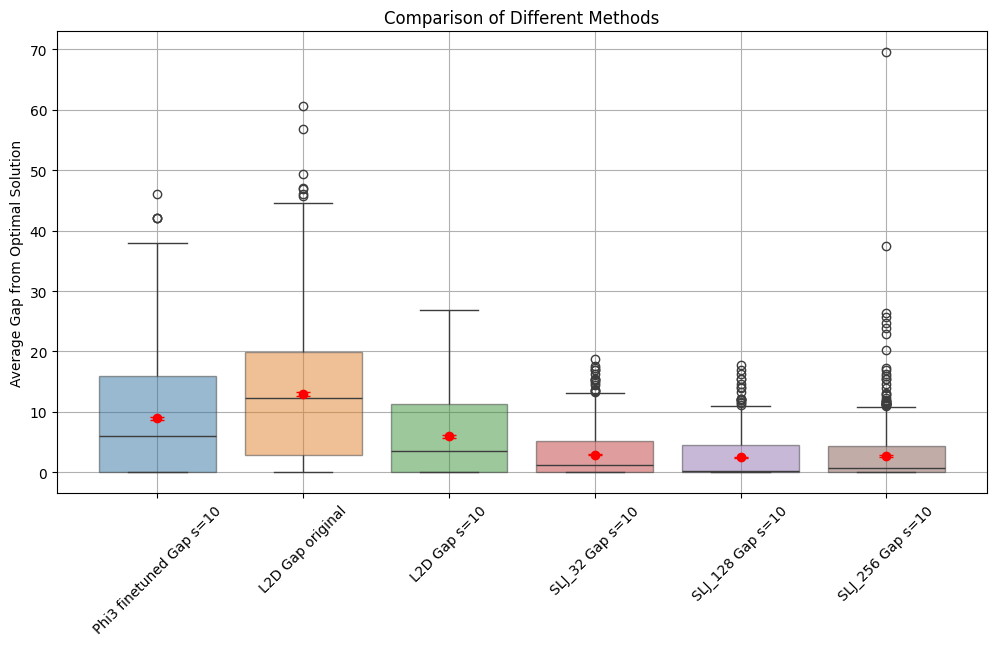

技术框架:该论文的技术框架主要包括以下几个部分:1) 构建JSSP数据集:作者构建了一个包含12万个样本的监督数据集,用于训练LLM。2) LLM模型选择与训练:选择合适的LLM模型,并使用构建的数据集进行训练,使其学习JSSP的调度规则。3) 采样方法:提出了一种新的采样方法,用于提高LLM生成调度方案的质量。4) 评估指标:使用总完工时间等指标评估LLM的调度性能。

关键创新:该论文的关键创新在于首次将大型语言模型应用于Job Shop调度问题,并证明了其可行性。此外,作者还提出了一种新的采样方法,可以有效提高LLM的调度性能。与现有方法相比,该方法具有更高的灵活性和可扩展性,可以应用于更复杂的JSSP场景。

关键设计:论文的关键设计包括:1) 数据集构建:数据集包含了不同规模的JSSP实例,以及对应的最优或近似最优解。2) LLM模型选择:具体使用的LLM模型未知,但需要具备强大的序列建模能力。3) 采样方法:具体的采样方法细节未知,但目标是提高LLM生成高质量调度方案的概率。4) 损失函数:损失函数用于衡量LLM生成调度方案与最优解之间的差距,并指导模型训练。

🖼️ 关键图片

📊 实验亮点

该论文的主要实验结果表明,基于LLM的调度方法可以达到与其他神经方法相当的性能。具体性能数据未知,但该结果证明了LLM在解决JSSP问题上的潜力。此外,提出的采样方法可以有效提高LLM的调度性能,进一步提升了该方法的竞争力。与传统优化算法相比,LLM方法具有更高的灵活性和可扩展性。

🎯 应用场景

该研究成果可应用于各种生产制造场景,例如汽车制造、电子产品组装、半导体生产等。通过利用LLM进行智能调度,可以显著提高生产效率,降低生产成本,并优化资源利用率。未来,该技术还可以扩展到其他调度优化问题,例如物流调度、交通调度等,具有广阔的应用前景。

📄 摘要(原文)

The job shop scheduling problem (JSSP) remains a significant hurdle in optimizing production processes. This challenge involves efficiently allocating jobs to a limited number of machines while minimizing factors like total processing time or job delays. While recent advancements in artificial intelligence have yielded promising solutions, such as reinforcement learning and graph neural networks, this paper explores the potential of Large Language Models (LLMs) for JSSP. We introduce the very first supervised 120k dataset specifically designed to train LLMs for JSSP. Surprisingly, our findings demonstrate that LLM-based scheduling can achieve performance comparable to other neural approaches. Furthermore, we propose a sampling method that enhances the effectiveness of LLMs in tackling JSSP.