Multi-Agent Continuous Control with Generative Flow Networks

作者: Shuang Luo, Yinchuan Li, Shunyu Liu, Xu Zhang, Yunfeng Shao, Chao Wu

分类: cs.AI, cs.MA

发布日期: 2024-08-13

🔗 代码/项目: GITHUB

💡 一句话要点

提出MACFN,通过生成流网络实现多智能体连续控制中的协同探索。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多智能体系统 生成流网络 连续控制 协同探索 流分解

📋 核心要点

- 传统GFlowNets的个体流匹配约束限制了其在多智能体连续控制问题中的应用。

- MACFN通过集中式全局流匹配训练分散式个体流策略,实现多智能体协同探索。

- 实验表明,MACFN优于现有方法,具有更强的探索能力,代码已开源。

📝 摘要(中文)

生成流网络(GFlowNets)旨在从一个分布中生成多样化的轨迹,其中轨迹的最终状态与奖励成正比,这为探索性控制任务提供了一种强大的强化学习替代方案。然而,GFlowNets中的个体流匹配约束限制了其在多智能体系统中的应用,尤其是在连续联合控制问题中。本文提出了一种新的多智能体生成连续流网络(MACFN)方法,使多个智能体能够对各种组合式连续对象进行协同探索。从技术上讲,MACFN以集中式的全局流匹配方式训练分散式的、基于个体流的策略。在集中式训练期间,MACFN引入了一个连续流分解网络,以推断每个智能体的流贡献,而只有全局奖励。然后,智能体可以仅基于其分配的局部流以分散的方式传递动作,从而形成与奖励成正比的联合策略分布。为了保证连续流分解的表达性,我们在理论上推导了分解网络的一致性条件。实验结果表明,该方法优于最先进的同类方法,并具有更好的探索能力。代码可在https://github.com/isluoshuang/MACFN获取。

🔬 方法详解

问题定义:论文旨在解决多智能体系统中,特别是连续控制问题中,如何利用生成流网络进行高效协同探索的问题。现有GFlowNets方法由于其个体流匹配约束,难以直接应用于多智能体系统,尤其是在奖励稀疏或具有组合性质的任务中,智能体难以有效探索。

核心思路:论文的核心思路是将全局奖励分解为每个智能体的局部流贡献,从而在集中式训练中学习分散式的个体策略。通过训练一个连续流分解网络,使得每个智能体可以根据其局部流贡献独立地选择动作,最终实现整体的协同探索。

技术框架:MACFN的整体框架包含以下几个主要模块:1) 集中式训练环境,用于收集多智能体的交互数据和全局奖励;2) 连续流分解网络,用于将全局流分解为每个智能体的局部流;3) 分散式个体策略网络,每个智能体根据其局部流贡献选择动作;4) GFlowNet的训练目标,用于优化连续流分解网络和个体策略网络。

关键创新:该方法最重要的创新点在于提出了连续流分解网络,它能够在只有全局奖励的情况下,学习到每个智能体的局部流贡献。这种分解方式使得智能体可以在分散的环境中独立行动,同时保证整体的协同性。此外,论文还从理论上推导了分解网络的一致性条件,保证了分解的有效性。

关键设计:连续流分解网络的设计至关重要,论文中可能采用了特定的网络结构(例如,基于Transformer或图神经网络),以捕捉智能体之间的依赖关系。损失函数的设计需要保证分解的准确性和一致性,可能包括流匹配损失、一致性损失等。此外,个体策略网络的设计也需要考虑连续动作空间的特点,可能采用高斯策略或其他连续动作策略。

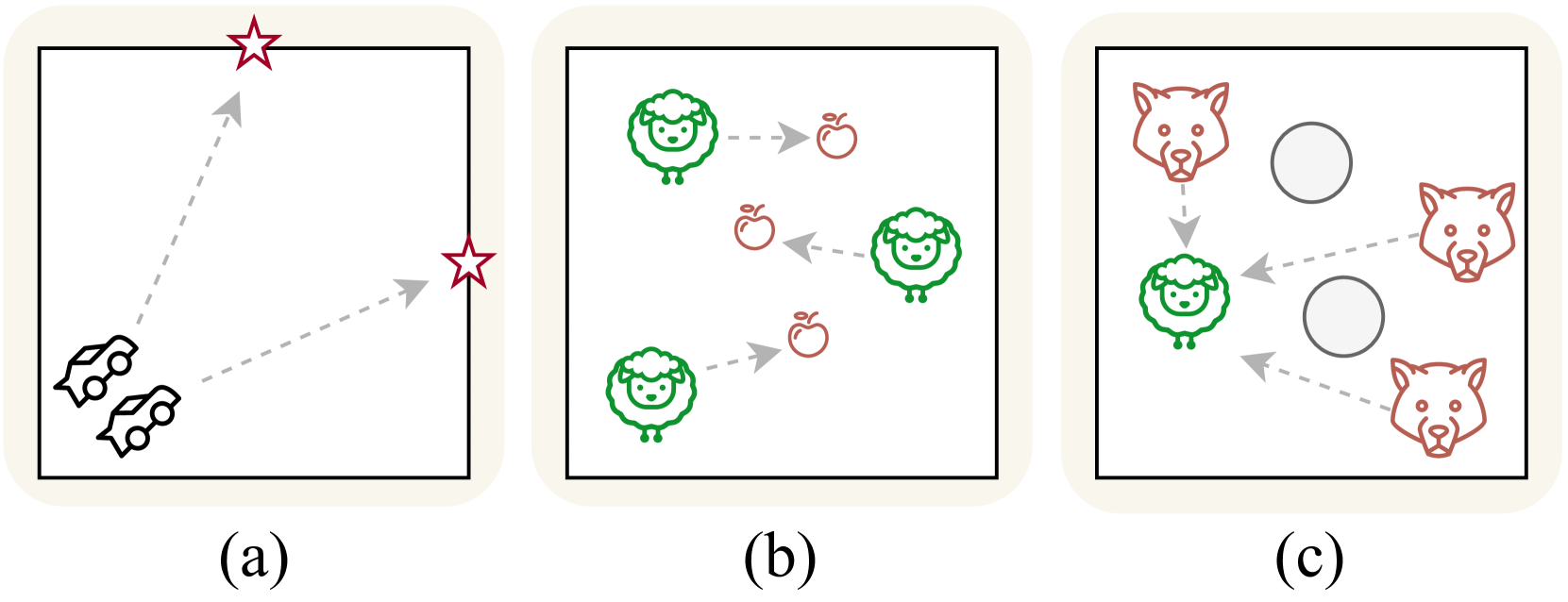

🖼️ 关键图片

📊 实验亮点

实验结果表明,MACFN在多智能体连续控制任务中优于现有方法,例如在协同推动物体等任务中,MACFN能够更快地找到最优策略,并取得更高的奖励。与传统的强化学习方法相比,MACFN具有更强的探索能力和更好的泛化性能。具体性能提升幅度未知,需参考论文中的实验数据。

🎯 应用场景

MACFN方法可应用于机器人协同操作、自动驾驶车辆编队、多智能体资源分配等领域。该方法能够有效提升多智能体系统的探索能力和协同效率,在复杂环境中实现更优的控制性能。未来,该方法有望扩展到更广泛的多智能体协作任务中,例如智能交通、智能制造等。

📄 摘要(原文)

Generative Flow Networks (GFlowNets) aim to generate diverse trajectories from a distribution in which the final states of the trajectories are proportional to the reward, serving as a powerful alternative to reinforcement learning for exploratory control tasks. However, the individual-flow matching constraint in GFlowNets limits their applications for multi-agent systems, especially continuous joint-control problems. In this paper, we propose a novel Multi-Agent generative Continuous Flow Networks (MACFN) method to enable multiple agents to perform cooperative exploration for various compositional continuous objects. Technically, MACFN trains decentralized individual-flow-based policies in a centralized global-flow-based matching fashion. During centralized training, MACFN introduces a continuous flow decomposition network to deduce the flow contributions of each agent in the presence of only global rewards. Then agents can deliver actions solely based on their assigned local flow in a decentralized way, forming a joint policy distribution proportional to the rewards. To guarantee the expressiveness of continuous flow decomposition, we theoretically derive a consistency condition on the decomposition network. Experimental results demonstrate that the proposed method yields results superior to the state-of-the-art counterparts and better exploration capability. Our code is available at https://github.com/isluoshuang/MACFN.