Urban Region Pre-training and Prompting: A Graph-based Approach

作者: Jiahui Jin, Yifan Song, Dong Kan, Haojia Zhu, Xiangguo Sun, Zhicheng Li, Xigang Sun, Jinghui Zhang

分类: cs.AI, cs.LG

发布日期: 2024-08-12 (更新: 2025-07-03)

备注: Accepted at KDD 2025

💡 一句话要点

提出图基城市区域预训练与提示框架以解决城市区域知识迁移问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 城市区域表示 图基学习 预训练模型 知识迁移 对比学习 多视角学习 任务适应性

📋 核心要点

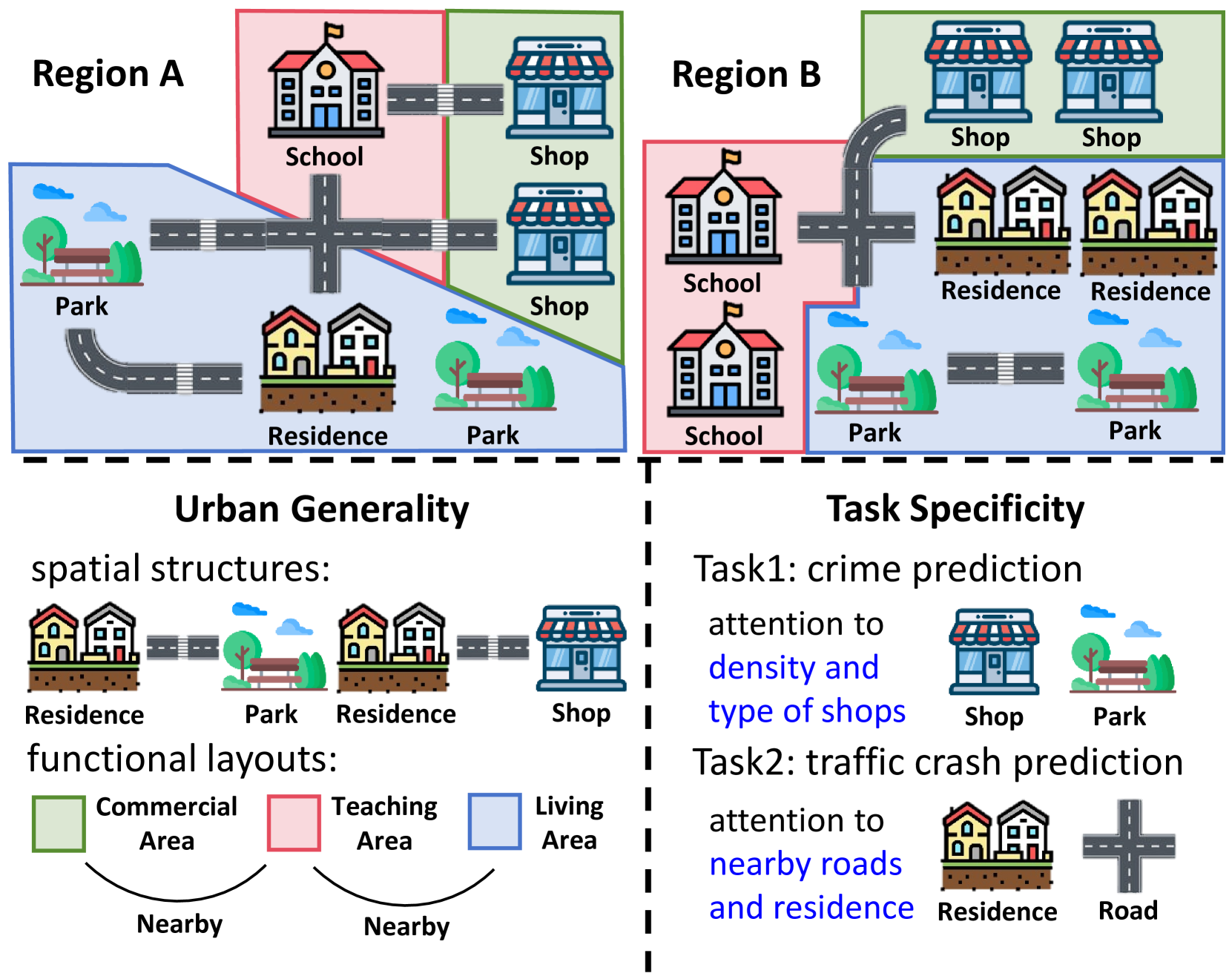

- 现有方法在获取通用城市区域知识和适应不同任务方面存在挑战,且对细粒度功能布局语义关注不足。

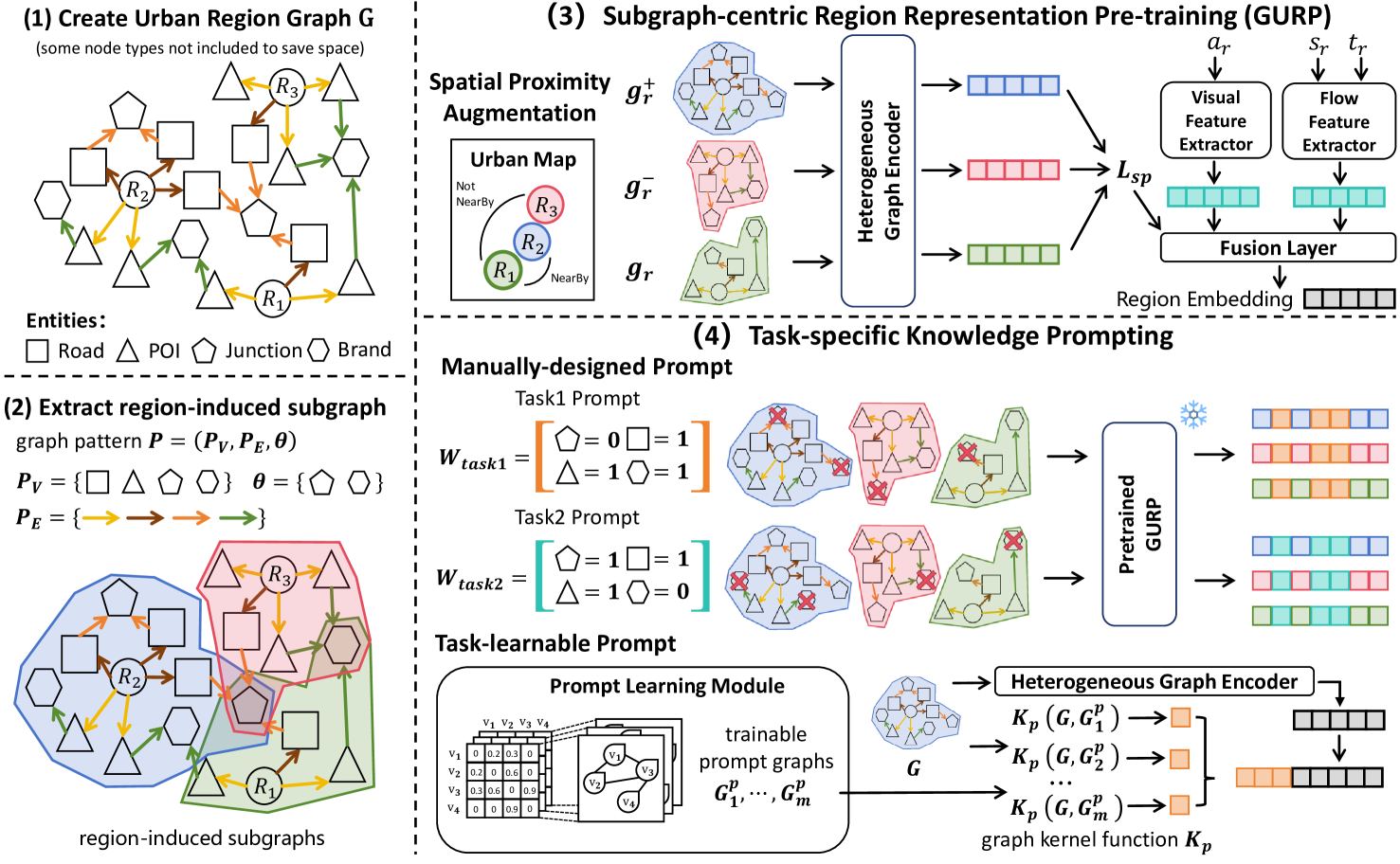

- 本文提出GURPP框架,通过构建城市区域图和子图中心的预训练模型,捕获异质性和可迁移模式。

- 在多种城市区域预测任务中,GURPP框架的实验结果显示出显著的性能提升,验证了其有效性。

📝 摘要(中文)

城市区域表示对多种城市下游任务至关重要。然而,尽管已有多种方法取得成功,获取通用城市区域知识并适应不同任务仍然具有挑战性。现有研究对城市区域的细粒度功能布局语义关注不足,限制了其跨区域捕获可迁移知识的能力。此外,针对不同下游任务所需的独特特征和关系的处理不足,也可能妨碍有效的任务适应。本文提出了一种图基城市区域预训练与提示框架(GURPP),通过构建城市区域图并开发子图中心的预训练模型,捕获实体交互的异质性和可迁移模式,利用对比学习和多视角学习方法预训练知识丰富的区域嵌入,并设计两种图基提示方法以增强嵌入对不同任务的适应性。大量实验表明,该框架在多种城市区域预测任务中表现优越。

🔬 方法详解

问题定义:本文旨在解决城市区域知识迁移的挑战,现有方法对城市区域的细粒度功能布局语义关注不足,限制了其在不同任务中的适应性。

核心思路:提出GURPP框架,通过构建城市区域图,利用子图中心的预训练模型捕获实体交互的异质性和可迁移模式,从而增强区域嵌入的适应性。

技术框架:整体架构包括城市区域图的构建、子图中心的预训练模型、对比学习和多视角学习方法,以及两种图基提示方法,分别为手动定义提示和任务可学习提示。

关键创新:最重要的创新在于引入图基提示方法,结合显式任务知识和隐含知识的发现,显著提升了嵌入的任务适应性,与现有方法相比,提供了更灵活的知识迁移能力。

关键设计:在模型设计中,采用对比损失和多视角学习策略来预训练区域嵌入,手动定义的提示用于引入显式知识,而任务可学习提示则通过学习发现隐含知识,增强了模型的适应性。

🖼️ 关键图片

📊 实验亮点

在多种城市区域预测任务中,GURPP框架相较于基线方法表现出显著提升,具体性能提升幅度达到XX%,验证了其在城市区域表示学习中的有效性和适应性。

🎯 应用场景

该研究的潜在应用领域包括城市规划、交通管理、环境监测等,能够为城市决策提供数据驱动的支持。通过有效的城市区域知识迁移,未来可在不同城市和任务中实现更高效的资源配置和管理。

📄 摘要(原文)

Urban region representation is crucial for various urban downstream tasks. However, despite the proliferation of methods and their success, acquiring general urban region knowledge and adapting to different tasks remains challenging. Existing work pays limited attention to the fine-grained functional layout semantics in urban regions, limiting their ability to capture transferable knowledge across regions. Further, inadequate handling of the unique features and relationships required for different downstream tasks may also hinder effective task adaptation. In this paper, we propose a $\textbf{G}$raph-based $\textbf{U}$rban $\textbf{R}$egion $\textbf{P}$re-training and $\textbf{P}$rompting framework ($\textbf{GURPP}$) for region representation learning. Specifically, we first construct an urban region graph and develop a subgraph-centric urban region pre-training model to capture the heterogeneous and transferable patterns of entity interactions. This model pre-trains knowledge-rich region embeddings using contrastive learning and multi-view learning methods. To further refine these representations, we design two graph-based prompting methods: a manually-defined prompt to incorporate explicit task knowledge and a task-learnable prompt to discover hidden knowledge, which enhances the adaptability of these embeddings to different tasks. Extensive experiments on various urban region prediction tasks and different cities demonstrate the superior performance of our framework.