Explainable AI Reloaded: Challenging the XAI Status Quo in the Era of Large Language Models

作者: Upol Ehsan, Mark O. Riedl

分类: cs.HC, cs.AI

发布日期: 2024-08-09 (更新: 2024-08-13)

备注: Accepted to ACM HTTF 2024

💡 一句话要点

针对大语言模型时代XAI的挑战,提出以人为中心的解释性框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 可解释人工智能 大型语言模型 以人为中心 黑盒模型 算法透明度

📋 核心要点

- 传统XAI侧重于打开模型黑盒,但在LLM时代,这种方法面临可访问性和实用性的挑战。

- 论文提出以人为中心的XAI视角,强调在黑盒外部、边缘以及利用基础设施缝隙来提供解释。

- 通过综合现有研究,论文为LLM时代的XAI发展方向提供了新的思路和实践建议。

📝 摘要(中文)

当可解释人工智能(XAI)的最初愿景被提出时,最流行的框架是打开人工智能的(隐喻)“黑盒”,以便我们能够理解其内部运作。随着大型语言模型(LLM)的出现,打开黑盒的能力越来越受到限制,特别是对于非AI专家最终用户而言。在本文中,我们挑战了LLM时代“打开”黑盒的假设,并主张转变我们对XAI的期望。通过强调以算法为中心的XAI视角的认知盲点,我们认为以人为中心的视角可以成为前进的道路。我们通过沿着三个维度综合XAI研究来实施该论点:黑盒之外的可解释性,黑盒边缘的可解释性,以及利用基础设施缝隙的可解释性。最后,我们总结了反思性地告知XAI作为一个领域的经验。

🔬 方法详解

问题定义:现有XAI方法主要关注打开模型内部的“黑盒”,试图理解模型的内部运作机制。然而,对于大型语言模型(LLM)而言,其复杂性使得直接理解内部机制变得困难,特别是对于非AI专家用户。此外,过度关注模型内部可能忽略了模型与用户、环境之间的交互,导致解释的实用性降低。

核心思路:论文的核心在于转变XAI的视角,从以算法为中心转向以人为中心。这意味着不再执着于完全理解模型内部的运作方式,而是关注如何为用户提供有用的、可理解的解释,即使这些解释并不直接涉及模型的内部细节。核心在于提升用户对模型行为的理解和信任,从而更好地利用模型。

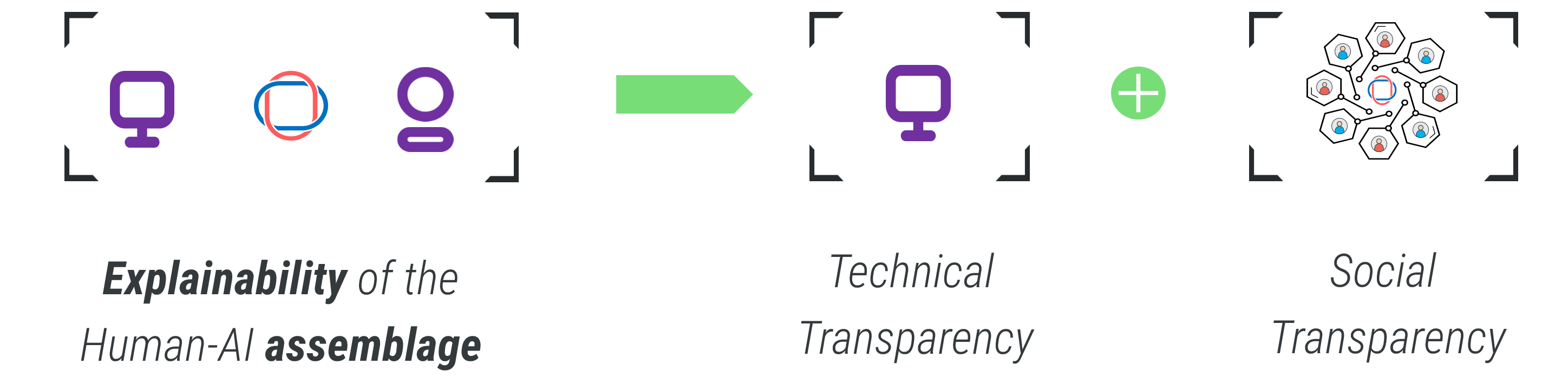

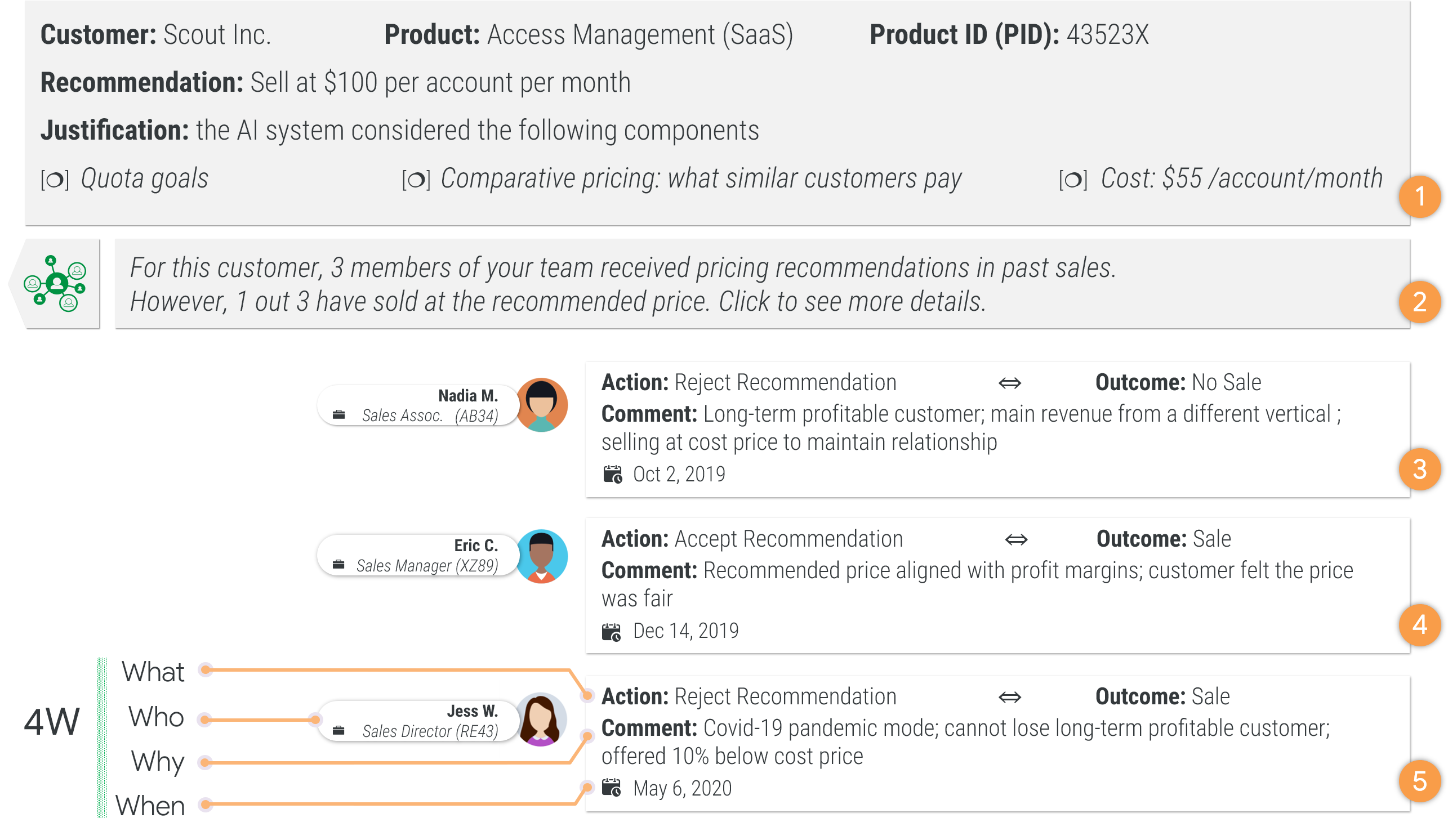

技术框架:论文并没有提出一个全新的技术框架,而是对现有XAI研究进行了重新组织和分类,提出了三个维度的解释性方法: 1. 黑盒之外的可解释性:关注模型输入输出之间的关系,例如通过对抗样本分析、输入敏感性分析等方法来理解模型对不同输入的反应。 2. 黑盒边缘的可解释性:关注模型与环境、用户之间的交互,例如通过用户反馈、模型调试等方式来改进模型的行为。 3. 利用基础设施缝隙的可解释性:利用现有的工具、平台和数据来提供解释,例如通过可视化工具、日志分析等方式来帮助用户理解模型。

关键创新:论文的关键创新在于提出了以人为中心的XAI视角,并将其应用于LLM时代。这种视角转变强调了XAI的实用性和可访问性,使得XAI不再仅仅是研究人员的专利,而是可以被更广泛的用户所使用。

关键设计:论文并没有提出具体的算法或模型设计,而是提供了一个概念框架,指导XAI研究人员在LLM时代应该关注哪些方面。关键在于理解用户的需求,并根据用户的需求来设计解释方法。例如,对于非AI专家用户,可能更需要高层次的、易于理解的解释,而不是复杂的数学公式或模型结构图。

🖼️ 关键图片

📊 实验亮点

该论文并非实验性研究,而是对现有XAI研究的综合和反思。其亮点在于提出了以人为中心的XAI视角,并将其应用于LLM时代。这种视角转变对于XAI领域的发展具有重要的指导意义,可以帮助研究人员更好地应对LLM带来的挑战。

🎯 应用场景

该研究成果可应用于各种需要可解释AI的场景,例如金融风控、医疗诊断、自动驾驶等。通过提供更易于理解的解释,可以提高用户对AI系统的信任度,促进AI技术的广泛应用。此外,该研究还可以帮助开发者更好地理解和调试AI系统,从而提高系统的性能和可靠性。

📄 摘要(原文)

When the initial vision of Explainable (XAI) was articulated, the most popular framing was to open the (proverbial) "black-box" of AI so that we could understand the inner workings. With the advent of Large Language Models (LLMs), the very ability to open the black-box is increasingly limited especially when it comes to non-AI expert end-users. In this paper, we challenge the assumption of "opening" the black-box in the LLM era and argue for a shift in our XAI expectations. Highlighting the epistemic blind spots of an algorithm-centered XAI view, we argue that a human-centered perspective can be a path forward. We operationalize the argument by synthesizing XAI research along three dimensions: explainability outside the black-box, explainability around the edges of the black box, and explainability that leverages infrastructural seams. We conclude with takeaways that reflexively inform XAI as a domain.