AppAgent v2: Advanced Agent for Flexible Mobile Interactions

作者: Yanda Li, Chi Zhang, Wenjia Jiang, Wanqi Yang, Bin Fu, Pei Cheng, Xin Chen, Ling Chen, Yunchao Wei

分类: cs.HC, cs.AI

发布日期: 2024-08-05 (更新: 2025-09-17)

💡 一句话要点

AppAgent v2:用于灵活移动交互的先进Agent框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 移动设备交互 多模态Agent 大型语言模型 RAG 用户界面 自动化任务 知识库

📋 核心要点

- 现有基于LLM的视觉Agent在移动设备交互方面存在不足,尤其是在复杂多步骤任务和跨应用场景中。

- AppAgent v2通过构建灵活的动作空间和定制的结构化知识库,提升了Agent在移动设备上的适应性和精确性。

- 实验结果表明,该框架在各种基准测试中表现出色,验证了其在实际场景中的有效性,展现了优越的性能。

📝 摘要(中文)

本文介绍了一种新颖的基于LLM的多模态Agent框架,用于移动设备交互。该框架能够像人类一样操作移动设备。Agent构建了一个灵活的动作空间,增强了其在各种应用程序中的适应性,包括解析器、文本和视觉描述。Agent的运行分为探索和部署两个阶段。在探索阶段,通过Agent驱动或手动探索,将用户界面元素的功能记录到定制的结构化知识库中。在部署阶段,RAG技术能够高效地从该知识库中检索和更新信息,从而使Agent能够有效且准确地执行任务,包括跨各种应用程序执行复杂的、多步骤的操作,从而展示了该框架在处理定制任务工作流程方面的适应性和精确性。在各种基准测试中进行的实验结果表明了该框架的卓越性能,证实了其在实际场景中的有效性。代码即将开源。

🔬 方法详解

问题定义:现有基于LLM的移动设备Agent在处理复杂、多步骤任务以及跨多个应用程序的任务时,面临着适应性和精确性的挑战。传统的Agent可能难以有效地理解和利用用户界面元素的功能,导致任务执行失败或效率低下。

核心思路:AppAgent v2的核心思路是构建一个灵活的动作空间和一个定制的结构化知识库。灵活的动作空间允许Agent适应不同的应用程序和任务需求,而结构化知识库则存储了用户界面元素的功能信息,以便Agent能够高效地检索和利用这些信息。通过探索阶段构建知识库,部署阶段利用RAG技术检索信息,从而提升Agent的性能。

技术框架:AppAgent v2的整体框架包含两个主要阶段:探索阶段和部署阶段。在探索阶段,Agent通过自主探索或人工辅助的方式,学习并记录用户界面元素的功能,并将这些信息存储到定制的结构化知识库中。在部署阶段,Agent利用RAG(Retrieval-Augmented Generation)技术,从知识库中检索相关信息,并生成相应的动作序列来完成任务。整个流程模拟了人类用户与移动设备的交互方式。

关键创新:AppAgent v2的关键创新在于其灵活的动作空间和定制的结构化知识库。灵活的动作空间允许Agent适应不同的应用程序和任务需求,而结构化知识库则提供了丰富的功能信息,使得Agent能够更准确地理解用户意图并执行相应的动作。此外,RAG技术的应用也提高了Agent检索和利用知识的效率。

关键设计:关于关键设计,论文中提到Agent构建了一个灵活的动作空间,增强了其在各种应用程序中的适应性,包括解析器、文本和视觉描述。在部署阶段,RAG技术能够高效地从该知识库中检索和更新信息,从而使Agent能够有效且准确地执行任务。但是具体的参数设置、损失函数、网络结构等技术细节,论文中没有详细说明,属于未知信息。

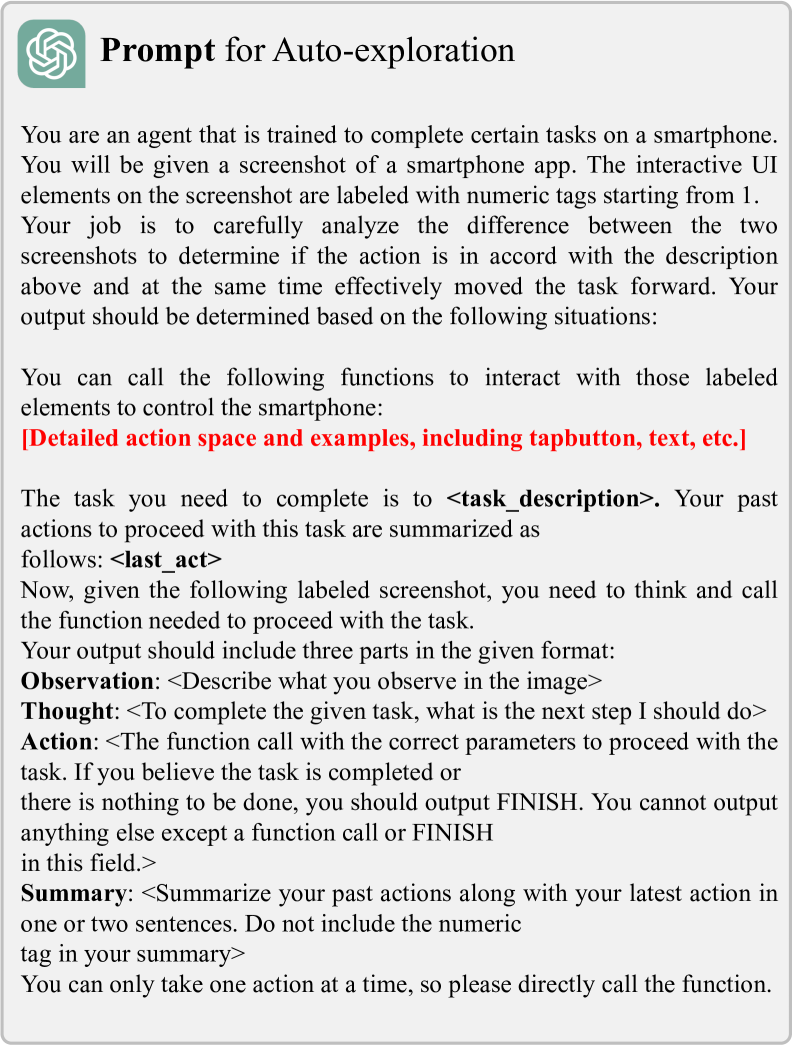

🖼️ 关键图片

📊 实验亮点

论文的实验结果表明,AppAgent v2在各种基准测试中表现出色,证明了其在实际场景中的有效性。具体的性能数据和对比基线在摘要中没有给出,需要在论文中进一步查找。但可以确定的是,该框架的性能优于现有方法,能够更准确、更高效地完成任务。

🎯 应用场景

AppAgent v2具有广泛的应用前景,可用于自动化测试、智能助手、辅助功能等领域。例如,它可以用于自动化测试应用程序的功能,帮助开发者快速发现和修复bug。此外,它还可以作为智能助手,帮助用户完成各种任务,例如预订机票、发送邮件等。对于残疾人士,AppAgent v2可以提供辅助功能,帮助他们更方便地使用移动设备。

📄 摘要(原文)

With the advancement of Multimodal Large Language Models (MLLM), LLM-driven visual agents are increasingly impacting software interfaces, particularly those with graphical user interfaces. This work introduces a novel LLM-based multimodal agent framework for mobile devices. This framework, capable of navigating mobile devices, emulates human-like interactions. Our agent constructs a flexible action space that enhances adaptability across various applications including parser, text and vision descriptions. The agent operates through two main phases: exploration and deployment. During the exploration phase, functionalities of user interface elements are documented either through agent-driven or manual explorations into a customized structured knowledge base. In the deployment phase, RAG technology enables efficient retrieval and update from this knowledge base, thereby empowering the agent to perform tasks effectively and accurately. This includes performing complex, multi-step operations across various applications, thereby demonstrating the framework's adaptability and precision in handling customized task workflows. Our experimental results across various benchmarks demonstrate the framework's superior performance, confirming its effectiveness in real-world scenarios. Our code will be open source soon.