Contrastive Learning-based Chaining-Cluster for Multilingual Voice-Face Association

作者: Wuyang Chen, Yanjie Sun, Kele Xu, Yong Dou

分类: cs.SD, cs.AI, eess.AS

发布日期: 2024-08-04 (更新: 2024-08-19)

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于对比学习的链式聚类方法,解决多语环境下的声纹-人脸关联问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 声纹识别 人脸识别 多模态融合 对比学习 聚类算法 跨语言 身份关联

📋 核心要点

- 现有方法难以有效关联多语环境下人脸与声纹,存在跨语言韵律建模和数据变异性挑战。

- 采用监督交叉对比学习(SCC)建立人脸和声纹的鲁棒关联,并设计链式聚类后处理减少异常值影响。

- 在FAME 2024挑战赛中获得第二名,验证了方法在多语声纹-人脸关联任务中的有效性和鲁棒性。

📝 摘要(中文)

本文提出了一种新颖的解决方案,用于解决多语环境下的声纹-人脸关联(FAME)2024挑战赛。该方案侧重于一种基于对比学习的链式聚类方法,以增强声纹和人脸之间的关联。该任务面临着在听觉和视觉模态线索之间建立生物特征关系,以及在不同语言之间建模韵律相互依赖性的挑战,同时还要解决数据中存在的内在和外在可变性。为了应对这些挑战,我们的方法采用监督交叉对比(SCC)学习来建立多语言场景中声纹和人脸之间的鲁棒关联。在此之后,我们专门设计了一个基于链式聚类的后处理步骤,以减轻在无约束的真实数据中经常发现的异常值的影响。我们进行了广泛的实验,以研究语言对声纹-人脸关联的影响。总体结果在FAME公共评估平台上进行了评估,我们获得了第二名。结果表明了我们方法的优越性能,并且我们验证了我们提出的方法的鲁棒性和有效性。

🔬 方法详解

问题定义:论文旨在解决多语环境下声纹和人脸关联的问题。现有方法在处理跨语言的韵律差异以及数据中存在的各种变异性(例如,光照、姿态、口音等)时,关联效果不佳,容易受到噪声和异常值的影响。因此,如何在复杂的多语环境下建立鲁棒的声纹-人脸关联是该论文要解决的核心问题。

核心思路:论文的核心思路是利用监督交叉对比学习(SCC)来学习人脸和声纹之间的共享表示空间,从而建立它们之间的鲁棒关联。通过对比学习,模型能够区分属于同一身份的不同模态数据,并拉近它们在特征空间中的距离,同时推开属于不同身份的数据。此外,论文还设计了一个链式聚类后处理步骤,用于过滤掉异常值,进一步提高关联的准确性。

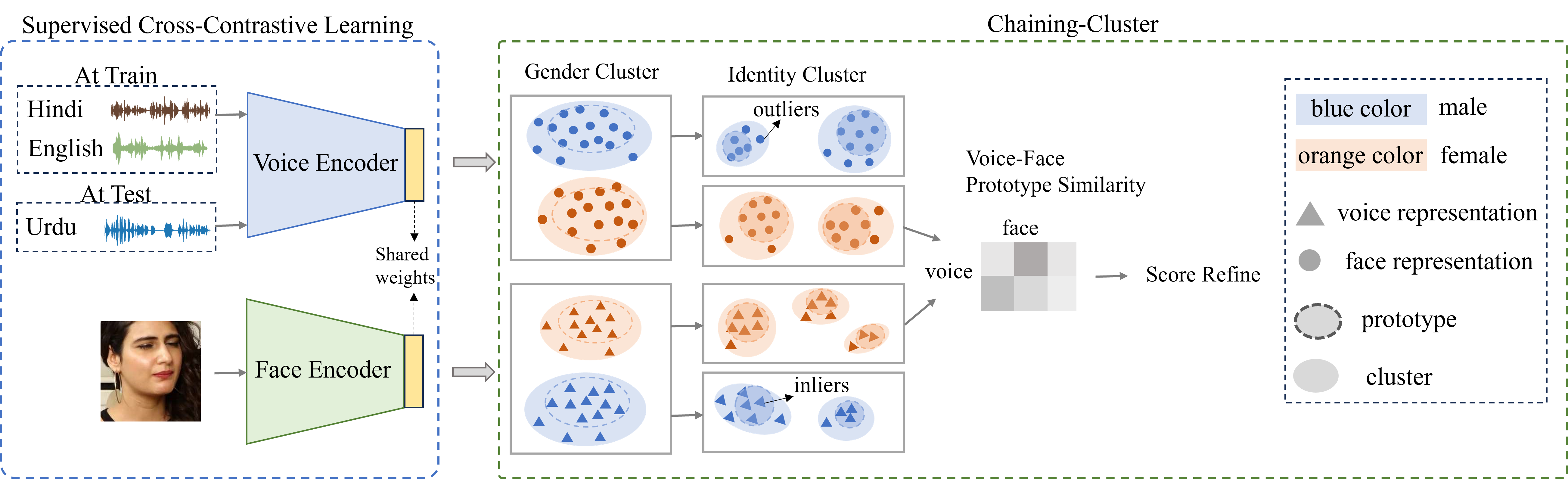

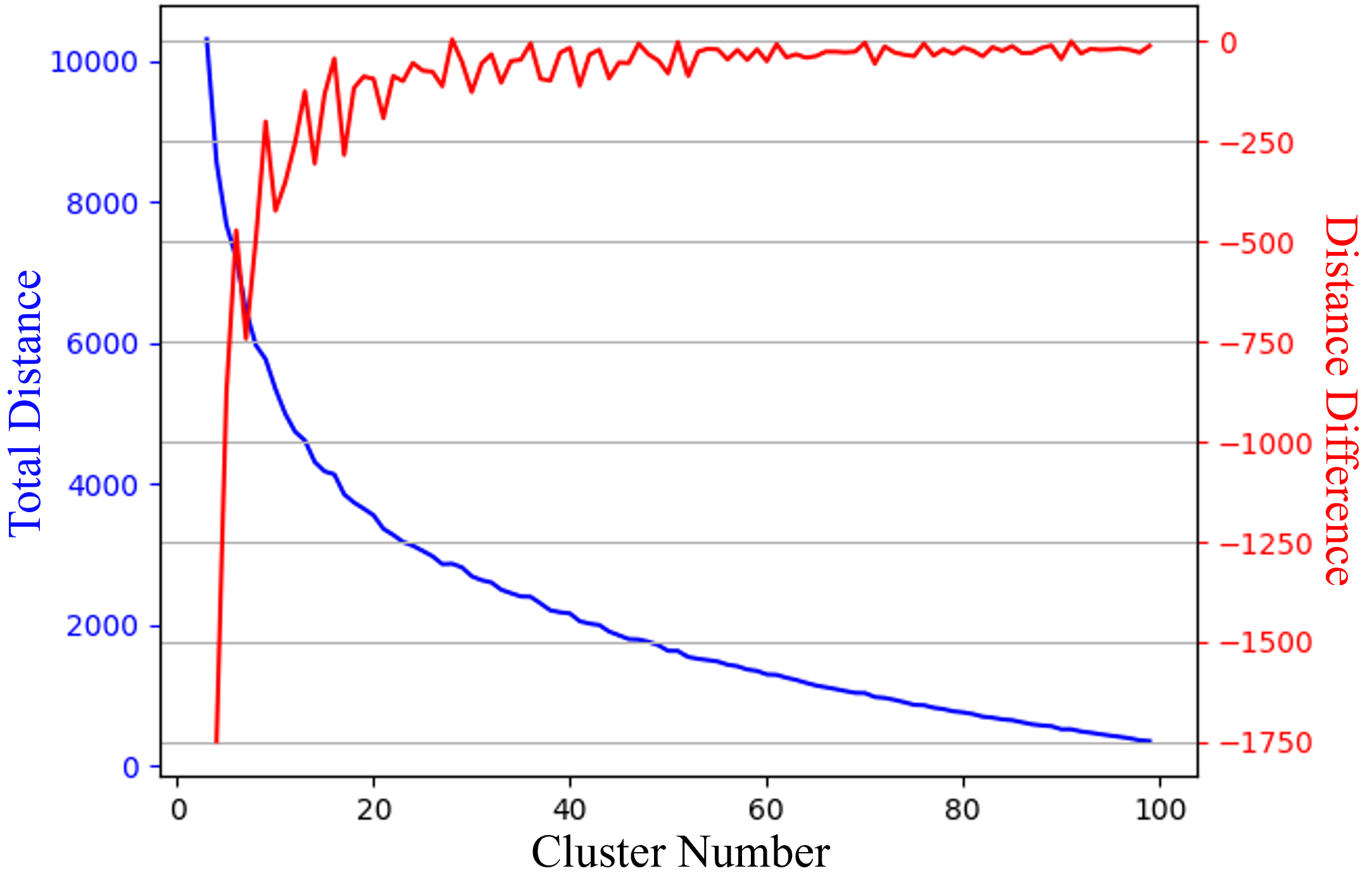

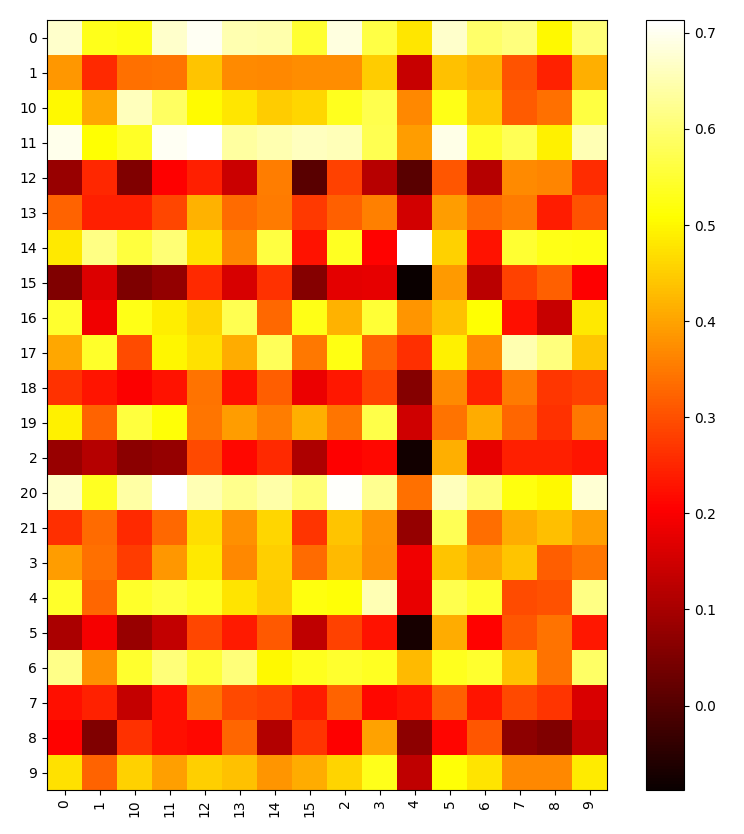

技术框架:整体框架包含两个主要阶段:1) 特征提取和对比学习阶段:使用预训练模型(具体模型未知)提取人脸和声纹的特征,然后使用监督交叉对比学习(SCC)损失函数训练模型,使得同一身份的人脸和声纹特征在嵌入空间中更加接近,不同身份的特征更加远离。2) 链式聚类后处理阶段:对对比学习得到的关联结果进行聚类,并利用链式聚类算法识别并去除异常值,从而提高关联的准确性。

关键创新:论文的关键创新在于将监督交叉对比学习(SCC)应用于多语环境下的声纹-人脸关联任务,并结合链式聚类进行后处理。SCC 能够有效地学习跨模态的共享表示,从而提高关联的鲁棒性。链式聚类则能够有效地过滤掉异常值,进一步提高关联的准确性。这种结合对比学习和聚类的方法,能够更好地应对多语环境下的复杂性和挑战。

关键设计:论文的关键设计包括:1) 监督交叉对比学习损失函数的设计:具体损失函数的形式未知,但其目标是拉近同一身份的人脸和声纹特征,推开不同身份的特征。2) 链式聚类算法的具体实现:算法细节未知,但其目标是识别并去除关联结果中的异常值。3) 特征提取器的选择和训练:使用了预训练模型提取特征,但具体模型结构和训练方式未知。这些设计共同保证了方法在多语环境下的有效性和鲁棒性。

🖼️ 关键图片

📊 实验亮点

该方法在FAME 2024挑战赛中获得了第二名,验证了其在多语声纹-人脸关联任务中的有效性。实验结果表明,所提出的监督交叉对比学习和链式聚类后处理能够有效地提高关联的准确性和鲁棒性。具体的性能提升数据未知,但排名结果证明了该方法的优越性。

🎯 应用场景

该研究成果可应用于多媒体内容分析、智能安防、身份验证等领域。例如,在视频监控中,可以通过声纹和人脸的关联来快速识别目标人物;在智能客服中,可以根据用户的声音和面部表情来提供个性化的服务。未来,该技术有望在人机交互、虚拟现实等领域发挥更大的作用。

📄 摘要(原文)

The innate correlation between a person's face and voice has recently emerged as a compelling area of study, especially within the context of multilingual environments. This paper introduces our novel solution to the Face-Voice Association in Multilingual Environments (FAME) 2024 challenge, focusing on a contrastive learning-based chaining-cluster method to enhance face-voice association. This task involves the challenges of building biometric relations between auditory and visual modality cues and modelling the prosody interdependence between different languages while addressing both intrinsic and extrinsic variability present in the data. To handle these non-trivial challenges, our method employs supervised cross-contrastive (SCC) learning to establish robust associations between voices and faces in multi-language scenarios. Following this, we have specifically designed a chaining-cluster-based post-processing step to mitigate the impact of outliers often found in unconstrained in the wild data. We conducted extensive experiments to investigate the impact of language on face-voice association. The overall results were evaluated on the FAME public evaluation platform, where we achieved 2nd place. The results demonstrate the superior performance of our method, and we validate the robustness and effectiveness of our proposed approach. Code is available at https://github.com/colaudiolab/FAME24_solution.