Recording First-person Experiences to Build a New Type of Foundation Model

作者: Dionis Barcari, David Gamez, Aliya Grig

分类: cs.AI, cs.HC, cs.LG

发布日期: 2024-07-31

备注: 5 pages, 5 figures, 3 tables. arXiv admin note: substantial text overlap with arXiv:2408.00030

💡 一句话要点

提出一种基于第一人称体验记录的新型基础模型构建方法,旨在更精确地复现人类行为

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 第一人称视角 基础模型 多模态数据 生理信号 行为建模

📋 核心要点

- 现有基础模型依赖互联网数据,面临数据枯竭问题,且难以捕捉人类真实情感和生理反应。

- 论文提出一种基于第一人称体验记录的新型基础模型构建方法,旨在更精确地复现人类行为。

- 论文设计了记录设备,捕捉视觉、听觉、皮肤电导、面部表情和脑电图等多模态数据,并进行了初步测试。

📝 摘要(中文)

近年来,基础模型产生了巨大的影响,大量资金投入到人工智能领域。像Chat-GPT这样流行的模型,都是基于大量的互联网数据进行训练的。然而,这种数据很快就会耗尽,科技公司正在寻找新的数据来源来训练下一代基础模型。强化学习、RAG、提示工程和认知建模等技术常被用于微调和增强基础模型的行为。这些技术已被用于复制人物,例如Caryn Marjorie。但这些聊天机器人并非基于人们对环境的真实情感和生理反应,因此充其量只是对其模仿角色的表面近似。为了解决这些问题,我们开发了一种记录设备,可以捕捉佩戴者所见所闻,以及他们的皮肤电导(GSR)、面部表情和脑部状态(14通道脑电图)。人工智能算法被用来将这些数据处理成关于环境和主体内部状态的丰富图像。基于这些数据训练的基础模型可以比目前已开发的人格模型更准确地复制人类行为。这种类型的模型具有许多潜在的应用,包括推荐、个人助理、GAN系统、约会和招聘。本文介绍了这项工作的背景,并描述了记录设备及其功能的初步测试。然后,提出了如何从记录设备捕获的数据中创建一种新型的基础模型,并概述了一些应用。数据收集和模型训练成本高昂,因此我们目前正在努力启动一家初创公司,以为该项目的下一阶段筹集资金。

🔬 方法详解

问题定义:现有基础模型训练依赖于互联网数据,这些数据存在枯竭的风险,并且难以捕捉到人类真实的生理和情感反应。现有方法,如基于强化学习的微调,只能在表面上近似模仿人类行为,无法深入理解人类行为背后的内在机制。

核心思路:论文的核心思路是通过记录第一人称视角下的多模态数据(视觉、听觉、生理信号等),构建一个更丰富、更真实的数据集,从而训练出能够更准确地模拟人类行为的基础模型。这种方法旨在捕捉人类对环境的真实反应,而不仅仅是表面行为。

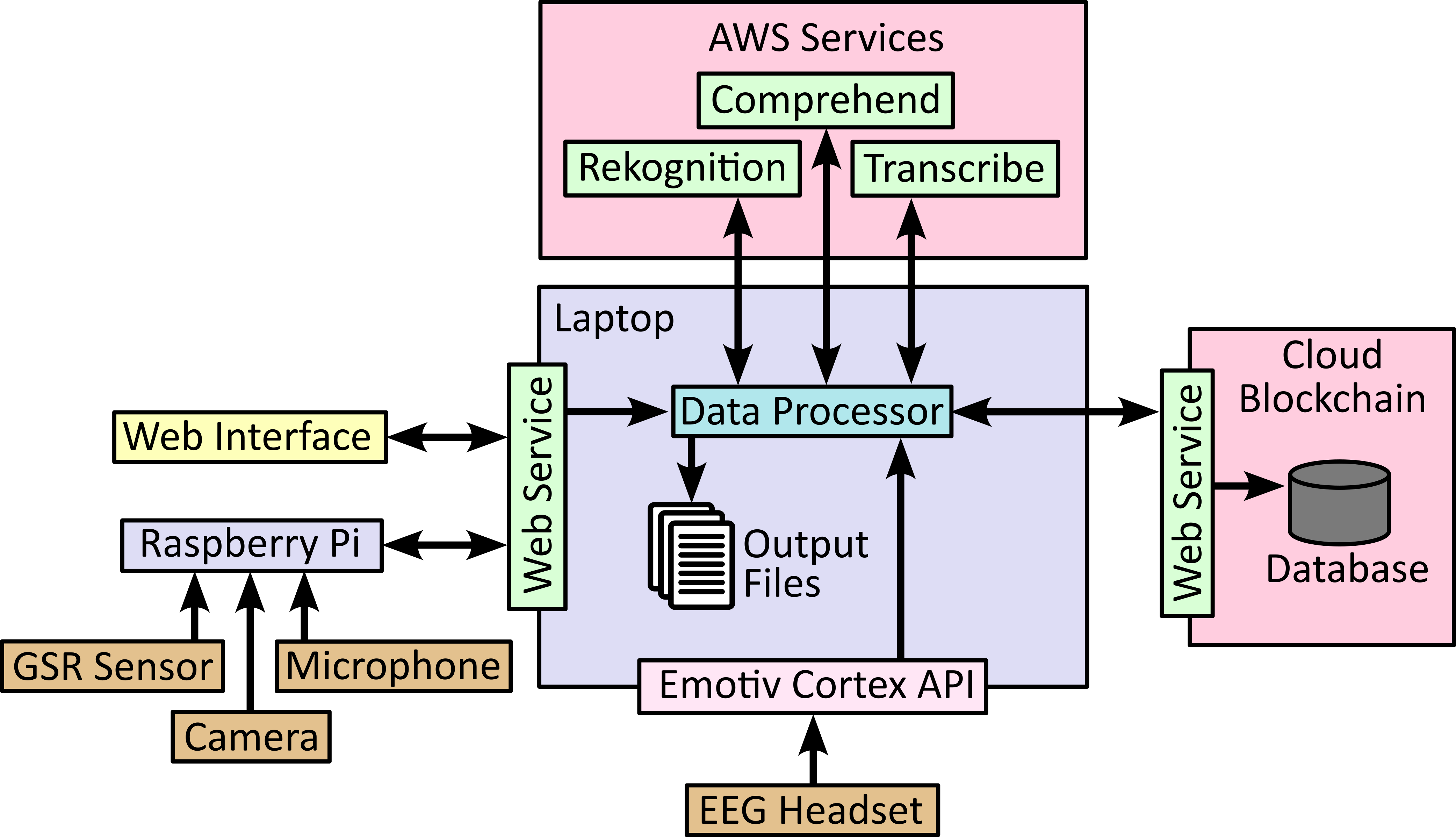

技术框架:该方法的核心在于一个定制的记录设备,该设备能够同时捕捉佩戴者的视觉和听觉信息,以及皮肤电导(GSR)、面部表情和脑电图(EEG)等生理信号。然后,使用AI算法处理这些数据,提取环境和主体内部状态的特征。最终,使用这些数据训练基础模型。

关键创新:该方法的关键创新在于数据采集方式的改变,从传统的互联网数据转向第一人称体验记录。这种方式能够捕捉到更丰富、更真实的人类行为数据,包括生理和情感反应。此外,多模态数据的融合也是一个创新点,能够更全面地描述人类行为。

关键设计:记录设备的关键设计包括:1) 高质量的视觉和听觉传感器,用于捕捉环境信息;2) 皮肤电导传感器,用于测量皮肤的电导率,反映情绪状态;3) 面部表情识别算法,用于分析面部表情;4) 14通道脑电图(EEG)设备,用于测量脑电活动。数据处理方面,需要设计合适的AI算法,将多模态数据融合,并提取有用的特征。模型训练方面,需要选择合适的基础模型架构,并设计合适的损失函数,以优化模型的性能。

🖼️ 关键图片

📊 实验亮点

论文描述了记录设备的初步测试,验证了设备能够有效地捕捉视觉、听觉、皮肤电导、面部表情和脑电图等多模态数据。虽然论文没有提供具体的性能数据,但初步测试结果表明,该方法具有可行性,并为构建更准确的人类行为模型奠定了基础。

🎯 应用场景

该研究具有广泛的应用前景,包括:个性化推荐系统,能够根据用户的真实反应提供更精准的推荐;个人助理,能够更好地理解用户的需求和情感;生成对抗网络(GAN),用于生成更逼真的人类行为;约会应用,能够帮助用户找到更合适的伴侣;招聘系统,能够更准确地评估候选人的能力和性格。

📄 摘要(原文)

Foundation models have had a big impact in recent years and billions of dollars are being invested in them in the current AI boom. The more popular ones, such as Chat-GPT, are trained on large amounts of Internet data. However, it is becoming apparent that this data is likely to be exhausted soon, and technology companies are looking for new sources of data to train the next generation of foundation models. Reinforcement learning, RAG, prompt engineering and cognitive modelling are often used to fine-tune and augment the behaviour of foundation models. These techniques have been used to replicate people, such as Caryn Marjorie. These chatbots are not based on people's actual emotional and physiological responses to their environment, so they are, at best, a surface-level approximation to the characters they are imitating. To address these issues, we have developed a recording rig that captures what the wearer is seeing and hearing as well as their skin conductance (GSR), facial expression and brain state (14 channel EEG). AI algorithms are used to process this data into a rich picture of the environment and internal states of the subject. Foundation models trained on this data could replicate human behaviour much more accurately than the personality models that have been developed so far. This type of model has many potential applications, including recommendation, personal assistance, GAN systems, dating and recruitment. This paper gives some background to this work and describes the recording rig and preliminary tests of its functionality. It then suggests how a new type of foundation model could be created from the data captured by the rig and outlines some applications. Data gathering and model training are expensive, so we are currently working on the launch of a start-up that could raise funds for the next stage of the project.